ภาพ AI ปลอมทำงานอย่างไร?

ทุกวันนี้ AI มีอยู่ทุกหนทุกแห่งแม้กระทั่งในสงคราม แอปพลิเคชันปัญญาประดิษฐ์ได้รับการพัฒนาขึ้นมากในปีนี้ และแทบทุกคนสามารถใช้เครื่องสร้าง AI เพื่อสร้างภาพที่ดูสมจริงได้อย่างน้อยก็เมื่อมองครั้งแรก

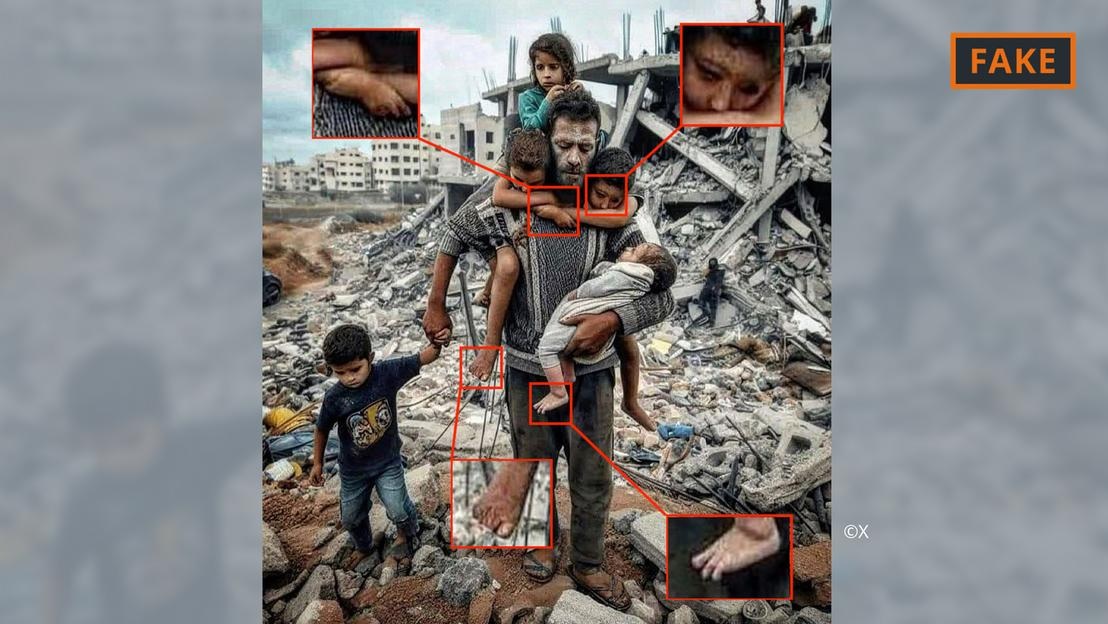

ภาพปลอมที่สร้างโดย AI ของสงครามในฉนวนกาซา

ผู้ใช้เพียงให้คำแนะนำแก่เครื่องมือ เช่น Midjourney หรือ Dall-E รวมทั้งข้อมูลจำเพาะและข้อมูลเพื่อดำเนินการนี้ จากนั้นเครื่องมือ AI จะแปลงข้อความหรือแม้แต่เสียงเตือนให้เป็นรูปภาพ

กระบวนการสร้างภาพนี้อาศัยสิ่งที่เรียกว่าการเรียนรู้ของเครื่องจักร ตัวอย่างเช่น หากผู้สร้างขอให้แสดงภาพชายวัย 70 ปีกำลังขี่จักรยาน พวกเขาจะค้นหาฐานข้อมูลเพื่อจับคู่คำศัพท์กับรูปภาพ

จากข้อมูลที่มีอยู่อัลกอริทึม AI จะสร้างภาพของนักปั่นจักรยานผู้สูงอายุ ด้วยอินพุตและการอัปเดตทางเทคนิคที่เพิ่มมากขึ้นอย่างต่อเนื่อง ทำให้เครื่องมือเหล่านี้ได้รับการปรับปรุงอย่างมากและมีการเรียนรู้อย่างต่อเนื่อง

ทั้งหมดนี้ถูกนำไปใช้กับภาพที่เกี่ยวข้องกับความขัดแย้งในตะวันออกกลาง ในความขัดแย้งที่ “มีอารมณ์รุนแรงมาก” ข้อมูลที่ผิดพลาด รวมถึงข้อมูลที่แพร่กระจายผ่านภาพ AI จะส่งผลกระทบอย่างใหญ่หลวง ผู้เชี่ยวชาญด้าน AI อย่าง Hany Farid กล่าว

ฟาริด ศาสตราจารย์ด้านการวิเคราะห์ดิจิทัลที่มหาวิทยาลัยแคลิฟอร์เนีย เบิร์กลีย์ กล่าวว่าการต่อสู้ที่ดุเดือดถือเป็นแหล่งเพาะพันธุ์ที่สมบูรณ์แบบสำหรับการสร้างและเผยแพร่เนื้อหาปลอม ตลอดจนการกระตุ้นอารมณ์

ภาพเอไอของสงครามอิสราเอล-ฮามาส

รูปภาพและวิดีโอที่สร้างขึ้นด้วยความช่วยเหลือของปัญญาประดิษฐ์ได้กระตุ้นให้เกิดการเผยแพร่ข้อมูลเท็จที่เกี่ยวข้องกับสงครามในยูเครน และสิ่งนี้ยังคงเกิดขึ้นอย่างต่อเนื่องในสงครามอิสราเอล-ฮามาส

ตามที่ผู้เชี่ยวชาญกล่าวไว้ ภาพ AI ที่แพร่หลายบนโซเชียลมีเดียเกี่ยวกับสงครามมักจะแบ่งออกเป็นสองประเภท หนึ่งที่มุ่งเน้นไปที่ความทุกข์ของผู้คนและกระตุ้นความเห็นอกเห็นใจ อีกอย่างคือ AI ปลอมที่ขยายเหตุการณ์ให้เกินจริง ก่อให้เกิดความขัดแย้งและความรุนแรงเพิ่มมากขึ้น

ภาพปลอมที่สร้างโดย AI ของพ่อและลูกใต้ซากปรักหักพังในฉนวนกาซา

ตัวอย่างเช่น หมวดหมู่แรกได้แก่ภาพถ่ายด้านบนของพ่อพร้อมกับลูกทั้งห้าคนยืนอยู่หน้ากองซากปรักหักพัง มีการแชร์หลายครั้งบน X (เดิมคือ Twitter) และ Instagram มีผู้เข้าชมหลายแสนครั้ง

รูปภาพนี้ถูกทำเครื่องหมายโดยชุมชนอย่างน้อยใน X ว่าเป็นของปลอม สามารถรับรู้ได้จากข้อผิดพลาดและความไม่สอดคล้องต่างๆ ที่มักพบในภาพ AI (ดูภาพด้านบน)

ความผิดปกติที่คล้ายคลึงกันยังสามารถเห็นได้ในภาพ AI ปลอมที่กลายเป็นไวรัลทาง X ด้านล่าง ซึ่งมีเจตนาแสดงให้เห็นครอบครัวชาวปาเลสไตน์กำลังกินอาหารร่วมกันบนซากปรักหักพัง

ภาพปลอมของพรรคปาเลสไตน์ที่สร้างโดย AI

ในขณะเดียวกัน รูปภาพอีกภาพซึ่งแสดงให้เห็นกองทหารโบกธงอิสราเอลขณะเดินผ่านชุมชนที่เต็มไปด้วยบ้านเรือนที่ถูกระเบิดนั้น จัดอยู่ในประเภทที่สอง ซึ่งออกแบบมาเพื่อปลุกปั่นความเกลียดชังและความรุนแรง

ภาพ AI เหล่านี้มาจากไหน?

ภาพความขัดแย้งที่สร้างโดย AI ส่วนใหญ่มักถูกโพสต์บนแพลตฟอร์มโซเชียลมีเดีย แต่ยังสามารถพบได้บนแพลตฟอร์มและองค์กรอื่นๆ อีกหลายแห่ง รวมถึงเว็บไซต์ข่าวบางแห่งด้วย

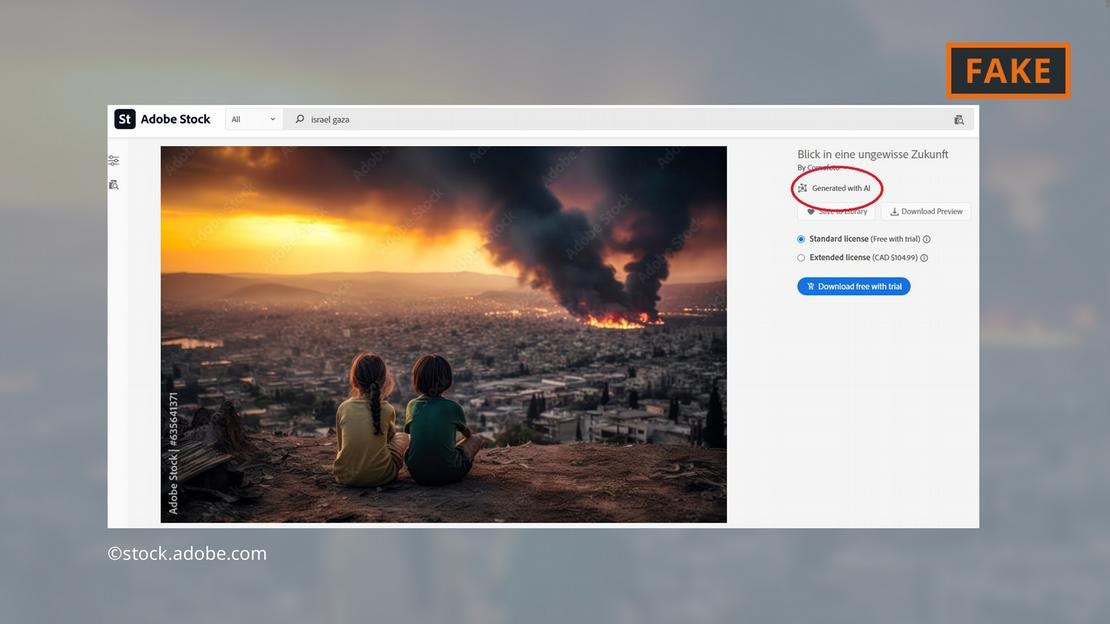

บริษัทซอฟต์แวร์ Adobe สร้างความฮือฮาด้วยการเพิ่มรูปภาพที่สร้างด้วย AI ลงในกลุ่มรูปภาพสต็อกภายในสิ้นปี 2022 โดยรูปภาพเหล่านี้จะได้รับการติดป้ายกำกับตามนั้นในฐานข้อมูล

ปัจจุบัน Adobe ยังเสนอขายภาพ AI ของสงครามในตะวันออกกลางอีกด้วย ไม่ว่าจะเป็นภาพการระเบิด ผู้ประท้วง หรือกลุ่มควันด้านหลังมัสยิดอัลอักซอ

Adobe นำเสนอภาพที่สร้างด้วย AI ของการสู้รบในฉนวนกาซา

นักวิจารณ์พบว่าเรื่องนี้เป็นเรื่องที่น่ากังวล เนื่องจากบางเว็บไซต์ยังคงใช้รูปภาพดังกล่าวโดยไม่ได้ระบุว่าเป็นรูปภาพที่สร้างโดย AI ตัวอย่างเช่น รูปภาพด้านบนปรากฏบนหน้า “Newsbreak” โดยไม่มีข้อบ่งชี้ใดๆ ว่าสร้างขึ้นโดยใช้ AI

แม้แต่ European Parliamentary Research Service ซึ่งเป็นหน่วยงานด้านวิทยาศาสตร์ของรัฐสภายุโรป ยังได้แสดงเอกสารออนไลน์เกี่ยวกับความขัดแย้งในตะวันออกกลางโดยใช้ภาพ AI จากฐานข้อมูลของ Adobe โดยไม่ได้ระบุว่าเป็นภาพที่สร้างโดย AI

European Digital Media Observatory เรียกร้องให้นักข่าวและผู้เชี่ยวชาญด้านสื่อระมัดระวังเป็นพิเศษเมื่อใช้ภาพ AI และขอแนะนำไม่ให้ใช้ โดยเฉพาะอย่างยิ่งเมื่อทำการรายงานเหตุการณ์ในชีวิตจริง เช่น สงครามในฉนวนกาซา

ภาพ AI อันตรายขนาดไหน?

เนื้อหาและภาพไวรัลของ AI ทำให้ผู้ใช้รู้สึกไม่สบายใจเกี่ยวกับทุกสิ่งทุกอย่างที่พบเจอทางออนไลน์ “หากเราเข้าสู่โลกที่ภาพ เสียง และวิดีโอสามารถถูกบิดเบือนได้ ทุกสิ่งก็จะกลายเป็นสิ่งที่น่าสงสัย ดังนั้น คุณจะสูญเสียศรัทธาในทุกสิ่ง รวมถึงความจริงด้วย” ฟาริด นักวิจัยจากมหาวิทยาลัยแคลิฟอร์เนีย เบิร์กลีย์ อธิบาย

นั่นคือสิ่งที่เกิดขึ้นในกรณีต่อไปนี้: ภาพของสิ่งที่กล่าวกันว่าเป็นศพที่ถูกเผาของทารกชาวอิสราเอลถูกแชร์บนโซเชียลมีเดียโดยนายกรัฐมนตรีอิสราเอล เบนจามิน เนทันยาฮู และนักการเมืองอีกหลายคน

แจ็กสัน ฮิงเคิล ซึ่งเป็นผู้มีอิทธิพลต่อต้านอิสราเอล อ้างในเวลาต่อมาว่าภาพดังกล่าวถูกสร้างขึ้นโดยใช้ปัญญาประดิษฐ์ แถลงการณ์ของ Hinkle มีผู้เข้าชมมากกว่า 20 ล้านครั้งบนโซเชียลมีเดีย และได้ก่อให้เกิดการถกเถียงอย่างดุเดือดบนแพลตฟอร์ม

ในที่สุด องค์กรและเครื่องมือตรวจสอบจำนวนมากก็ประกาศว่าภาพดังกล่าวเป็นของจริง และคำกล่าวอ้างของ Hinkle ก็เป็นเท็จ อย่างไรก็ตาม เห็นได้ชัดว่าไม่มีเครื่องมือใดที่จะช่วยให้ผู้ใช้ฟื้นความไว้วางใจที่สูญเสียไปกลับคืนมาได้อย่างง่ายดาย!

ฮวงไห่ (ตาม DW)

แหล่งที่มา

![[ภาพ] พบกับนักบินของ Victory Squadron](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/21/fd30103acbd744b89568ca707378d532)

![[ภาพ] นายกรัฐมนตรี Pham Minh Chinh ให้การต้อนรับรัฐมนตรีกระทรวงคมนาคมของฝรั่งเศส](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/21/aa649691f85546d59c3624b1821ab6e2)

![[ภาพ] นายกรัฐมนตรี Pham Minh Chinh ให้การต้อนรับผู้นำสาธารณรัฐตาตาร์สถาน สหพันธรัฐรัสเซีย](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/21/7877cb55fc794acdb7925c4cf893c5a1)

การแสดงความคิดเห็น (0)