รูปภาพของนักบินอวกาศกำลังขี่ม้าเป็นการผสมผสานระหว่างโมเดล AI เชิงกำเนิดสองประเภท ภาพ: MIT News

เมื่อความเร็วและคุณภาพไม่ใช่สิ่งที่ต้องแลกกันอีกต่อไป

ในสาขาการถ่ายภาพด้วย AI ปัจจุบันมีแนวทางหลักอยู่ 2 แนวทาง:

โมเดลการแพร่กระจายช่วยให้ได้ภาพที่คมชัดและมีรายละเอียดมากขึ้น อย่างไรก็ตาม การประมวลผลเหล่านี้ค่อนข้างช้าและต้องใช้การประมวลผลจำนวนมาก เนื่องจากต้องใช้ขั้นตอนการประมวลผลหลายสิบขั้นตอนเพื่อขจัดสัญญาณรบกวนจากแต่ละพิกเซล

ในทางกลับกัน โมเดลถดถอยอัตโนมัติจะทำงานได้เร็วกว่ามาก เนื่องจากสามารถคาดการณ์ส่วนเล็ก ๆ ของภาพตามลำดับได้ แต่บ่อยครั้งที่ภาพเหล่านั้นจะสร้างรายละเอียดที่ไม่ดีและมีแนวโน้มที่จะเกิดข้อผิดพลาดได้

HART (hybrid autoregressive transformer) รวมทั้งสองอย่างเข้าด้วยกัน เพื่อมอบ "สิ่งที่ดีที่สุดของทั้งสองโลก" ขั้นแรกจะใช้โมเดลอัตโนมัติถดถอยเพื่อสร้างภาพทั้งหมดโดยการเข้ารหัสเป็นโทเค็นที่แยกจากกัน จากนั้นโมเดลการแพร่กระจายน้ำหนักเบาจะดำเนินการเพิ่มโทเค็นที่เหลือ ซึ่งเป็นข้อมูลรายละเอียดที่สูญหายไปในระหว่างการเข้ารหัส

รูปภาพที่ได้มีคุณภาพเทียบเท่า (หรือดีกว่า) กับโมเดลการแพร่กระจายที่ล้ำสมัย แต่ประมวลผลได้เร็วกว่า 9 เท่า และใช้ทรัพยากรการคำนวณน้อยลง 31%

แนวทางใหม่ในการสร้างภาพคุณภาพด้วยความเร็วสูง

นวัตกรรมที่โดดเด่นอย่างหนึ่งของ HART คือการแก้ปัญหาการสูญเสียข้อมูลเมื่อใช้โมเดลถดถอยอัตโนมัติ การแปลงรูปภาพเป็นโทเค็นแยกจากกันจะทำให้ทุกอย่างเร็วขึ้น แต่ก็จะทำให้สูญเสียรายละเอียดสำคัญๆ เช่น ขอบวัตถุ รูปลักษณ์ใบหน้า เส้นผม ดวงตา ปาก และอื่นๆ ไปด้วย

โซลูชันของ HART คือการปล่อยให้โมเดลการแพร่กระจายเน้นที่การ "แก้ไข" รายละเอียดเหล่านี้ผ่านโทเค็นที่เหลืออยู่เพียงอย่างเดียว และเนื่องจากแบบจำลองอัตโนถดถอยได้ทำงานส่วนใหญ่เสร็จแล้ว แบบจำลองการแพร่กระจายจึงต้องมีขั้นตอนการประมวลผลเพียง 8 ขั้นตอนเท่านั้น แทนที่จะต้องมากกว่า 30 ขั้นตอนเหมือนก่อนหน้านี้

“โมเดลการแพร่กระจายนั้นนำไปใช้ได้ง่ายกว่า ส่งผลให้มีประสิทธิภาพสูงขึ้น” Haotian Tang ซึ่งเป็นผู้เขียนร่วมอธิบาย

โดยเฉพาะอย่างยิ่ง การผสมผสานระหว่างโมเดลหม้อแปลงอัตโนมัติที่มีพารามิเตอร์ 700 ล้านตัวและโมเดลการแพร่กระจายน้ำหนักเบาที่มีพารามิเตอร์ 37 ล้านตัวทำให้ HART มีประสิทธิภาพเท่ากับโมเดลการแพร่กระจายที่มีพารามิเตอร์สูงสุดถึง 2 พันล้านตัว แต่เร็วกว่าถึงเก้าเท่า

ในตอนแรก ทีมงานได้พยายามรวมแบบจำลองการแพร่กระจายเข้ากับขั้นตอนเริ่มต้นของการถ่ายภาพ แต่ส่งผลให้เกิดข้อผิดพลาดสะสม แนวทางที่มีประสิทธิภาพที่สุดคือปล่อยให้โมเดลการแพร่กระจายจัดการขั้นตอนสุดท้ายและเน้นเฉพาะส่วนที่ "หายไป" ของภาพเท่านั้น

ปลดล็อกอนาคตของ AI มัลติมีเดีย

ทิศทางต่อไปของทีมวิจัยคือการสร้างแบบจำลอง AI ด้านภาพและภาษารุ่นใหม่โดยใช้สถาปัตยกรรม HART เนื่องจาก HART สามารถปรับขนาดและปรับเปลี่ยนได้กับข้อมูลหลายประเภท (มัลติโหมด) พวกเขาจึงคาดหวังว่าสามารถนำไปประยุกต์ใช้ในการสร้างวิดีโอ การคาดการณ์เสียง และอื่นๆ อีกมากมาย

งานวิจัยนี้ได้รับทุนสนับสนุนจากหลายองค์กร รวมทั้ง MIT-IBM Watson AI Lab, MIT-Amazon Science Center, MIT AI Hardware Program และ US National Science Foundation NVIDIA ยังได้บริจาคโครงสร้างพื้นฐาน GPU เพื่อฝึกโมเดลดังกล่าวด้วย

(ตามรายงานของ MIT News)

ที่มา: https://vietnamnet.vn/cong-cu-ai-moi-tao-anh-chat-luong-cao-nhanh-gap-9-lan-2384719.html

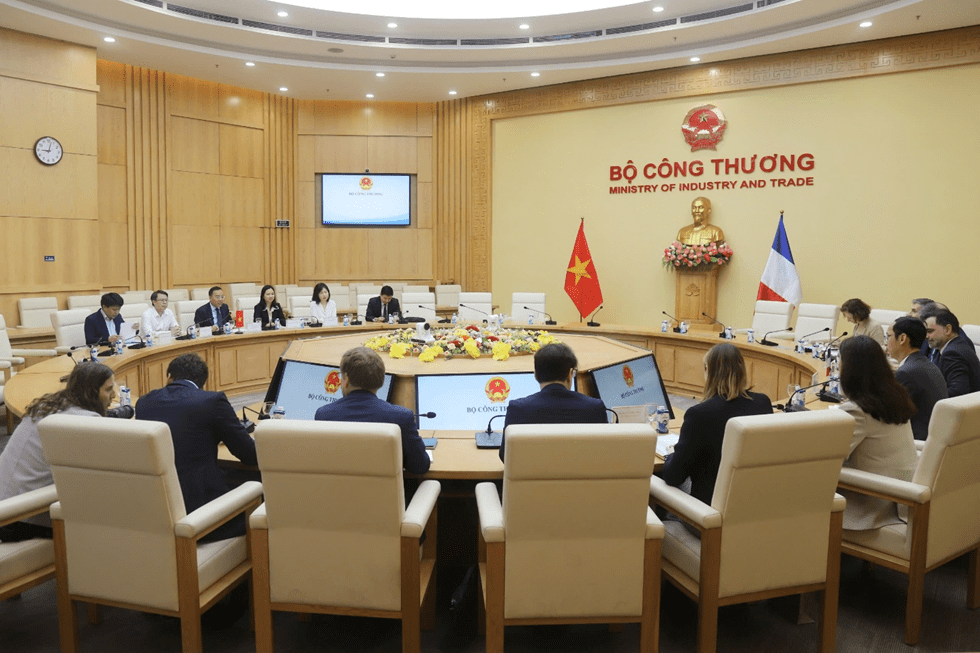

![[ภาพ] ก้าวข้ามทุกอุปสรรค เร่งสร้างโครงการขยายโรงไฟฟ้าพลังน้ำฮว่าบิ่ญให้คืบหน้า](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/bff04b551e98484c84d74c8faa3526e0)

![[ภาพ] การปิดการประชุมครั้งที่ 11 ของคณะกรรมการกลางพรรคคอมมิวนิสต์เวียดนามครั้งที่ 13](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/114b57fe6e9b4814a5ddfacf6dfe5b7f)

การแสดงความคิดเห็น (0)