เมื่อไม่นานนี้ กรมความปลอดภัยสารสนเทศได้ออกคำเตือนเกี่ยวกับเหตุการณ์ฉ้อโกงโดยใช้ภาพและวีดีโอไฮเทคที่เกิดขึ้นซ้ำๆ กัน

ด้วยเหตุนี้ สถานการณ์ของผู้ก่ออาชญากรรมทางไซเบอร์ที่ใช้ประโยชน์จากภาพและวิดีโอสาธารณะของผู้คน เพื่อตัดต่อ ตัดต่อ และข่มขู่แบล็กเมล์ด้วยวิดีโอปลอม จึงได้รับการเตือนจากทางการให้ประชาชนทราบเป็นวงกว้างแล้ว

โดยใช้เทคโนโลยี Deepfake ซึ่งช่วยให้สามารถจำลองเสียงและภาพของบุคคลได้ด้วยความแม่นยำสูง ผู้กระทำความผิดสามารถปลอมตัวเป็นผู้นำในการประชุมออนไลน์ หรือสร้างวิดีโอและการโทรเพื่อกระทำการฉ้อโกงทางการเงินได้

ยิ่งไปกว่านั้น การหลอกลวงเหล่านี้มักจะใช้ประโยชน์จากปัจจัยทางจิตวิทยา เช่น ความเร่งด่วน ความกลัว หรืออำนาจ ทำให้เหยื่อดำเนินการอย่างเร่งรีบโดยไม่ตรวจสอบความถูกต้องอย่างรอบคอบ

Deepfakes ไม่เพียงแต่เป็นการหลอกลวงด้านการลงทุนทางการเงินเท่านั้น ตัวอย่างอีกประการหนึ่งคือกลลวงทางความรัก ซึ่งมีการใช้ Deepfakes เพื่อสร้างตัวละครในจินตนาการที่โต้ตอบกับเหยื่อผ่านทางวิดีโอคอล หลังจากได้รับความไว้วางใจจากเหยื่อแล้ว ผู้หลอกลวงจะขอโอนเงินเพื่อใช้ในยามฉุกเฉิน ค่าเดินทาง หรือการกู้ยืมเงิน

จากสถานการณ์ดังกล่าว กรมการรักษาความปลอดภัยข้อมูลจึงแนะนำให้ประชาชนระมัดระวังคำแนะนำด้านการลงทุนจากผู้มีชื่อเสียงในโซเชียลเน็ตเวิร์ก ระวังข้อความ อีเมล์ หรือการโทรที่ไม่รู้จัก ชมการแสดงสีหน้าไม่เป็นธรรมชาติในวิดีโออย่างใกล้ชิด

นอกจากนี้ ผู้คนยังต้องจำกัดการโพสต์เนื้อหาที่เกี่ยวข้องกับข้อมูลส่วนตัวบนเครือข่ายสังคมออนไลน์ เพื่อหลีกเลี่ยงกรณีที่ผู้ร้ายขโมยข้อมูล เช่น รูปภาพ วิดีโอ หรือเสียง นอกจากนี้ ตั้งค่าบัญชีของคุณเป็นส่วนตัวเพื่อปกป้องข้อมูลส่วนบุคคลของคุณ

ในการให้สัมภาษณ์กับหนังสือพิมพ์ Dai Doan Ket ผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์ Ngo Minh Hieu ผู้ก่อตั้งร่วมของโครงการป้องกันการฉ้อโกงทางไซเบอร์ของเวียดนาม (Chongluadao.vn) กล่าวว่า การใช้เทคโนโลยี Deepfake (การจำลองแบบลึก) ใน AI เพื่อสร้างวิดีโอคอลปลอมเพื่อจุดประสงค์ในการฉ้อโกง ยังคงมีความซับซ้อน ผู้ถูกทดลองใช้ประโยชน์จากเทคโนโลยีนี้เพื่อเพิ่มความน่าเชื่อถือให้กับ “เหยื่อ” ของตน

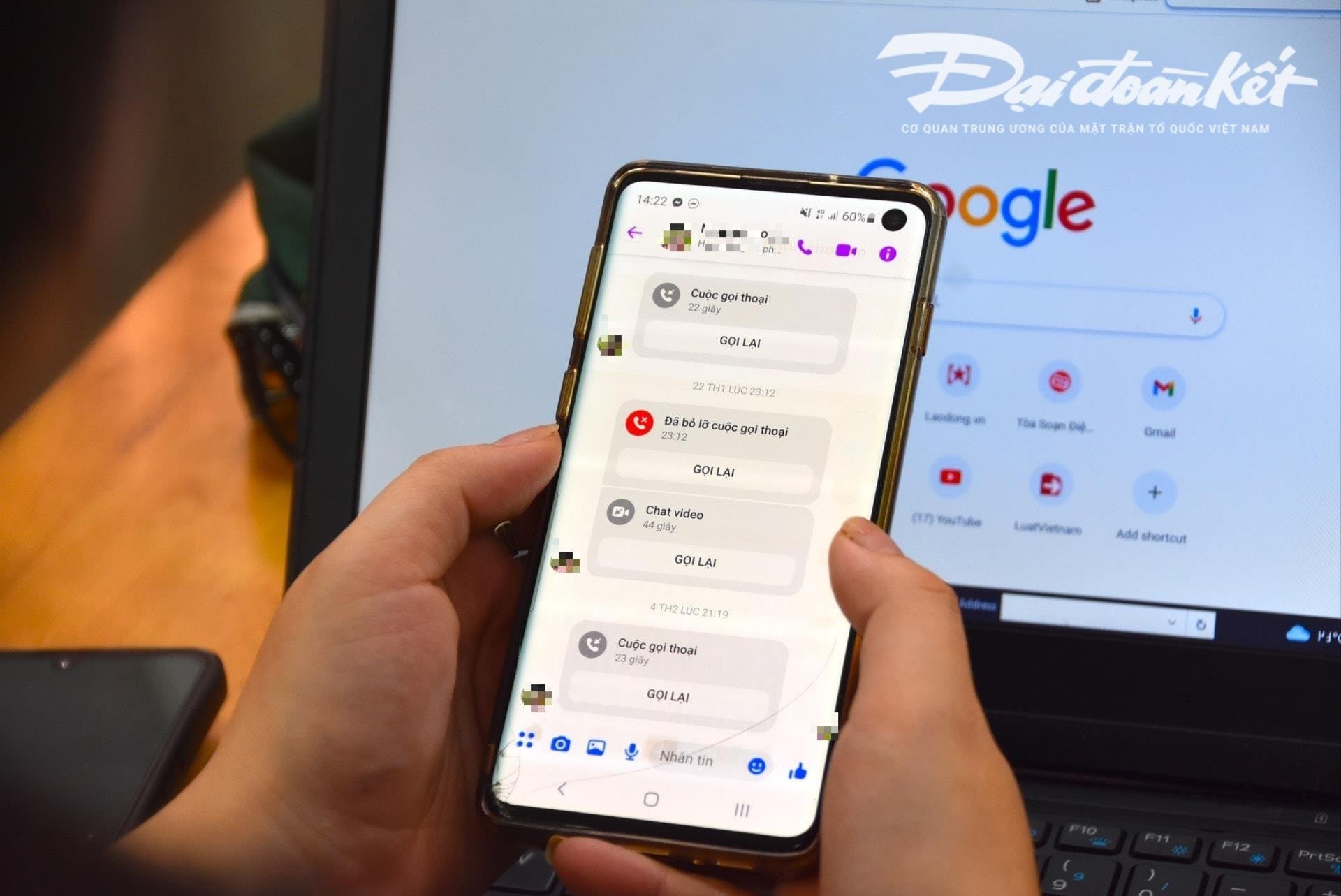

โดยเฉพาะอย่างยิ่ง ผู้เสียหายจะทำการโทรวิดีโอหาเหยื่อจากภาพและวิดีโอที่ "ขโมย" มาก่อน จากนั้นทำการประมวลผลทางเทคนิค บิดเบือนเสียง หรือแก้ไขปัญหาภาพปลอม เพื่อสร้างความไว้วางใจให้กับเหยื่อ

โดยทั่วไปการโทรเหล่านี้มักสั้นมาก กินเวลาเพียงไม่กี่วินาที จากนั้นผู้หลอกลวงจึงอ้างข้ออ้างว่าเครือข่ายไม่เสถียร อยู่บนถนน ฯลฯ เพื่อขอให้เหยื่อทำตามคำขอของผู้หลอกลวง

ผู้เชี่ยวชาญเตือนว่าการใช้ AI เพื่อการฉ้อโกงทางไซเบอร์อาจเพิ่มขึ้นอย่างมากในอนาคตอันใกล้นี้ ดังนั้นประชาชนจะต้องเพิ่มความระมัดระวังในตนเองมากขึ้น โดยเฉพาะการได้รับข้อความแปลกๆ วิดีโอคอล หรือลิงค์ต่างๆ

ตามการวิเคราะห์ของผู้เชี่ยวชาญ อัลกอริทึมปัญญาประดิษฐ์ (AI) Deepfake ในปัจจุบันจะไม่สามารถจัดการได้หากผู้โทรเลี้ยวซ้าย เลี้ยวขวา หรือยืนขึ้น...

จุดอ่อนอย่างหนึ่งที่ผู้คนต้องระวังเมื่อรับสายคือฟันของพวกเขา ด้วยเหตุนี้ อัลกอริธึม AI ในปัจจุบันจึงไม่สามารถสร้างฟันของบุคคลที่ถูกปลอมแปลงได้

หากใช้ Deepfake รูปภาพปากที่เปิดอยู่ของบุคคลนั้นอาจไม่มีฟัน บางคนอาจมีขากรรไกร 3 ขากรรไกรหรือถึง 4 ขากรรไกรก็ได้ ดังนั้นฟีเจอร์ฟันจึงเป็นองค์ประกอบที่สามารถจดจำการโทรปลอมได้มากที่สุดโดยใช้ Deepfake

“การชะลอความเร็ว” และไม่ปฏิบัติตามคำขอทันทีถือเป็นข้อกำหนดเบื้องต้นเพื่อหลีกเลี่ยงการตกหลุมพรางการหลอกลวง เมื่อได้รับข้อความหรือโทรศัพท์ผ่านโซเชียลเน็ตเวิร์ก ผู้คนจำเป็นต้องโทรหาญาติๆ ของตนโดยตรง เพื่อตรวจสอบว่าใครเป็นผู้ติดต่อกับพวกเขาภายในเวลาขั้นต่ำ 30 วินาที หรือพบปะกันเป็นการส่วนตัว

ในกรณีที่สงสัยว่ามีการแอบอ้างเป็นญาติในโซเชียลเน็ตเวิร์กเพื่อฉ้อโกงหรือยักยอกทรัพย์สิน จำเป็นต้องรายงานไปยังหน่วยงานตำรวจที่ใกล้ที่สุดทันที เพื่อการสนับสนุนและการจัดการอย่างทันท่วงที

ที่มา: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

![[ภาพ] ก้าวข้ามทุกอุปสรรค เร่งสร้างโครงการขยายโรงไฟฟ้าพลังน้ำฮว่าบิ่ญให้คืบหน้า](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/bff04b551e98484c84d74c8faa3526e0)

![[ภาพ] การปิดการประชุมครั้งที่ 11 ของคณะกรรมการกลางพรรคคอมมิวนิสต์เวียดนามครั้งที่ 13](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/114b57fe6e9b4814a5ddfacf6dfe5b7f)

การแสดงความคิดเห็น (0)