OpenAIはChatGPT-4がどのようにトレーニングされたかについてはあまり明らかにしていない。ただし、通常、大規模言語モデル (LLM) は、英語が共通語であるインターネットから取得したテキストでトレーニングされます。 ChatGPT-3 のトレーニング データの約 93% は英語です。

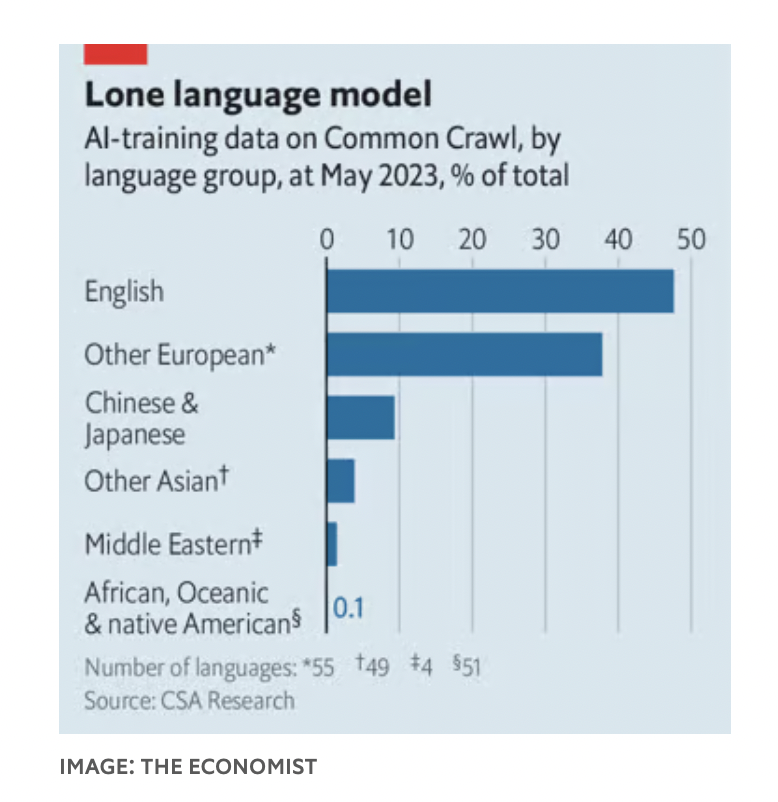

AI モデルのトレーニングに使用されているデータセットの 1 つである Common Crawl では、英語がコーパスの 47% を占め、他のヨーロッパ言語がさらに 38% を占めています。対照的に、中国人と日本人を合わせた割合はわずか9%です。

ジョンズ・ホプキンス大学の研究者ナサニエル・ロビンソン氏とその同僚による調査では、この問題は ChatGPT だけに限定されないことが判明しました。すべての LLM は、トレーニング データが不足している「低リソース」言語よりも、トレーニング データが豊富な「高リソース」言語でのパフォーマンスが向上します。

これは、教育から医療に至るまでの分野を改善するために貧困国に AI を導入したいと考えている人々にとって問題です。そのため、世界中の研究者がAIの多言語化に取り組んでいます。

インド政府は昨年9月、農家が国からの有用な最新情報を入手できるチャットボットを導入した。

チャットボットの構築を支援した非営利団体EkStep Foundationのシャンカール・マルワダ氏は、このボットは2種類の言語モデルを組み合わせて機能し、ユーザーは母国語でクエリを送信できると述べた。これらの母国語によるクエリは、インドの研究施設の機械翻訳ソフトウェアに渡され、英語に翻訳されてから LLM に転送され、応答が処理されます。最後に、応答はユーザーの母国語に翻訳されます。

このプロセスは機能するかもしれませんが、クエリを LLM の「推奨」言語に翻訳するのは不器用な回避策です。言語は文化や世界観を反映する手段です。シドニー大学の研究者レベッカ・ジョンソン氏が2022年に発表した論文によると、ChatGPT-3は銃規制や難民政策などのトピックについて、世界価値観調査で表現されたアメリカの価値観に匹敵する回答を生成したという。

そのため、多くの研究者は、あまり使用されていない言語でも LLM を習得できるように努めています。技術的には、言語のトークン化を変更するというアプローチがあります。 Sarvam AI というインドのスタートアップ企業は、ヒンディー語に最適化されたトークナイザー、またはデーバナーガリー語 (インド) に最適化された OpenHathi - LLM モデルを作成し、質問への回答コストを大幅に削減できます。

もう 1 つの方法は、LLM をトレーニングするデータセットを改善することです。 11月、アブダビのモハメド・ビン・ザイド大学の研究チームは、「Jais」と呼ばれるアラビア語を話すモデルの最新バージョンをリリースした。 ChatGPT-3 の 1/6 のパラメータ数ですが、アラビア語では同等のパフォーマンスを発揮します。

モハメド・ビン・ザイド大学のティモシー・ボールドウィン学長は、チームが大量のアラビア語のテキストをデジタル化したにもかかわらず、モデルには依然として英語のテキストも含まれていると指摘した。いくつかの概念はすべての言語で同じであり、どの言語でも学習できます。

3 番目のアプローチは、モデルをトレーニングした後に調整することです。 Jais と OpenHathi には、人間が生成した質問と回答のペアが多数あります。誤情報の防止については、西洋のチャットボットでも同様です。

中国の大手テクノロジー企業、百度の法学修士アーニー・ボット氏は、政府を怒らせる可能性のある発言を制限する規制を受けている。モデルは、ユーザーが LLM の回答を評価するという人間のフィードバックから学習することもできます。しかし、機械の反応を批評できる資格を持った人材を雇う必要があるため、発展途上地域の多くの言語ではそれを実行するのは困難です。

(エコノミスト誌によると)

[広告2]

ソース

コメント (0)