SGGPO

カスペルスキーは、責任を持って透明性のある技術開発への取り組みを強化するために、企業システムの開発と使用において人工知能 (AI) または機械学習 (ML) を適用するための倫理原則を提示しています。

|

| Kaspersky は、AI のサブセットである ML アルゴリズムをエンタープライズ ソリューションに 20 年近く使用してきました。 |

AI アルゴリズムがサイバーセキュリティにおいてますます重要になるにつれ、カスペルスキーのホワイトペーパーの原則では、企業が AI テクノロジーの信頼性を確保する方法と、業界の企業が AI/ML アルゴリズムの使用に関連するリスクを軽減するための指針が説明されています。

人工知能と人間の専門知識を組み合わせることで、カスペルスキーのソリューションは幅広いサイバー脅威を効果的に検出し、対抗することができます。その中で、MLは脅威の自動検出や異常の特定、マルウェア検出の精度向上に重要な役割を果たしています。

イノベーションを促進するために、カスペルスキーは AI/ML の開発と使用に関する倫理原則を策定しました。これらの原則は、AI が賢明に利用されてより良い世界が実現されるようにするための多国間外交ツールとして、業界にも公開されています。

透明性の原則は、企業は製品やサービスで使用される AI/ML テクノロジーについて顧客に通知する必要があるというカスペルスキーの強い信念を反映しています。カスペルスキーは、できるだけ使いやすい AI/ML システムを開発し、ソリューションの仕組みやカスペルスキーが AI/MI テクノロジーを活用する方法について関係者と情報を共有することで、この原則を遵守しています。

カスペルスキーによれば、AI/ML の開発と使用を促進するには、透明性、安全性という 6 つの原則を考慮する必要があります。人間による制御;プライバシー;サイバーセキュリティ目的での使用へのコミットメント。オープンな対話…

[広告2]

ソース

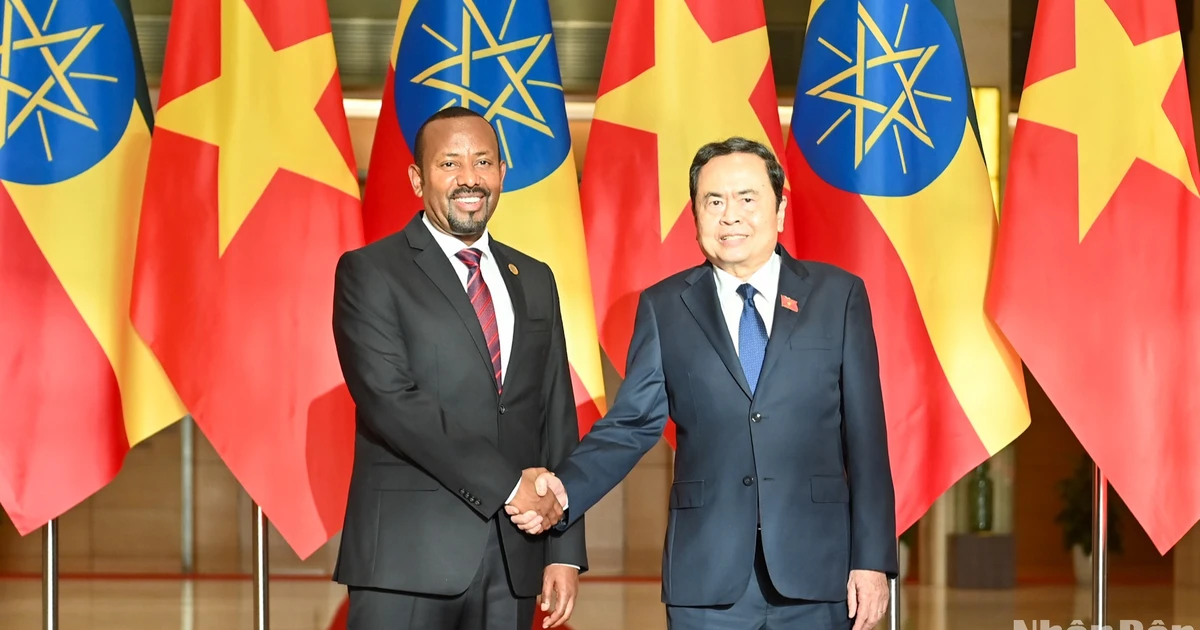

![[写真] ルオン・クオン大統領がエチオピアのアビィ・アハメド・アリ首相を歓迎](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/16/504685cac833417284c88a786739119c)

![[動画] Viettelがベトナム最大の海底光ケーブルラインを正式に運用開始](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/f19008c6010c4a538cc422cb791ca0a1)

![[写真] ルオン・クオン大統領が「親切の行為」プログラムの典型的な例100例と面会](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/16/ce8300edfa7e4afbb3d6da8f2172d580)

コメント (0)