アルファベット(グーグルの親会社)の株式1億3500万ドルを保有する株主であるトリリアム・アセット・マネジメントは、2023年の年次総会でAI(人工知能)とアルゴリズムの透明性の問題を提起した。同基金の代表者は、アルゴリズムは司法や医療などの一部の分野では危険な結果をもたらす可能性があり、「この技術が社会にとって安全かどうかを知るためには」説明責任と透明性が必要だと述べたとトリリウムは主張した。

同ファンドがアルファベットに透明性を求めるのは今回が初めてではない。 2023年初頭にOpenAIのChatGPT人工知能が爆発的に普及する前に、Trilliumも同様の要請を行った。しかし、Google はどちらの場合も上記の要求に応じることを拒否しました。

Googleは悪意のある人物から身を守るためにアルゴリズムとAIに関する秘密を隠している

「検索大手」によると、アルゴリズムに関する情報はウェブサイト上で公開されており、YouTubeがユーザーにおすすめコンテンツをどのように並べているかについての透明性も確保されているという。しかし、同社の事業の基盤となっている独自のアルゴリズムは公開できない。

「アルゴリズムの透明性は、悪意のある人物による情報の悪用、ユーザーのプライバシーへの影響、機密の商業情報の漏洩といったリスクも考慮する必要がある」とグーグルは説明した。

グーグルのサンダー・ピチャイCEOは、AIは医療を含む生活のあらゆる分野に影響を与えるだろうと述べ、同社がこの技術をより有用なものにするために「責任を持って」人工知能に取り組んでいると断言した。

同社の声明とトリリウム基金からの要請は、急速なAI開発とユーザーおよびテクノロジー業界の懸念を背景に行われた。昨年5月、AIエンジニアの先駆者であるジェフリー・ヒントン氏がGoogleを去り、AIベースのチャットボットの危険性について警告した。

[広告2]

ソースリンク

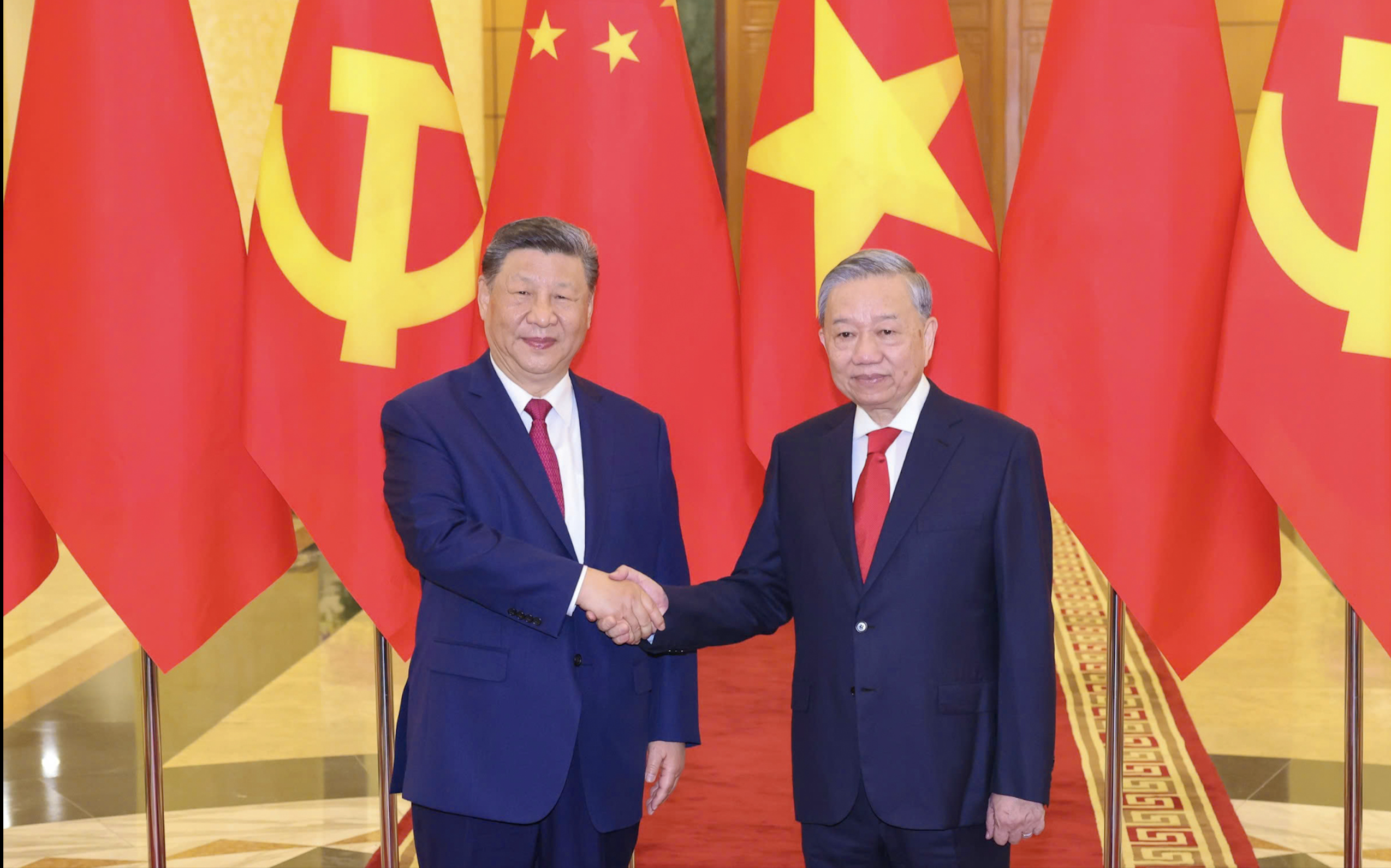

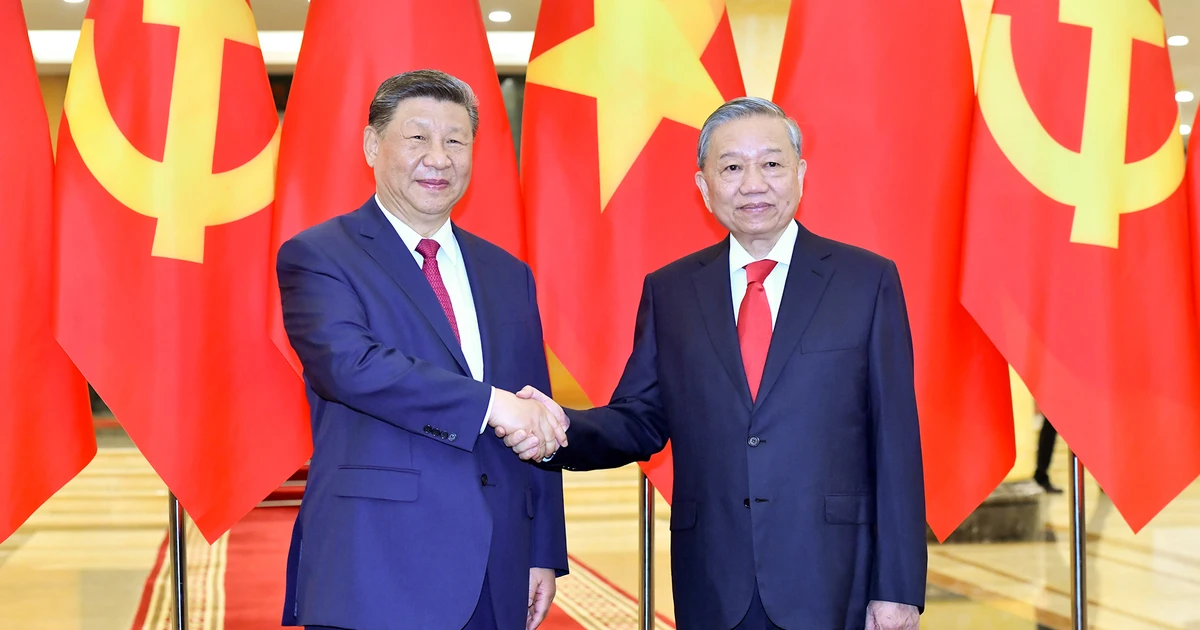

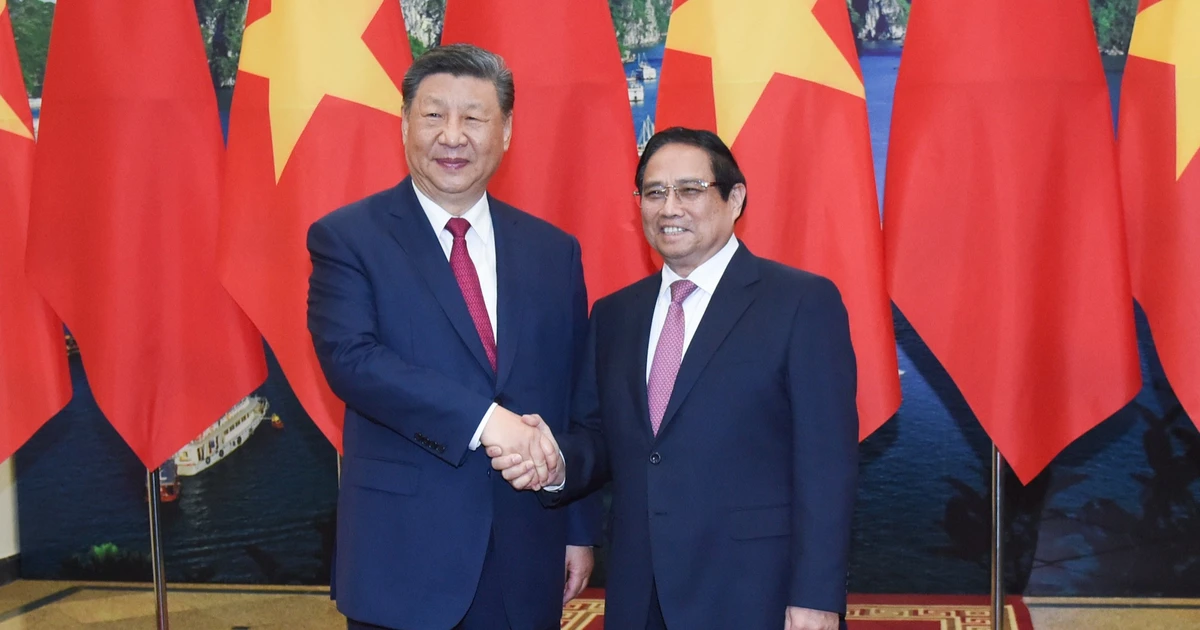

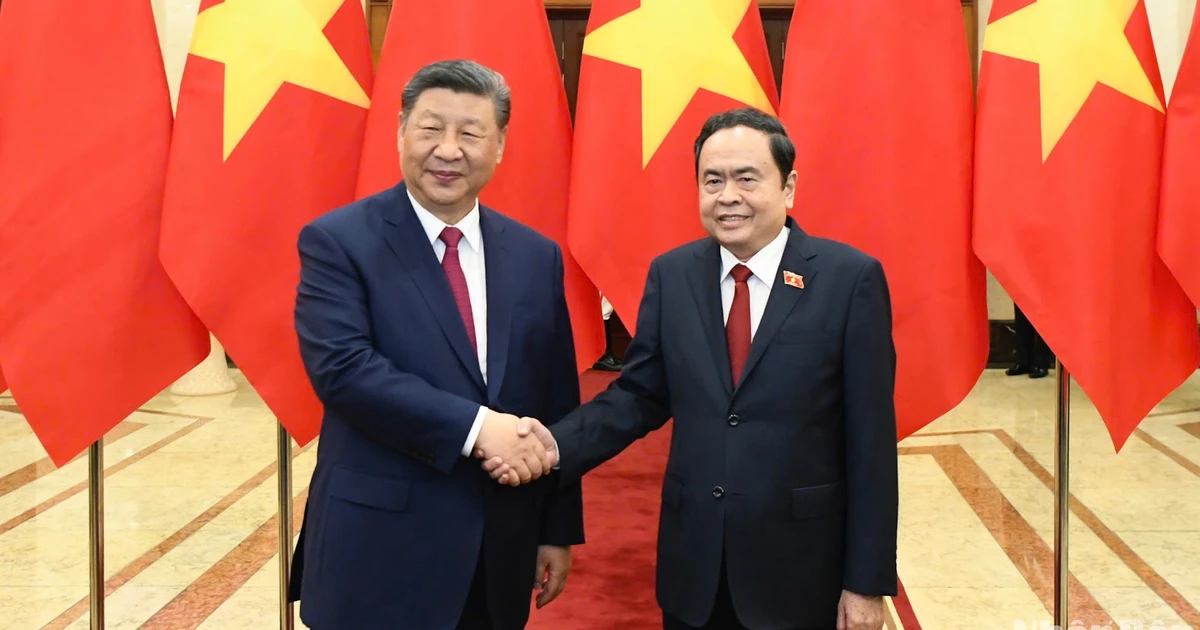

![[写真] 習近平中国総書記兼国家主席歓迎レセプション](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/14/9afa04a20e6441ca971f6f6b0c904ec2)

コメント (0)