2024年5月、OpenAIのGPT-4o、GoogleのGemini 1.5 Proなど、世界的に有名なテクノロジー大手が次々と人工知能(AI)の新バージョンを発表し、ユーザーエクスペリエンスを最適化するための多くの「超スマート」機能が追加されました。しかし、この技術が多くのオンライン詐欺のシナリオでサイバー犯罪者によって使用されていることは否定できません。

リスクの増大

情報通信省のファム・ドゥック・ロン副大臣は最近の会議で、サイバー攻撃はますます巧妙化、複雑化し、継続的に増加しているという事実を指摘した。特に AI のサポートがある場合、ユーザーが直面するリスクは飛躍的に増加します。 「AI技術はサイバー犯罪者によって、新たなマルウェアや、新しく洗練されたフィッシング攻撃を簡単に作成するために使用されている」とファム・ドゥック・ロン副大臣は警告した。

ベトナム情報通信省情報セキュリティ局の報告書によると、AIに関連するサイバーセキュリティリスクは世界中で1兆米ドル以上の損害を引き起こしており、そのうちベトナムだけで8兆~10兆ベトナムドンに上ります。現在最も一般的な用途は、詐欺目的で声や顔を偽造するために AI を使用することです。 2025 年までには、1 秒あたり約 3,000 件の攻撃、1 秒あたり 12 件のマルウェア、1 日あたり 70 件の新しい脆弱性と弱点が発生すると予測されています。

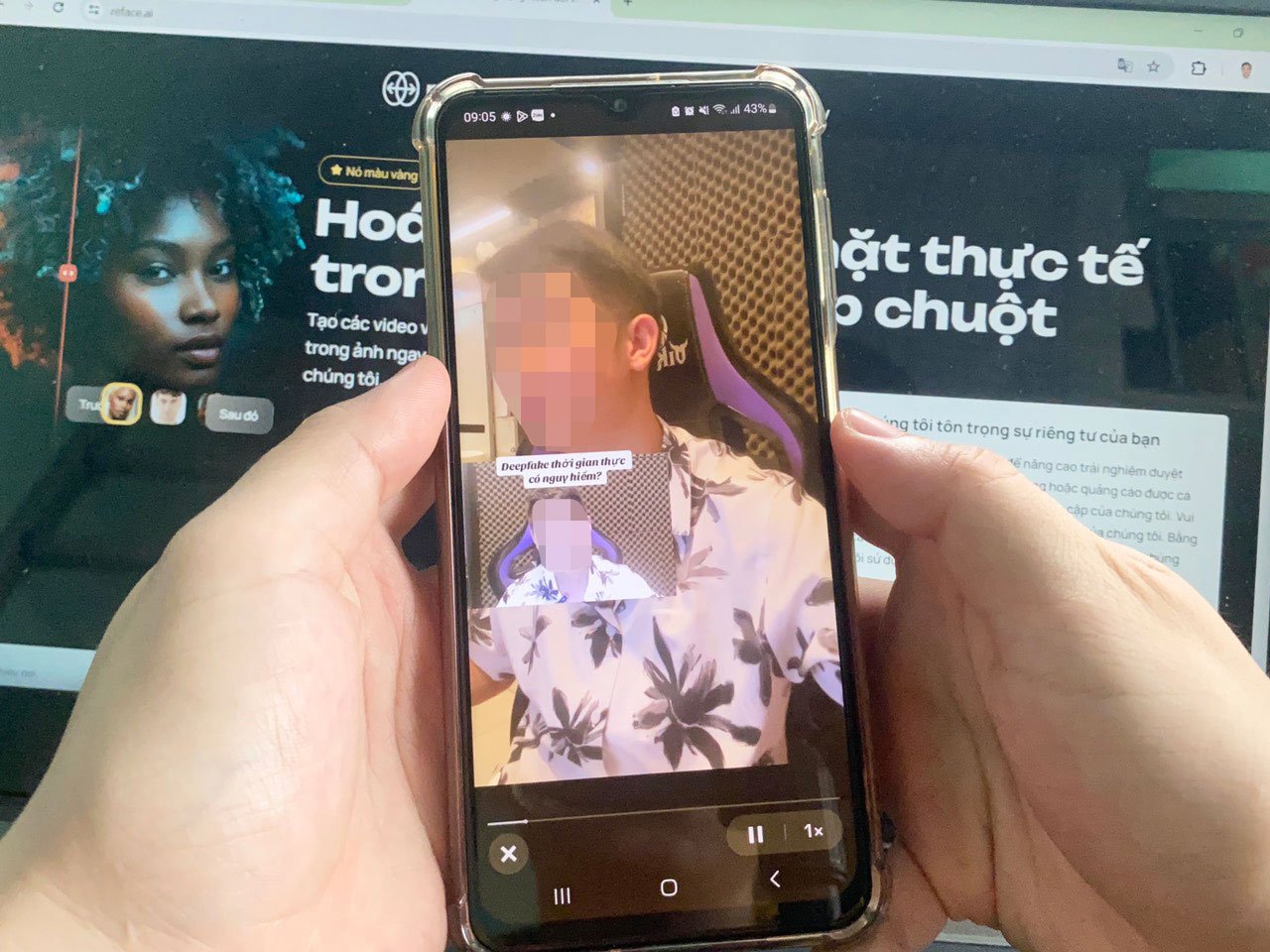

アプリケーションのセキュリティサポートを専門とするBShieldのディレクター、Nguyen Huu Giap氏によると、AIの進歩により偽の画像や音声を作成することは難しくないとのこと。詐欺師は、ソーシャル ネットワークに投稿した公開情報から、またはオンラインでの就職面接や「当局」の名前を使った電話などのトリックを通じて、ユーザー データを簡単に収集できます。 BShield が実施したシミュレーションでは、詐欺師はビデオ通話で入手した顔を CCCD 用紙に載せ、動いている人の体に合成して eKYC ツールを騙し、システムに本物の人物として認識させることができるという。

ディープフェイク技術を使った詐欺の手口は増加しており、より巧妙化しています。写真:LE TINH

ユーザーの視点から見ると、ホーチミン市のITスペシャリストであるNguyen Thanh Trung氏は、悪意のある人物がchatGPTを利用して、銀行や評判の良い組織からの実際のメールに似た内容と文体の詐欺メールを作成する可能性があることを懸念しています。これらのメールにはマルウェアが添付されている可能性があり、ユーザーがクリックすると、確実にデータが盗まれ、資産が奪われます。 「AIソフトウェアはますます改良され、本物の人物と95%類似した顔と声を持つ偽の動画を作成できるようになり、ジェスチャーはリアルタイムで変化するため、視聴者が見分けるのは非常に困難になっている」とチュン氏は述べた。

まもなく法的な回廊が完成

セキュリティ専門家のファム・ディン・タン氏は、ハイテク詐欺のリスクを抑えるには、ユーザーはAIに関する知識を定期的に更新し、出所不明のリンクをクリックしないようにする必要があると指摘した。企業では、データのセキュリティとシステム運用を確保するために予算を割り当てる必要があります。企業のスタッフは、システムで発生する実際の脆弱性にアクセスし、サイバー攻撃の種類を識別する能力を高めるために、徹底的なトレーニングを受ける必要もあります。

AI開発部門不正対策プロジェクトの責任者であるタ・コン・ソン氏は、AIは極めてインテリジェントなサポート機能により、ユーザーの生活や企業、機関、部門の業務に深く浸透していると語った。特に、AI テクノロジーは現在非常にアクセスしやすく、簡単に使用できるため、悪意のある人物がそれを簡単に不正目的で利用できる状況が生まれます。 「詐欺師も攻撃方法を常に変えているので、ユーザーはそれを防ぐ方法を知るために定期的に情報を更新する必要がある」と孫氏は勧めた。

専門家によると、最近アップグレードされた GPT-4o および Gemini 1.5 Pro モデルは、AI の知能に限界がないことを証明しました。したがって、企業に AI 不正防止ツールやソリューションの開発を奨励することに加えて、管理機関はトレンドを先取りするために AI に関する法的枠組みを早急に完成させる必要があります。

国家人口データセンター副所長のグエン・アン・トゥアン中佐は、AIの開発、生産、応用、使用の過程における国内外のサービス提供者の倫理と責任を規制する文書を早急に発行する必要があると述べた。同時に、AI サービスを活用、適用、接続、提供するシステムに関する技術基準についても具体的な規制が必要です。 「AIリスクに対抗するためには、AIプロジェクトの研究と適用が必要です。AIは人間によって作られ、知識の産物であるため、『良いAI』と『悪いAI』のバリエーションがあり、AI自体によってAIの発展を阻止することが可能です」とトゥアン大佐は指摘しました。

サイバーセキュリティの課題

グエン・アン・トゥアン中佐は、AIがサイバーセキュリティに課題をもたらしていることを認めた。したがって、AI 対応のマルウェアがドキュメント ファイルにインストールされる可能性があります。ユーザーがドキュメントファイルをアップロードすると、このマルウェアがシステムに侵入します。さらに、特殊な AI テクノロジーにより、ハッカーはシステムをシミュレートし、セキュリティ ホールを攻撃することができます。 AIは、公安部のアプリケーションやウェブサイトの偽の画像や名前を使用して、人々がダウンロードしてインストールし、IDカード番号やログインパスワードなどの情報を提供する多くのアプリケーションを作成できます。 「AIは、より洗練されたセキュリティ回避メカニズムと柔軟なソースコード変更を備えた独自のソフトウェアとハイブリッドマルウェアも開発するだろう」とグエン・アン・トゥアン中佐は警告した。

[広告2]

出典: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[写真] クチトンネル訪問 - 英雄的な地下の偉業](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/8/06cb489403514b878768dd7262daba0b)

コメント (0)