情報セキュリティ局は最近、ハイテクビデオおよび画像詐欺が継続的に発生していることについて警告を発した。

そのため、サイバー犯罪者が人々の公開画像や動画を悪用して編集、カットしたり、偽の動画で脅迫したりする状況について、当局は広く国民に警告を発している。

人物の音声と画像を高精度に再現できるディープフェイク技術を使用することで、犯罪者はオンライン会議でリーダーになりすましたり、ビデオや通話を作成して金融詐欺を実行したりすることができます。

さらに、こうした詐欺は緊急性、恐怖、権力といった心理的要因を悪用することが多く、被害者は真偽を慎重に確認せずに性急に行動してしまいます。

ディープフェイクは金融投資詐欺だけに限りません。もう 1 つの例はロマンス詐欺です。ロマンス詐欺では、ディープフェイクを使用して、ビデオ通話で被害者と対話する架空のキャラクターが作成されます。詐欺師は被害者の信頼を得た後、緊急事態、旅費、またはローンを賄うために送金を要求します。

上記の状況を踏まえ、情報セキュリティ局は、ソーシャル ネットワーク上の著名人による投資アドバイスには注意するよう推奨しています。知らないテキスト、電子メール、または電話には注意してください。動画内の不自然な表情に注意してください。

また、悪意のある人物が画像や動画、音声などの情報を盗む事態を避けるために、ソーシャル ネットワーク上で個人情報に関連するコンテンツを投稿することを制限する必要があります。また、個人情報を保護するためにアカウントを非公開に設定してください。

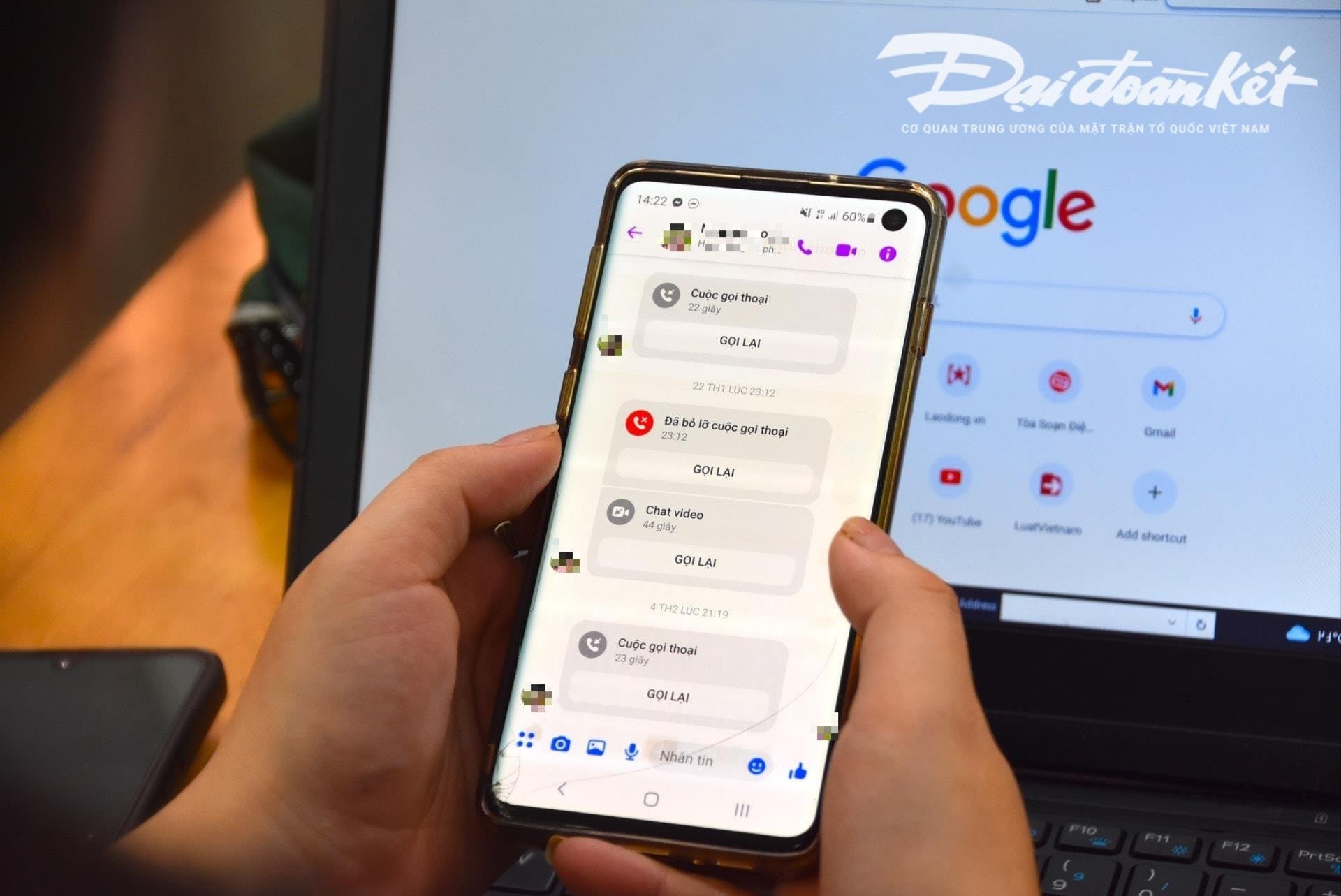

ベトナムサイバー詐欺防止プロジェクト(Chongluadao.vn)の共同設立者でサイバーセキュリティ専門家のゴ・ミン・ヒュー氏は、ダイ・ドアン・ケット紙のインタビューで、詐欺目的でビデオ通話を偽造するためにAIのディープフェイク技術(ディープシミュレーション)を使用することは依然として複雑であると語った。被験者はこの技術を利用して「獲物」の信頼性を高めます。

具体的には、被験者は、以前に「盗まれた」画像や動画から被害者に積極的にビデオ通話をかけ、技術的に加工したり、音声を歪めたり、画像を偽造したりして、被害者の信頼を得ようとします。

通常、これらの通話は非常に短く、数秒しか続きません。その後、詐欺師は不安定なネットワークや路上にいるなどの言い訳を使って、被害者に詐欺師の要求に応じるように求めます。

専門家は、近い将来、サイバー詐欺における AI の利用が大幅に増加する可能性があると警告しています。したがって、人々は積極的に警戒心を高めなければなりません。特に、奇妙なメッセージ、ビデオ通話、リンクを受信したとき。

この専門家の分析によると、リアルタイム通話中の現在のディープフェイク人工知能(AI)アルゴリズムは、発信者が左を向いたり、右を向いたり、立ち上がったりした場合には対応できないとのことだ...

こうした電話を受けるときに特に注意しなければならない弱点は、歯です。したがって、現在の AI アルゴリズムでは、なりすましの対象となる人物の歯を再現することはできません。

ディープフェイクを使用すると、人物の開いた口の画像には歯がなかったり、顎が 3 つ、あるいは 4 つあるように見える場合もあります。したがって、歯の特徴は、ディープフェイクを使用した偽の通話で最も認識しやすい要素です。

「スピードを落として」要求にすぐに応じないことは、詐欺の罠に陥らないための前提条件です。ソーシャル ネットワーク経由でメッセージや電話を受けた場合、最短 30 秒以内に親戚に直接電話して、誰が連絡してきたのかを確認するか、直接会う必要があります。

ソーシャル ネットワーク上で親族を装い、詐欺や財産の横領を行っている疑いがある場合は、速やかに最寄りの警察機関に通報し、迅速なサポートと対応を受ける必要があります。

[広告2]

出典: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

コメント (0)