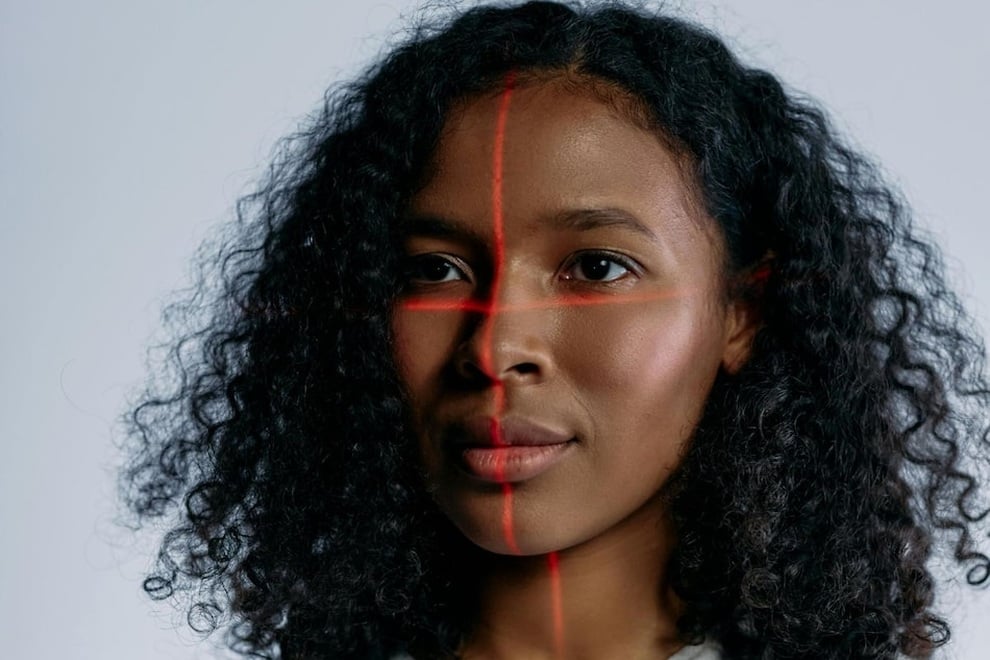

(Dan Tri) - Chameleon AI モデルは、顔認識ツールから画像を保護するためにデジタル マスクを追加できます。

研究者チームは、個人情報やデジタルアカウントにアクセスするためにハッカーや詐欺師が顔スキャンを行うことからユーザーを保護できる人工知能(AI)システムを開発した。

このツールはカメレオンと呼ばれます。

カメレオンは、隠しマスクを作成してユーザーの顔を「隠す」ことで機能します。この人工知能モデルはデータに最適化されており、低性能のテクノロジーデバイスでも使用できます。

この AI モデルは、ジョージア工科大学 (米国ジョージア工科大学) の研究者によって arXiv 誌に発表されました。

これにより、ユーザーはハッカーや AI データ収集ボットによる顔データスキャンの試みから自分の身元を保護することができます。

「カメレオンのようなプライバシー保護データと分析を共有することで、AI技術の責任あるガバナンスと採用を促進し、責任あるイノベーションで科学分野に勢いを生み出すことができます」とジョージア工科大学コンピュータサイエンス学部のインテリジェントコンピューティングデータ学科のリン・リウ教授は述べています。

マスク モデルが適用されると、スキャンによって「別の人物」として表示されるため、顔認識ツールは画像を検出できなくなります。

実は、同様の AI ツールはすでに存在していますが、Chameleon にはデータの最適化や画像セキュリティ品質の向上など、多くの改良が施されています。

研究者らは、このツールは写真ごとに別々のマスクを使用するのではなく、ユーザーが更新した数枚の顔写真に基づいて各ユーザーのマスクを生成すると指摘している。

このツールの課題の 1 つは画像の品質を維持することであるため、研究者はダーク テクニックを使用して Chameleon からの「知覚」を最適化しました。

手動による介入やパラメータ設定なしでマスクを自動的にレンダリングするため、AI が全体的な画像品質を損なうことはありません。

これはプライバシー重視の AI ツールであり、研究者らは Chameleon コードを GitHub で近々公開する予定であることを明らかにしました。このオープン ソースは開発者がアプリケーションに統合するために使用されます。

[広告2]

出典: https://dantri.com.vn/suc-manh-so/nguoi-dung-tranh-duoc-lua-dao-tu-nhan-dang-khuon-mat-nho-cong-cu-ai-moi-20241203130212300.htm

コメント (0)