SGPO

AI チャットボットには多くの大きなメリットがありますが、ユーザーがこれらのツールが子供に及ぼす潜在的なリスクを認識していない場合、個人データの紛失、生命の脅威、不適切なコンテンツなどの大きなリスクに直面することになります。

|

| 親は子どもがインターネットを安全に利用できるように指導する必要がある |

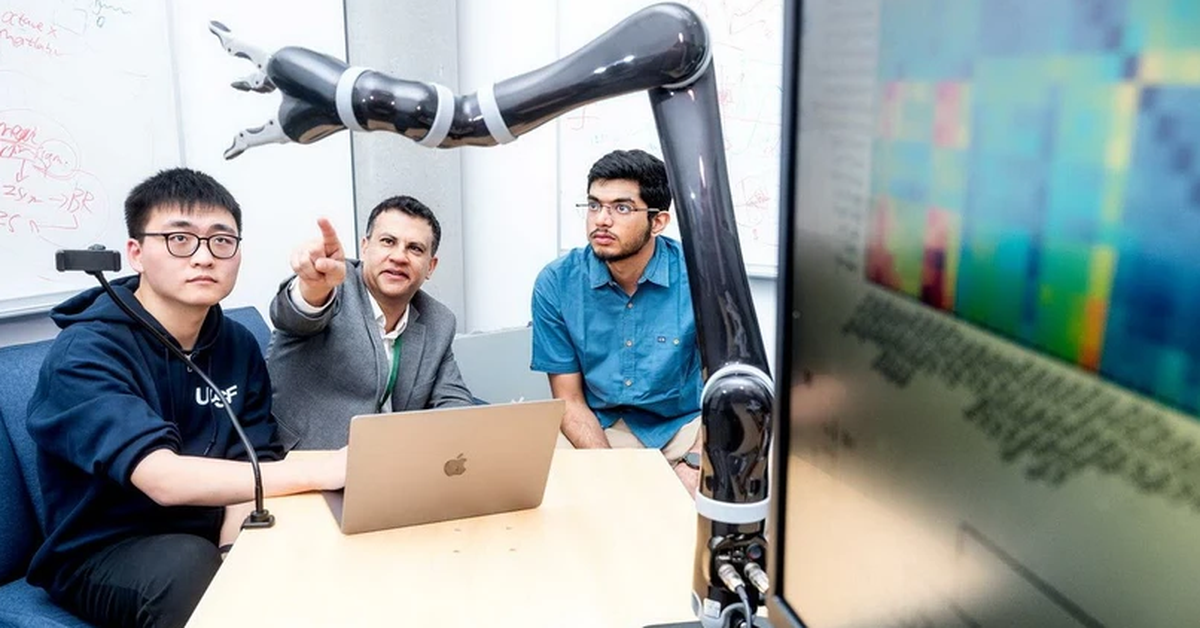

AI ツールの助けにより、学習はこれまで以上に効率的になりました。 AI チャットボットを使用すると、ユーザーはたった一文で世界中のあらゆるトピックに関する有用な情報を見つけることができます。

このような状況では、世界中のあらゆる年齢の子供たちが AI ツールにアクセスできるようになっていますが、これらのツールは使用前に同意を得る必要がほとんどないか、まったくありません。

AI チャットボットにより、何十ものタブを開いたり、無数の記事を読んだりすることなく、情報を簡単にナビゲートできるようになりました。これは、好奇心旺盛な子供たちにとって特に重要であり、AI は子供たちが学習に積極的に参加できるように支援できます。

さらに、AIは子供たちが言語スキルを磨き、時間制限なしに自由に議論できるプラットフォームを提供しますが、これにはリスクも伴います。

カスペルスキーのウェブコンテンツアナリスト、Noura Afaneh氏は、オンラインコンテンツについて、AIチャットボットの使用時に特定のリスクがあることを指摘しました。その中でも、ChatGPTはユーザー数の増加率が最も高い記録を打ち立てていますが、ユーザーの年齢確認を行っていないため、子供のデータプライバシーにとって脅威となっています。

さらに、ChatGPT によって提供されるコンテンツが完全に正確ではない場合があり、ユーザーが誤った情報を受け取ることになりかねません。これには偽の参考文献や存在しない記事が含まれており、ChatGPT が一部の学生にとって盗作ツールになる一因にもなっています。

さらに、スナップチャットの「My AI」チャットボットも、13歳のユーザーでもペアレンタルコントロールなしで使用できるため、子供たちに多く使用されているチャットボットであり、子供のプライバシーとアプリによる子供のデータの保持について疑問が生じていると、Noura Afaneh氏は例を挙げた。

リスクの1つは、子供たちがAIを本当の友達と勘違いし、そのアドバイスに従って行動することだ。そのアドバイスには「偏った、不正確な、有害な、または誤解を招く内容が含まれる可能性がある」。

親として、この AI チャットボットの使用を禁止することが必ずしも子供を保護する最善の方法ではないことを理解することが重要です。子供は常にオンラインで新しいコンテンツにさらされる可能性があるため、親は上記のリスクのバランスを取り、リスクを軽減するために積極的な役割を果たす必要があります。

AI チャットボットによるリスクを最小限に抑えるための保護者向けのヒント:

• 子どもたちにインターネットの安全性について教える: 子どもたちにオンラインの安全性とプライバシーに関する知識を与えることは、チャットボットであっても、見知らぬ人と個人情報を共有することを防ぐ効果的な方法です。

• お子様と一緒に AI チャットボットを体験してください: カスペルスキーは、保護者がお子様に AI チャットボットの使用方法を指導し、AI チャットボットにどのような質問をすべきか、どのような質問をすべきでないかについて認識を高めることを推奨しています。

• プライバシー設定の監視、制御、設定: 保護者にとって最も強力なオンライン保護ツールの 1 つは、包括的なセキュリティ ソリューションです。さらに、テクノロジー時代の子育てアプリは、オンラインで子供たちを保護するために非常に必要なリソースを提供します。

[広告2]

ソース

コメント (0)