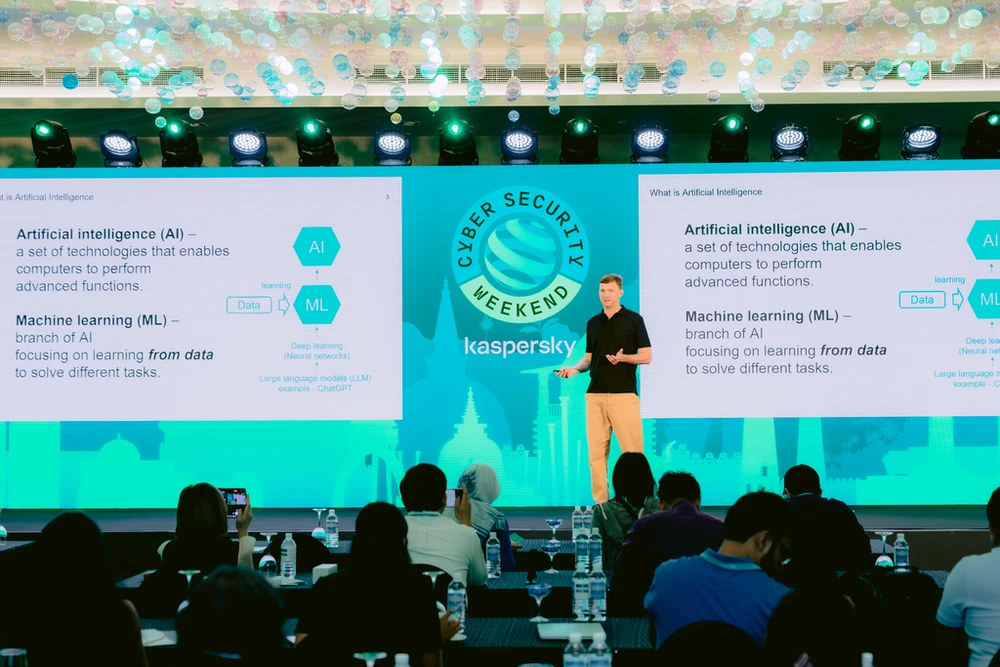

À mesure que l’IA devient plus accessible, avec de plus en plus de particuliers et d’entreprises utilisant l’IA via des outils courants… les pirates peuvent également automatiser les attaques, accélérer les opérations et déployer des campagnes plus complexes pour atteindre leurs objectifs illégaux.

Voici les types d’attaques observés par Kaspersky : ChatGPT peut être utilisé pour développer des logiciels malveillants et déployer automatiquement des attaques sur plusieurs victimes ; Le programme d'IA infiltre les données des utilisateurs sur les smartphones et, grâce au processus d'analyse des données sensibles, les méchants peuvent « lire » complètement les messages, les mots de passe et les codes bancaires de la victime ; Les algorithmes d'intelligence en essaim aident les réseaux informatiques automatisés (bonets) à récupérer les réseaux malveillants qui ont été éliminés par les solutions de sécurité.

Les recherches de Kaspersky sur l’utilisation de l’IA pour déchiffrer les mots de passe montrent que la plupart des mots de passe sont cryptés à l’aide d’algorithmes de hachage tels que MD5 et SHA. Ainsi, une simple opération suffit pour transformer un mot de passe en une ligne de texte crypté, mais inverser l’ensemble du processus est un grand défi.

Grâce à l’IA, les acteurs malveillants peuvent exploiter du contenu frauduleux, notamment du texte, des images, de l’audio et de la vidéo, pour lancer des attaques d’ingénierie sociale. De grands modèles de langage comme ChatGPT-4o sont utilisés pour générer des scripts et des messages très sophistiqués. En surmontant les barrières linguistiques, l'IA peut rédiger un véritable e-mail, simplement en se basant sur les informations des réseaux sociaux. L’IA peut même imiter le style d’écriture de la victime. Cela rend les comportements frauduleux encore plus difficiles à détecter.

Dans le même temps, le Deepfake existe en tant que « problème » en matière de cybersécurité, même s’il était auparavant considéré comme un produit de la recherche scientifique. Se faire passer pour des célébrités à des fins financières est la méthode la plus courante. Ensuite, les escrocs utilisent également Deepfake pour voler des comptes, passer de faux appels aux amis et aux proches des victimes pour s'approprier des biens.

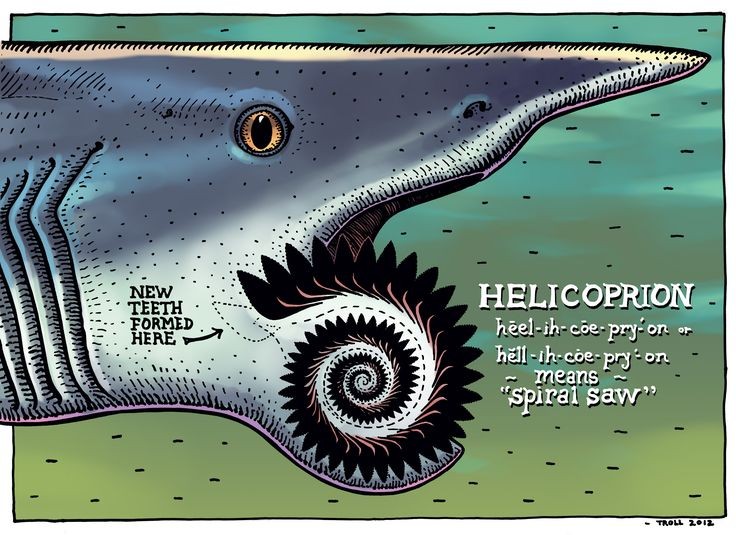

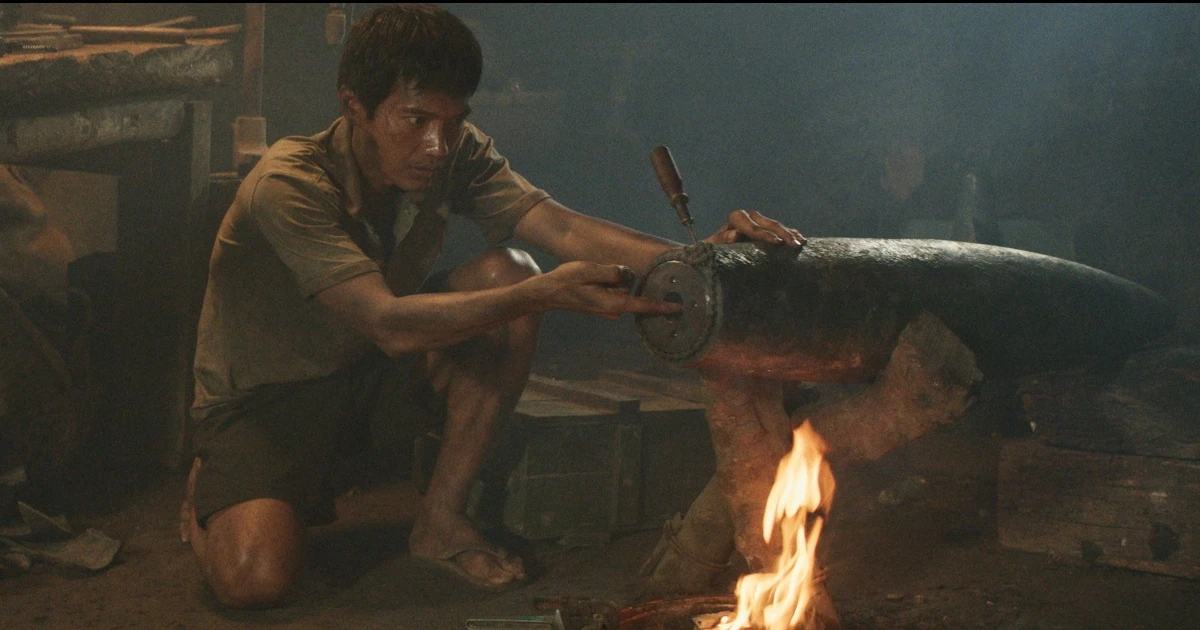

En plus d’exploiter la technologie de l’IA pour des activités illégales, les méchants peuvent également attaquer les algorithmes de l’IA. Comme les attaques par « injection rapide » en saisissant des commandes malveillantes dans de grands modèles de langage, allant même à l’encontre de règles auparavant restreintes ; Les attaques adverses impliquent l'ajout de champs d'information cachés aux images ou à l'audio pour influencer la capacité du système d'apprentissage automatique à classer les images.

L’IA est progressivement intégrée à tous les aspects de la vie humaine, d’Apple Intelligence à Google Gemini en passant par Microsoft Copilot. Par conséquent, la lutte contre les vulnérabilités de l’IA devrait être une priorité absolue. Kaspersky utilise la technologie de l'IA pour protéger ses clients et ses partenaires depuis de nombreuses années, en recherchant en permanence les vulnérabilités des systèmes d'IA, afin d'accroître la résilience du système et en recherchant activement des techniques de cyberattaque pour fournir des solutions de protection fiables contre les attaques d'IA.

KIM THANH

Source : https://www.sggp.org.vn/nhieu-thach-thuc-cua-ai-trong-thoi-dai-moi-post754401.html

![[Photo] Saison des mûres de Phuc Tho – Fruit sucré issu de l'agriculture verte](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/1710a51d63c84a5a92de1b9b4caaf3e5)

![[Photo] Le Premier ministre Pham Minh Chinh préside une réunion pour discuter des solutions fiscales pour les marchandises importées et exportées du Vietnam](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/19b9ed81ca2940b79fb8a0b9ccef539a)

![[Photo] Jeux folkloriques uniques au festival du village de Chuong](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/cff805a06fdd443b9474c017f98075a4)

Comment (0)