وقال جيفري ماكجريجور، الرئيس التنفيذي لشركة تروبيك، إن الحادث كان مجرد غيض من فيض. وأضاف ماكجريجور أنه سيكون هناك الكثير من المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي على وسائل التواصل الاجتماعي ونحن لسنا مستعدين لذلك.

وبحسب شبكة CNN، فإن شركة Truepic تريد حل هذه المشكلة من خلال توفير تقنية تدعي التحقق من صحة الوسائط في وقت إنشائها من خلال Truepic Lens. سيخبر تطبيق جمع البيانات المستخدمين بالتاريخ والوقت والموقع والجهاز المستخدم لإنشاء الصورة، وسيطبق توقيعًا رقميًا للتحقق مما إذا كانت الصورة طبيعية أو تم إنشاؤها بواسطة الذكاء الاصطناعي.

صورة مزيفة لانفجار البنتاغون تنتشر على تويتر

وقالت شركة تروبيك، وهي شركة مدعومة من مايكروسوفت تأسست في عام 2015، إنها تشهد اهتماما من جانب المنظمات غير الحكومية وشركات الإعلام، وحتى شركات التأمين التي تتطلع إلى التأكد من شرعية المطالبات.

وقال ماكجريجور إنه عندما يمكن تزييف كل شيء، وعندما يصل الذكاء الاصطناعي إلى ذروته في الجودة وإمكانية الوصول، فإننا لم نعد نعرف ما هو الواقع على الإنترنت.

تعمل شركات التكنولوجيا مثل Truepic على مكافحة المعلومات المضللة عبر الإنترنت منذ سنوات. لكن ظهور مجموعة جديدة من أدوات الذكاء الاصطناعي القادرة على توليد الصور والأعمال المكتوبة من أوامر المستخدم أضاف المزيد من الإلحاح إلى الأمر. وفي وقت سابق من هذا العام، انتشرت على نطاق واسع صور مزيفة للبابا فرانسيس مرتديًا سترة من تصميم بالنسياغا، ولاعتقال الرئيس الأمريكي السابق دونالد ترامب. وقد تركت الحادثتان ملايين الأشخاص في حيرة بشأن المخاطر المحتملة للذكاء الاصطناعي.

ويدعو بعض المشرعين الآن شركات التكنولوجيا إلى معالجة المشكلة من خلال وضع علامات على المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي. قالت نائبة رئيس المفوضية الأوروبية فيرا جوروفا إن شركات بما في ذلك جوجل وميتا ومايكروسوفت وتيك توك انضمت إلى مدونة الممارسات الطوعية للاتحاد الأوروبي لمكافحة المعلومات المضللة.

يحاول عدد متزايد من الشركات الناشئة وشركات التكنولوجيا العملاقة، بما في ذلك بعض الشركات التي تنفذ الذكاء الاصطناعي التوليدي في منتجاتها، تنفيذ المعايير والحلول لمساعدة الأشخاص على تحديد ما إذا كانت الصورة أو الفيديو قد تم إنشاؤه باستخدام الذكاء الاصطناعي.

ولكن مع تقدم تكنولوجيا الذكاء الاصطناعي بشكل أسرع من قدرة البشر على مواكبتها، فمن غير الواضح ما إذا كانت هذه الحلول قادرة على حل المشكلة بشكل كامل. حتى شركة OpenAI، الشركة التي تقف وراء Dall-E وChatGPT، اعترفت بأن جهودها الخاصة للمساعدة في اكتشاف الكتابة التي يتم إنشاؤها بواسطة الذكاء الاصطناعي غير كاملة.

تتبع شركات تطوير الحلول نهجين لحل المشكلة. تعتمد الطريقة الأولى على تطوير برامج لتحديد الصور التي يتم إنشاؤها بواسطة الذكاء الاصطناعي بعد إنتاجها ومشاركتها عبر الإنترنت. يركز الآخر على وضع علامة على الصورة على أنها حقيقية أو تم إنشاؤها بواسطة الذكاء الاصطناعي باستخدام نوع من التوقيع الرقمي.

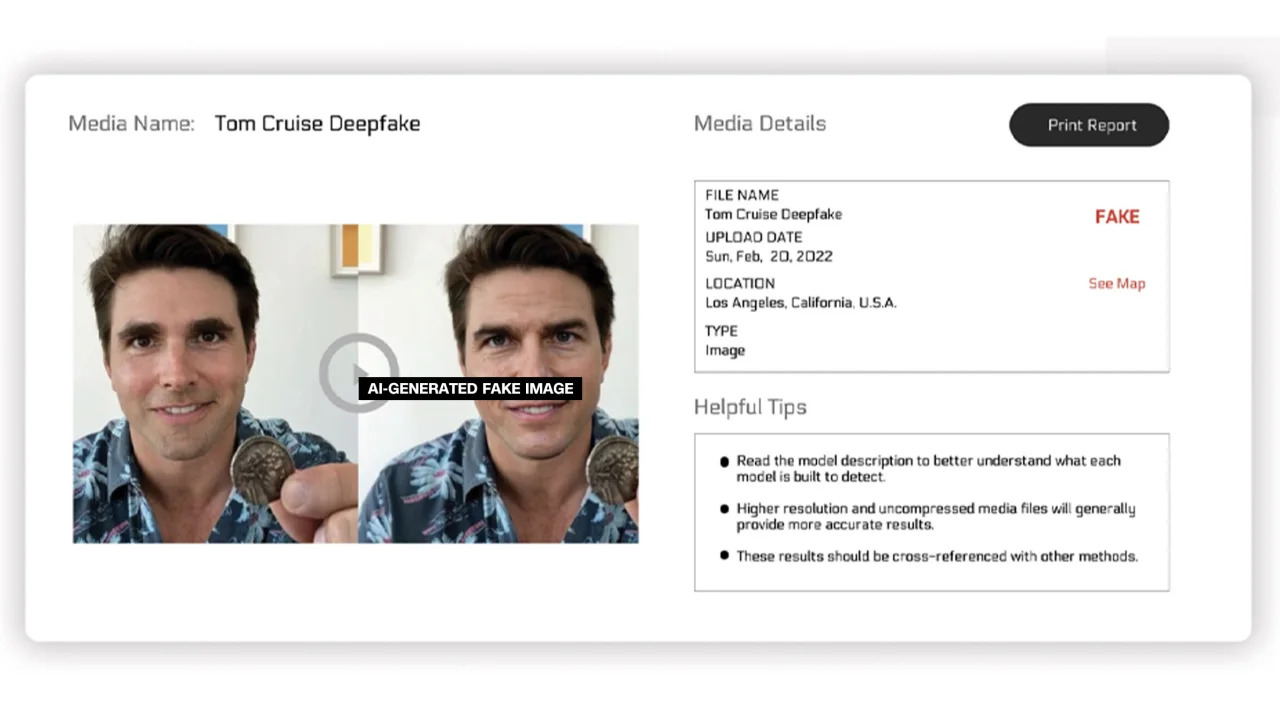

تعمل مؤسستا Reality Defender وHive Moderation على النهج الأول. من خلال منصتهم، يمكن للمستخدمين تحميل الصور المراد مسحها ضوئيًا ثم تلقي تحليل يوضح نسبة مئوية تشير إلى ما إذا كانت الصورة حقيقية أم تم إنشاؤها بواسطة الذكاء الاصطناعي.

وتقول شركة Reality Defender إن الشركة تستخدم تقنية البصمة التزييفية العميقة والمحتوى التوليدي للكشف عن مقاطع الفيديو والصوت والصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي. وفي مثال قدمته الشركة، عرض تطبيق Reality Defender صورة مزيفة لتوم كروز، والتي تم تصنيفها على أنها "مشبوهة" بنسبة 53% لأن الشخص في الصورة كان لديه وجه مشوه يُرى عادةً في الصور المحررة.

صور مُصنّفة تم إنشاؤها بواسطة الذكاء الاصطناعي

تقدم هذه الخدمات إصدارات مجانية ومدفوعة. تقول Hive Moderation إنها تفرض رسومًا قدرها 1.50 دولارًا لكل 1000 صورة. وتقول شركة ريالتي ديفندر إن أسعار منتجاتها قد تختلف بناءً على مجموعة متنوعة من العوامل، في حالة احتياج العميل إلى خبرة الشركة ودعمها. يقول بن كولمان، الرئيس التنفيذي لشركة Reality Defender، إن الخطر يتضاعف كل شهر لأن أي شخص يمكنه إنشاء صور مزيفة باستخدام أدوات الذكاء الاصطناعي.

وتعمل العديد من الشركات الأخرى على دمج نوع من الملصقات في الصور للتأكد من كونها حقيقية أو تم إنشاؤها بواسطة الذكاء الاصطناعي. حتى الآن، كان هذا الجهد مدفوعًا إلى حد كبير بتحالف الأصالة والمحتوى الأصلي (C2PA).

تأسست C2PA في عام 2021 لإنشاء معيار فني لإصدار شهادات منشأ وتاريخ الوسائط الرقمية، من خلال الجمع بين مبادرة مصادقة المحتوى (CAI) الخاصة بشركة Adobe ومشروع Origin، بقيادة Microsoft وBBC، مع التركيز على مكافحة المعلومات المضللة في الأخبار الرقمية. وتشمل الشركات الأخرى المشاركة في C2PA شركة Truepic و Intel و Sony.

استنادًا إلى مبادئ C2PA، ستوفر CAI أدوات مفتوحة المصدر للشركات لإنشاء بيانات اعتماد المحتوى أو البيانات الوصفية التي تحتوي على معلومات حول الصور. وفقًا لموقع CAI، فإن هذا يسمح للمبدعين بمشاركة التفاصيل حول كيفية إنشاء صورة بشكل شفاف. بهذه الطريقة، يمكن للمستخدمين النهائيين الوصول إلى السياق حول من، وماذا، وكيف تم تغيير الصورة - ومن ثم الحكم بأنفسهم على مدى صحة الصورة.

قامت العديد من الشركات بدمج معيار C2PA وأدوات CAI في تطبيقاتها. يتوافق برنامج Firefly من Adobe - أداة التصوير بالذكاء الاصطناعي الجديدة المضافة إلى Photoshop - مع معيار C2PA من خلال ميزة Content Credentials. وأعلنت مايكروسوفت أيضًا أن الصور ومقاطع الفيديو التي تم إنشاؤها باستخدام Bing Image Creator وMicrosoft Designer ستحمل توقيعات تشفيرية في الأشهر المقبلة.

في شهر مايو، أعلنت شركة جوجل عن ميزة "حول هذه الصورة"، والتي تسمح للمستخدمين بمعرفة متى ظهرت الصورة لأول مرة على جوجل وأين يمكن رؤيتها. وأعلن عملاق البحث أيضًا أن كل صورة يتم إنشاؤها بواسطة الذكاء الاصطناعي من Google ستحمل علامة في الملف الأصلي "لإضافة السياق" إذا تم العثور على الصورة على موقع ويب أو منصة أخرى.

في حين تحاول شركات التكنولوجيا معالجة المخاوف بشأن الصور التي تولدها الذكاء الاصطناعي وسلامة الوسائط الرقمية، يؤكد الخبراء في هذا المجال أن الشركات ستحتاج إلى العمل معًا ومع الحكومات لمعالجة هذه القضية. ومع ذلك، تتسابق شركات التكنولوجيا لتطوير الذكاء الاصطناعي على الرغم من المخاطر.

[إعلان 2]

رابط المصدر

تعليق (0)