AIの制御を失うことの危険性

人類は地平線上の亡霊を無視しているようだ。それは人工知能(AI)によって引き起こされる世界的核戦争の亡霊だ。国連のアントニオ・グテーレス事務総長はこれについて警告した。しかし、これまでのところ、核保有国はこの壊滅的な脅威に対処するために団結することができていない。

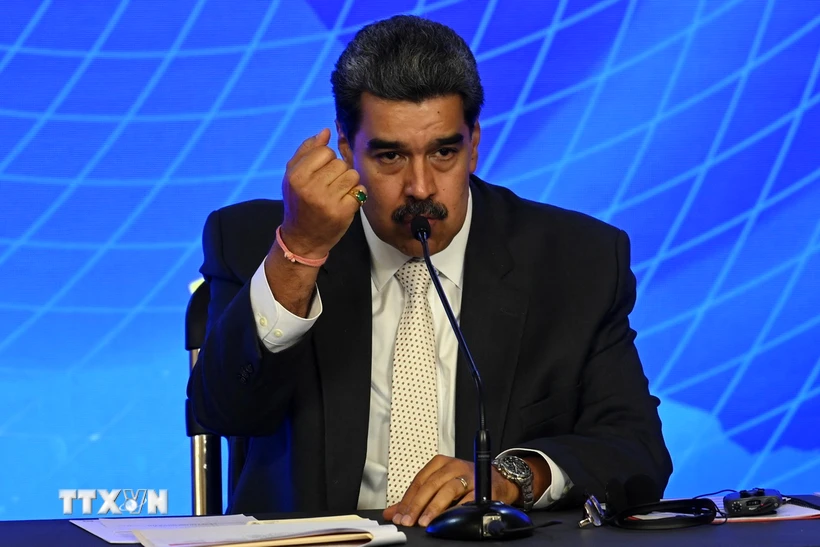

人工知能(AI)の急速な発展により、核兵器の発射プロセスにAIが介入するリスクが高まっています。図

米国、ロシア、中国、英国、フランスの5大核保有国の間では、核兵器発射の決定に人間が関与することを保証するシステムを持つという「人間が関与する」という原則について、長い間非公式の合意が存在してきた。

5大国のうち、核発射指揮システムにAIを導入していると述べている国はない。ムンバイ(インド)の国際研究機関、Strategic Foresight Group会長のサンディープ・ワスレカー博士によると、これは真実だが誤解を招くものだという。

AIはすでに脅威の検出やターゲットの選択に使用されています。 AI 搭載システムは、センサー、衛星、レーダーからの膨大な量のデータをリアルタイムで分析し、飛来するミサイル攻撃を分析して対応オプションを提案します。

その後、オペレーターはさまざまな情報源からの脅威を相互チェックし、敵のミサイルを迎撃するか、報復攻撃を開始するかを決定します。

「現在、オペレーターの応答時間は10~15分です。2030年までに、これは5~7分に短縮されます」とサンディープ・ワスレカー氏は語った。 「最終的な決定は人間が下しますが、AI の予測分析と処方分析の影響を受けることになります。AI は 2030 年代には打ち上げ決定の原動力になる可能性があります。」

問題は、AI が間違いを犯す可能性があることです。脅威検出アルゴリズムは、ミサイル攻撃が存在しない場合でもミサイル攻撃を検知する可能性があります。コンピュータエラー、ネットワーク侵入、または信号を不明瞭にする環境要因が原因である可能性があります。オペレーターが他のソースからの誤報を 2 ~ 3 分以内に確認しないと、報復攻撃が引き起こされる可能性があります。

非常に小さなエラーが大きな災害を引き起こす

犯罪予測、顔認識、がんの予後など、多くの民間機能における AI の使用には 10% の誤差があることが知られています。サンディープ・ワスレカー氏によれば、核早期警報システムでは誤差の範囲は約5%になる可能性がある。

今後 10 年間で画像認識アルゴリズムの精度が向上すると、この誤差の範囲は 1 ~ 2% に低下する可能性があります。しかし、1%の誤差でも世界的核戦争を引き起こす可能性がある。

AI エラーによって核攻撃や報復の決定が引き起こされる可能性があります。写真: 現代戦争研究所

脅威検出システムを回避できる新たなマルウェアが出現するにつれ、今後 2 ~ 3 年でリスクが増大する可能性があります。マルウェアは検出を回避するために適応し、ターゲットを自動的に識別して自動的に攻撃します。

冷戦中にはいくつかの「瀬戸際政策」の状況がありました。 1983年、ソ連の衛星がアメリカが発射したミサイル5発を誤って探知した。ロシアのセプホフ15司令センターの将校スタニスワフ・ペトロフ氏は、これは誤報だと結論付け、反撃を開始できるよう上官に警告しなかった。

1995年、オレネゴルスクのレーダー基地はノルウェー沖でのミサイル攻撃を検知した。ロシアの戦略軍は厳戒態勢に置かれ、当時のロシア大統領ボリス・エリツィンに核のブリーフケースが手渡された。彼はそれが間違いだと疑い、ボタンを押さなかった。それは科学ロケットだったことが判明しました。両方の状況で AI を使用して対応を決定すると、結果は悲惨なものになる可能性があります。

現在、極超音速ミサイルは AI ではなく従来の自動化を使用しています。マッハ5からマッハ25の速度で移動し、レーダー探知を回避して飛行経路を制御することができます。超大国は、移動する標的を瞬時に見つけて破壊し、殺害の決定権を人間から機械に移すために、極超音速ミサイルに AI を搭載する計画を立てている。

汎用人工知能の開発競争も行われており、人間の制御を超えて動作する AI モデルが生まれる可能性もあります。そうなると、AI システムは自らを強化して複製することを学習し、意思決定プロセスを引き継ぐようになります。このような AI が核兵器の意思決定支援システムに統合されると、機械が壊滅的な戦争を開始できるようになります。

行動する時が来た

上記のリスクに直面して、多くの専門家は、人類は「人間が関与する」というスローガンを繰り返すだけでなく、核戦争のリスクを最小限に抑えるために大国間の包括的な合意が必要であると考えています。

この合意には透明性、説明責任、協力のための措置が含まれていなければならない。試験および評価に関する国際基準危機コミュニケーションチャネル国家監督委員会人間のオペレーターを迂回できる攻撃的な AI モデルを禁止する規則。

アントニオ・グテーレス事務総長は、1945年に原爆が投下された広島で平和記念式典に出席した。写真:国連

地政学的な変化がそのような条約を締結する機会を生み出している。例えば、中国と米国の一流AI専門家はAIリスクに関するトラック2の対話を数多く行っており、昨年11月にはジョー・バイデン前米大統領と習近平中国国家主席による共同声明が発表された。

サンディープ・ワスレカー博士によると、億万長者のイーロン・マスクは、AIがもたらす存在的リスクから人類を救う必要性を強く主張している。マスク氏は、現米大統領のドナルド・トランプ氏に対し、ジョー・バイデン氏と習近平氏の共同声明を条約にするよう求める可能性がある。

サンディープ・ワスレカー博士によると、核AIチャレンジにはロシアの参加も必要だという。ロシアは今年1月まで、ウクライナ問題が議論の対象にされない限り、AIとの融合を含むいかなる核リスク削減措置についても議論することを拒否していた。

ドナルド・トランプ大統領がロシアのウラジーミル・プーチン大統領と二国間関係の改善とウクライナ戦争の終結に向けて対話を進めていることから、ロシアは協議に応じる姿勢を見せているかもしれない。

今年2月、パリAIアクションサミットでのJ・D・ヴァンス米副大統領の演説を受けて、新アメリカ安全保障センター(CNAS)も「AI終末の防止:核兵器と人工知能のつながりにおける米中露の競争」と題する報告書を発表した。

報告書は、AIと核のつながりの最も重大なリスクを特定し、米国政府に中国およびロシアと包括的なリスク軽減および危機管理メカニズムを確立するよう求めている。

これに先立ち、昨年9月には、韓国のソウルで開催された軍事における責任あるAI(REAIM)サミットにおいて、米国を含む約60カ国が、軍事におけるAIの責任ある使用を管理するための「行動計画」を採択した。これは、昨年ハーグで開催された会議に続く、2回目の会議となります。こうした動きは、AIによって引き起こされる核戦争のリスクがSFではないことを示しています。

世界は明らかに、ますます緊急性を増す存在に関わる問題に直面しており、国連のアントニオ・グテーレス事務総長が呼びかけているように、「核兵器の使用に関するあらゆる決定は機械やアルゴリズムではなく人間によって行われる」ようにするために、核保有国による実際の行動が求められている。

グエン・カーン

![[写真] トゥ・ラム書記長が汚職、浪費、悪質行為の防止と撲滅に関する中央指導委員会の常任会議を主宰](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/839ea9ed0cd8400a8ba1c1ce0728b2be)

![[写真] ニャンダン新聞がホーチミン共産主義青年同盟創立94周年を祝う](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/5571705682934ac5be5014ce171facb4)

コメント (0)