បញ្ញាសិប្បនិម្មិត (AI) គឺជាប្រធានបទនៃការពិភាក្សាដ៏ធំបំផុតនៅក្នុងឧស្សាហកម្មបច្ចេកវិទ្យាចាប់តាំងពី OpenAI បានប្រកាស ChatGPT ក្នុងខែវិច្ឆិកា ឆ្នាំ 2022។ មិនយូរប៉ុន្មានក្រុមហ៊ុនដូចជា Google, Meta, Microsoft... ក៏បានវិនិយោគយ៉ាងច្រើននៅក្នុងកិច្ចខិតខំប្រឹងប្រែង AI ផ្ទាល់ខ្លួនរបស់ពួកគេ។

Big Tech មិនខ្មាស់អៀនចំពោះមហិច្ឆតារបស់ខ្លួនសម្រាប់ AI នោះទេ ប៉ុន្តែថ្មីៗនេះ វាបានកំពុងដោះស្រាយយ៉ាងស្ងៀមស្ងាត់នូវហានិភ័យនៃបច្ចេកវិទ្យាចំពោះអាជីវកម្មរបស់ខ្លួន។ នៅក្នុងរបាយការណ៍ប្រចាំឆ្នាំ 2023 របស់ខ្លួន Alphabet ដែលជាក្រុមហ៊ុនមេរបស់ Google បាននិយាយថា ផលិតផល និងសេវាកម្ម AI បង្កបញ្ហាប្រឈមខាងសីលធម៌ បច្ចេកវិទ្យា ច្បាប់ និងបទប្បញ្ញត្តិ... ដែលអាចជះឥទ្ធិពលអវិជ្ជមានដល់ម៉ាកយីហោ និងតម្រូវការ។

យោងតាម Bloomberg, Meta, Microsoft និង Oracle ក៏បានលើកឡើងពីការព្រួយបារម្ភអំពី AI នៅក្នុងឯកសាររបស់ពួកគេជាមួយគណៈកម្មការមូលបត្រអាមេរិក (SEC) ដែលជារឿយៗស្ថិតនៅក្រោមផ្នែក "កត្តាហានិភ័យ" ។ ជាឧទាហរណ៍ ក្រុមហ៊ុន Microsoft កត់ចំណាំថា លក្ខណៈពិសេស AI ដែលអាចបង្កើតបានអាចងាយរងគ្រោះទៅនឹងការគំរាមកំហែងផ្នែកសុវត្ថិភាពដែលមិនបានមើលឃើញទុកជាមុន។

នៅក្នុងរបាយការណ៍ប្រចាំឆ្នាំ 2023 របស់ Meta ក្រុមហ៊ុនមេរបស់ Facebook បានសង្កត់ធ្ងន់ថា "មានហានិភ័យសំខាន់ៗដែលទាក់ទងនឹងការអភិវឌ្ឍន៍ និងការដាក់ពង្រាយ AI" ហើយថា "មិនអាចមានការធានាថាការប្រើប្រាស់ AI នឹងកែលម្អសេវាកម្ម ផលិតផល ឬផ្តល់អត្ថប្រយោជន៍ដល់ប្រតិបត្តិការអាជីវកម្មនោះទេ។" មេតារាយបញ្ជីសេណារីយ៉ូ AI ដែលអាចបង្កគ្រោះថ្នាក់ដល់អ្នកប្រើប្រាស់ និងបង្ហាញពួកគេទៅកាន់វិវាទ ដូចជាព័ត៌មានមិនពិត (ដូចជានៅក្នុងការបោះឆ្នោត) ខ្លឹមសារព្យាបាទ ការរំលោភកម្មសិទ្ធិបញ្ញា និងឯកជនភាពទិន្នន័យ។

ទន្ទឹមនឹងនេះ សាធារណជនក៏បានសម្តែងការព្រួយបារម្ភអំពី AI ដែលធ្វើឱ្យការងារមួយចំនួនលែងប្រើ ឬបាត់ ឬគំរូភាសាធំៗដែលត្រូវបានបណ្តុះបណ្តាលលើទិន្នន័យផ្ទាល់ខ្លួនដែលផ្សព្វផ្សាយព័ត៌មានមិនពិត។

នៅថ្ងៃទី 4 ខែមិថុនា ក្រុមអតីតនិយោជិត OpenAI មួយក្រុមបានផ្ញើ "លិខិតចេតនា" សុំឱ្យក្រុមហ៊ុនបច្ចេកវិទ្យាធ្វើបន្ថែមទៀតដើម្បីកាត់បន្ថយហានិភ័យនៃ AI ។ ពួកគេបារម្ភថា AI បង្កើនវិសមភាព ឧបាយកល ព័ត៌មានមិនពិត និងប្រព័ន្ធ AI ស្វ័យប្រវត្តិដែលមិនមានការគ្រប់គ្រងបានគំរាមកំហែងដល់ការរស់រានមានជីវិតរបស់មនុស្សជាតិ។

ប្រភព

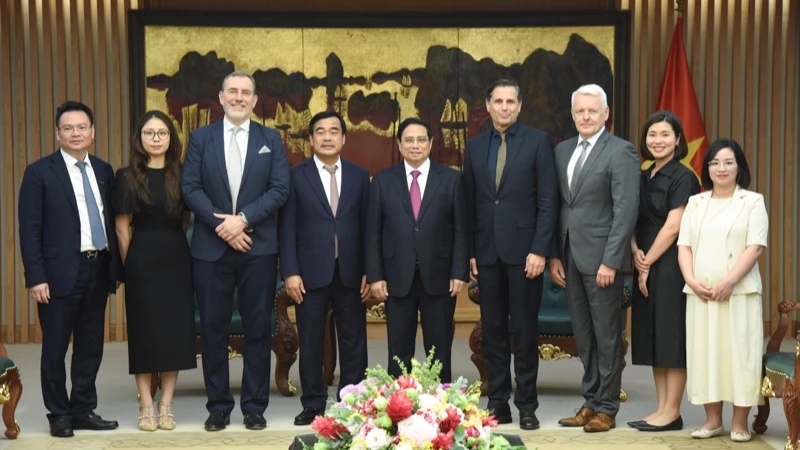

![[រូបថត] នាយករដ្ឋមន្ត្រី Pham Minh Chinh ទទួលជួបប្រធាន Skoda Auto Group](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/27/298bbec539e346d99329a8c63edd31e5)

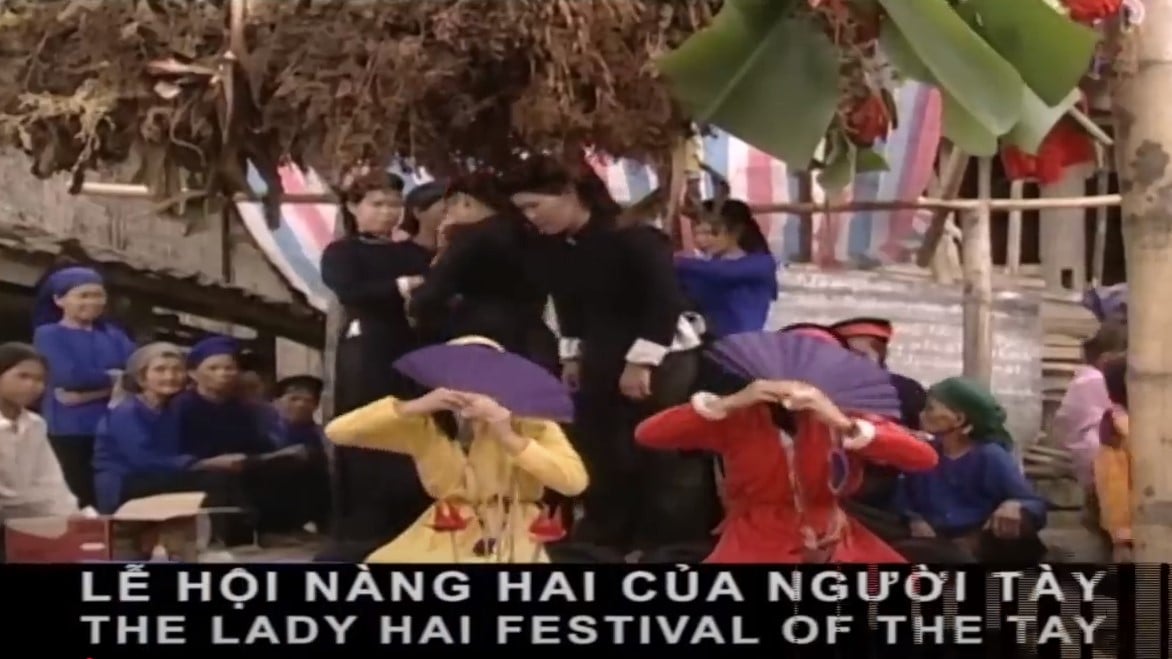

![[រូបថត] មនុស្សជិត 2,000 នាក់បានចូលរួមយ៉ាងសាទរក្នុងទិវារត់អូឡាំពិក - ដើម្បីសុវត្ថិភាពនៃមាតុភូមិ](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/27/33bed26f570a477daf286b68b14474d4)

Kommentar (0)