Un equipo de investigación de inteligencia artificial (IA) de la Universidad Politécnica de Valencia, España, ha descubierto que, a medida que los modelos lingüísticos grandes se vuelven más grandes y sofisticados, tienden a ser menos propensos a admitir ante los usuarios que no saben la respuesta. [anuncio_1]

|

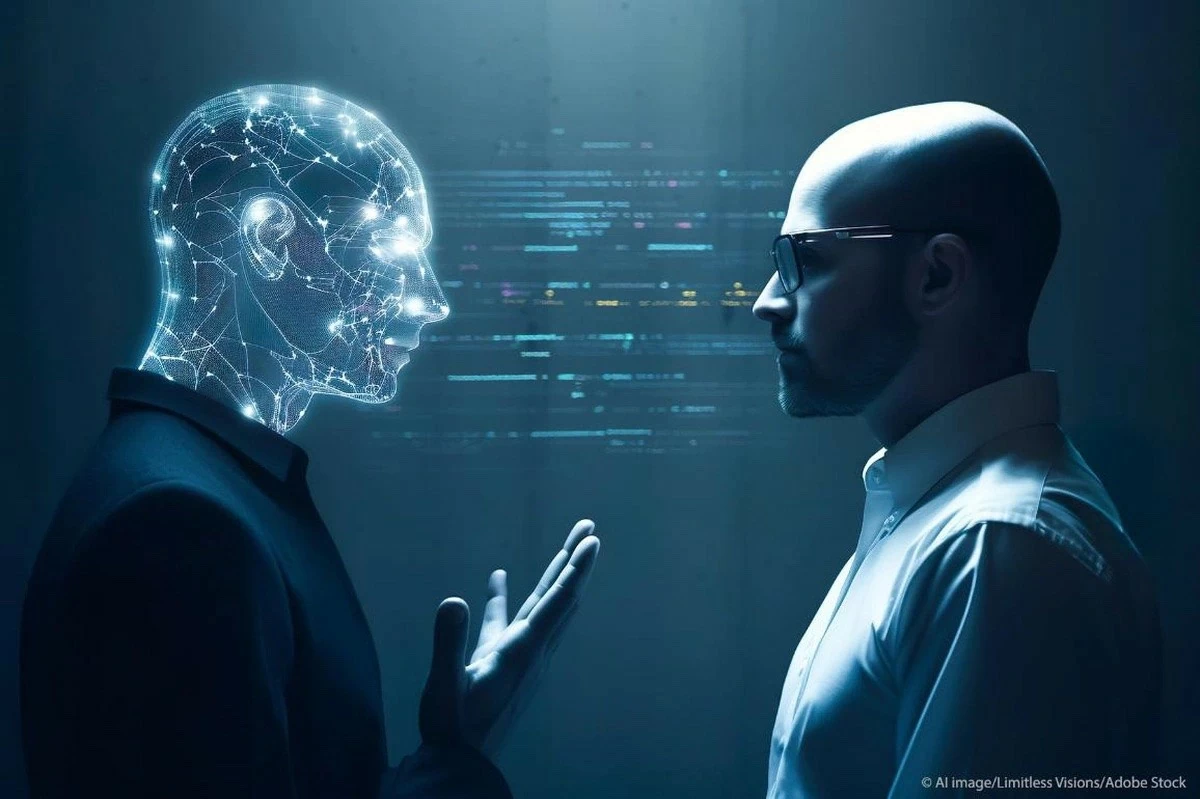

| Cuanto más inteligente sea la IA, menos probable será que admita ante los usuarios que no sabe la respuesta. (Imagen de ilustración AI) |

En el estudio, publicado en la revista Nature , el equipo probó las últimas versiones de tres de los chatbots de IA más populares en cuanto a capacidad de respuesta, precisión y la capacidad de los usuarios para detectar respuestas incorrectas.

Para probar la precisión de los tres LLM más populares, BLOOM, LLaMA y GPT, el equipo planteó miles de preguntas y comparó las respuestas recibidas con las respuestas de versiones anteriores a las mismas preguntas. También varían en cuanto a temas, incluyendo matemáticas, ciencias, rompecabezas de palabras y geografía, así como la capacidad de crear texto o realizar acciones como ordenar listas.

Los resultados del estudio revelaron algunas tendencias notables. La precisión general de los chatbots mejora con cada nueva versión, pero aún disminuye cuando se enfrentan a preguntas más difíciles. Sorprendentemente, a medida que los LLM se vuelven más grandes y más sofisticados, tienden a ser menos abiertos sobre su capacidad para responder correctamente.

En versiones anteriores, la mayoría de los LLM eran sinceros con los usuarios cuando no podían encontrar una respuesta o necesitaban más información. Por el contrario, las versiones más nuevas tienden a adivinar más, lo que resulta en más respuestas en general, incluidas tanto correctas como incorrectas. Más preocupante aún es que el estudio encontró que todos los LLM todavía ocasionalmente daban respuestas incorrectas incluso a preguntas fáciles, lo que sugiere que su confiabilidad sigue siendo un problema que necesita mejoras.

Estos hallazgos resaltan una paradoja en la evolución de la IA: si bien los modelos se están volviendo más poderosos, también pueden volverse menos transparentes respecto de sus limitaciones.

Esto plantea nuevos desafíos en el uso y la confianza de los sistemas de IA, lo que requiere que los usuarios sean más cautelosos y que los desarrolladores se concentren en mejorar no solo la precisión sino también la “autoconciencia” de los modelos.

[anuncio_2]

Fuente: https://baoquocte.vn/cang-thong-minh-tri-tue-nhan-tao-cang-co-xu-huong-giau-dot-287987.html

![[Foto] El Secretario General To Lam recibe al Embajador de Francia en Vietnam, Olivier Brochet](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/49224f0f12e84b66a73b17eb251f7278)

![[Foto] El presidente de la Asamblea Nacional, Tran Thanh Man, se reúne con destacados trabajadores de la industria del petróleo y el gas.](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/1d0de4026b75434ab34279624db7ee4a)

![[Foto] Clausura de la IV Cumbre de la Alianza para el Crecimiento Verde y los Objetivos Globales](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/c0a0df9852c84e58be0a8b939189c85a)

![[Foto] Promover la amistad, la solidaridad y la cooperación entre los ejércitos y los pueblos de ambos países.](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/0c4d087864f14092aed77252590b6bae)

![[Foto] El periódico Nhan Dan anuncia el proyecto "Ama tanto a Vietnam".](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/362f882012d3432783fc92fab1b3e980)

![[Foto] Ceremonia de bienvenida al Ministro de Defensa chino y a la delegación para el intercambio de amistad.](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/fadd533046594e5cacbb28de4c4d5655)

![[Vídeo] Viettel pone oficialmente en funcionamiento la línea de cable óptico submarino más grande de Vietnam](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/f19008c6010c4a538cc422cb791ca0a1)

Kommentar (0)