เวียดนามมีกฎจริยธรรมด้าน AI ชุดแรกแล้ว

คาดว่าปัญญาประดิษฐ์ (AI) จะนำประโยชน์มากมายมาสู่ประชาชน สังคม และเศรษฐกิจของเวียดนาม ควบคู่ไปกับการประยุกต์ใช้ AI เวียดนามได้ทำการวิจัยและดำเนินมาตรการเพื่อลดความเสี่ยงในกระบวนการพัฒนาและการใช้งาน AI โดยรักษาสมดุลระหว่างปัจจัยทางเศรษฐกิจ จริยธรรม และกฎหมาย

นี่ก็เป็นเหตุผลที่กระทรวงวิทยาศาสตร์และเทคโนโลยี (MOST) ได้ออกเอกสารชุดหนึ่งที่เป็นแนวทางเกี่ยวกับหลักการต่างๆ เกี่ยวกับการวิจัยและพัฒนาระบบปัญญาประดิษฐ์อย่างมีความรับผิดชอบ

เอกสารแนะแนวกำหนดหลักการทั่วไปและคำแนะนำโดยสมัครใจจำนวนหนึ่งสำหรับการอ้างอิงและการประยุกต์ใช้ในกระบวนการวิจัย ออกแบบ พัฒนา และจัดทำระบบปัญญาประดิษฐ์

ขอเชิญชวนหน่วยงานด้านวิทยาศาสตร์และเทคโนโลยี องค์กร ธุรกิจ และบุคคลต่างๆ ที่มีส่วนร่วมในการวิจัย ออกแบบ พัฒนา และจัดเตรียมระบบปัญญาประดิษฐ์ ให้ใช้เอกสารแนะนำฉบับนี้

ดังนั้น การวิจัยและพัฒนาของระบบ AI ในเวียดนามจะต้องยึดตามมุมมองพื้นฐานในการก้าวไปสู่สังคมที่เน้นมนุษย์เป็นศูนย์กลาง โดยทุกคนได้รับประโยชน์จากปัญญาประดิษฐ์ โดยต้องรักษาสมดุลที่สมเหตุสมผลระหว่างประโยชน์และความเสี่ยง

กิจกรรมวิจัยและพัฒนาระบบ AI ในเวียดนามมุ่งเน้นที่จะให้เกิดความเป็นกลางทางเทคโนโลยี ในทุกกรณี กระทรวงวิทยาศาสตร์และเทคโนโลยีสนับสนุนการแลกเปลี่ยนและหารือโดยการมีส่วนร่วมของฝ่ายที่เกี่ยวข้อง หลักการและแนวปฏิบัตินี้จะยังคงได้รับการวิจัยและปรับปรุงเพื่อให้เหมาะสมกับสถานการณ์ในทางปฏิบัติ

กระทรวงวิทยาศาสตร์และเทคโนโลยีกล่าวว่าการจัดทำเอกสารชุดดังกล่าวมีวัตถุประสงค์เพื่อส่งเสริมความสนใจในการวิจัย พัฒนา และการใช้ปัญญาประดิษฐ์ในเวียดนามในลักษณะที่ปลอดภัยและรับผิดชอบ โดยลดผลกระทบด้านลบต่อประชาชนและชุมชนให้เหลือน้อยที่สุด สิ่งนี้จะเพิ่มความไว้วางใจของผู้ใช้และสังคมต่อ AI และอำนวยความสะดวกในการวิจัยและพัฒนาปัญญาประดิษฐ์ในเวียดนาม

หลักการพัฒนา AI อย่างมีความรับผิดชอบ

ในเอกสารดังกล่าว นักพัฒนาจะได้รับการสนับสนุนให้แสดงให้เห็นถึงจิตวิญญาณแห่งการทำงานร่วมกัน ส่งเสริมนวัตกรรมผ่านการเชื่อมต่อและปฏิสัมพันธ์ของระบบปัญญาประดิษฐ์ นักพัฒนาจะต้องแน่ใจว่ามีความโปร่งใสโดยการควบคุมอินพุต/เอาต์พุตของระบบ AI และความสามารถในการอธิบายการวิเคราะห์ที่เกี่ยวข้อง

นักพัฒนาจำเป็นต้องให้ความสำคัญกับความสามารถในการควบคุมระบบปัญญาประดิษฐ์และประเมินความเสี่ยงที่เกี่ยวข้องไว้ล่วงหน้า วิธีการหนึ่งในการประเมินความเสี่ยงคือการดำเนินการทดสอบในพื้นที่แยกจากกัน เช่น ห้องปฏิบัติการ หรือสภาพแวดล้อมที่รับประกันความปลอดภัยก่อนนำไปใช้งานจริง

นอกจากนี้ เพื่อให้แน่ใจว่าระบบ AI สามารถควบคุมได้ นักพัฒนาควรให้ความสำคัญกับการติดตามระบบ (ด้วยเครื่องมือประเมิน/ตรวจสอบ หรือการแก้ไข/อัปเดตตามความคิดเห็นของผู้ใช้) และมาตรการตอบสนอง (การปิดระบบ การปิดเครือข่าย ฯลฯ) ที่ดำเนินการโดยมนุษย์หรือระบบ AI ที่เชื่อถือได้

ผู้พัฒนาต้องแน่ใจว่าระบบปัญญาประดิษฐ์จะไม่ก่อให้เกิดอันตรายต่อชีวิต ร่างกาย หรือทรัพย์สินของผู้ใช้หรือบุคคลที่สาม รวมถึงผ่านตัวกลาง ควรให้ความสำคัญกับความปลอดภัยของระบบปัญญาประดิษฐ์ ความน่าเชื่อถือ และความสามารถในการทนต่อการโจมตีทางกายภาพหรืออุบัติเหตุ จำเป็นต้องแน่ใจว่าระบบ AI ไม่ละเมิดความเป็นส่วนตัวของผู้ใช้หรือบุคคลที่สาม สิทธิความเป็นส่วนตัวที่ระบุไว้ในหลักการ ได้แก่ ความเป็นส่วนตัวในเชิงพื้นที่ (ความสบายใจในชีวิตส่วนบุคคล) ความเป็นส่วนตัวของข้อมูล (ข้อมูลส่วนบุคคล) และความลับของการสื่อสาร

ในการพัฒนาระบบปัญญาประดิษฐ์ นักพัฒนาจะต้องเอาใจใส่เป็นพิเศษในการเคารพสิทธิมนุษยชนและศักดิ์ศรีความเป็นมนุษย์ ในขอบเขตที่เป็นไปได้ ขึ้นอยู่กับลักษณะของเทคโนโลยีที่ประยุกต์ใช้ นักพัฒนาควรใช้มาตรการเพื่อให้แน่ใจว่าจะไม่ก่อให้เกิดการเลือกปฏิบัติหรือไม่ยุติธรรมอันเนื่องมาจากอคติ (ความลำเอียง) ในข้อมูลการฝึกอบรม ไม่เพียงเท่านั้น นักพัฒนายังต้องปฏิบัติตามหน้าที่ต่อผู้ถือผลประโยชน์และสนับสนุนผู้ใช้ด้วย

ที่มา: https://vietnamnet.vn/viet-nam-ra-nguyen-tac-ai-khong-duoc-gay-ton-hai-tinh-mang-tai-san-nguoi-dung-2292026.html

![[ภาพ] นครโฮจิมินห์เร่งซ่อมทางเท้าก่อนวันหยุด 30 เมษายน](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/17f78833a36f4ba5a9bae215703da710)

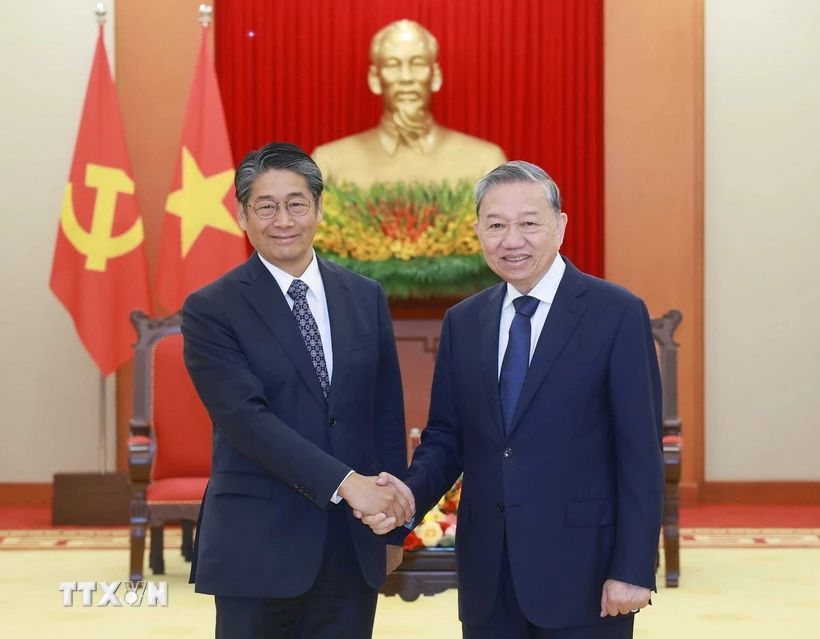

![[ภาพ] เลขาธิการโตลัมให้การต้อนรับเอกอัครราชทูตญี่ปุ่นประจำเวียดนาม อิโตะ นาโอกิ](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3a5d233bc09d4928ac9bfed97674be98)

![[ภาพ] ช่วงเวลาพักผ่อนสั้นๆ ของกองกำลังกู้ภัยกองทัพประชาชนเวียดนาม](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/a2c91fa05dc04293a4b64cfd27ed4dbe)

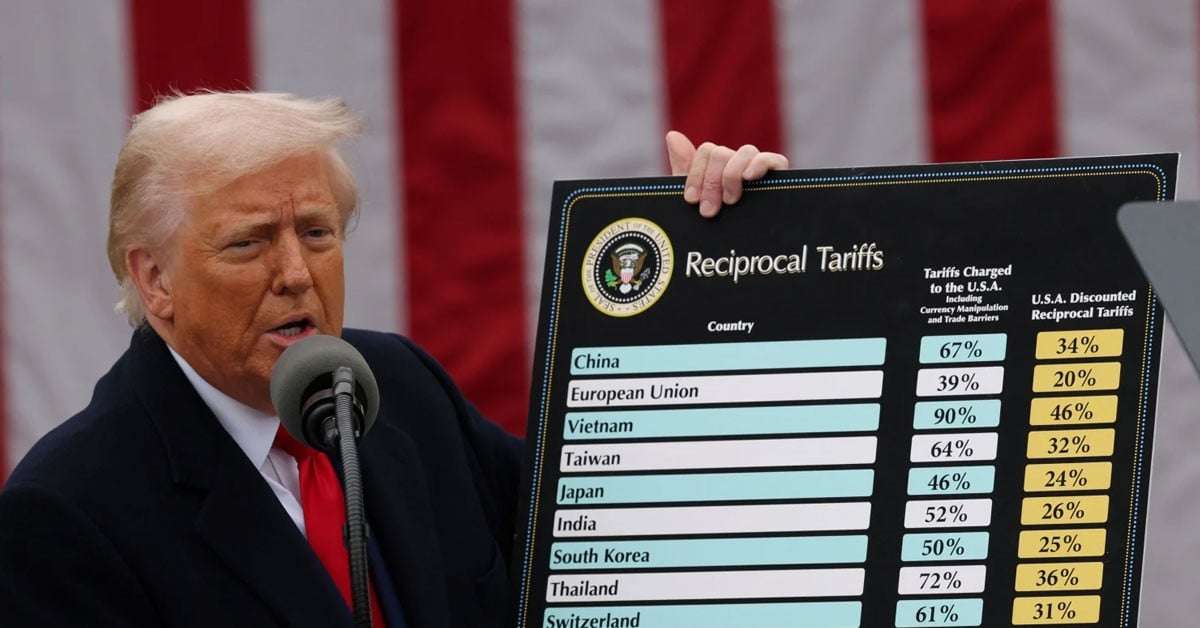

![[ภาพ] นายกรัฐมนตรี Pham Minh Chinh เป็นประธานการประชุมหลังสหรัฐประกาศภาษีศุลกากรตอบโต้](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/ee90a2786c0a45d7868de039cef4a712)

![[ภาพ] นายกรัฐมนตรี Pham Minh Chinh เป็นประธานการประชุมคณะกรรมการอำนวยการศูนย์การเงินระดับภูมิภาคและระหว่างประเทศครั้งแรก](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/47dc687989d4479d95a1dce4466edd32)

การแสดงความคิดเห็น (0)