Департамент информационной безопасности недавно выпустил предупреждение относительно продолжающихся случаев мошенничества с использованием высокотехнологичных видеоматериалов и изображений.

Соответственно, власти широко предупреждают общественность о ситуации, когда киберпреступники используют общедоступные изображения и видео людей для редактирования, вырезания и шантажа с помощью поддельных видеороликов.

Используя технологию Deepfake, которая позволяет воспроизводить звук и изображение человека с высокой точностью, преступники могут выдавать себя за лидеров на онлайн-встречах или создавать видеоролики и звонки для совершения финансового мошенничества.

Более того, подобные мошенничества часто эксплуатируют психологические факторы, такие как срочность, страх или власть, заставляя жертв действовать поспешно, не проверяя тщательно подлинность информации.

Дипфейки не ограничиваются мошенничеством в сфере финансовых инвестиций. Другим примером являются романтические аферы, где Deepfakes используются для создания вымышленных персонажей, которые взаимодействуют с жертвами посредством видеозвонков; Завоевав доверие жертвы, мошенник просит перевести деньги на покрытие непредвиденных расходов, командировочных расходов или кредитов.

В связи с вышеизложенной ситуацией Департамент информационной безопасности рекомендует гражданам с осторожностью относиться к инвестиционным советам от знаменитостей в социальных сетях; Будьте осторожны с неизвестными текстовыми сообщениями, электронными письмами или звонками; Внимательно следите за неестественными выражениями лиц на видео.

Людям также необходимо ограничить публикацию в социальных сетях контента, связанного с личной информацией, чтобы избежать случаев кражи злоумышленниками такой информации, как изображения, видео или голоса; Кроме того, сделайте свою учетную запись приватной, чтобы защитить вашу личную информацию.

В беседе с корреспондентом газеты Dai Doan Ket эксперт по кибербезопасности Нго Минь Хьеу, соучредитель проекта по предотвращению кибермошенничества во Вьетнаме (Chongluadao.vn), сказал, что использование технологии Deepfake (глубокое моделирование) в ИИ для подделки видеозвонков с целью мошенничества по-прежнему остается сложной задачей. Субъекты используют эту технологию для повышения доверия к своей «добыче».

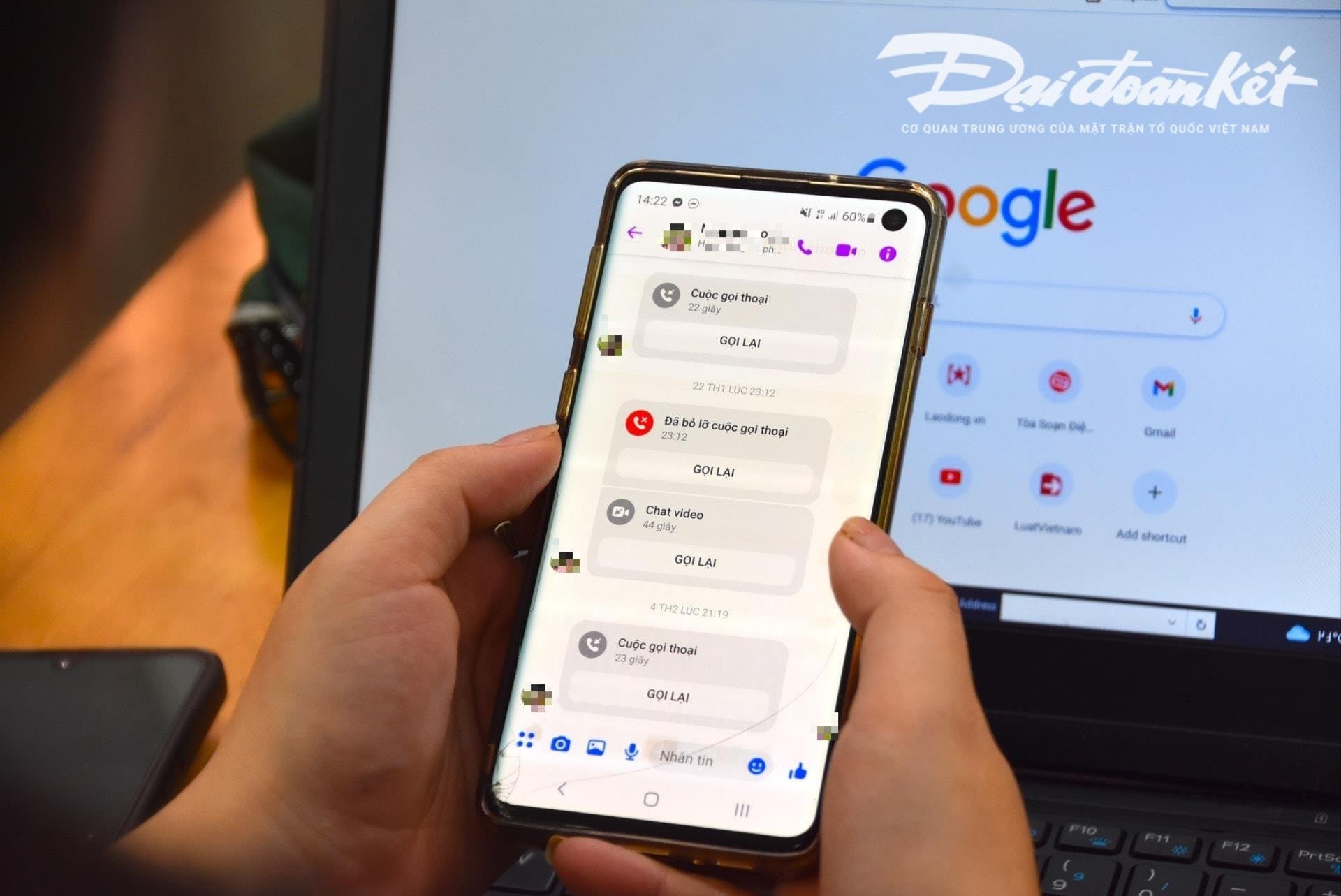

В частности, субъекты будут заблаговременно совершать видеозвонки жертвам с помощью ранее «украденных» изображений и видео и обрабатывать их технически, искажать звук или подделывать проблемы с изображением, чтобы завоевать доверие жертв.

Обычно эти звонки очень короткие, длятся всего несколько секунд, затем мошенник под предлогом нестабильной связи, нахождения на улице и т. д. просит жертву выполнить его просьбы.

Эксперты предупреждают, что в ближайшем будущем использование ИИ для кибермошенничества, вероятно, значительно возрастет. Поэтому людям необходимо заранее повышать свою бдительность. Особенно при получении странных сообщений, видеозвонков, ссылок.

Согласно анализу этого эксперта, текущий алгоритм искусственного интеллекта (ИИ) Deepfake во время звонков в реальном времени не сможет справиться с ситуацией, если звонящий повернется налево, направо или встанет...

Одной из особых слабостей, о которой следует помнить людям, получающим такие звонки, являются их зубы. Соответственно, существующие алгоритмы искусственного интеллекта не могут воспроизвести зубы человека, за которого выдает себя человек.

При использовании Deepfake на изображении открытого рта человека могут отсутствовать зубы, у некоторых людей может быть 3 челюсти, даже 4. Таким образом, зубы являются наиболее узнаваемым элементом поддельного звонка с использованием Deepfake.

«Замедление» и невыполнение просьбы немедленно — обязательное условие, позволяющее не попасть в ловушку мошенничества. При получении сообщений или звонков через социальные сети людям необходимо позвонить своим родственникам напрямую, чтобы точно узнать, кто с ними связывается, в течение как минимум 30 секунд или встретиться лично.

В случае возникновения подозрений в выдаче себя за родственников в социальных сетях с целью мошенничества или присвоения имущества необходимо немедленно сообщить в ближайшее отделение полиции для своевременной поддержки и рассмотрения вопроса.

Источник: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

![[Фото] Закрытие 11-й конференции 13-го Центрального Комитета Коммунистической партии Вьетнама](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/114b57fe6e9b4814a5ddfacf6dfe5b7f)

![[Фото] Преодолевая все трудности, ускоряем ход строительства проекта расширения ГЭС Хоабинь](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/bff04b551e98484c84d74c8faa3526e0)

Комментарий (0)