(Dan Tri) - La quantité de données utilisées pour former l'intelligence artificielle est presque épuisée, ce qui oblige les chercheurs à utiliser l'IA pour s'entraîner les uns les autres. Cela pourrait être la percée qui aiderait l’IA à surpasser l’intelligence humaine.

Elon Musk propose de nouvelles façons de développer l'IA qui pourraient être dangereuses

Le milliardaire de la technologie Elon Musk, fondateur de la société d'intelligence artificielle xAI, vient de publier des informations choquantes sur le processus de formation et d'éducation des modèles d'intelligence artificielle (IA).

« Nous avons désormais épuisé toutes les connaissances humaines en matière de formation et d'éducation de l'IA. Cela se produit depuis l'année dernière », a répondu Elon Musk dans une interview diffusée en direct sur le réseau social X le 9 janvier.

Les modèles d'IA tels que GPT-4, Gemini, Grok ou Llama... sont entraînés à partir de grandes quantités de données collectées sur Internet, à partir de revues scientifiques, d'études publiées, de données utilisateurs sur les réseaux sociaux...

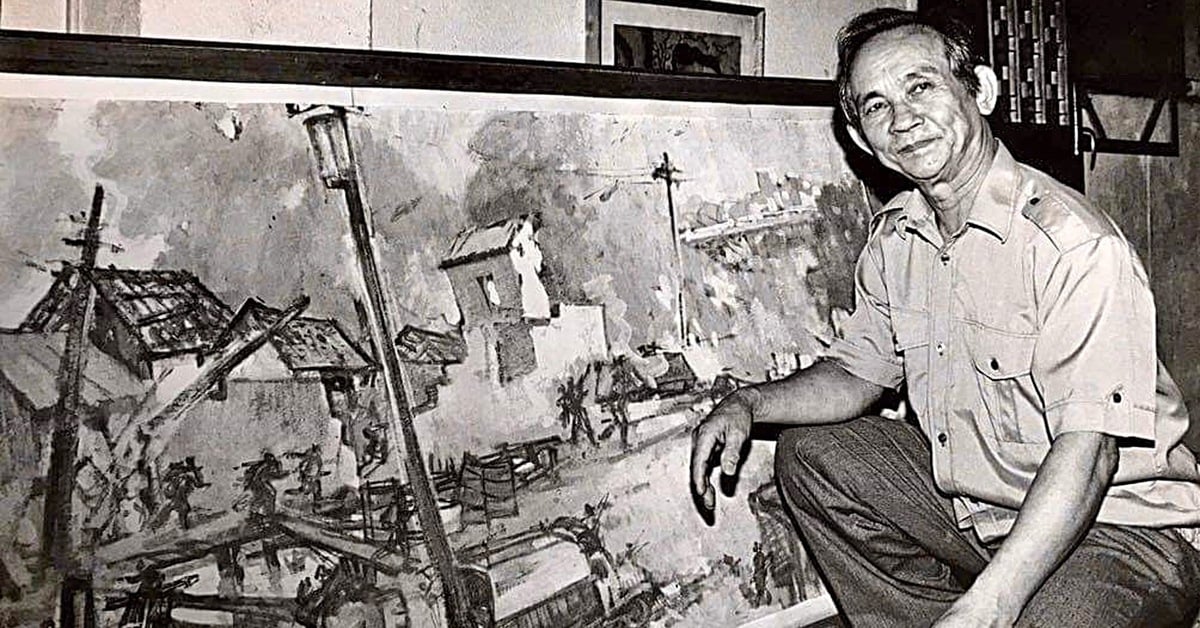

Elon Musk propose d’utiliser les données de l’IA pour former l’IA, mais cela comporte de nombreux risques potentiels (Illustration : Getty).

Cependant, le rythme de développement des modèles d’IA est si rapide que la quantité de données disponibles n’est plus suffisante pour former et améliorer l’intelligence de ces modèles d’IA.

Pour surmonter ce problème, Elon Musk a proposé une solution, qui consiste à utiliser les données générées par l’IA elle-même pour former les modèles d’IA. En d’autres termes, l’IA peut s’entraîner elle-même et s’entraîner mutuellement sans dépendre de données fournies par l’homme.

« La seule façon de résoudre ce problème est de compléter les données synthétiques générées par les modèles d’IA eux-mêmes et d’utiliser ces données pour former l’IA elle-même », a partagé Elon Musk.

Les systèmes d’IA auto-formés basés sur des données synthétiques générées par l’IA elle-même contribueront à réduire les coûts de développement et la dépendance aux données humaines. Cela a conduit de nombreuses personnes à s’inquiéter du fait que l’IA pourrait s’entraîner à surpasser l’intelligence humaine, au-delà du contrôle de l’humanité.

Cependant, les experts en intelligence artificielle affirment que l’utilisation de données synthétiques générées par l’IA elle-même pour former des modèles d’IA peut faire s’effondrer ces modèles, lorsque les données générées manquent de créativité, sont biaisées et ne sont pas mises à jour avec les données les plus récentes.

« Lorsque vous utilisez des données synthétiques pour former des modèles d’IA, leurs performances se dégradent progressivement, les données de sortie étant peu inspirantes et biaisées », a déclaré Andrew Duncan, directeur de l’IA à l’Alan Turing Institute au Royaume-Uni.

Les données de haute qualité sont considérées comme une « mine de ressources » inestimable pour laquelle les sociétés de développement d’IA se disputent. Cependant, tous les scientifiques ne sont pas prêts à consacrer leurs recherches à la formation de modèles d’IA.

Google a réussi à créer une IA qui pense et agit exactement comme les humains

Imaginez avoir un moyen de déterminer la personnalité, les attitudes et le style d’une personne, puis de créer une réplique IA de cette personne.

Il ne s’agit pas de science-fiction, mais de l’objectif sous-jacent d’une étude révolutionnaire menée par des chercheurs de l’Université de Stanford et de Google.

En seulement 2 heures d’entretien, Google peut créer une IA qui pense et agit exactement comme vous (Photo : ZipRecruiter).

Les chercheurs ont créé une réplique IA de plus de 1 000 participants en utilisant des informations provenant d’entretiens qui ont duré seulement 2 heures. Ces IA peuvent imiter le comportement humain.

Le potentiel d’application de cette invention est énorme. Les décideurs politiques et les entreprises pourraient utiliser cette simulation d’IA pour prédire la réaction du public aux nouvelles politiques ou aux nouveaux produits, au lieu de s’appuyer uniquement sur des groupes de discussion ou des sondages répétitifs.

Les chercheurs pensent que cette technologie pourrait aider à explorer les structures sociales, à piloter des interventions et à développer des théories nuancées du comportement humain.

Cependant, cela comporte également certains risques, comme des préoccupations éthiques concernant l’utilisation abusive de clones d’IA. Les acteurs malveillants pourraient exploiter cette IA pour manipuler l’opinion publique, se faire passer pour des individus ou simuler les aspirations publiques sur la base de fausses données agrégées.

Ces préoccupations s’inscrivent également dans la crainte de longue date de nombreux citoyens selon laquelle la prolifération de modèles d’IA similaires pourrait avoir des effets négatifs sur l’avenir de l’humanité.

Source : https://dantri.com.vn/suc-manh-so/ai-sap-dat-duoc-buoc-dot-pha-moi-co-the-vuot-qua-tri-tue-con-nguoi-20250111132229246.htm

![[Photo] Des reliques spéciales au Musée d'histoire militaire du Vietnam associées à l'héroïque 30 avril](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/a49d65b17b804e398de42bc2caba8368)

![[Photo] Moment d'amour : les Birmans sont émus de remercier les soldats vietnamiens](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/9b2e07196eb14aa5aacb1bc9e067ae6f)

![[Photo] Le secrétaire général To Lam reçoit l'ambassadeur du Japon au Vietnam Ito Naoki](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3a5d233bc09d4928ac9bfed97674be98)

Comment (0)