Desarrollar la responsabilidad es un elemento clave para hacer que la IA sea más útil. Ilustración: Bloomberg. |

La IA generativa está cambiando muchos campos. En educación, la IA apoya el aprendizaje, detecta el plagio y ayuda en la enseñanza. En el campo médico, la IA apoya el diagnóstico por imágenes, la personalización de regímenes de tratamiento y la investigación de medicamentos. Esta herramienta también promueve la creación automática de contenidos, apoya la atención al cliente y crea “KOL virtuales” en los negocios y el marketing.

Además de los beneficios, la proliferación de la IA generativa también plantea preocupaciones éticas, ya que la herramienta puede amplificar los sesgos y difundir información errónea. La IA también tiene el potencial de comprometer la privacidad, la seguridad de los datos y la estabilidad de la fuerza laboral.

Al igual que muchos países alrededor del mundo, Vietnam está emergiendo en la aplicación de IA generativa. Para que la IA sea una herramienta útil en lugar de dañina para los humanos, desarrollarla de manera responsable es una de las tareas importantes.

Tendencias de IA responsable

El Dr. Sam Goundar, profesor titular de Tecnología de la Información en RMIT Vietnam, reitera algunas de las controversias que rodean la ética de la IA generativa. Desde el escándalo de pornografía falsa de Taylor Swift, la llamada de suplantación de identidad del expresidente estadounidense Joe Biden hasta el fraude académico mediante inteligencia artificial.

“Más preocupantes son los casos de chatbots que incitan al suicidio, crean contenido de abuso infantil, incitan a asesinatos, algoritmos de contratación sesgados o vulnerabilidades de seguridad explotadas por la IA.

Estas cuestiones resaltan la necesidad de un enfoque centrado en el ser humano para mitigar el uso indebido de la IA y proteger los intereses individuales y sociales”, afirmó el Dr. Goundar.

Pantalla de la herramienta Microsoft Copilot. Foto: Bloomberg. |

Según el Dr. Goundar, en 2025 veremos una tendencia hacia una IA responsable y centrada en el ser humano. En medio de las crecientes preocupaciones sobre sesgos, desinformación y riesgos éticos, se prioriza la tecnología de inteligencia artificial transparente (XAI), que ayuda a los usuarios a comprender cómo la IA toma decisiones.

Varios países como Estados Unidos, Canadá, Australia, China, Japón, etc. han comenzado a adoptar regulaciones de IA para gestionar y garantizar una implementación ética de la IA en toda la industria.

Otra tendencia es la IA híbrida, un modelo que combina IA y humanos, que también podría desarrollarse en 2025.

En el desarrollo sostenible, la IA puede ayudar a abordar el cambio climático y promover la tecnología verde. Además, la IA ampliará sus aplicaciones en ciberseguridad, ayudando a mejorar la capacidad de analizar riesgos y responder a las amenazas en el espacio digital.

“A medida que se acelera la adopción de la IA, garantizar una gobernanza responsable de la misma es esencial para optimizar los beneficios de la tecnología y reducir los riesgos potenciales”, enfatizó el Dr. Goundar.

Soluciones de desarrollo de IA responsable

Vietnam es uno de los países que innova activamente en el campo de la IA. Por lo tanto, garantizar el desarrollo ético de una IA es importante para evitar algoritmos de IA sesgados, riesgos para la privacidad y pérdida de confianza pública.

Para desarrollar la IA de acuerdo con principios éticos, el Dr. Goundar propuso una serie de soluciones, como invertir en investigación sobre la ética de la IA y cooperar con las universidades para proporcionar un marco legal para la implementación responsable de la IA.

A continuación, se debería considerar integrar la ética de la IA en los programas universitarios y ampliar los programas de capacitación en IA para líderes empresariales, educadores y formuladores de políticas.

Promover la responsabilidad y la ética ayuda a que la IA se convierta en una herramienta útil para los humanos. Foto: Bloomberg. |

También es importante concienciar al público para ayudar a las personas y a las empresas a comprender el impacto de la IA en la privacidad. Además, podría fomentar la aplicación de la IA con fines sociales como la atención sanitaria, el medio ambiente y la educación, en lugar de centrarse únicamente en el lucro.

Además de la educación y la concientización, los marcos legales también juegan un papel importante en el sostenimiento del desarrollo responsable de la IA.

Los expertos de RMIT Vietnam propusieron una serie de soluciones, como aplicar regulaciones más estrictas sobre la IA, acercarse a los modelos internacionales de gobernanza de la IA, lanzar una certificación ética de la IA, así como construir un sistema de clasificación y auditoría de riesgos de la IA para evaluar y probar sistemas de alto riesgo.

“Si Vietnam aspira a convertirse en una potencia regional en IA para 2030, su éxito dependerá no solo del avance tecnológico, sino también de regulaciones sólidas, inversiones éticas en IA y concienciación pública para combatir los riesgos potenciales”, enfatizó el Dr. Goundar.

Fuente: https://znews.vn/xu-huong-ai-moi-cua-nam-2025-post1538816.html

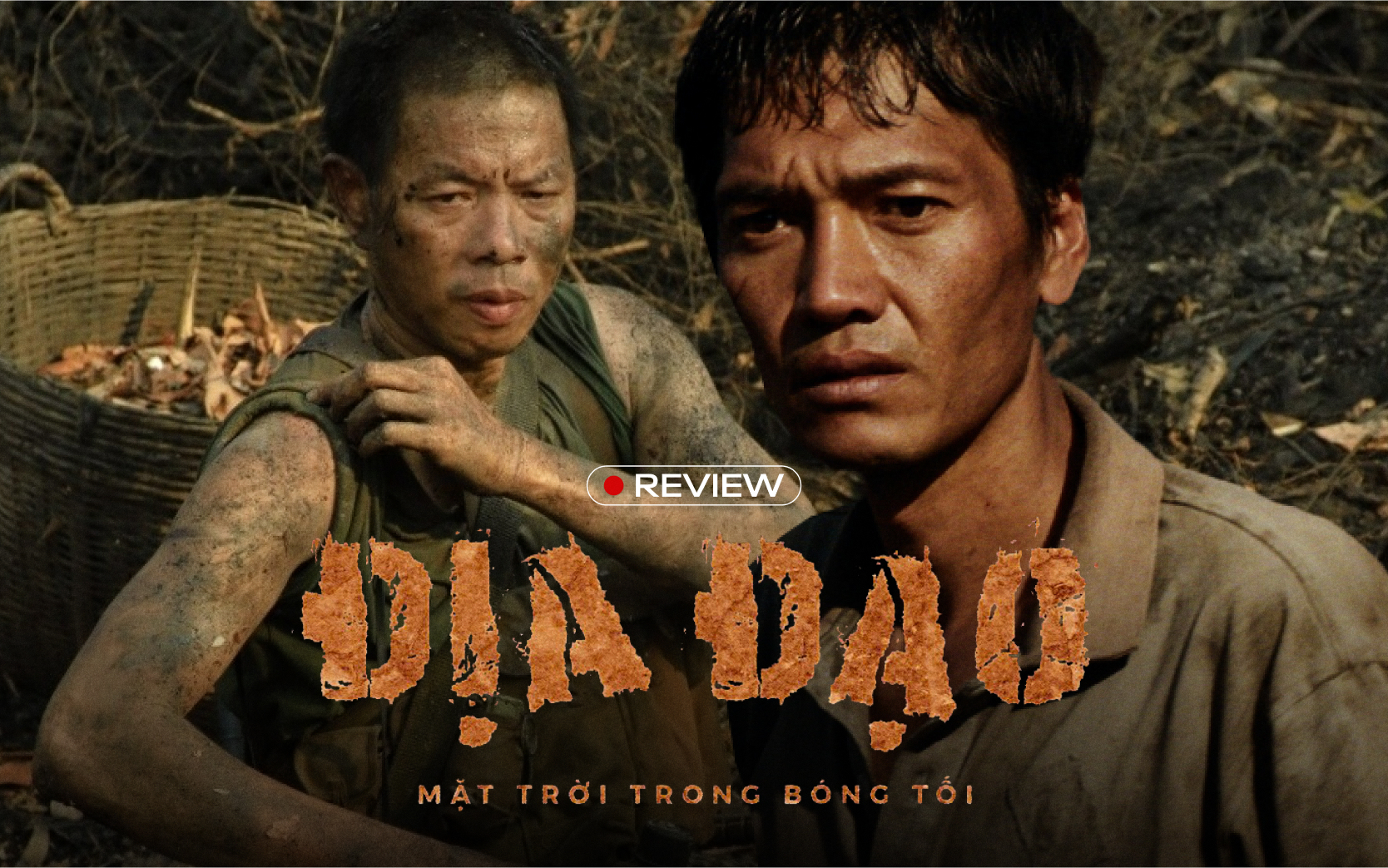

![[Foto] Visita a los túneles de Cu Chi: una heroica hazaña subterránea](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/8/06cb489403514b878768dd7262daba0b)

Kommentar (0)