Muchas de las herramientas de inteligencia artificial (IA) más populares del mundo funcionan con programas con prejuicios contra las mujeres, desarrollados por empresas como OpenAI y Meta. Así lo revela un nuevo estudio anunciado por la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (UNESCO) el 7 de marzo.

Las empresas más grandes en la carrera de la IA ahora están utilizando cantidades masivas de datos de Internet para entrenar algoritmos, conocidos como modelos de lenguaje grande (LLM). La UNESCO probó el algoritmo Llama 2 de Meta y los GPT-2 y GPT-3.5 de OpenAI utilizados en la popular aplicación de chat ChatGPT. Los resultados de las pruebas mostraron que cada uno de estos algoritmos mostraba evidencia clara de sesgo contra las mujeres.

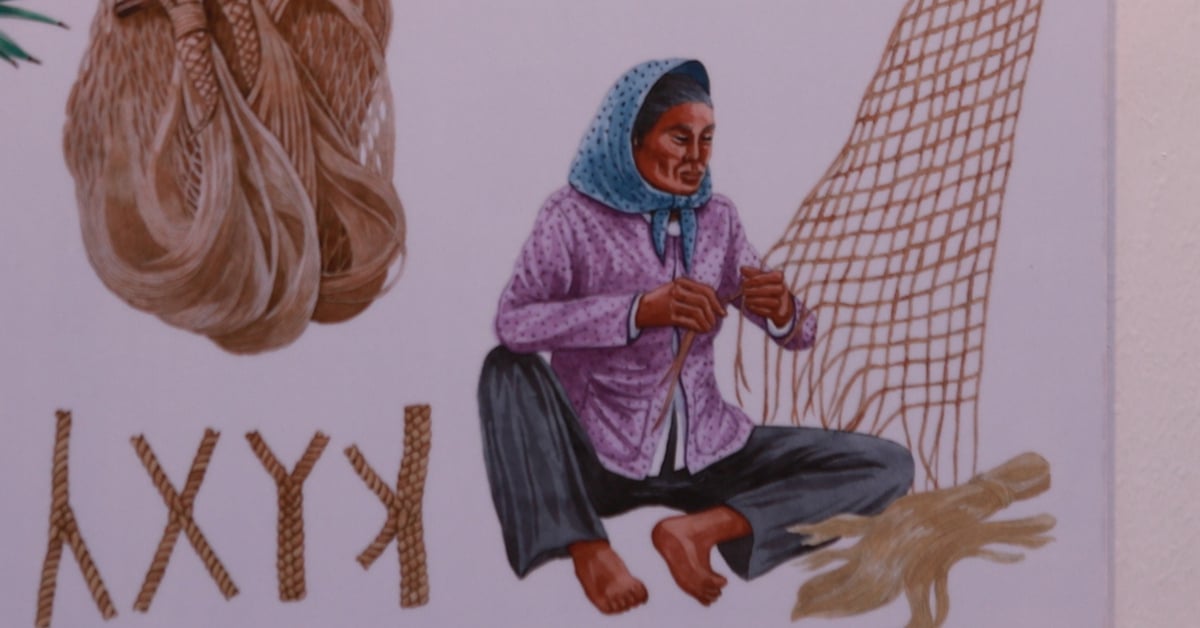

Los resultados mostraron que los textos relacionados con nombres femeninos generados por estas herramientas a menudo contenían palabras como “hogar”, “familia” o “hijos”, mientras que los textos relacionados con nombres masculinos a menudo contenían palabras como “negocio”, “salario” o “carrera”; A menudo se representa a los hombres con trabajos como profesores, abogados, médicos; A las mujeres se las asocia a menudo con trabajos como cocinar, tareas del hogar, etc.

HACER CAO

[anuncio_2]

Fuente

![[Foto] Temporada de moreras de Phuc Tho: una fruta dulce de la agricultura ecológica](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/1710a51d63c84a5a92de1b9b4caaf3e5)

![[Foto] El primer ministro Pham Minh Chinh preside una reunión para discutir soluciones fiscales para las importaciones y exportaciones de bienes de Vietnam.](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/19b9ed81ca2940b79fb8a0b9ccef539a)

![[Foto] Resumen de los ensayos del desfile en preparación para la celebración del 30 de abril](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/11/78cfee0f2cc045b387ff1a4362b5950f)

Kommentar (0)