Riesgos potenciales en la difusión de desinformación

La ciencia y la tecnología no sólo afectan la forma como la prensa y los medios transmiten sus mensajes e influyen e influyen en la forma y eficacia del acceso público, sino que también inciden profundamente en la calidad de la información.

De hecho, el periodismo ha sabido adaptarse rápidamente a la innovación tecnológica, especialmente en los últimos años. La inteligencia artificial (IA) se ha vuelto cada vez más popular en los medios de comunicación y en las salas de redacción. La adopción de IA ha beneficiado tanto a los periodistas como a las organizaciones de medios. Libera a los periodistas de las tediosas tareas cotidianas, ahorrándoles tiempo y permitiéndoles centrarse en un trabajo más creativo y que requiere más habilidades.

Si bien la IA tiene muchos beneficios, también plantea algunas preocupaciones. Uno de los riesgos más importantes es la posibilidad de que el contenido generado por IA difunda información errónea.

Las 10 principales agencias de noticias del mundo piden negociaciones colectivas y transparentes entre los medios de comunicación y los desarrolladores de IA para controlar qué material con derechos de autor se puede utilizar en el entrenamiento de herramientas de IA, así como para eliminar el sesgo en los algoritmos de IA.

La semana pasada, 10 de las principales agencias de noticias del mundo firmaron una carta pidiendo transparencia y leyes de derechos de autor claras dirigidas a la IA. Estas agencias de noticias argumentan que la IA tiene el potencial de “amenazar la sostenibilidad del ecosistema mediático” al erosionar significativamente la confianza de los lectores en la calidad e integridad de las noticias.

Según muchos estudios, la IA se puede utilizar para filtrar y seleccionar historias que tengan más probabilidades de atraer a los lectores y captar su atención, creando así un desequilibrio en las noticias que no existiría si las historias se presentaran de forma objetiva y producida por humanos. El público sólo está expuesto a un lado de la historia y, por lo tanto, puede verse sesgado por la información unilateral generada por IA. Además, la IA se puede utilizar para difundir información errónea y noticias falsas al público presentando historias falsas junto a las reales.

Además, la IA también puede ser engañada por noticias falsas. Los algoritmos de IA están diseñados para procesar datos de forma rápida y precisa, lo que significa que puede ser difícil distinguir entre noticias reales y falsas. Además, la IA es incapaz de comprender las implicaciones emocionales y éticas de las noticias que procesa. A medida que la IA se vuelve más avanzada, la vulnerabilidad a las noticias falsas aumentará, haciendo aún más difícil distinguir entre lo que es real y lo que es falso.

Según el Profesor Asociado Dr. Nguyen Ngoc Oanh, Jefe del Departamento de Relaciones Internacionales de la Academia de Periodismo y Comunicación, cuando la IA se vuelve poderosa, también es el momento en que debemos prestar especial atención y ser proactivos contra el riesgo de que los malos y las fuerzas hostiles utilicen la IA para difundir noticias tóxicas y falsas. Desde la perspectiva de la seguridad de los medios, esto presenta un riesgo potencial de desinformación, distorsión y noticias falsas. Una vez que la inteligencia artificial se aplica en el campo de la información, la tecnología puede ayudar a falsificar voces, imágenes, crear historias falsas y declaraciones que parezcan reales para engañar al público, especialmente en el espacio de las redes sociales.

Quienes tienen malas intenciones se aprovechan del rol y la reputación de la prensa para falsificar información, engañando al público con la información proporcionada y reflejada por la prensa. El desarrollo de noticias falsas se volverá más sofisticado y complejo, y por lo tanto, junto con una mayor vigilancia, los métodos para identificar, responder y gestionar las noticias falsas deben centrarse en la inversión en tecnología inteligente y su gestión sistemática. Es necesario mejorar la capacidad de gestión social y de las agencias de prensa para adaptarse a los cambios, comentó el profesor asociado Dr. Nguyen Ngoc Oanh.

La industria de las noticias debe encontrar formas de proteger su contenido creativo.

Desde el lanzamiento de ChatGPT en noviembre de 2022, se han implementado casi a diario nuevas aplicaciones basadas en la plataforma de IA generativa. Como resultado, Internet está lleno de contenido generado por IA. Junto con las cosas que sorprenden a la gente, también hay mucho contenido soso y repetitivo. Esto facilita la difusión de información errónea y también supone una mayor carga para la industria de los medios a la hora de intentar generar y restaurar la confianza de los lectores.

El periodista Nguyen Hoang Nhat, subdirector del periódico Vietnamplus, recordó las lecciones del pasado, cuando muchos expertos dijeron que uno de los primeros grandes errores de la prensa fue reaccionar demasiado lentamente a la importancia e invasión de las redes sociales. "Hemos dedicado mucho tiempo a publicar todo nuestro contenido en redes sociales, modificando nuestra esencia para servirles, algo que a veces no es nuestro punto fuerte ni lo que necesitan los lectores. En resumen, les hemos dado demasiado poder y hemos provocado que se vuelvan contra nosotros", declaró el periodista Nguyen Hoang Nhat.

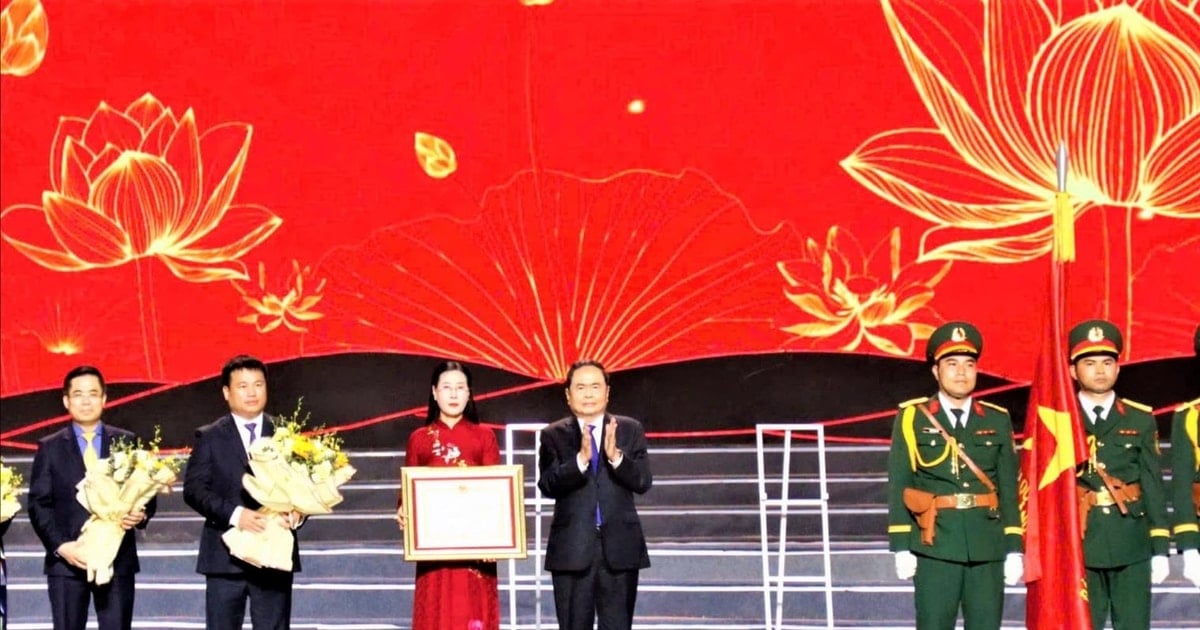

Durante los días en que la selección femenina de Vietnam competía en el Mundial, aparecieron en las redes sociales numerosas fuentes que difundían información distorsionada y fabricada. (Foto: VTC)

Al analizar la actual amenaza que supone la IA, el periodista Nguyen Hoang Nhat dijo que, en general, la IA ayuda a las salas de redacción a hacer su trabajo más rápido y ahorrar costes, pero hará que los editores y periodistas sean más indulgentes y contribuirá a difundir información falsa más rápidamente. "Por ejemplo, durante el reciente Mundial Femenino, el contenido falso sobre la selección femenina vietnamita se volvió terriblemente viral a través de memes creados con herramientas de inteligencia artificial, llevando la psicología general de un segmento de la audiencia a extremos extremos", puso como ejemplo el periodista Nguyen Hoang Nhat.

En el extranjero, News Guard publicó una estadística sorprendente: había 347 sitios de noticias que no se diferenciaban en nada de los sitios de noticias legítimos, pero estaban llenos de contenido generado por IA y promovían desinformación. Un estudio reciente del Instituto Tecnológico de Massachusetts (MIT) descubrió que las personas tienen más probabilidades de creer en información errónea generada por IA que en noticias falsas escritas por humanos.

Según el periodista Nguyen Hoang Nhat, esta realidad coloca a la industria de las noticias en una posición en la que debe encontrar formas de proteger su contenido creativo y su propiedad intelectual, pero tampoco puede darle la espalda a las comodidades que brinda la IA.

Al evaluar los desafíos en la honestidad de las noticias, el profesor asociado Dr. Nguyen Ngoc Oanh dijo que si bien Chat GPT tiene muchas características destacadas, al final, es solo una herramienta que los periodistas deben aprender a dominar, usarla para servir sus actividades laborales para crear obras y productos periodísticos de acuerdo con los principios de la profesión. La cuestión de verificar las fuentes de información de los reporteros y periodistas es extremadamente importante si no quieren "contribuir" a la difusión de información inexacta.

A través de muchos seminarios y debates sobre inteligencia artificial, una conclusión es que el riesgo de utilizar datos y noticias falsas en trabajos periodísticos es muy alto si la gestión de contenidos en la sala de redacción no puede seguir el ritmo del desarrollo de la tecnología digital. En el contexto de que el marco legal para el periodismo digital en Vietnam aún no se ha puesto al día con la realidad, los problemas legales, las amenazas a la seguridad de los medios, los casos de violación de derechos de autor y las controversias sobre la ética de la prensa y la responsabilidad social de la prensa al aplicar el periodismo automatizado... son los principales desafíos hoy en día.

Phan Hoa Giang

[anuncio_2]

Fuente

Kommentar (0)