Nachdem das Startup OpenAI Ende 2022 seine erste KI-Anwendung, ChatGPT, auf den Markt brachte, löste dies eine Welle des Wettbewerbs um die Entwicklung von KI-Anwendungen aus, insbesondere generativer KI, die viele Annehmlichkeiten in allen Lebensbereichen mit sich bringt. Dies bringt jedoch auch viele Risiken mit sich.

Verletzung der Privatsphäre

In den letzten Jahren haben viele Organisationen und Einzelpersonen Verluste erlitten, als Cyberkriminelle mithilfe von KI Videoclips erstellten, die die Bilder und Stimmen echter Menschen imitierten. Ein Beispiel ist der Deepfake-Trick.

Laut dem Ende November 2023 von Sumsub veröffentlichten Identity Fraud Report haben Deepfake-Betrugsfälle in den Jahren 2022 und 2023 weltweit um das Zehnfache zugenommen. Dies ist auch die Zeit der explosionsartigen Zunahme künstlicher KI-Anwendungen auf der Welt.

Status Labs kommentierte, dass Deepfake enorme Auswirkungen auf Kultur, Privatsphäre und den persönlichen Ruf habe. Ein Großteil der Nachrichten und der Aufmerksamkeit rund um Deepfakes konzentriert sich auf Pornovideos von Prominenten, Rachepornos, Desinformation, Fake News, Erpressung und Betrug. So wurde beispielsweise im Jahr 2019 ein Energieunternehmen in den USA um 243.000 US-Dollar betrogen, als ein Betrüger das Bild und die Stimme der Unternehmensleitung imitierte und die Mitarbeiter aufforderte, Geld an Partner zu überweisen.

Die Nachrichtenagentur Reuters sagte, dass im Jahr 2023 weltweit etwa 500.000 Deepfake-Inhalte in Video- und Sprachform über soziale Netzwerke geteilt wurden. Neben Deepfakes zum Spaß gibt es auch Tricks, die von Bösewichten entwickelt wurden, um die Community zu betrügen. Schätzungen zufolge verursachten Deepfake-Betrugsfälle weltweit im Jahr 2022 Schäden von bis zu 11 Millionen US-Dollar.

Viele Technologieexperten haben vor den negativen Auswirkungen der KI gewarnt, darunter geistige Eigentumsrechte und Authentizität sowie darüber hinaus Streitigkeiten über geistige Eigentumsrechte zwischen von KI geschaffenen „Werken“. Beispielsweise bittet eine Person eine KI-Anwendung, ein Bild mit einem bestimmten Thema zu zeichnen, eine andere Person bittet die KI jedoch ebenfalls, dasselbe zu tun, wodurch Bilder mit vielen Ähnlichkeiten entstehen.

Dadurch können leicht Eigentumsstreitigkeiten entstehen. Bis heute hat die Welt jedoch noch keine Entscheidung über die Anerkennung des Urheberrechts für KI-generierte Inhalte getroffen (Anerkennung des Urheberrechts für Einzelpersonen, die kreative KI bestellen, oder Unternehmen, die KI-Anwendungen entwickeln).

Ein von einer KI-Anwendung generiertes Bild

Schwierig, zwischen echt und falsch zu unterscheiden

Können KI-generierte Inhalte also gegen das Urheberrecht verstoßen? Technologisch gesehen werden KI-generierte Inhalte durch Algorithmen aus Daten synthetisiert, mit denen sie trainiert wurden. Diese Datenbanken werden von Entwicklern von KI-Anwendungen aus vielen Quellen zusammengetragen, hauptsächlich aus Wissensdatenbanken im Internet. Bei vielen dieser Werke liegt das Urheberrecht bei ihren Eigentümern.

Am 27. Dezember 2023 verklagte die New York Times (USA) OpenAI (mit ChatGPT) und Microsoft mit der Behauptung, dass Millionen ihrer Artikel zum Trainieren von KI-Chatbots und KI-Plattformen dieser beiden Unternehmen verwendet wurden. Die Belege zeigen, dass es Inhalte gibt, die von Chatbots auf Anfrage von Benutzern erstellt werden und die den Inhalten von Artikeln ähneln oder mit ihnen identisch sind. Diese Zeitung kann nicht ignorieren, wenn ihr „geistiges Eigentum“ von Unternehmen für Profitzwecke missbraucht wird.

Die New York Times ist die erste große US-Zeitung, die eine Urheberrechtsklage im Zusammenhang mit KI eingereicht hat. Es ist möglich, dass in naher Zukunft auch andere Zeitungen klagen werden, insbesondere nach dem Erfolg der New York Times.

Zuvor hatte OpenAI im Juli 2023 eine Urheberrechtslizenzvereinbarung mit der Nachrichtenagentur Associated Press und im Dezember 2023 mit Axel Springer – einem deutschen Verlag, dem die beiden Zeitungen Politico und Business Insider gehören – geschlossen.

Auch die Schauspielerin Sarah Silverman schloss sich im Juli 2023 mehreren Klagen an und beschuldigte Meta und OpenAI, ihre Memoiren als Trainingstext für KI-Programme zu verwenden. Viele Autoren zeigten sich zudem besorgt, als bekannt wurde, dass KI-Systeme Zehntausende Bücher in ihre Datenbank aufgenommen hatten, was zu Klagen von Autoren wie Jonathan Franzen und John Grisham führte.

Inzwischen hat auch der Fotodienst Getty Images ein KI-Unternehmen verklagt, weil es Bilder auf der Grundlage von Textaufforderungen erstellt und das urheberrechtlich geschützte Bildmaterial des Unternehmens unbefugt verwendet hat …

Benutzer können in Urheberrechtsprobleme geraten, wenn sie „leichtfertig“ „Werke“ verwenden, die sie von KI-Tools „zusammenstellen“ lassen. Experten empfehlen stets, KI-Tools nur zum Suchen, Sammeln von Daten und Erstellen von Vorschlägen ausschließlich als Referenz zu verwenden.

Ein weiteres Problem ist, dass KI-Anwendungen die Benutzer verwirren, wenn sie nicht zwischen Wahrheit und Falschheit bestimmter Inhalte unterscheiden können. Bei der Annahme von Manuskripten kann es für Verleger und Herausgeber zu Verwirrung kommen. Auch für Lehrer ist es schwierig herauszufinden, ob die Schüler in ihren Arbeiten KI einsetzen oder nicht.

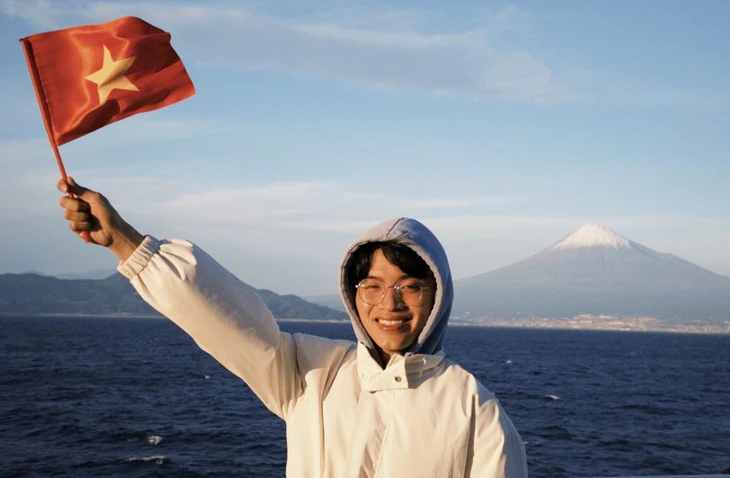

Die Community muss jetzt wachsamer sein, da sie nicht weiß, welche Inhalte echt und welche gefälscht sind. Beispielsweise wäre es für den Durchschnittsmenschen schwierig zu erkennen, ob ein Foto von einer KI „verzaubert“ oder bearbeitet wurde.

Gesetzliche Regelungen zum KI-Einsatz sind notwendig

Während sie auf Anwendungstools warten, die KI-Eingriffe erkennen können, müssen die Verwaltungsbehörden bald klare und spezifische gesetzliche Vorschriften für die Verwendung dieser Technologie zur Erstellung privater Inhalte erlassen. Gesetzliche Regelungen müssen den Menschen zeigen, dass in Inhalte und Werke durch KI eingegriffen wurde, beispielsweise durch die standardmäßige Vermerkung eines Wasserzeichens auf Bildern, die durch KI manipuliert wurden.

[Anzeige_2]

Quelle: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Foto] Eröffnung der 11. Konferenz des 13. Zentralkomitees der Partei](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/f9e717b67de343d7b687cb419c0829a2)

![[Foto] Aprilfest in Can Tho](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/bf5ae82870e648fabfbcc93a25b481ea)

![[Foto] Premierminister Pham Minh Chinh lobt die Streitkräfte, die Myanmar bei der Überwindung der Folgen des Erdbebens unterstützen](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/e844656d18bd433f913182fbc2f35ec2)

![[Foto] Wiedererleben der heroischen Erinnerungen der Nation im Programm „Hanoi – Wille und Glaube an den Sieg“](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/19ce7bfadf0a4a9d8e892f36f288e221)

Kommentar (0)