Der japanische Premierminister Fumio Kishida sagte, er werde der G7-Gruppe einen Plan zur Regulierung von Entwicklern künstlicher Intelligenz (KI) vorschlagen.

Ziel der Vorschriften ist es, die Verbreitung von Fehlinformationen zu verhindern, indem die Öffentlichkeit dafür sensibilisiert wird, zwischen von KI erstellten und nicht von Algorithmen generierten Bildern und Informationen zu unterscheiden.

Die Leitlinien sollen bereits im Herbst bei einem virtuellen Treffen der sieben größten Volkswirtschaften der Welt (G7) vorgeschlagen werden.

In dem Bericht heißt es, Japan sei besorgt über die komplexen Bilder und Informationen, die durch künstliche Intelligenz generiert würden, da diese die Öffentlichkeit verwirren und die wirtschaftliche Stabilität gefährden könnten.

Unterdessen erklärte die britische Datenschutzbehörde, dass KI-Chatbots ein Datenschutzrisiko für Kinder darstellen könnten. In diesem Fall handelt es sich um den Chatbot „My AI“, der vom US-Technologieunternehmen Snapchat entwickelt wurde.

Den Behörden zufolge hat Snapchat die Datenschutzrisiken für Kinder, die von dem KI-Chatbot ausgehen, den das Unternehmen im April auf den Markt gebracht hat, möglicherweise nicht richtig eingeschätzt. Das Information Commissioner’s Office (ICO) hat erklärt, dass das US-Unternehmen ein landesweites Verbot der KI-Anwendung in Erwägung ziehen werde, wenn es dem Unternehmen nicht gelinge, die Bedenken der Regulierungsbehörden ausreichend auszuräumen.

„Die ersten Ergebnisse der Untersuchung deuten darauf hin, dass Snap vor der Einführung der KI-Anwendung die Datenschutzrisiken für Kinder und andere Benutzer nicht vollständig und genau bewertet hat“, sagte der ICO-Vertreter.

Die Aussage der Regulierungsbehörde bedeutet jedoch nicht, dass Snapchat, eine in Großbritannien unter jungen Leuten weit verbreitete Messaging-App, gegen Datenschutzgesetze verstoßen hat.

Snap erklärte, dass das Unternehmen die ICO-Ankündigung prüfe und sich dem Schutz der Privatsphäre der Benutzer verpflichte. „Unsere KI durchläuft einen strengen Datenschutz- und Rechtsprüfungsprozess, bevor sie öffentlich zugänglich gemacht wird“, erklärte das US-Technologieunternehmen. „Wir werden weiterhin konstruktiv mit dem ICO zusammenarbeiten, um Bedenken hinsichtlich unserer Risikobewertungsprozesse auszuräumen.“

Das ICO untersucht, wie „My AI“ die persönlichen Daten von rund 21 Millionen Snapchat-Nutzern in Großbritannien verarbeitet hat, darunter Kinder im Alter von 13 bis 17 Jahren.

Die von Snapchat entwickelte App basiert auf ChatGPT von OpenAI – dem bekanntesten Beispiel generativer KI, die politische Entscheidungsträger weltweit aufgrund von Datenschutz- und Sicherheitsbedenken regulieren möchten.

Soziale Netzwerke wie Snapchat setzen voraus, dass ihre Benutzer mindestens 13 Jahre alt sind. Es gelingt ihnen jedoch nicht immer, minderjährige Kinder von der Nutzung ihrer Plattformen abzuhalten.

Zuvor hatte Reuters im August 2023 berichtet, dass die Regulierungsbehörde Informationen sammle, um festzustellen, ob die Messaging-App minderjährige Benutzer tatsächlich von ihrer Plattform entfernt.

(Laut Bloomberg, Reuters)

Meta nutzt Facebook- und Instagram-Benutzerdaten, um KI-Chatbots zu trainieren

Meta sagte, dass es die öffentlichen Facebook- und Instagram-Posts der Benutzer nutzt, um seinen neuen virtuellen Assistenten mit künstlicher Intelligenz (KI) zu trainieren, schließt jedoch Inhalte aus, die nur mit Familie und Freunden geteilt werden.

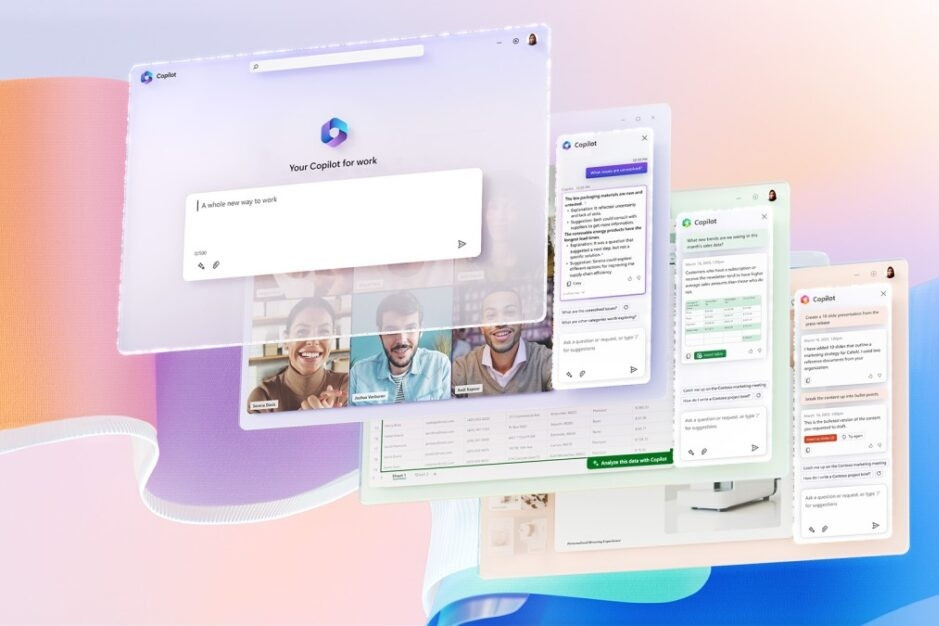

Microsoft bringt den KI-Chatbot-virtuellen Assistenten Copilot auf den Markt

Der virtuelle Assistent Microsoft Copilot wird unter Windows 11, Microsoft 365, im Edge-Browser und der Bing-Suchmaschine verfügbar sein.

Drei neue Funktionen für Googles KI-Chatbot Bard

Zu den neuen Funktionen von Google Bard gehören die Überprüfung der Antwortgenauigkeit, der Import von Benutzerdaten zwischen Apps und das Einladen anderer zum Chatten mit Chatbots.

[Anzeige_2]

Quelle

Kommentar (0)