อันตรายของการสูญเสียการควบคุม AI

ดูเหมือนว่ามนุษยชาติจะเพิกเฉยต่อผีบางอย่างที่อยู่บนขอบฟ้า มันคือภัยคุกคามของสงครามนิวเคลียร์ระดับโลกที่เกิดจากปัญญาประดิษฐ์ (AI) นายอันโตนิโอ กูเตอร์เรส เลขาธิการสหประชาชาติ ออกมาเตือนเกี่ยวกับเรื่องดังกล่าว แต่จนถึงขณะนี้ ประเทศที่มีอาวุธนิวเคลียร์ยังไม่สามารถร่วมมือกันเจรจาเกี่ยวกับภัยคุกคามร้ายแรงนี้ได้

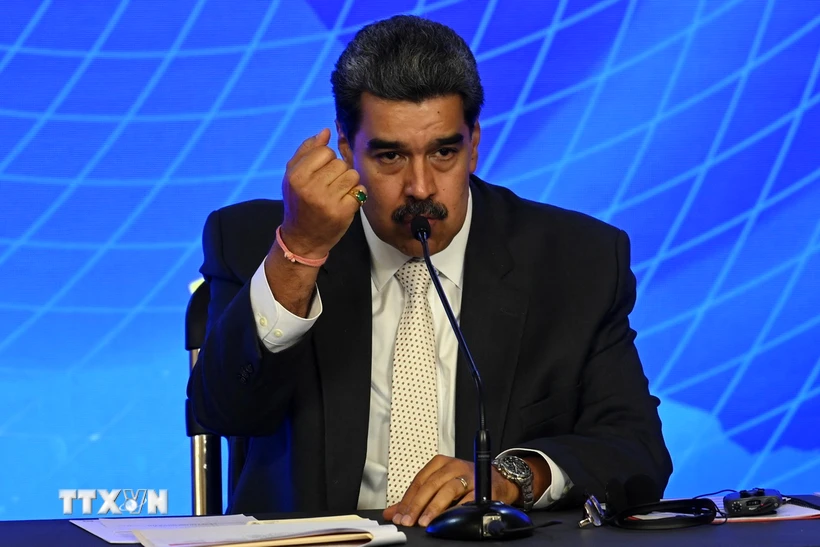

การพัฒนาอย่างรวดเร็วของปัญญาประดิษฐ์ (AI) เพิ่มความเสี่ยงที่ AI อาจแทรกแซงกระบวนการการยิงอาวุธนิวเคลียร์ ภาพประกอบ

มานานแล้วที่มหาอำนาจด้านนิวเคลียร์ทั้ง 5 ประเทศ ได้แก่ สหรัฐอเมริกา รัสเซีย จีน สหราชอาณาจักร และฝรั่งเศส ได้มีฉันทามติร่วมกันอย่างไม่เป็นทางการเกี่ยวกับหลักการ "มนุษย์อยู่ในการควบคุม" ซึ่งหมายความว่าแต่ละประเทศมีระบบที่จะรับรองว่ามนุษย์มีส่วนเกี่ยวข้องในการตัดสินใจยิงอาวุธนิวเคลียร์

ทั้งห้ามหาอำนาจไม่มีใครบอกว่าพวกเขาใช้ AI ในระบบสั่งการยิงอาวุธนิวเคลียร์ของตน ตามที่ดร. Sundeep Waslekar ประธาน Strategic Foresight Group ซึ่งเป็นองค์กรวิจัยระดับนานาชาติในเมืองมุมไบ (ประเทศอินเดีย) กล่าวไว้ว่าเรื่องนี้เป็นเรื่องจริง แต่เป็นการเข้าใจผิด

ปัจจุบัน AI ถูกนำมาใช้ในการตรวจจับภัยคุกคามและเลือกเป้าหมายแล้ว ระบบที่ขับเคลื่อนด้วย AI วิเคราะห์ข้อมูลจำนวนมหาศาลจากเซ็นเซอร์ ดาวเทียม และเรดาร์แบบเรียลไทม์ วิเคราะห์การโจมตีขีปนาวุธที่เข้ามา และแนะนำทางเลือกในการตอบสนอง

จากนั้นผู้ปฏิบัติการจะตรวจสอบภัยคุกคามจากแหล่งต่างๆ และตัดสินใจว่าจะสกัดกั้นขีปนาวุธของศัตรูหรือเปิดฉากโจมตีตอบโต้

“ปัจจุบัน เวลาตอบสนองที่ผู้ให้บริการสามารถรับได้คือ 10 ถึง 15 นาที ภายในปี 2030 เวลาตอบสนองจะลดลงเหลือ 5 ถึง 7 นาที” Sundeep Waslekar กล่าว “แม้ว่ามนุษย์จะเป็นผู้ตัดสินใจขั้นสุดท้าย แต่พวกเขาจะได้รับอิทธิพลจากการวิเคราะห์เชิงคาดการณ์และเชิงกำหนดของ AI AI อาจเป็นแรงผลักดันเบื้องหลังการตัดสินใจเปิดตัวได้เร็วที่สุดในช่วงทศวรรษ 2030”

ปัญหาคือ AI สามารถทำผิดพลาดได้ อัลกอริธึมการตรวจจับภัยคุกคามสามารถระบุการโจมตีด้วยขีปนาวุธได้เมื่อไม่มีการโจมตีเกิดขึ้น อาจเกิดจากข้อผิดพลาดของคอมพิวเตอร์ การบุกรุกเครือข่าย หรือปัจจัยสภาพแวดล้อมที่บดบังสัญญาณ หากผู้ปฏิบัติงานไม่ยืนยันสัญญาณเตือนภัยเท็จจากแหล่งอื่นภายใน 2 ถึง 3 นาที พวกเขาอาจก่อให้เกิดการโจมตีตอบโต้

ข้อผิดพลาดเล็กน้อยแต่เป็นหายนะครั้งใหญ่

การใช้ AI ในการทำงานด้านพลเรือนหลายอย่าง เช่น การคาดการณ์อาชญากรรม การจดจำใบหน้า และการพยากรณ์โรคมะเร็ง พบว่ามีค่าความคลาดเคลื่อนอยู่ที่ 10% ตามที่นาย Sundeep Waslekar กล่าว ในระบบเตือนภัยล่วงหน้าทางนิวเคลียร์ ขอบเขตของข้อผิดพลาดอาจอยู่ที่ประมาณ 5%

เมื่อความแม่นยำของอัลกอริทึมการจดจำภาพได้รับการปรับปรุงในทศวรรษหน้า ขอบเขตข้อผิดพลาดดังกล่าวอาจลดลงเหลือ 1-2% แต่แม้ความคลาดเคลื่อนเพียง 1% ก็อาจทำให้เกิดสงครามนิวเคลียร์ทั่วโลกได้

การตัดสินใจโจมตีหรือการตอบโต้ด้วยอาวุธนิวเคลียร์อาจเกิดจากข้อผิดพลาดของ AI ภาพ: สถาบันสงครามสมัยใหม่

ความเสี่ยงอาจเพิ่มขึ้นในอีกสองถึงสามปีข้างหน้าเนื่องจากมีมัลแวร์ใหม่ๆ เกิดขึ้นและสามารถหลีกเลี่ยงระบบตรวจจับภัยคุกคามได้ มัลแวร์จะปรับตัวเพื่อหลีกเลี่ยงการตรวจจับ โดยระบุเป้าหมายโดยอัตโนมัติและโจมตีพวกเขาโดยอัตโนมัติ

มีสถานการณ์ “การเผชิญหน้าอย่างสูสี” หลายครั้งในช่วงสงครามเย็น ในปีพ.ศ.2526 ดาวเทียมของสหภาพโซเวียตตรวจพบขีปนาวุธ 5 ลูกที่ถูกสหรัฐฯ ยิงผิดพลาด สตานิสลาฟ เปตรอฟ เจ้าหน้าที่จากศูนย์บัญชาการเซปูคอฟ-15 ของรัสเซีย สรุปว่าเป็นการแจ้งเตือนภัยเท็จ และไม่ได้แจ้งให้ผู้บังคับบัญชาทราบ เพื่อที่พวกเขาจะได้เปิดการโจมตีตอบโต้

ในปีพ.ศ. 2538 สถานีเรดาร์ Olenegorsk ตรวจพบการโจมตีด้วยขีปนาวุธนอกชายฝั่งนอร์เวย์ กองกำลังยุทธศาสตร์ของรัสเซียถูกจัดให้อยู่ในสถานะเตรียมพร้อมสูงสุด และประธานาธิบดีบอริส เยลต์ซินแห่งรัสเซียในขณะนั้นก็ได้รับมอบกระเป๋าเอกสารเกี่ยวกับนิวเคลียร์ เขาสงสัยว่ามันเป็นความผิดพลาดจึงไม่ได้กดปุ่ม ปรากฎว่ามันเป็นจรวดวิทยาศาสตร์ หากใช้ AI ในการกำหนดการตอบสนองในทั้งสองสถานการณ์ ผลที่ตามมาอาจเลวร้ายได้

ในปัจจุบันขีปนาวุธความเร็วเหนือเสียงใช้ระบบอัตโนมัติแบบเดิมแทน AI พวกมันสามารถเดินทางด้วยความเร็วตั้งแต่มัค 5 ถึงมัค 25 โดยหลีกเลี่ยงการตรวจจับของเรดาร์และควบคุมเส้นทางการบินได้ มหาอำนาจกำลังวางแผนที่จะปรับปรุงขีปนาวุธความเร็วเหนือเสียงด้วย AI เพื่อค้นหาและทำลายเป้าหมายที่เคลื่อนที่ได้ในทันที โดยเปลี่ยนการตัดสินใจในการสังหารจากมนุษย์มาเป็นเครื่องจักรแทน

ยังมีการแข่งขันในการพัฒนาปัญญาประดิษฐ์ทั่วไป ซึ่งอาจนำไปสู่โมเดล AI ที่ทำงานนอกเหนือการควบคุมของมนุษย์ เมื่อสิ่งนี้เกิดขึ้น ระบบ AI จะเรียนรู้ที่จะปรับปรุงและจำลองตัวเอง โดยเข้ามาควบคุมกระบวนการตัดสินใจ เมื่อ AI ดังกล่าวถูกผสานเข้าในระบบสนับสนุนการตัดสินใจสำหรับอาวุธนิวเคลียร์ เครื่องจักรก็จะสามารถเริ่มสงครามอันเลวร้ายได้

ถึงเวลาที่จะต้องดำเนินการ

เมื่อเผชิญกับความเสี่ยงดังกล่าว ผู้เชี่ยวชาญหลายคนเชื่อว่ามนุษยชาติจำเป็นต้องมีข้อตกลงที่ครอบคลุมระหว่างประเทศมหาอำนาจเพื่อลดความเสี่ยงของสงครามนิวเคลียร์ โดยถือเป็นมากกว่าการพูดซ้ำๆ ถึงสโลแกนว่า “มนุษย์อยู่ในวงจร”

ข้อตกลงนี้จะต้องรวมถึงมาตรการเพื่อความโปร่งใส ความรับผิดชอบ และความร่วมมือ มาตรฐานสากลสำหรับการทดสอบและประเมินผล ช่องทางการสื่อสารในภาวะวิกฤต; คณะกรรมการกำกับดูแลระดับชาติ และกฎเกณฑ์เพื่อห้ามไม่ให้มีโมเดล AI แบบก้าวร้าวที่สามารถหลบเลี่ยงผู้ปฏิบัติการที่เป็นมนุษย์ได้

เลขาธิการสหประชาชาติ อันโตนิโอ กูเตอร์เรส เข้าร่วมพิธีรำลึกสันติภาพในเมืองฮิโรชิม่า ซึ่งถูกระเบิดปรมาณูโจมตีในปี 2488 ภาพ: UN

การเปลี่ยนแปลงทางภูมิรัฐศาสตร์กำลังสร้างโอกาสสำหรับสนธิสัญญาประเภทนี้ ตัวอย่างเช่น ผู้เชี่ยวชาญด้าน AI ชั้นนำจากจีนและสหรัฐฯ ได้ร่วมกันหารือในหัวข้อที่สองเกี่ยวกับความเสี่ยงของ AI ซึ่งนำไปสู่แถลงการณ์ร่วมกันของอดีตประธานาธิบดีสหรัฐฯ โจ ไบเดน และประธานาธิบดีจีนสีจิ้นผิง เมื่อเดือนพฤศจิกายนที่ผ่านมา

ดร. Sundeep Waslekar กล่าวว่า มหาเศรษฐี Elon Musk เป็นผู้สนับสนุนอย่างแข็งขันถึงความจำเป็นในการช่วยมนุษยชาติจากความเสี่ยงต่อการดำรงอยู่ที่เกิดจาก AI นายมัสก์อาจเรียกร้องให้ประธานาธิบดีโดนัลด์ ทรัมป์ของสหรัฐฯ ในปัจจุบันเปลี่ยนแถลงการณ์ร่วมระหว่างนายโจ ไบเดนและนายสีจิ้นผิงให้กลายเป็นสนธิสัญญา

ความท้าทายด้าน AI นิวเคลียร์ยังต้องอาศัยการมีส่วนร่วมของรัสเซียอีกด้วย ตามที่ดร. Sundeep Waslekar กล่าว จนกระทั่งเดือนมกราคมปีนี้ รัสเซียปฏิเสธที่จะหารือเกี่ยวกับมาตรการลดความเสี่ยงด้านนิวเคลียร์ใดๆ รวมถึงการผสานกับ AI เว้นแต่ประเด็นยูเครนจะถูกนำมาหารือ

ด้วยการที่ประธานาธิบดีโดนัลด์ ทรัมป์กำลังเจรจากับประธานาธิบดีรัสเซีย วลาดิมีร์ ปูติน เพื่อปรับปรุงความสัมพันธ์ทวิภาคีและยุติสงครามในยูเครน รัสเซียอาจเปิดใจสำหรับการหารือแล้ว

ในเดือนกุมภาพันธ์ปีนี้ ภายหลังจากที่รองประธานาธิบดีสหรัฐฯ เจ ดี แวนซ์ ได้กล่าวสุนทรพจน์ในงาน Paris AI Action Summit ศูนย์เพื่อความมั่นคงอเมริกันยุคใหม่ (CNAS) ก็ได้เผยแพร่รายงานที่มีชื่อว่า "การป้องกันวันสิ้นโลกของ AI: การแข่งขันระหว่างสหรัฐฯ จีน และรัสเซียในจุดเชื่อมโยงระหว่างอาวุธนิวเคลียร์และปัญญาประดิษฐ์"

รายงานระบุถึงความเสี่ยงที่สำคัญที่สุดของความสัมพันธ์ระหว่าง AI กับนิวเคลียร์ และเรียกร้องให้รัฐบาลสหรัฐฯ จัดตั้งกลไกการบรรเทาความเสี่ยงและการจัดการวิกฤตที่ครอบคลุมร่วมกับจีนและรัสเซีย

ก่อนหน้านี้เมื่อเดือนกันยายนปีที่แล้ว มีประเทศต่างๆ ประมาณ 60 ประเทศ รวมทั้งสหรัฐอเมริกา ได้นำ "แผนปฏิบัติการ" มาใช้เพื่อจัดการการใช้งาน AI อย่างมีความรับผิดชอบในกองทัพ ณ การประชุมสุดยอด Responsible AI in Military (REAIM) ที่จัดขึ้นที่กรุงโซล ประเทศเกาหลีใต้ นี่คือการประชุมครั้งที่สองของประเภทนี้ โดยจัดขึ้นที่กรุงเฮกเมื่อปีที่แล้ว การเคลื่อนไหวเหล่านี้แสดงให้เห็นว่าความเสี่ยงของสงครามนิวเคลียร์ที่เริ่มต้นโดย AI ไม่ใช่เรื่องนิยายวิทยาศาสตร์

โลกกำลังเผชิญกับปัญหาด้านการดำรงอยู่อย่างเร่งด่วนที่เพิ่มมากขึ้นอย่างชัดเจน ซึ่งต้องการการดำเนินการจริงจากมหาอำนาจด้านนิวเคลียร์ เพื่อให้แน่ใจว่า “การตัดสินใจทุกครั้งเกี่ยวกับการใช้อาวุธนิวเคลียร์จะทำโดยมนุษย์ ไม่ใช่เครื่องจักรหรืออัลกอริทึม” ดังที่นายอันโตนิโอ กูเตอร์เรส เลขาธิการสหประชาชาติ เรียกร้อง

เหงียนคานห์

![[ภาพ] หนังสือพิมพ์หนานดานเฉลิมฉลองครบรอบ 94 ปีการก่อตั้งสหภาพเยาวชนคอมมิวนิสต์โฮจิมินห์](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/5571705682934ac5be5014ce171facb4)

![[ภาพ] เลขาธิการ ท.ลัม เป็นประธานการประชุมคณะกรรมการบริหารกลางว่าด้วยการป้องกันและปราบปรามการทุจริต การสูญเปล่า และความคิดด้านลบ](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/839ea9ed0cd8400a8ba1c1ce0728b2be)

![[ภาพ] รมว.กลาโหมเป็นประธานตรวจเยี่ยมการฝึกสวนสนามและเดินขบวน](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/35c2dd58a3e840d3a8cd615e70e89039)

การแสดงความคิดเห็น (0)