В мае 2024 года всемирно известные технологические гиганты один за другим выпустили новые версии искусственного интеллекта (ИИ), такие как OpenAI с GPT-4o, Google с Gemini 1.5 Pro... со множеством «суперумных» функций, добавленных для оптимизации пользовательского опыта. Однако нельзя отрицать, что эта технология используется киберпреступниками во многих сценариях интернет-мошенничества.

Риск увеличивается

Выступая на недавней конференции, заместитель министра информации и коммуникаций Фам Дык Лонг отметил тот факт, что кибератаки постоянно растут, становясь все более изощренными и сложными. Особенно при наличии поддержки ИИ риски, с которыми сталкиваются пользователи, возрастут в геометрической прогрессии. «Технологии искусственного интеллекта используются киберпреступниками для легкого создания новых вредоносных программ, новых и сложных фишинговых атак...» - предупредил заместитель министра Фам Дык Лонг.

По данным отчета Департамента информационной безопасности Министерства информации и коммуникаций, риски кибербезопасности, связанные с ИИ, нанесли ущерб более чем на 1 триллион долларов США по всему миру, из которых 8 000–10 000 миллиардов донгов приходится только на Вьетнам. Наиболее распространенным сегодня является использование ИИ для подделки голосов и лиц в целях мошенничества. Прогнозируется, что к 2025 году будет происходить около 3000 атак в секунду, появляться 12 вредоносных программ в секунду и 70 новых уязвимостей и слабых мест в день.

По словам г-на Нгуена Хыу Зиапа, директора компании BShield, специализирующейся на поддержке безопасности приложений, создание поддельных изображений и голосов не представляет сложности благодаря развитию искусственного интеллекта. Мошенники могут легко собирать данные пользователей из общедоступной информации, которую они публикуют в социальных сетях, или с помощью таких уловок, как онлайн-собеседования и телефонные звонки от имени «органов власти». В ходе симуляции, проведенной BShield, мошенник может поместить лицо, полученное по видеозвонку, на бумагу CCCD, объединить его с телом движущегося человека, чтобы обмануть инструмент eKYC и быть распознанным системой как реальный человек.

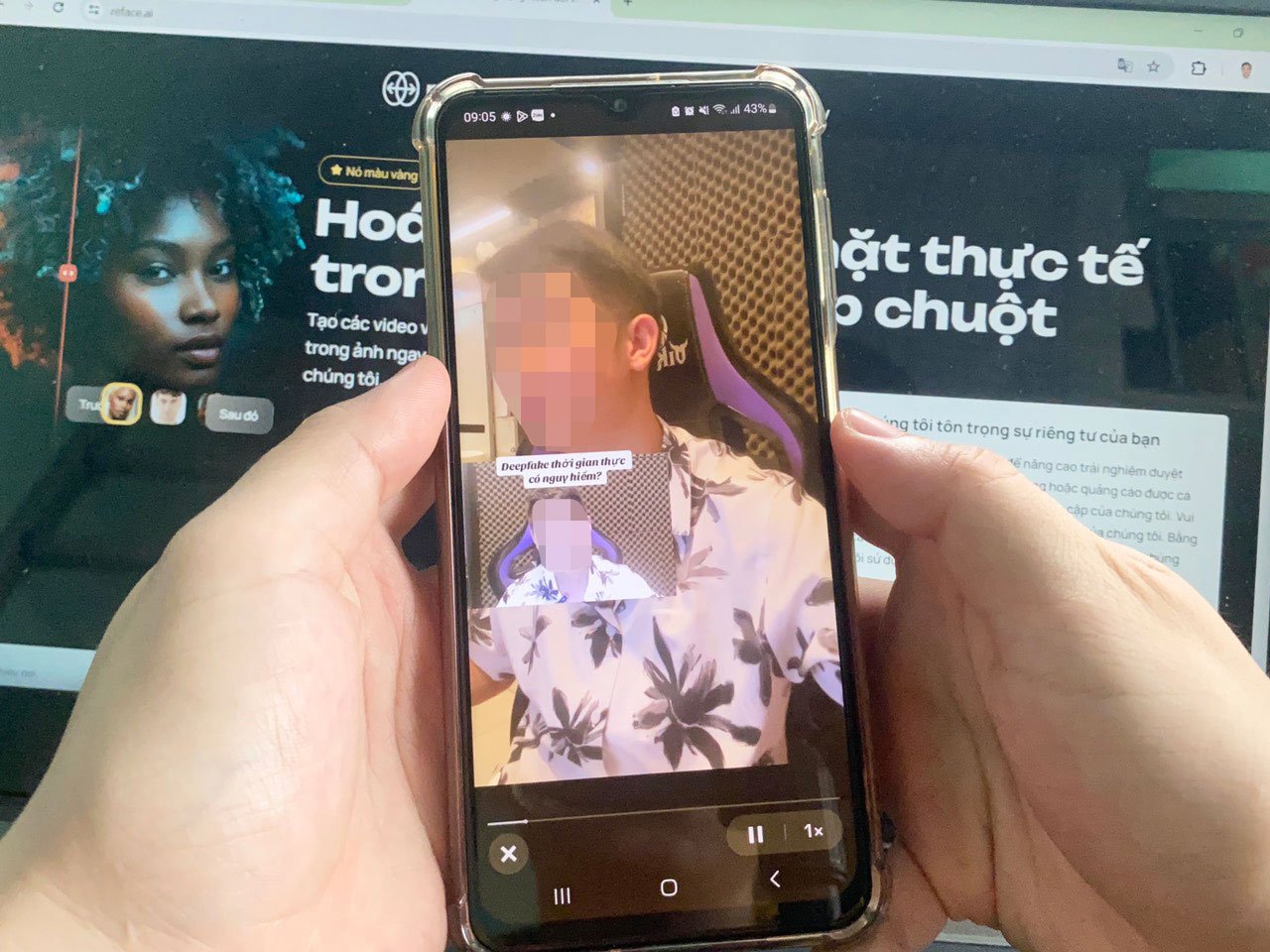

Методы мошенничества с использованием технологии deepfake становятся все более разнообразными и изощренными. Фото: ЛЕ ТИНЬ

С точки зрения пользователя, г-н Нгуен Тхань Трунг, ИТ-специалист из Хошимина, обеспокоен тем, что злоумышленники могут воспользоваться chatGPT для создания мошеннических писем с содержанием и стилем написания, аналогичными реальным письмам от банков или авторитетных организаций. К этим письмам, скорее всего, прикреплено вредоносное ПО, если пользователи нажмут на него, их данные определенно будут украдены, а активы — присвоены. «Программное обеспечение ИИ постоянно совершенствуется, оно может создавать поддельные видеоролики с лицами и голосами, которые на 95% похожи на реальных людей, жесты меняются в реальном времени, что значительно затрудняет обнаружение подделки зрителями», - сказал г-н Трунг.

Скоро будет готов юридический коридор

Чтобы ограничить риск мошенничества с использованием высоких технологий, эксперт по безопасности Фам Динь Тханг отметил, что пользователям необходимо регулярно обновлять свои знания об ИИ и не переходить по ссылкам неизвестного происхождения. Для предприятий необходимо выделить бюджет на обеспечение безопасности данных и работы системы. Сотрудники предприятий также должны пройти углубленную подготовку, чтобы иметь возможность выявлять реальные уязвимости, возникающие в системе, что повысит их способность определять типы кибератак.

Г-н Та Конг Сон, руководитель отдела разработки искусственного интеллекта проекта по борьбе с мошенничеством, отметил, что искусственный интеллект глубоко проникает в жизнь пользователей и деятельность предприятий, агентств и подразделений благодаря своим чрезвычайно интеллектуальным функциям поддержки. Примечательно, что в настоящее время технология ИИ очень доступна и проста в использовании, что создает условия для злоумышленников, которые смогут легко воспользоваться ею в мошеннических целях. «Мошенники также постоянно меняют методы своих атак, пользователям следует регулярно обновлять информацию, чтобы знать, как это предотвратить», - порекомендовал г-н Сон.

По мнению экспертов, недавно модернизированные модели GPT-4o и Gemini 1.5 Pro... доказали, что интеллект ИИ не имеет границ. Таким образом, помимо поощрения предприятий к разработке инструментов и решений по борьбе с мошенничеством на основе ИИ, органам управления необходимо как можно скорее завершить формирование правового коридора в отношении ИИ, чтобы оставаться впереди тенденций.

Подполковник Нгуен Ань Туан, заместитель директора Национального центра демографических данных, заявил, что необходимо в ближайшее время выпустить документы, регламентирующие этику и ответственность отечественных и зарубежных поставщиков услуг в процессе разработки, производства, применения и использования ИИ. В то же время необходимы конкретные правила в отношении технических стандартов для систем, которые используют, применяют, подключают и предоставляют услуги ИИ. «Необходимо исследовать и применять проекты ИИ для борьбы с рисками ИИ. Поскольку ИИ создается людьми, является продуктом знаний, будут существовать вариации «хорошего ИИ» и «плохого ИИ», поэтому можно предотвратить развитие искусственного интеллекта с помощью самого искусственного интеллекта», - отметил полковник Туан.

Проблемы кибербезопасности

Подполковник Нгуен Ань Туан признал, что ИИ создает проблемы для кибербезопасности. Соответственно, вредоносное ПО, поддерживаемое ИИ, может быть установлено в файлах документов. Когда пользователи загружают файлы документов, эта вредоносная программа проникает в систему. Кроме того, с помощью специальных технологий искусственного интеллекта хакеры могут имитировать системы и атаковать уязвимости безопасности. ИИ может создавать множество приложений с поддельными изображениями и названиями приложений и веб-сайтов Министерства общественной безопасности, чтобы люди могли их загружать, устанавливать и предоставлять такую информацию, как номер удостоверения личности и пароль для входа. «ИИ также разработает собственное программное обеспечение и гибридные вредоносные программы с более сложными механизмами обхода защиты и гибкими изменениями исходного кода», — предупредил подполковник Нгуен Ань Туан.

Источник: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[Фото] Посещение туннелей Ку Чи — героический подземный подвиг](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/8/06cb489403514b878768dd7262daba0b)

Комментарий (0)