|

OpenAI의 챗봇은 새로운 기술을 통해 끊임없이 개선되고 있습니다. 사진: 뉴욕타임스 . |

2024년 9월, OpenAI는 o1 모델을 통합한 ChatGPT 버전을 출시했습니다. 이 모델은 수학, 과학, 컴퓨터 프로그래밍과 관련된 작업에 대해 추론할 수 있습니다.

이전 버전의 ChatGPT와 달리 새로운 기술은 응답을 제공하기 전에 복잡한 문제에 대한 솔루션을 "생각"하는 데 시간이 걸립니다.

OpenAI에 이어 Google, Anthropic, DeepSeek 등 많은 경쟁사들도 비슷한 추론 모델을 도입했습니다. 완벽하지는 않지만 여전히 많은 개발자가 신뢰하는 챗봇 업그레이드 기술입니다.

AI 추론 방법

기본적으로 추론은 챗봇이 사용자가 제시한 문제를 해결하는 데 더 많은 시간을 할애할 수 있다는 것을 의미합니다.

캘리포니아 대학교 버클리 캠퍼스의 컴퓨터 과학 교수인 댄 클라인은 뉴욕 타임스와의 인터뷰에서 "추론은 시스템이 질문을 받은 후 더 많은 작업을 수행하는 방법입니다."라고 말했습니다.

추론 시스템은 문제를 개별 단계로 분해하거나 시행착오를 통해 해결할 수 있습니다.

ChatGPT가 처음 출시되었을 당시, 정보를 추출하고 종합하여 질문에 즉시 답변할 수 있었습니다. 그 사이, 추론 시스템이 문제를 해결하고 대응하는 데는 몇 초(혹은 몇 분) 더 시간이 필요합니다.

|

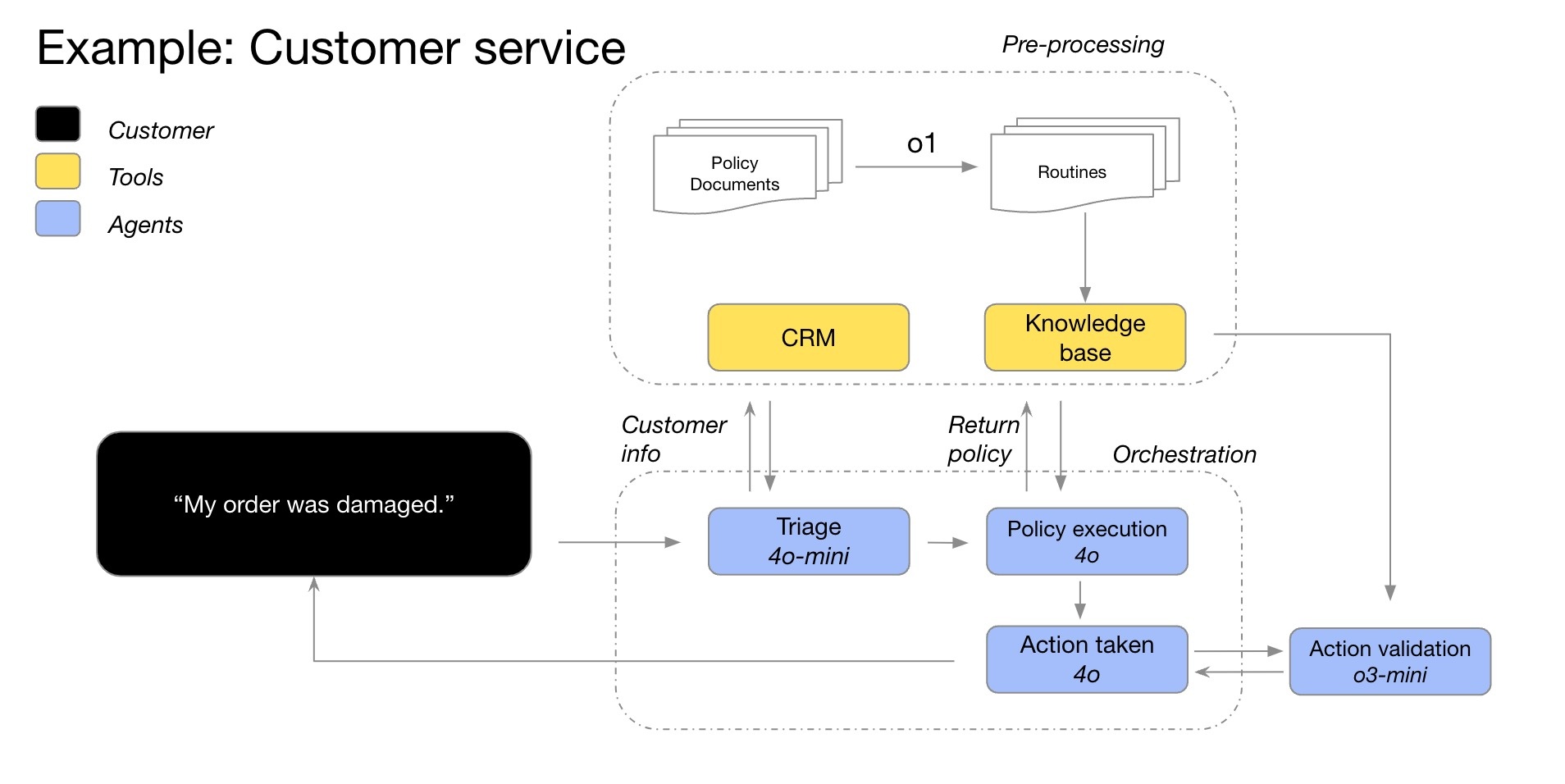

고객 케어 챗봇의 o1 모델 추론 과정의 예. 사진: OpenAI . |

어떤 경우에는 추론 시스템이 문제에 대한 접근 방식을 바꾸어 해결책을 지속적으로 개선합니다. 또한, 모델은 최적의 선택을 하기 전에 여러 솔루션을 테스트하거나 이전 응답의 정확성을 확인할 수 있습니다.

일반적으로 추론 시스템은 질문에 대답할 수 있는 모든 가능한 방법을 고려합니다. 이것은 마치 초등학교 학생들이 수학 문제를 푸는 데 가장 적합한 방법을 선택하기 전에 종이에 많은 선택 사항을 적는 것과 같습니다.

뉴욕 타임스 에 따르면 AI는 이제 모든 주제에 대해 추론할 수 있다고 합니다. 그러나 이 과제는 수학, 과학, 컴퓨터 프로그래밍과 관련된 문제를 풀 때 가장 효과적일 것입니다.

이론적 시스템은 어떻게 훈련되나요?

일반적인 챗봇에서도 사용자는 프로세스에 대한 설명을 요청하거나 답변의 정확성을 확인할 수 있습니다. 실제로, 많은 ChatGPT 훈련 데이터 세트에는 이미 문제 해결 절차가 포함되어 있습니다.

사용자의 요청 없이도 작업을 수행할 수 있는 추론 시스템은 훨씬 더 발전했습니다. 이 과정은 더 복잡하고 광범위합니다. 기업들이 '추론'이라는 단어를 사용하는 이유는 시스템이 인간의 생각 방식과 유사하게 작동하기 때문입니다.

OpenAI와 같은 많은 회사는 오늘날 챗봇을 개선하는 가장 좋은 솔루션은 추론 시스템이 될 것으로 기대합니다. 수년간 그들은 챗봇이 가능한 한 인터넷에서 많은 정보를 바탕으로 훈련되면 더 잘 작동할 것이라고 믿었습니다.

2024년이 되면 AI 시스템은 인터넷에 있는 텍스트를 거의 모두 소비하게 될 것입니다. 즉, 기업은 추론 시스템을 포함하여 채팅봇을 업그레이드하기 위한 새로운 솔루션을 찾아야 합니다.

|

스타트업 DeepSeek은 OpenAI보다 비용이 저렴한 추론 모델로 "열풍"을 일으킨 적이 있습니다. 사진: 블룸버그 . |

작년부터 OpenAI와 같은 회사는 강화 학습 기술에 집중해 왔습니다. 일반적으로 이 과정은 수개월이 걸리며, 이 기간 동안 AI는 시행착오를 통해 행동을 학습합니다.

예를 들어, 수천 개의 문제를 풀면 시스템은 올바른 답을 내는 최적의 방법을 학습할 수 있습니다. 이를 바탕으로 연구자들은 시스템이 올바른 해결책과 잘못된 해결책을 인식하는 데 도움이 되는 복잡한 피드백 메커니즘을 구축했습니다.

OpenAI의 연구원인 제리 트워렉은 "개를 훈련하는 것과 같습니다. 잘되면 간식을 주고, 잘 안 되면 '저 개는 나쁘다'고 말합니다."라고 말했습니다.

AI가 미래일까?

뉴욕 타임스 에 따르면 강화 학습 기술은 수학, 과학, 컴퓨터 프로그래밍 요구 사항에 잘 맞습니다. 이 부분에서는 옳고 그름이 명확히 구분되어 있습니다.

반면, 강화 학습은 창의적 글쓰기, 철학, 윤리와 같은 분야에서는 효과적이지 않습니다. 이러한 분야에서는 좋은 것과 나쁜 것을 구분하기 어렵습니다. 그럼에도 불구하고 연구자들은 이 기술이 수학을 넘어서는 문제에서도 AI 성능을 향상시킬 수 있다고 주장한다.

Anthropic의 최고 과학 책임자인 Jared Kaplan은 "시스템은 긍정적이고 부정적인 결과로 이어지는 경로를 학습할 것입니다."라고 말했습니다.

|

AI 모델 클로드를 소유한 스타트업 Anthropic의 웹사이트. 사진: 블룸버그 . |

강화 학습과 추론 시스템은 서로 다른 개념이라는 점을 알아두는 것이 중요합니다. 구체적으로 강화 학습은 이론적 시스템을 구축하는 방법입니다. 이는 챗봇이 추론할 수 있는 최종 훈련 단계입니다.

아직은 비교적 새로운 분야이기 때문에 과학자들은 추론형 챗봇이나 강화 학습이 AI가 사람처럼 생각하는 데 도움이 될지 확신할 수 없습니다. 현재 AI 훈련 트렌드 중 상당수가 처음에는 매우 빠르게 성장하다가 이후 둔화된다는 점이 주목할 만합니다.

게다가 추론형 챗봇도 여전히 실수를 할 수 있다. 확률에 따라 시스템은 인터넷이나 강화 학습을 통해 얻은 데이터와 가장 유사한 프로세스를 선택합니다. 그러므로 챗봇은 여전히 잘못되거나 불합리한 솔루션을 선택할 수 있습니다.

출처: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

![[사진] 쿠치 터널 방문 - 영웅적인 지하 업적](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/8/06cb489403514b878768dd7262daba0b)

댓글 (0)