De nombreux outils d’intelligence artificielle (IA) parmi les plus populaires au monde sont alimentés par des programmes biaisés contre les femmes, développés par des sociétés comme OpenAI et Meta. C'est le résultat d'une nouvelle étude annoncée par l'Organisation des Nations Unies pour l'éducation, la science et la culture (UNESCO) le 7 mars.

Les plus grandes entreprises dans la course à l’IA utilisent désormais des quantités massives de données provenant d’Internet pour former des algorithmes, connus sous le nom de grands modèles de langage (LLM). L'UNESCO a testé l'algorithme Llama 2 de Meta et les algorithmes GPT-2 et GPT-3.5 d'OpenAI utilisés dans l'application de chat populaire ChatGPT. Les résultats des tests ont montré que chacun de ces algorithmes présentait des preuves évidentes de partialité à l’encontre des femmes.

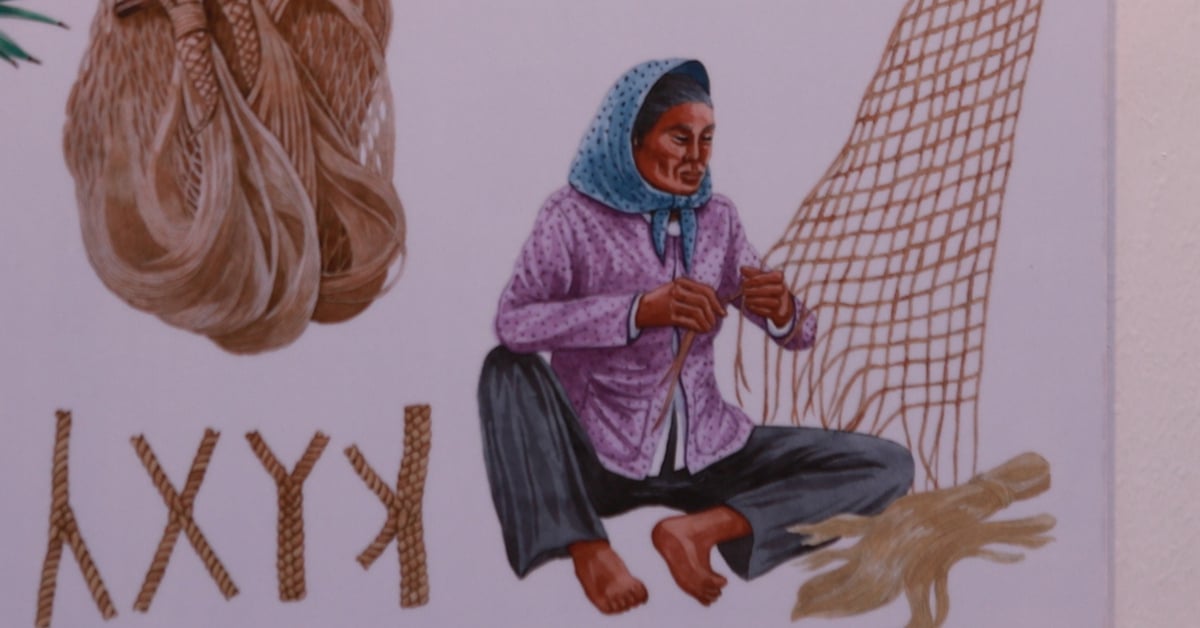

Les résultats ont montré que les textes liés aux noms féminins générés par ces outils contenaient souvent des mots tels que « maison », « famille » ou « enfants », tandis que les textes liés aux noms masculins contenaient souvent des mots tels que « entreprise », « salaire » ou « carrière » ; Les hommes sont souvent représentés avec des métiers tels qu’enseignants, avocats, médecins ; Les femmes sont souvent associées à des tâches telles que la cuisine, les tâches ménagères, etc.

DO CAO

Source

![[Photo] Retour sur les moments impressionnants de l'équipe de sauvetage vietnamienne au Myanmar](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/11/5623ca902a934e19b604c718265249d0)

![[Photo] Les « Beautés » participent à la répétition du défilé à l'aéroport de Bien Hoa](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/11/155502af3384431e918de0e2e585d13a)

![[Photo] Résumé des exercices de défilé en préparation de la célébration du 30 avril](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/11/78cfee0f2cc045b387ff1a4362b5950f)

Comment (0)