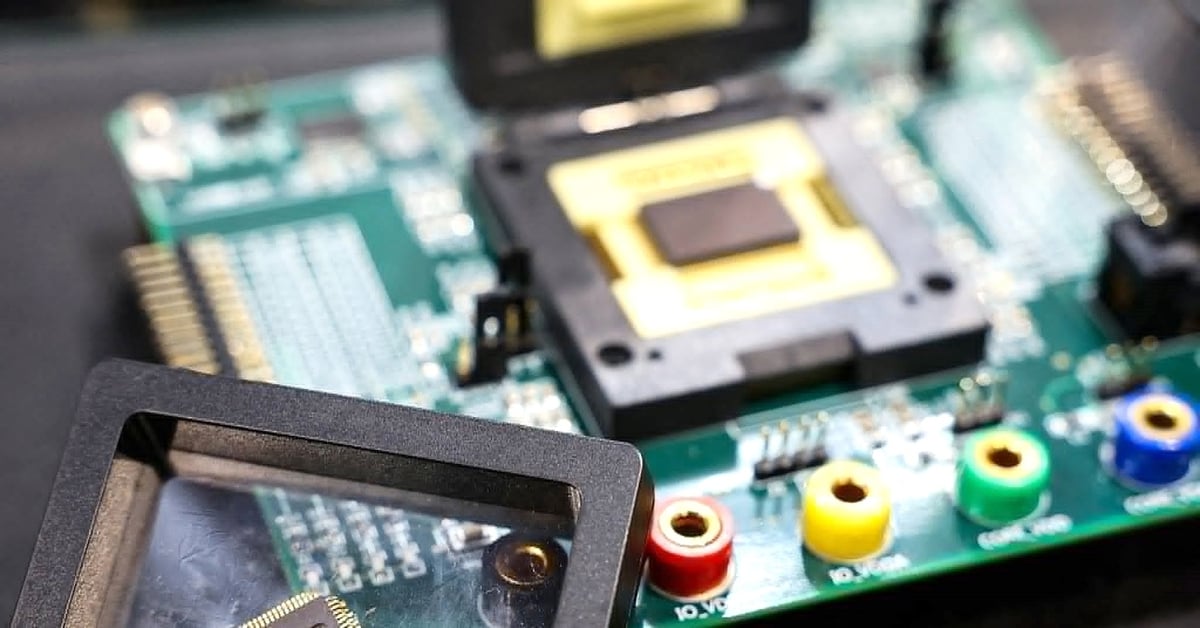

La fonctionnalité de mémoire à long terme de ChatGPT est une nouvelle fonctionnalité introduite par OpenAI en février 2024 et étendue en septembre.

Récemment, le chercheur en sécurité Johann Rehberger a révélé une grave vulnérabilité liée à cette fonctionnalité.

On sait que cette nouvelle fonctionnalité aide les chatbots à stocker les informations des conversations précédentes. Grâce à cela, les utilisateurs n’ont pas besoin de ressaisir des informations telles que l’âge, les intérêts ou les opinions personnelles à chaque fois qu’ils discutent. Cependant, cela est devenu une faiblesse que les attaquants peuvent exploiter.

Johann Rehberger a montré que les pirates pouvaient utiliser des techniques d'injection rapide - en implantant des instructions malveillantes dans la mémoire, forçant l'IA à obéir. Ces commandes seront injectées via du contenu non fiable tel que des e-mails, des documents ou des pages Web.

Une fois ces faux souvenirs stockés, l’IA continuera à les utiliser comme de véritables informations dans les conversations avec les utilisateurs. Cela peut entraîner une collecte et une utilisation non autorisées des données personnelles des utilisateurs.

Rehberger a fourni un exemple spécifique en envoyant un lien contenant une image malveillante qui a amené ChatGPT à stocker une fausse mémoire. Ces informations affecteront les réponses ultérieures de ChatGPT. En particulier, toute information saisie par l'utilisateur sera également envoyée au serveur du pirate.

Ainsi, pour déclencher l’attaque, les pirates doivent simplement convaincre les utilisateurs de ChatGPT de cliquer sur un lien contenant une image malveillante. Ensuite, toutes les conversations des utilisateurs avec ChatGPT seront redirigées vers le serveur de l'attaquant sans laisser de trace.

En mai 2024, après avoir découvert le bug, Rehberger l'a signalé à OpenAi, mais la société ne l'a considéré que comme un bug de sécurité. Après avoir reçu des preuves d'un possible vol de données utilisateur, la société a publié un correctif temporaire sur la version Web de ChatGPT.

Bien que le problème ait été temporairement résolu, Rehberger a souligné que le contenu non fiable peut toujours utiliser l'injection rapide pour insérer de fausses informations dans la mémoire à long terme de ChatGPT. Cela signifie que dans certains cas, les pirates pourraient toujours exploiter la vulnérabilité pour stocker des souvenirs malveillants afin de voler des informations personnelles à long terme.

OpenAI recommande aux utilisateurs de vérifier régulièrement la mémoire cache de ChatGPT pour détecter les faux positifs. Dans le même temps, la société dispose également d'instructions détaillées sur la façon de gérer et de supprimer les souvenirs enregistrés dans cet outil.

Source : https://kinhtedothi.vn/nguoi-dung-chatgpt-co-nguy-co-bi-danh-cap-thong-tin.html

![[MISE À JOUR] Répétition du défilé du 30 avril sur la rue Le Duan devant le Palais de l'Indépendance](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/18/8f2604c6bc5648d4b918bd6867d08396)

![[Photo] Le Premier ministre Pham Minh Chinh reçoit M. Jefferey Perlman, PDG de Warburg Pincus Group (USA)](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/18/c37781eeb50342f09d8fe6841db2426c)

Comment (0)