وفقًا لـ BGR ، سيكون عام 2024 وقتًا محوريًا للعالم ليدرك ما إذا كان الذكاء الاصطناعي هو مستقبل الحوسبة حقًا أم أنه مجرد جنون عابر. وفي حين تتنوع التطبيقات الحقيقية للذكاء الاصطناعي بشكل متزايد، فإن الجانب المظلم لهذه التكنولوجيا سوف يتم الكشف عنه أيضًا من خلال عمليات احتيال لا حصر لها في الأشهر المقبلة.

أصدر خبراء مكافحة الاحتيال في Scams.info قائمة بثلاث عمليات احتيال بالذكاء الاصطناعي ينبغي على الجميع الحذر منها في عام 2024. كقاعدة عامة، احذر من أي شيء مبهرج للغاية، ولكن الحيل التالية تتطلب يقظة خاصة.

احتيال استثماري باستخدام الذكاء الاصطناعي

لقد استثمرت شركات كبيرة مثل جوجل ومايكروسوفت وOpenAI ملايين الدولارات في الذكاء الاصطناعي وستواصل الاستثمار بشكل أكبر هذا العام. سيستغل المحتالون هذه الحقيقة لإغرائك بالاستثمار في فرص مشبوهة. إذا حاول أحد الأشخاص على وسائل التواصل الاجتماعي إقناعك بأن الذكاء الاصطناعي سيضاعف عوائد استثماراتك، ففكر مرتين قبل فتح محفظتك.

الاستثمارات "الجيدة" منخفضة المخاطر لا وجود لها أبدًا.

يحذر الخبير نيكولاس كراوتش من موقع Scams.info قائلاً: "كن حذرًا من الاستثمارات التي تعد بعوائد مرتفعة مع مخاطر منخفضة وتأكد من إجراء البحث قبل الالتزام بأموالك". وينبغي للمستثمرين الجدد أيضًا أن يكونوا حذرين من العروض التي تهدف إلى إحالة المستثمرين؛ إنهم يعملون في كثير من الأحيان وفق نموذج متعدد المستويات، والذي لا يستفيد منه إلا أولئك الموجودون في القمة، في حين نادراً ما يستفيد منه المشاركون الآخرون.

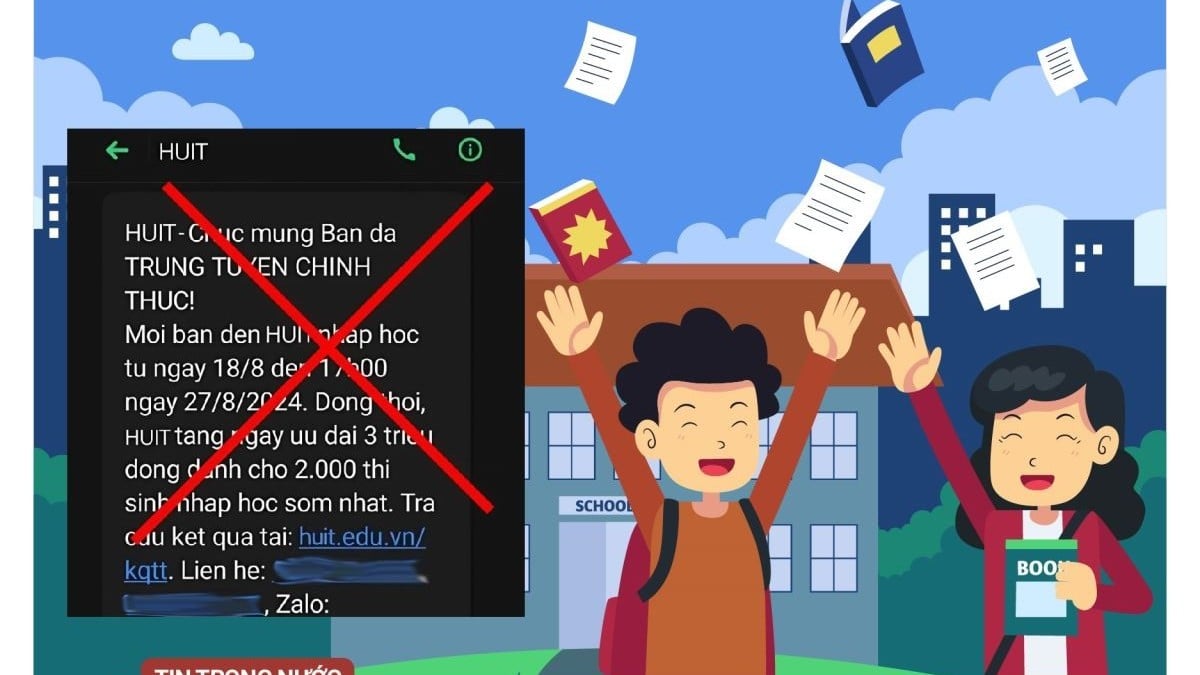

انتحال شخصية الأقارب

لم تعد خدعة انتحال شخصية الأصدقاء أو الأقارب لاقتراض المال جديدة، حيث إن تقليد صوت المحتال ليس فعالاً حقًا. ومع ذلك، مع الذكاء الاصطناعي، أصبحت هذه الخدعة أكثر رعباً. بمجرد استخدام مقطع فيديو على YouTube أو منشور على Facebook بصوت أحد الأحباء، يمكن للمحتالين استخدام الذكاء الاصطناعي لتقليده بشكل مثالي. هل يمكنك معرفة الفرق عبر الهاتف؟

يمكن للذكاء الاصطناعي تقليد صوت من تحب بسهولة

لقطة شاشة من صحيفة واشنطن بوست

وأكد كراوتش أنه "من المهم أن يحمي الأشخاص حساباتهم على وسائل التواصل الاجتماعي لمنع المحتالين من الاستيلاء على أصواتهم ومعلومات عائلاتهم".

استخدام الصوت لتجاوز نظام الأمان

تستخدم بعض البنوك خاصية التعرف على الصوت للتحقق من هوية المستخدمين عند إجراء المعاملات عبر الهاتف. وللأسباب المذكورة أعلاه، أصبحت هذه الطريقة فجأة أقل أمانًا من ذي قبل. إذا قمت بنشر مقاطع فيديو أو مقاطع صوتية في أي مكان على الإنترنت، فيمكن للأشرار استخدام هذا المحتوى لنسخ صوتك. وكما أشار كراوتش، لا تزال البنوك تمتلك بيانات أخرى للتحقق من هويات العملاء، ولكن هذا التكتيك يجعل المجرمين أقرب خطوة إلى سرقة حسابك المصرفي.

لم تعد أنظمة أمان الصوت آمنة من قوة الذكاء الاصطناعي

يمكن للذكاء الاصطناعي أن يغير حياتنا بشكل جذري وطريقة تفاعلنا مع الأجهزة. وهي أيضًا أحدث أداة يستخدمها المتسللون والمحتالون لمهاجمة المستخدمين. لذلك، كن دائمًا يقظًا وابحث دائمًا بعناية قبل المشاركة في أي أنشطة تتعلق بالذكاء الاصطناعي.

[إعلان 2]

رابط المصدر

![[صورة] الأمين العام تو لام يستقبل السفير الفرنسي لدى فيتنام أوليفييه بروشيت](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/49224f0f12e84b66a73b17eb251f7278)

![[صورة] أشجار الصنوبر التي يبلغ عمرها مائة عام - وجهة جذابة للسياح في جيا لاي](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/25a0b7b629294f3f89350e263863d6a3)

![[صورة] رئيس الوزراء فام مينه تشينه ورئيس الوزراء الإثيوبي يزوران معبد تران كوك](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/18ba6e1e73f94a618f5b5e9c1bd364a8)

![[صورة] الرئيس لونغ كونغ يستقبل وزير الدفاع الكيني سويبان تويا](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/0e7a5185e8144d73af91e67e03567f41)

![[صورة] لقاء حميم بين السيدتين الأوليين لرئيسي وزراء فيتنام وإثيوبيا مع الطلاب المكفوفين في مدرسة نجوين دينه تشيو](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/b1a43ba73eb94fea89034e458154f7ae)

![[صورة] حفل استقبال لوزير الدفاع الصيني والوفد المرافق له في إطار التبادل الودي](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/fadd533046594e5cacbb28de4c4d5655)

![[فيديو] شركة فيتيل تبدأ رسميًا تشغيل أكبر خط كابل بصري بحري في فيتنام](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/f19008c6010c4a538cc422cb791ca0a1)

تعليق (0)