(CLO) เครื่องมือแปลงคำพูดเป็นข้อความ Whisper ของ OpenAI มีการโฆษณาว่า "มีประสิทธิภาพและแม่นยำในระดับใกล้เคียงกับมนุษย์" แต่มีข้อเสียสำคัญประการหนึ่งคือ มีแนวโน้มที่จะสร้างข้อความสั้นๆ หรือแม้แต่ประโยคทั้งประโยคได้!

ผู้เชี่ยวชาญกล่าวว่าข้อความบางส่วนที่ผลิตขึ้น ซึ่งในอุตสาหกรรมเรียกว่ายาหลอนประสาท อาจมีเนื้อหาเกี่ยวกับการเหยียดเชื้อชาติ ความรุนแรง หรือแม้แต่การรักษาทางการแพทย์ในจินตนาการ

ผู้เชี่ยวชาญกล่าวว่าการประดิษฐ์ดังกล่าวมีความร้ายแรงเนื่องจาก Whisper ถูกใช้ในอุตสาหกรรมหลากหลายประเภททั่วโลกในการแปลและถอดเสียงบทสัมภาษณ์ สร้างวิดีโอข้อความและคำบรรยาย

ที่น่ากังวลกว่านั้นคือศูนย์การแพทย์กำลังใช้เครื่องมือที่ใช้ Whisper ในการบันทึกการปรึกษาระหว่างแพทย์กับคนไข้ แม้ว่า OpenAI จะเตือนว่าไม่ควรใช้เครื่องมือดังกล่าวใน "พื้นที่เสี่ยงสูง" ก็ตาม

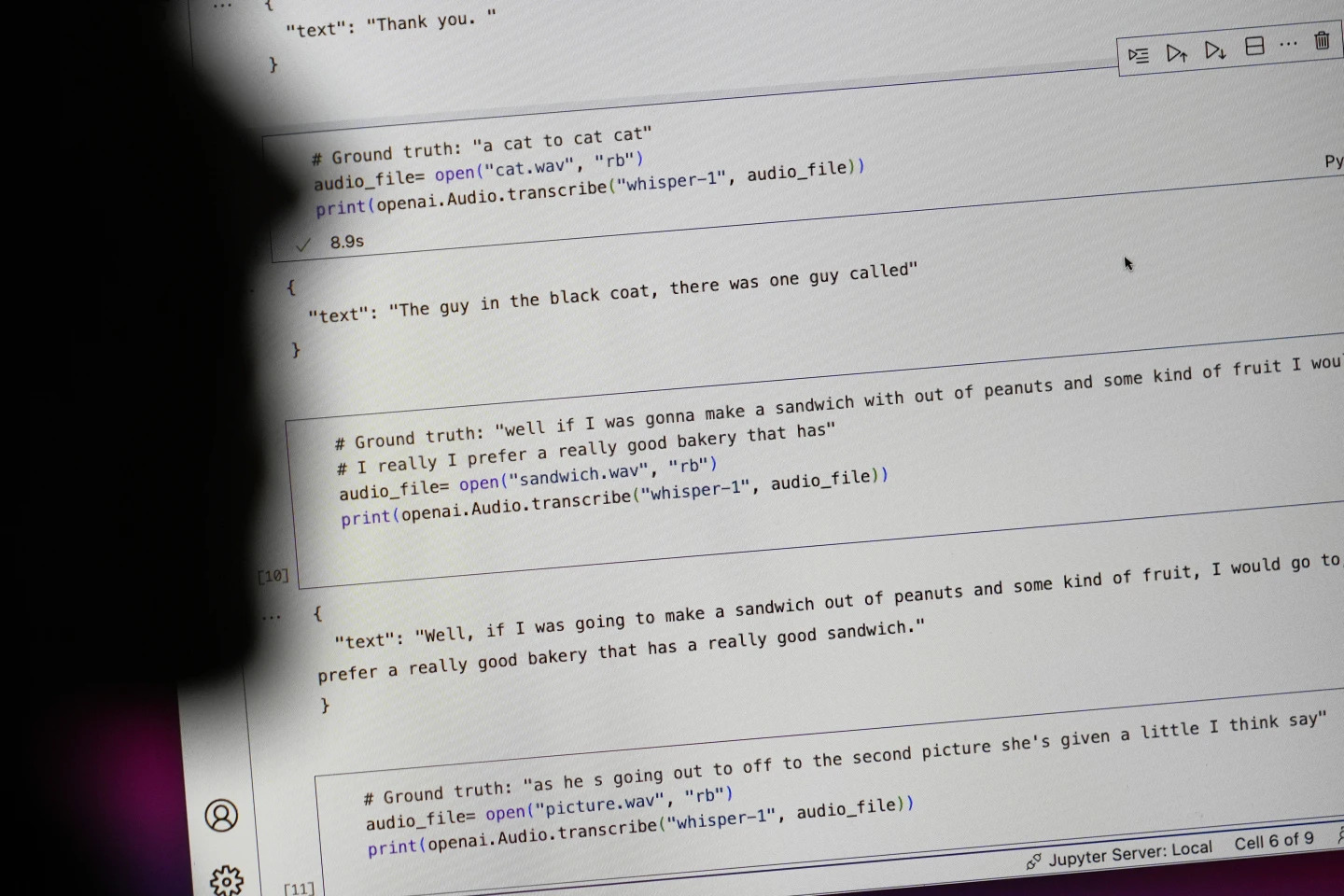

ประโยคที่ขึ้นต้นด้วย #Ground truth คือสิ่งที่ถูกกล่าวจริง ประโยคที่ขึ้นต้นด้วย #text คือสิ่งที่ Whisper ถอดความออกมา ภาพ : เอพี

นักวิจัยและวิศวกรระบุว่า Whisper มักทำให้เกิดภาพหลอนในระหว่างการใช้งาน ตัวอย่างเช่น นักวิจัยจากมหาวิทยาลัยมิชิแกนกล่าวว่าเขาพบภาพหลอนในบันทึกเสียง 8 ใน 10 รายการที่เขาได้ตรวจสอบ

วิศวกรการเรียนรู้ของเครื่องค้นพบการบิดเบือนในตอนแรกในประมาณครึ่งหนึ่งจากบันทึก Whisper มากกว่า 100 ชั่วโมงที่เขาวิเคราะห์ นักพัฒนารายที่สามกล่าวว่าเขาตรวจพบภาพหลอนในธนบัตรเกือบทุกใบจากจำนวน 26,000 ใบที่สร้างขึ้นโดยใช้ Whisper

ภาพลวงตาจะยังคงปรากฏแม้จะบันทึกไว้อย่างดีในตัวอย่างเสียงสั้นๆ การศึกษาล่าสุดโดยนักวิทยาศาสตร์คอมพิวเตอร์พบการบิดเบือน 187 ครั้งในคลิปเสียงที่ชัดเจนมากกว่า 13,000 คลิปที่พวกเขาตรวจสอบ

นักวิจัยกล่าวว่าแนวโน้มดังกล่าวจะส่งผลให้เกิดข้อผิดพลาดหลายหมื่นรายการในบันทึกหลายล้านรายการ

ความผิดพลาดเช่นนี้อาจก่อให้เกิด “ผลลัพธ์ที่ร้ายแรงจริงๆ” โดยเฉพาะอย่างยิ่งในโรงพยาบาล Alondra Nelson ศาสตราจารย์คณะสังคมศาสตร์ สถาบันการศึกษาระดับสูง กล่าว

“ไม่มีใครอยากได้รับการวินิจฉัยผิด จำเป็นต้องมีอุปสรรคที่มากขึ้น” เนลสันกล่าว

ศาสตราจารย์ Allison Koenecke จากมหาวิทยาลัย Cornell และ Mona Sloane จากมหาวิทยาลัย Virginia ได้ตรวจสอบข้อความสั้นๆ นับพันข้อความที่รวบรวมมาจาก TalkBank ซึ่งเป็นคลังข้อมูลงานวิจัยที่มหาวิทยาลัย Carnegie Mellon จัดเก็บไว้ พวกเขากำหนดว่าภาพหลอนเกือบร้อยละ 40 เป็นอันตรายหรือสร้างความรบกวน เนื่องจากผู้พูดอาจถูกเข้าใจผิดหรือถูกนำเสนอผิดได้

ผู้พูดในบันทึกเสียงครั้งหนึ่งได้บรรยายถึง "เด็กผู้หญิงอีกสองคนและผู้หญิงคนหนึ่ง" แต่ Whisper ได้แต่งเรื่องเกี่ยวกับเชื้อชาติเพิ่มเติม โดยเสริมว่า "เด็กผู้หญิงอีกสองคนและผู้หญิงคนหนึ่ง เอ่อ ผิวดำ"

ในการถ่ายทอดข้อมูลอีกครั้ง Whisper ได้ประดิษฐ์ยาที่ไม่มีอยู่จริงที่เรียกว่า "ยาปฏิชีวนะที่มีฤทธิ์เพิ่มขึ้น"

ในขณะที่นักพัฒนาส่วนใหญ่มักคิดว่าเครื่องมือถอดเสียงสามารถสะกดผิดหรือเกิดข้อผิดพลาดอื่นๆ ได้ แต่วิศวกรและนักวิจัยกลับบอกว่าพวกเขาไม่เคยเห็นเครื่องมือถอดเสียงที่ขับเคลื่อนด้วย AI ใดที่ทำให้เกิดภาพหลอนได้เท่ากับ Whisper เลย

เครื่องมือนี้รวมเข้าไว้ในแชทบอทเรือธงของ OpenAI หลายเวอร์ชันอย่าง ChatGPT และเป็นบริการที่รวมเข้าไว้ในแพลตฟอร์มคลาวด์คอมพิวติ้งของ Oracle และ Microsoft ซึ่งให้บริการแก่บริษัทหลายพันแห่งทั่วโลก นอกจากนี้ยังใช้ในการถอดเสียงและแปลข้อความเป็นภาษาต่างๆ หลายภาษาอีกด้วย

ง็อก อันห์ (ตามรายงานของเอพี)

ที่มา: https://www.congluan.vn/cong-cu-chuyen-giong-noi-thanh-van-ban-ai-cung-co-the-xuyen-tac-post319008.html

การแสดงความคิดเห็น (0)