|

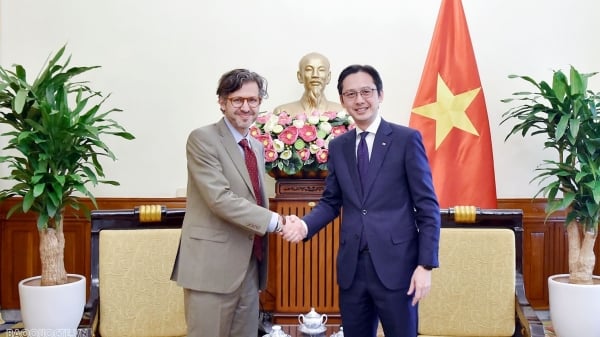

| Президент России Владимир Путин. (Источник: Рейтер) |

5 июня Кремль выступил со срочным заявлением, в котором заявил, что видеоролик с президентом России Владимиром Путиным, транслировавшийся на многих радио- и телеканалах в регионах, граничащих с Украиной, является дипфейком, созданным хакерами.

Поддельное видео, реальный эффект

В своей речи голос президента России Владимира Путина, созданный с помощью технологии deepfake, сообщил, что в Белгородской, Воронежской и Ростовской областях России введено чрезвычайное положение из-за готовящихся атак со стороны украинских сил. Фальшивый Путин также призвал жителей регионов покинуть свои дома и найти убежище в глубине России.

| Deepfake — это технология, которая использует искусственный интеллект (ИИ) для того, чтобы брать изображение и голос одного человека и вставлять их в видео другого человека. Технология Deepfake собирает изображение лица объекта, а затем заменяет это лицо лицом другого человека на видео. В случае аудиофайлов дипфейки используют запись голоса реального человека, чтобы обучить компьютер говорить в точности как этот человек. |

Радио «Мир» , одна из подвергшихся взлому станций, сообщило, что инцидент длился около 40 минут. Тем временем в социальных сетях начали распространяться фейковые видеоролики с участием Путина. Ни одно лицо или агентство пока не взяло на себя ответственность за этот инцидент.

После того, как ролик стал вирусным, пресс-секретарь Кремля Дмитрий Песков заявил, что объявление военного положения — дело рук хакеров.

«Никакого (введения военного положения) точно нет. Хакерские атаки действительно были в некоторых регионах. Мне сообщили, что был инцидент с хакерскими атаками на Радио Мир и на некоторых других каналах. Сейчас все хакеры ликвидированы, и информационные каналы снова под контролем», — заявил Дмитрий Песков российскому информационному агентству ТАСС.

Издание Kyiv Post также сообщило, что в административнном центре Белгородской области видеообращение назвали дипфейком, направленным на «нагнетание страха у мирных жителей Белгорода».

Анна Любакова, белорусская журналистка и внештатный научный сотрудник Атлантического совета, поделилась телевизионным клипом, демонстрирующим фейковое изображение г-на Путина.

Оценивая инцидент, специалист по обработке данных Арсений Хахалин, эксперт в области искусственного интеллекта (ИИ), заявил, что этот взлом может быть типичным примером использования дипфейка для превращения российско-украинского конфликта в оружие.

Однако это не первый случай использования технологии deepfake в этом конфликте. В первые недели спецоперации России в феврале 2022 года было опубликовано фейковое видео президента Украины Владимира Зеленского. В этом фейковом видео г-н Зеленский, по-видимому, призывает своих солдат сложить оружие и сдаться. Видео было быстро удалено, но оно уже стало вирусным в социальных сетях.

|

| В пропаганде технология deepfake имеет убедительный военный или политический эффект, это оружие, которое может оказать огромное влияние. (Источник: socialmediasafety) |

Новое популярное оружие

Полковник Филип Ингрэм, бывший офицер британской военной разведки и политик Организации Североатлантического договора (НАТО), рассказал Politico Europe о выдаче себя за Путина и заявил, что фейковые сообщения, якобы созданные на основе реальных данных, представляют собой растущий риск в мире, находящемся под влиянием искусственного интеллекта.

По словам этого человека, в пропаганде технология deepfake обеспечивает убедительный военный или политический эффект, это оружие, которое может иметь огромное влияние.

«Я подозреваю, что это новое оружие массового поражения», — добавил полковник Филип Ингрэм. Он привел в пример случай, произошедший несколько недель назад, когда в Twitter распространилась фейковая фотография бомбардировки Пентагона, из-за чего фондовый рынок обвалился на 500 миллиардов долларов, прежде чем восстановиться.

Профессор Хани Фарид из Калифорнийского университета в Беркли (США), эксперт по цифровым медиа, предупредил людей, что не стоит удивляться подобным вещам в современных условиях, когда люди создают и внедряют инструменты для манипулирования реальностью, а в сочетании с такими медиаканалами, как телевидение, радио, интернет... это может мгновенно сказаться на миллиардах долларов. Многие субъекты, преследующие различные цели, будут злоупотреблять этими технологиями.

«Это особенно актуально, поскольку наши регулирующие органы не стремятся обеспечить адекватную защиту технологического сектора, в то время как Кремниевая долина продолжает быстро расти и нарушать ход событий», — подчеркнул профессор Хани Фарид.

Источник

![[Фото] Открытие 4-го саммита Партнерства ради зеленого роста и глобальных целей](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/16/488550ff07ce4cd9b68a2a9572a6e035)

![[Фото] Проект строительства компонента скоростной автомагистрали «Север-Юг», участок Бунг - Ваннинь перед днем открытия](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/ad7c27119f3445cd8dce5907647419d1)

![[Фото] Президент Луонг Куонг принимает премьер-министра Эфиопии Абия Ахмеда Али](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/16/504685cac833417284c88a786739119c)

![[Фото] Множество практических мероприятий 9-го обмена дружбой по обороне границы между Вьетнамом и Китаем](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/16/3016ed3ef51049219574230056ddb741)

![[Фото] Председатель Национальной ассамблеи Чан Тхань Ман встречается с премьер-министром Эфиопии Абием Ахмедом Али](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/16/c196dbc1755d46e4ae7b506c5c15be55)

![[Видео] Viettel официально вводит в эксплуатацию крупнейшую подводную оптоволоконную кабельную линию во Вьетнаме](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/f19008c6010c4a538cc422cb791ca0a1)

Комментарий (0)