Технологические гиганты Alibaba, Baidu и ByteDance стремятся снизить стоимость «вывода» ИИ, предлагая цены на 90% ниже, чем у их американских коллег.

По словам Ли Кай-Фу, основателя 01.ai и бывшего главы Google China, компании на материке сокращают расходы, создавая модели, обучаемые на меньших объемах данных, требующие меньшей вычислительной мощности, но оптимизированного оборудования.

Согласно рейтингу, недавно опубликованному UC Berkeley SkyLab и LMSYS, модель Yi-Lingtning стартапа 01.ai заняла третье место, разделив с Grok-2 компании x.AI, после OpenAI и Google. Этот рейтинг основан на оценках пользователей, ответивших на вопросы.

01.ai и DeepSeek — это компании в сфере искусственного интеллекта, которые придерживаются стратегии, направленной на обучение моделей на основе небольших наборов данных, одновременно нанимая дешевую, высококвалифицированную рабочую силу.

FT сообщила, что стоимость вывода Yi-Lightning составляет 14 центов за миллион токенов по сравнению с 26 центами для o1-mini GPT от OpenAI. Между тем стоимость GPT 4o достигает $4,4 за миллион токенов. Количество токенов, используемых для генерации ответа, зависит от сложности каждого запроса.

Основатель Yi-Lightning рассказал, что компания потратила 3 миллиона долларов на «начальное обучение», прежде чем заняться тонкой настройкой для различных вариантов использования. Ли заявил, что их целью было «не создание лучшей модели», а создание конкурирующей модели, которая была бы «в 5–10 раз дешевле».

Метод, который применили 01.ai, DeepSeek, MiniMax и Stepfun, называется «экспертное моделирование» — это простое объединение нескольких нейронных сетей, обученных на наборах данных, специфичных для определенной области.

Исследователи рассматривают этот подход как ключевой способ достижения того же уровня интеллекта, что и у моделей больших данных, но с меньшей вычислительной мощностью. Однако сложность подхода заключается в том, что инженерам приходится организовывать процесс обучения с участием «нескольких экспертов», а не только одной общей модели.

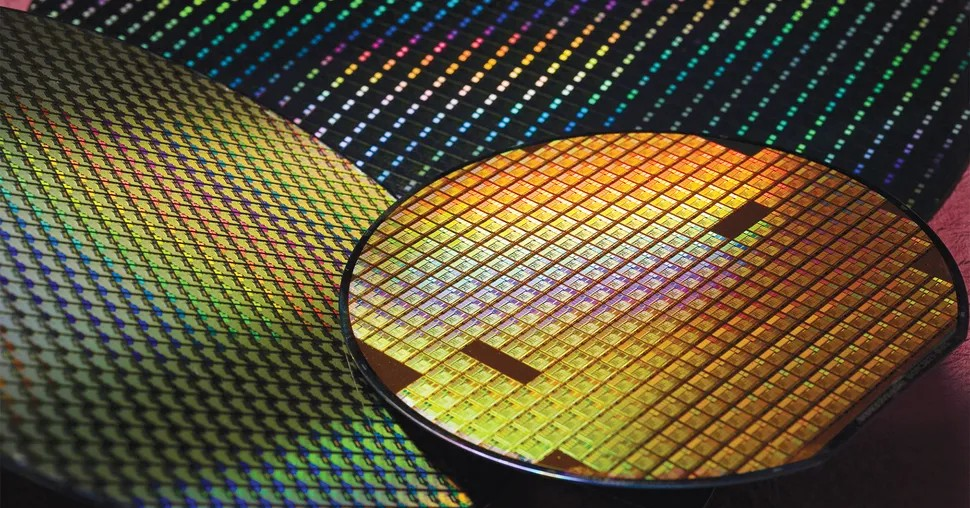

Из-за трудностей с доступом к высокопроизводительным ИИ-чипам китайские компании обратились к разработке высококачественных наборов данных для использования в обучении экспертных моделей, тем самым конкурируя с западными конкурентами.

Ли сказал, что 01.ai использует нетрадиционные способы сбора данных, такие как сканирование книг или сбор статей в приложении для обмена сообщениями WeChat, которые недоступны в открытом доступе в Интернете.

Основатель считает, что Китай находится в лучшем положении, чем США, поскольку обладает огромным резервом дешевых технических специалистов.

(По данным FT, Bloomberg)

Источник: https://vietnamnet.vn/trung-quoc-giam-90-chi-phi-ai-suy-luan-so-voi-my-2334520.html

![[Фото] Закрытие 11-й конференции 13-го Центрального Комитета Коммунистической партии Вьетнама](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/114b57fe6e9b4814a5ddfacf6dfe5b7f)

![[Фото] Преодолевая все трудности, ускоряем ход строительства проекта расширения ГЭС Хоабинь](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/12/bff04b551e98484c84d74c8faa3526e0)

Комментарий (0)