Фишинг уже давно является излюбленным оружием хакеров в киберпространстве. Он служит прелюдией к различным атакам, позволяя осуществлять кражу учетных данных, проникновение в инфраструктуру и срыв операций.

Развитие предварительно обученных моделей машинного обучения (GPT) создало новое измерение риска для сферы кибербезопасности. GPT — это крупная языковая модель и ведущая структура для генеративного ИИ.

Возможность создания убедительного искусственного текста в больших масштабах вызвала обеспокоенность у экспертов по безопасности. Это может оказать огромное влияние на мошенничество с использованием искусственного интеллекта, мошенничество с электронной почтой, включая компрометацию деловой электронной почты (BEC).

Фишинг основан на обмане конечного пользователя, заставляя его поверить, что электронное письмо отправлено от законного источника. GPT может помочь в этом процессе, создавая ответы, которые являются единообразными по стилю и языку, создавая у получателя ощущение, что он общается с надежным коллегой или человеком. Это значительно усложняет различение текста в сообщениях, сгенерированного машиной и человеком.

Хотя в настоящее время существуют инструменты для идентификации машинно-генерируемого текста, мы должны быть готовы к сценарию, когда GPT сможет обойти эти средства защиты. Кроме того, хакеры могут использовать модели, подобные GPT, для создания изображений, видео или атак на определенные отрасли, что еще больше увеличивает риски кибербезопасности.

Чтобы снизить эти угрозы, частным лицам и организациям необходимо быстро внедрять решения по защите электронной почты на базе искусственного интеллекта. ИИ может эффективно бороться с современными методами киберпреступности и выявлять подозрительные действия.

Методы многофакторной аутентификации (MFA) и биометрической идентификации могут повысить безопасность, обеспечивая дополнительный уровень защиты от вторжений хакеров.

Помимо технологических мер, для повышения эффективности человеческого фактора в борьбе с фишинговыми атаками решающее значение имеют регулярные программы обучения и повышения осведомленности. Человеческий опыт и бдительность помогут эффективно распознавать и реагировать на попытки мошенничества. Геймификация и моделирование могут использоваться для повышения осведомленности и выявления пользователей, подверженных риску кибератак.

Учитывая вероятность того, что фишинговые кампании с использованием GPT станут более распространенными, агентства и организации должны проявлять активность в своих действиях по обеспечению кибербезопасности. Понимая возможности технологии GPT и внедряя надежные меры безопасности, мы можем эффективно защититься от растущей угрозы мошенничества с использованием искусственного интеллекта.

(Барракуда)

Источник

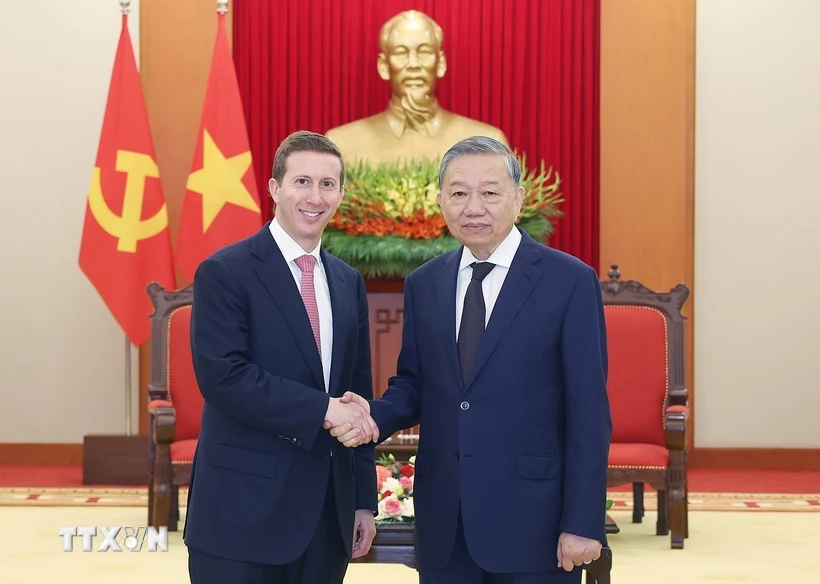

![[Фото] Премьер-министр Фам Минь Чинь принимает г-на Джеффри Перлмана, генерального директора Warburg Pincus Group (США)](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/18/c37781eeb50342f09d8fe6841db2426c)

![[ОБНОВЛЕНИЕ] Репетиция парада 30 апреля на улице Ле Дуан перед Дворцом Независимости](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/18/8f2604c6bc5648d4b918bd6867d08396)

Комментарий (0)