SGGPO 20 октября 2023 г. 19:13

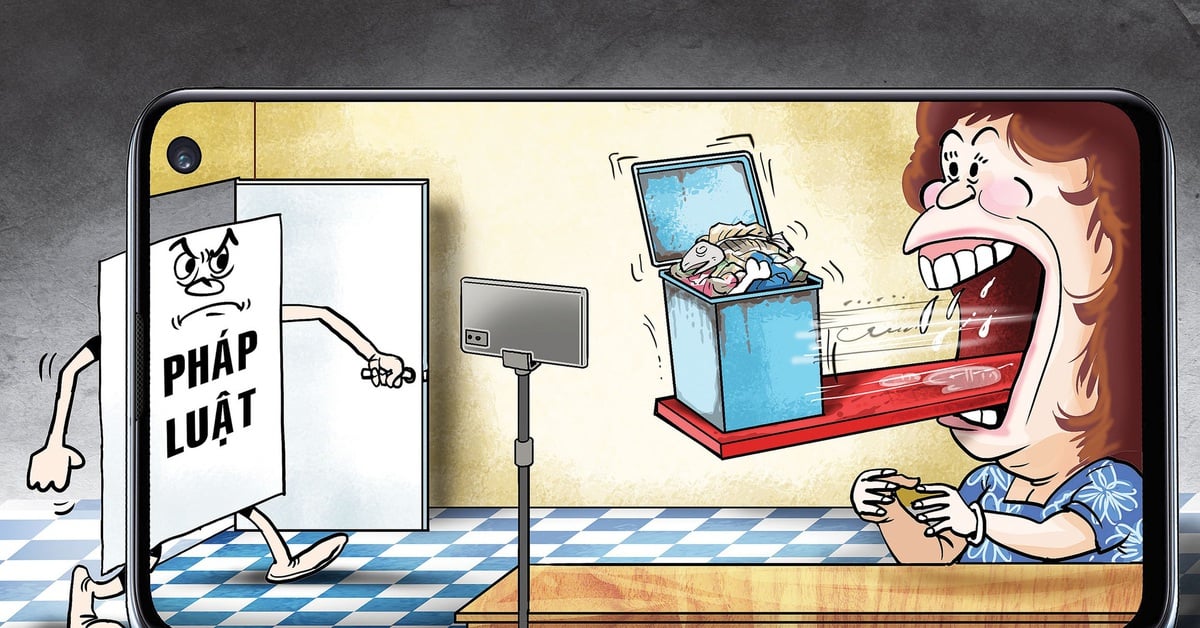

Дипфейки больше не используются в развлекательных целях, а постепенно становятся инструментом мошенничества со стороны киберпреступников... и мошенничество с использованием дипфейков будет расширяться, приобретая все более разнообразные и изощренные формы.

|

| Касперский прогнозирует, что дипфейк-мошенничество будет становиться все более разнообразным и изощренным. |

После исследования форумов даркнета, где часто действуют киберпреступники, «Лаборатория Касперского» пришла к выводу, что существует множество преступников, использующих дипфейки в целях мошенничества, причем спрос на них значительно превышает предложение программного обеспечения для дипфейков, представленного на рынке в настоящее время.

Эксперты «Лаборатории Касперского» прогнозируют, что мошенничество с использованием дипфейков будет становиться все более разнообразным и изощренным. От предоставления высококачественного видео с имитацией другого лица и полного комплекса услуг по его производству до использования изображений знаменитостей в поддельных прямых трансляциях в социальных сетях и обещания удвоить сумму, отправленную жертвой.

Хотя преступники используют искусственный интеллект в злонамеренных целях, частные лица и предприятия по-прежнему могут использовать его для выявления дипфейков и снижения вероятности успеха мошенничества. «Лаборатория Касперского» делится решениями, которые помогут пользователям защититься от мошенничества с использованием дипфейков:

Инструменты обнаружения контента на базе ИИ: программное обеспечение для обнаружения контента на базе ИИ использует передовые алгоритмы ИИ для анализа и определения уровня манипуляции изображениями, видео- и аудиофайлами.

Контент с использованием искусственного интеллекта, помеченный водяными знаками: водяные знаки выступают в качестве идентификационных знаков на изображениях, видео и т. д., помогая авторам защищать авторские права на работы с использованием искусственного интеллекта. Однако этот инструмент может стать оружием против дипфейков, поскольку он может помочь отследить происхождение платформы, создавшей ИИ.

Происхождение контента: поскольку ИИ собирает большие объемы данных из различных источников для создания нового контента, этот подход направлен на отслеживание происхождения этого контента.

Видеоаутентификация: процесс проверки того, что видеоконтент не был изменен с момента его создания. Именно этот процесс больше всего беспокоит создателей видео.

«Дипфейк стал кошмаром для женщин и общества. Киберпреступность теперь используют искусственный интеллект (ИИ) для наложения лиц жертв на порнографические фотографии и видео, а также в пропагандистских кампаниях. Целью этих форм является манипулирование общественным мнением путем распространения ложной информации или даже нанесения ущерба репутации организации или отдельного лица. «Мы призываем общественность быть более бдительными в отношении этой угрозы», — заявила г-жа Во Дуонг Ту Дьем, региональный директор Kaspersky во Вьетнаме.

Источник

![[Фото] «Красавицы» участвуют в репетиции парада в аэропорту Бьенхоа](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/11/155502af3384431e918de0e2e585d13a)

Комментарий (0)