2024년 5월, 세계적으로 유명한 기술 대기업들이 잇따라 새로운 버전의 인공지능(AI)을 출시했습니다. 여기에는 GPT-4o를 탑재한 OpenAI, Gemini 1.5 Pro를 탑재한 Google 등이 포함되며, 사용자 경험을 최적화하기 위해 많은 "매우 스마트한" 기능이 추가되었습니다. 그러나 이 기술이 사이버 범죄자들에 의해 다양한 온라인 사기 시나리오에 사용되고 있다는 것은 부인할 수 없습니다.

위험 증가

최근 컨퍼런스에서 정보통신부 차관 Pham Duc Long은 사이버 공격이 점점 더 정교하고 복잡해지고 있다는 사실을 지적했습니다. 특히 AI 지원이 있는 경우 사용자가 직면하는 위험은 기하급수적으로 증가할 것입니다. "사이버 범죄자들은 AI 기술을 이용해 새로운 맬웨어와 새롭고 정교한 피싱 공격을 쉽게 만들고 있습니다..." Pham Duc Long 부차관이 경고했습니다.

정보통신부 정보보안부 보고서에 따르면, AI와 관련된 사이버보안 위험으로 인한 피해는 전 세계적으로 1조 달러가 넘으며, 그 중 베트남에서만 8,000~10,000억 VND에 달합니다. 오늘날 가장 흔한 용도는 사기 목적으로 AI를 이용해 음성과 얼굴을 위조하는 것입니다. 2025년까지 초당 약 3,000건의 공격이 발생하고, 초당 12개의 맬웨어가 발생하며, 하루에 70개의 새로운 취약점과 약점이 발견될 것으로 예상됩니다.

애플리케이션에 대한 보안 지원을 전문으로 하는 BShield의 이사인 응우옌 후 지압(Nguyen Huu Giap) 씨에 따르면, AI가 발전함에 따라 가짜 이미지와 음성을 만드는 것이 어렵지 않습니다. 사기꾼은 소셜 네트워크에 게시한 공개 정보나 "당국"이라는 이름으로 온라인 구직 면접, 전화 통화 등의 속임수를 통해 사용자 데이터를 쉽게 수집할 수 있습니다. BShield에서 실시한 시뮬레이션에 따르면, 사기꾼은 영상 통화를 통해 얻은 얼굴을 CCCD 종이에 입력하고, 움직이는 사람의 신체와 합성하여 eKYC 도구를 속여 시스템에서 실제 사람으로 인식할 수 있습니다.

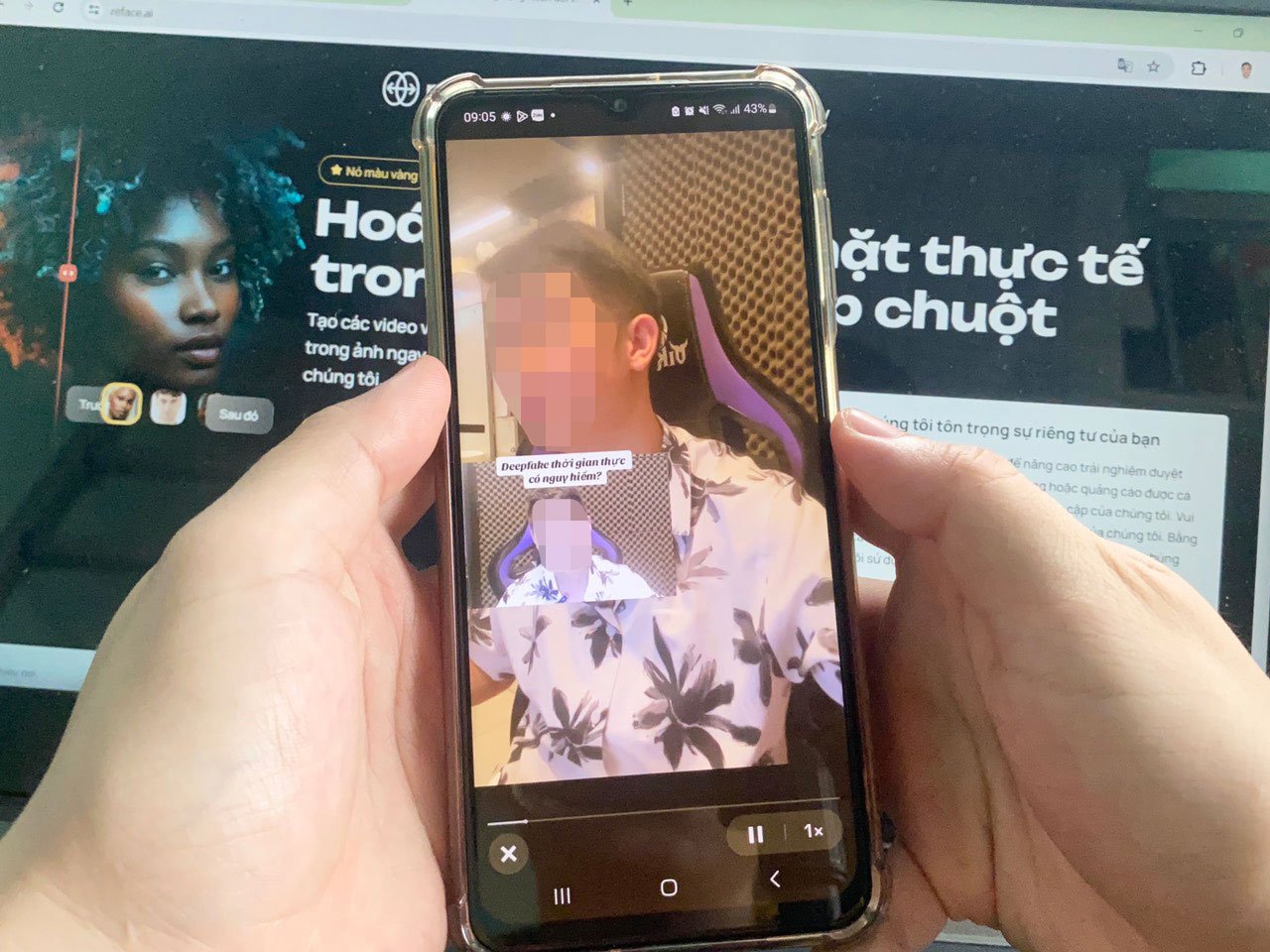

딥페이크 기술을 이용한 사기 수법이 늘어나고 더욱 정교해지고 있다. 사진: LE TINH

사용자 관점에서 볼 때, 호치민시의 IT 전문가인 응우옌 탄 중 씨는 악의적인 사람들이 chatGPT를 악용해 은행이나 평판 있는 조직의 실제 이메일과 유사한 내용과 문체를 사용한 사기성 이메일을 만들 수 있다는 점을 우려하고 있습니다. 이러한 이메일에는 악성 코드가 첨부되어 있을 가능성이 높으며, 사용자가 이를 클릭하면 데이터가 확실히 도난당하고 자산이 압류될 수 있습니다. "AI 소프트웨어는 점점 더 개선되고 있으며, 실제 사람과 95% 유사한 얼굴과 음성으로 가짜 영상을 만들 수 있고, 제스처는 실시간으로 바뀌어 시청자가 감지하기 매우 어렵습니다." - Trung 씨가 말했습니다.

곧 법적 복도가 완성됩니다

보안 전문가 Pham Dinh Thang은 첨단 사기 위험을 제한하기 위해서는 사용자가 AI에 대한 지식을 정기적으로 업데이트해야 하며 출처가 불분명한 링크를 클릭해서는 안 된다고 지적했습니다. 기업의 경우 데이터 보안과 시스템 운영을 보장하기 위한 예산을 할당해야 합니다. 기업 직원도 시스템에서 발생하는 실제 취약성에 접근하기 위해 심층적인 교육을 받아야 하며, 사이버 공격 유형을 식별하는 능력을 높여야 합니다.

AI 개발 부서 사기 방지 프로젝트의 책임자인 타 콩 손 씨는 AI가 매우 지능적인 지원 기능 덕분에 사용자의 삶과 기업, 기관 및 부서의 운영에 깊숙이 침투하고 있다고 말했습니다. 특히, AI 기술은 현재 매우 접근성이 좋고 사용하기 쉽기 때문에 악의적인 행위자들이 사기 목적으로 쉽게 이를 이용할 수 있는 환경이 조성됩니다. "사기꾼들은 또한 공격 방법을 끊임없이 바꾸고, 사용자는 이를 방지하는 방법을 알기 위해 정기적으로 정보를 업데이트해야 합니다." - 손 씨가 권고했습니다.

최근 업그레이드된 GPT-4o와 Gemini 1.5 Pro 모델은 AI의 지능에 한계가 없다는 사실을 입증했다고 전문가들은 말합니다. 따라서 기업이 AI 사기 방지 도구와 솔루션을 개발하도록 장려하는 것 외에도, 관리 기관에서는 추세를 앞서가기 위해 AI에 대한 법적 틀을 빨리 완성해야 합니다.

국가인구데이터센터 부소장인 응우옌 안 투안 중령은 AI를 개발, 생산, 적용, 활용하는 과정에서 국내외 서비스 제공자의 윤리와 책임을 규정하는 문서를 조만간 발행해야 한다고 말했습니다. 동시에 AI 서비스를 활용, 적용, 연결, 제공하는 시스템에 대한 기술 표준에 대한 구체적인 규정이 필요합니다. "AI 위험에 대처하기 위해 AI 프로젝트를 연구하고 적용하는 것이 필요합니다. AI는 인간이 만든 지식의 산물이기 때문에 '좋은 AI'와 '나쁜 AI'의 변형이 있을 것입니다. 따라서 인공지능 자체로 인공지능의 개발을 예방할 수 있습니다." - 투안 대령이 지적했습니다.

사이버 보안 과제

응우옌 안 투안 중령은 AI가 사이버 보안에 문제를 일으키고 있다는 사실을 인정했습니다. 따라서 AI 지원 맬웨어는 문서 파일에 설치될 수 있습니다. 사용자가 문서 파일을 업로드하면 이 맬웨어가 시스템에 침투합니다. 게다가 해커는 특수한 AI 기술을 이용해 시스템을 시뮬레이션하고 보안 취약점을 공격할 수도 있습니다. AI는 사람들이 다운로드 및 설치하고 신분증 번호, 로그인 비밀번호와 같은 정보를 제공할 수 있도록 공안부의 애플리케이션 및 웹사이트의 가짜 이미지와 이름을 사용한 많은 애플리케이션을 만들 수 있습니다. "AI는 또한 보다 정교한 보안 회피 메커니즘과 유연한 소스 코드 변경을 통해 자체 소프트웨어와 하이브리드 맬웨어를 개발할 것입니다." 중령 Nguyen Anh Tuan이 경고했습니다.

[광고2]

출처: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[사진] 칸토시 4월 축제](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/bf5ae82870e648fabfbcc93a25b481ea)

![[사진] 제13기 당중앙위원회 제11차 대표자회 개막](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/f9e717b67de343d7b687cb419c0829a2)

![[사진] 추옹마을 축제의 독특한 민속놀이](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/cff805a06fdd443b9474c017f98075a4)

![[인포그래픽] 2025년 제4회 동탑성 책과 독서문화의 날 다양한 활동](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/a5f00b7d966a475d891f3c3e528c9a66)

댓글 (0)