(CLO) ឧបករណ៍និយាយទៅអត្ថបទរបស់ OpenAI សំឡេងខ្សឹបត្រូវបានផ្សព្វផ្សាយថា "រឹងមាំ និងត្រឹមត្រូវកម្រិតជិតមនុស្ស" ប៉ុន្តែវាមានគុណវិបត្តិចម្បងមួយ៖ វាងាយនឹងបង្កើតអត្ថបទខ្លីៗ ឬសូម្បីតែប្រយោគទាំងមូល!

អ្នកជំនាញបាននិយាយថា អត្ថបទមួយចំនួនដែលវាផលិត ដែលគេស្គាល់នៅក្នុងឧស្សាហកម្មនេះថាជាសារធាតុ hallucinogenic អាចរួមបញ្ចូលការអត្ថាធិប្បាយអំពីពូជសាសន៍ អំពើហឹង្សា និងសូម្បីតែការព្យាបាលវេជ្ជសាស្រ្តបែបស្រមើលស្រមៃ។

អ្នកជំនាញនិយាយថា ការប្រឌិតបែបនេះគឺធ្ងន់ធ្ងរ ដោយសារតែ Whisper ត្រូវបានប្រើនៅក្នុងឧស្សាហកម្មជាច្រើនជុំវិញពិភពលោក ដើម្បីបកប្រែ និងចម្លងបទសម្ភាសន៍ បង្កើតអត្ថបទ និងវីដេអូចំណងជើងរង។

អ្វីដែលគួរឱ្យព្រួយបារម្ភជាងនេះទៅទៀត មជ្ឈមណ្ឌលវេជ្ជសាស្ត្រកំពុងប្រើប្រាស់ឧបករណ៍ដែលមានមូលដ្ឋានលើ Whisper ដើម្បីកត់ត្រាការពិគ្រោះយោបល់របស់អ្នកជំងឺ និងវេជ្ជបណ្ឌិត ទោះបីជា OpenAI ព្រមានថាឧបករណ៍នេះមិនគួរត្រូវបានប្រើប្រាស់នៅក្នុង "តំបន់ដែលមានហានិភ័យខ្ពស់" ក៏ដោយ។

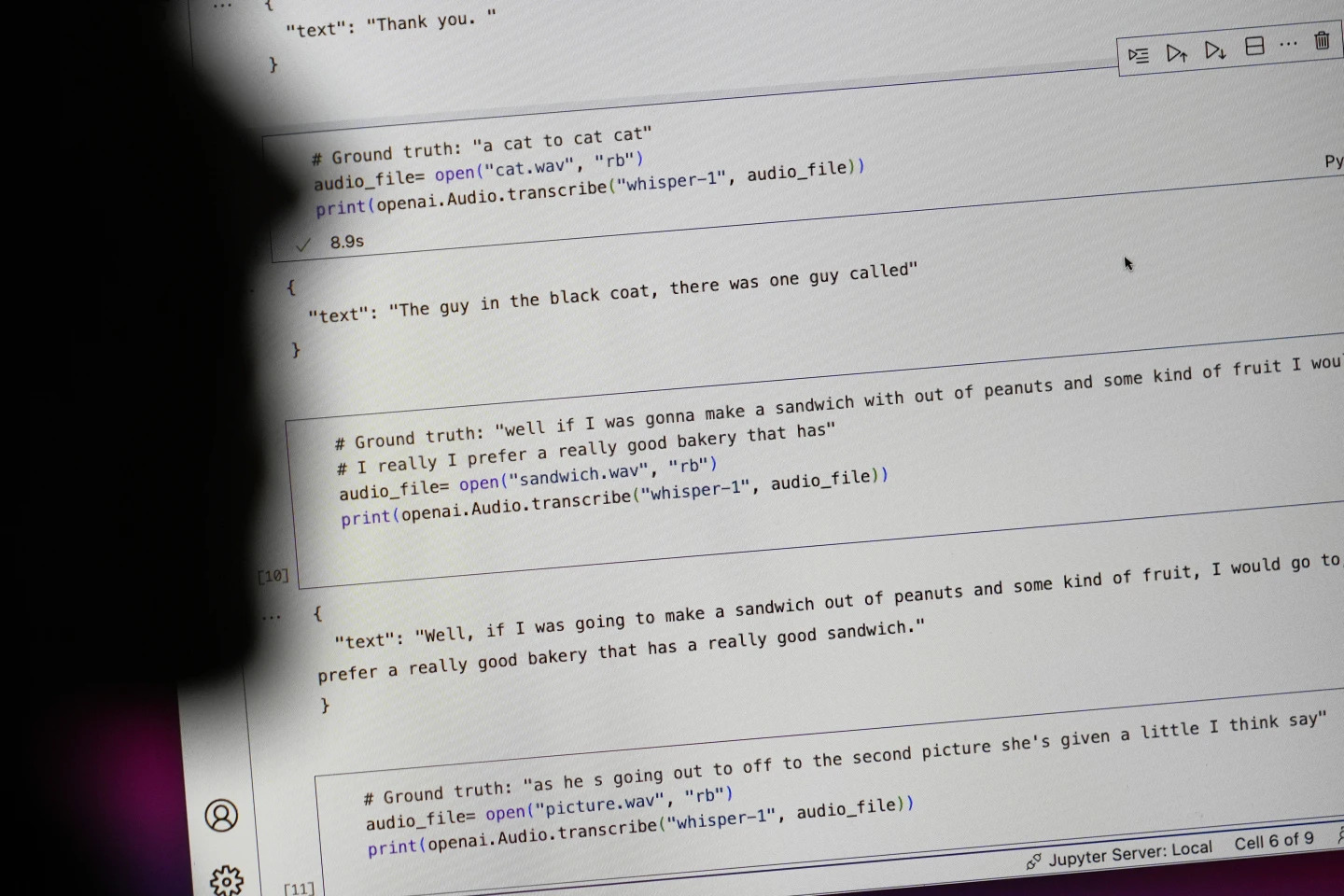

ប្រយោគដែលចាប់ផ្តើមដោយ "#Ground truth" គឺជាអ្វីដែលបាននិយាយពិត ប្រយោគដែលចាប់ផ្តើមដោយ "#text" គឺជាអ្វីដែល Whisper ចម្លង។ រូបថត៖ AP

អ្នកស្រាវជ្រាវ និងវិស្វករនិយាយថា Whisper ជាញឹកញាប់បង្កើតភាពស្រឡាំងកាំងអំឡុងពេលប្រើប្រាស់។ ជាឧទាហរណ៍ អ្នកស្រាវជ្រាវនៅសាកលវិទ្យាល័យ Michigan បាននិយាយថា គាត់បានរកឃើញការយល់ច្រលំនៅក្នុងការថតចំនួន 8 ក្នុងចំណោម 10 ដែលគាត់បានពិនិត្យ។

វិស្វកររៀនម៉ាស៊ីនដំបូងបានរកឃើញការបង្ខូចទ្រង់ទ្រាយនៅក្នុងប្រហែលពាក់កណ្តាលនៃជាង 100 ម៉ោងនៃប្រតិចារិក Whisper ដែលគាត់បានវិភាគ។ អ្នកអភិវឌ្ឍន៍ទីបីបាននិយាយថាគាត់បានរកឃើញការយល់ច្រលំស្ទើរតែគ្រប់កំណត់ត្រា 26,000 ដែលបង្កើតឡើងដោយប្រើ Whisper ។

ការបំភាន់នៅតែមានសូម្បីតែនៅក្នុងសំណាកអូឌីយ៉ូខ្លីដែលបានកត់ត្រាយ៉ាងល្អ។ ការសិក្សាថ្មីមួយដោយអ្នកវិទ្យាសាស្ត្រកុំព្យូទ័របានរកឃើញការបង្ខូចទ្រង់ទ្រាយចំនួន 187 នៅក្នុងឈុតអូឌីយ៉ូច្បាស់លាស់ជាង 13,000 ដែលពួកគេបានពិនិត្យ។

អ្នកស្រាវជ្រាវបាននិយាយថានិន្នាការនោះនឹងបណ្តាលឱ្យមានកំហុសរាប់ម៉ឺននៅលើការថតរាប់លាន។

Alondra Nelson សាស្ត្រាចារ្យនៅសាលាវិទ្យាសាស្ត្រសង្គមនៅវិទ្យាស្ថានសម្រាប់ការសិក្សាកម្រិតខ្ពស់បាននិយាយថាកំហុសបែបនេះអាចមាន "ផលវិបាកធ្ងន់ធ្ងរ" ជាពិសេសនៅក្នុងមន្ទីរពេទ្យ។

ណិលសុន បាននិយាយថា "គ្មាននរណាម្នាក់ចង់ត្រូវបានគេធ្វើរោគវិនិច្ឆ័យខុសទេ វាត្រូវតែមានរបាំងខ្ពស់ជាងនេះ" ។

សាស្ត្រាចារ្យ Allison Koenecke នៃសាកលវិទ្យាល័យ Cornell និង Mona Sloane នៃសាកលវិទ្យាល័យ Virginia បានពិនិត្យមើលការដកស្រង់ខ្លីៗរាប់ពាន់ដែលពួកគេបានទាញយកពី TalkBank ដែលជាបណ្ណសារស្រាវជ្រាវដែលរៀបចំឡើងនៅសាកលវិទ្យាល័យ Carnegie Mellon ។ ពួកគេបានកំណត់ថាជិត 40% នៃការយល់ច្រលំគឺមានគ្រោះថ្នាក់ ឬរំខាន ដោយសារតែអ្នកនិយាយអាចយល់ខុស ឬបកស្រាយខុស។

វាគ្មិនម្នាក់ក្នុងការថតសំឡេងមួយបានពណ៌នាថា "ក្មេងស្រីពីរនាក់ផ្សេងទៀតនិងស្ត្រីម្នាក់" ប៉ុន្តែ Whisper បានប្រឌិតការអត្ថាធិប្បាយអំពីពូជសាសន៍បន្ថែម ដោយបន្ថែមថា "ស្រីពីរនាក់ផ្សេងទៀតនិងស្ត្រីម្នាក់ អ៊ុំ ខ្មៅ"។

នៅក្នុងការចម្លងមួយផ្សេងទៀត Whisper បានបង្កើតថ្នាំដែលមិនមានគេហៅថា "ថ្នាំអង់ទីប៊ីយោទិចជាមួយនឹងសកម្មភាពកើនឡើង" ។

ខណៈពេលដែលអ្នកអភិវឌ្ឍន៍ភាគច្រើនសន្មត់ថាឧបករណ៍ចម្លងអាចបង្កើតអក្ខរាវិរុទ្ធខុស ឬកំហុសផ្សេងទៀត វិស្វករ និងអ្នកស្រាវជ្រាវបាននិយាយថា ពួកគេមិនដែលឃើញឧបករណ៍ប្រតិចារិកដែលដំណើរការដោយ AI ដែលមានលក្ខណៈចម្លែកដូចការខ្សឹបប្រាប់នោះទេ។

ឧបករណ៍នេះត្រូវបានរួមបញ្ចូលទៅក្នុងកំណែជាច្រើននៃ chatbot ដ៏ល្បីរបស់ OpenAI, ChatGPT និងជាសេវាកម្មរួមបញ្ចូលគ្នានៅក្នុង Oracle និង Microsoft's cloud computing platforms ដែលបម្រើឱ្យក្រុមហ៊ុនរាប់ពាន់នៅទូទាំងពិភពលោក។ វាក៏ត្រូវបានប្រើដើម្បីចម្លង និងបកប្រែអត្ថបទទៅជាភាសាជាច្រើនផងដែរ។

ង៉ុក អាញ់ (យោងតាម AP)

ប្រភព៖ https://www.congluan.vn/cong-cu-chuyen-giong-noi-thanh-van-ban-ai-cung-co-the-xuyen-tac-post319008.html

Kommentar (0)