マーク・ザッカーバーグ氏は1月18日のインスタグラムリールの投稿で、同社のAIに関する「将来のロードマップ」には「大規模なコンピューティングインフラ」の構築が必要だと述べた。 2024 年末までに、このインフラストラクチャは 350,000 個の Nvidia H100 チップによって提供される予定です。

Meta CEO は、購入したグラフィック処理装置 (GPU) の数を明らかにしていないが、H100 は 2022 年後半に発売される予定であり、供給は非常に限られている。レイモンド・ジェームスのアナリストは、Nvidia が H100 を 25,000 ドルから 30,000 ドルで販売すると見積もっている。 eBayでは、このチップの価格は4万ドルを超えることもある。 Meta を安値で買収した場合、そのコストは 90 億ドル近くになるだろう。

さらにザッカーバーグ氏は、他のGPUも含めると、インフラの計算能力は60万台のH100に相当するとも明らかにした。 2023年12月、Meta、OpenAI、Microsoftは、AMDの新しいInstinct MI300X AIチップを使用すると発表した。

Metaがこのような「高性能」なコンピュータチップを必要とする理由は、同社が汎用人工知能(AGI)の実現を目指しているためであり、ザッカーバーグ氏はこれを同社の「長期ビジョン」と呼んでいる。 OpenAI と Google DeepMind も、人間の知能に匹敵する未来の AI である AGI に取り組んでいます。

Metaの主任科学者Yann LeCun氏は、先月米国サンフランシスコで開催されたイベントでGPUの重要性を強調した。 AGI が欲しいなら、GPU をさらに購入する必要があると彼は考えています。 「AI戦争が起こっており、彼(Nvidia CEOのジェンスン・フアン)がその武器を提供しているのです。」

メタは2023年第3四半期の収益報告で、2024年の総支出はコンピューティング能力の拡大も含め、940億ドルから990億ドルの範囲になると述べた。同グループのトップはアナリストとの会合で、 「投資の優先順位で言えば、AIは技術面でもコンピューティングリソース面でも2024年に最大の投資分野になるだろう」とも断言した。

また1月18日、ザッカーバーグ氏は同社が開発中のAGIを「責任を持って」オープンソース化する計画であると述べた。これは大規模なLlama言語ファミリーと同様のアプローチだ。 Meta は Llama 3 をトレーニングしており、Fundamental AI Research (FAIR) と GenAI の研究チームを結集して、より緊密に連携する予定です。

ザッカーバーグ氏の投稿から間もなく、エンジニアのルカン氏はXにこう投稿した。 「プロセスを迅速化するために、FAIRは現在、AI製品部門であるGenAIの姉妹組織となっています。」

(CNBCによると)

[広告2]

ソース

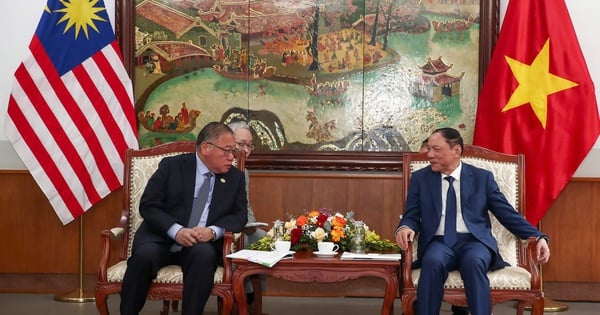

![[写真] ト・ラム事務総長が決議第18-NQ/TW号の実施状況を検討する第3回会議を主宰](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/14/10f646e55e8e4f3b8c9ae2e35705481d)

コメント (0)