En mayo de 2024, gigantes tecnológicos de fama mundial se sucedieron para lanzar nuevas versiones de inteligencia artificial (IA), como OpenAI con GPT-4o, Google con Gemini 1.5 Pro... con muchas funciones "súper inteligentes" añadidas para optimizar la experiencia del usuario. Sin embargo, es innegable que esta tecnología está siendo utilizada por ciberdelincuentes en numerosos escenarios de fraude en línea.

Aumento del riesgo

En una conferencia reciente, el viceministro de Información y Comunicaciones, Pham Duc Long, destacó el hecho de que los ataques cibernéticos aumentan continuamente con una creciente sofisticación y complejidad. Especialmente cuando hay soporte de IA, los riesgos que enfrentan los usuarios aumentarán exponencialmente. "Los ciberdelincuentes están utilizando la tecnología de inteligencia artificial para crear fácilmente nuevo malware y nuevos y sofisticados ataques de phishing...", advirtió el viceministro Pham Duc Long.

Según un informe del Departamento de Seguridad de la Información del Ministerio de Información y Comunicaciones, los riesgos de ciberseguridad relacionados con la IA han causado más de 1 billón de dólares en daños en todo el mundo, de los cuales entre 8.000 y 10.000 mil millones de VND solo en Vietnam. El uso más común hoy en día es el uso de IA para falsificar voces y rostros con fines fraudulentos. Se prevé que para 2025 habrá alrededor de 3.000 ataques/segundo, 12 malware/segundo y 70 nuevas vulnerabilidades y debilidades/día.

Según el Sr. Nguyen Huu Giap, director de BShield, empresa especializada en soporte de seguridad para aplicaciones, crear imágenes y voces falsas no es difícil con el avance de la IA. Los estafadores pueden recopilar fácilmente datos de los usuarios a partir de información pública que publican en redes sociales o mediante trucos como entrevistas de trabajo en línea y llamadas telefónicas bajo el nombre de "autoridades". En una simulación realizada por BShield, a partir del rostro disponible a través de una videollamada, el defraudador puede ponerlos en el papel CCCD, fusionarlos con el cuerpo de una persona en movimiento para engañar a la herramienta eKYC y ser reconocido por el sistema como una persona real.

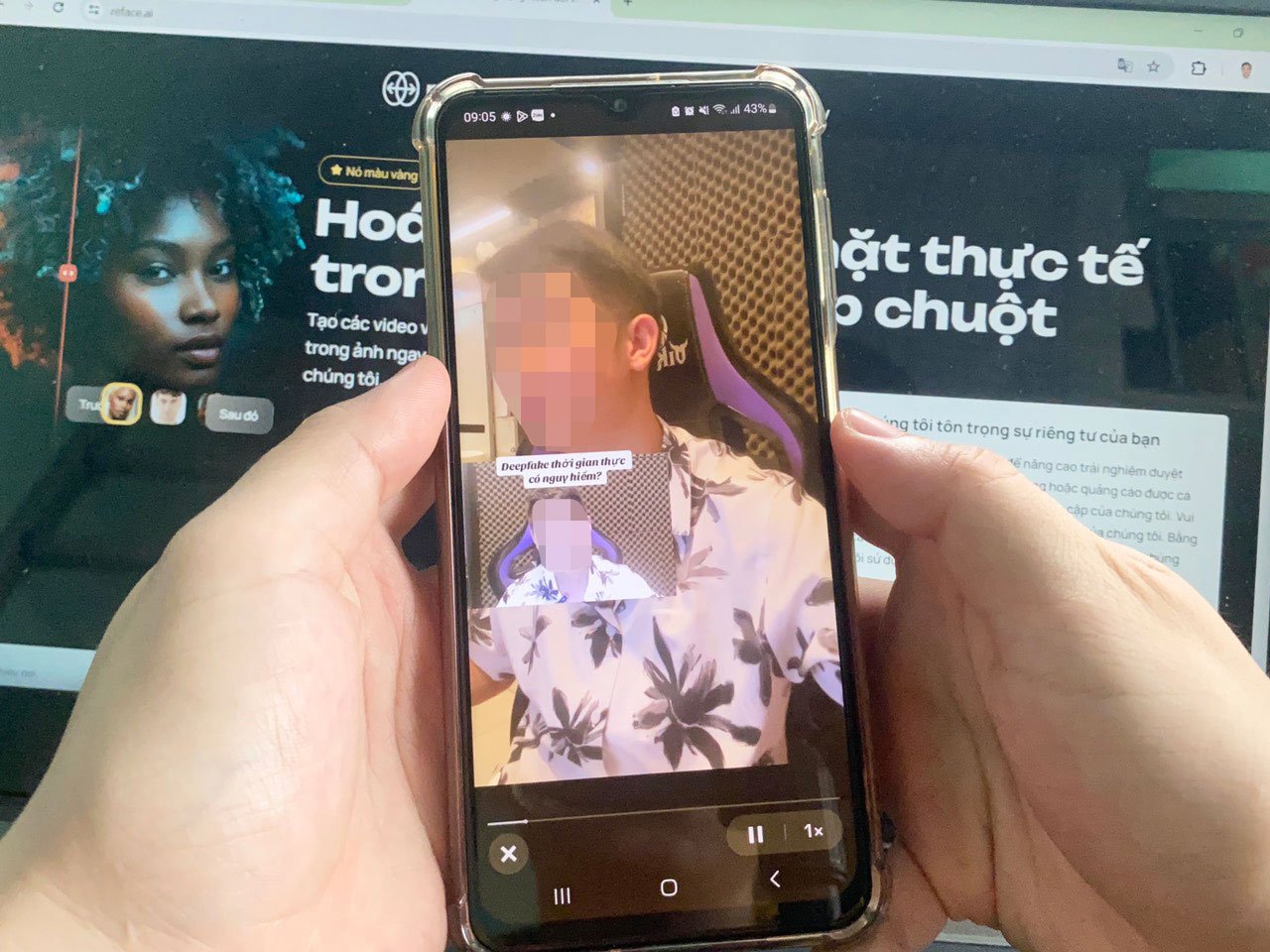

Los métodos fraudulentos que utilizan tecnología deepfake están aumentando y volviéndose más sofisticados. Foto: LE TINH

Desde la perspectiva del usuario, el Sr. Nguyen Thanh Trung, un especialista en TI de Ciudad Ho Chi Minh, está preocupado de que los malhechores puedan aprovechar chatGPT para crear correos electrónicos fraudulentos con contenido y estilo de redacción similares a los correos electrónicos reales de bancos u organizaciones acreditadas. Es probable que estos correos electrónicos contengan malware adjunto y, si los usuarios hacen clic en él, sus datos serán robados y sus activos apropiados. "El software de inteligencia artificial está mejorando cada vez más. Permite crear videos falsos con rostros y voces 95% similares a los de personas reales. Los gestos cambian en tiempo real, lo que dificulta mucho su detección por parte de los espectadores", afirmó Trung.

Corredor legal completo pronto

Para limitar el riesgo de fraude de alta tecnología, el experto en seguridad Pham Dinh Thang señaló que los usuarios necesitan actualizar periódicamente sus conocimientos sobre IA y no hacer clic en enlaces de origen desconocido. Para las empresas, se debe asignar presupuesto para garantizar la seguridad de los datos y las operaciones del sistema. El personal de la empresa también necesita recibir capacitación profunda para acceder a las vulnerabilidades reales que ocurren en el sistema, aumentando la capacidad de identificar tipos de ataques cibernéticos.

El Sr. Ta Cong Son, Jefe del Departamento de Desarrollo de IA - Proyecto Antifraude, dijo que la IA ha estado penetrando profundamente en las vidas de los usuarios y las operaciones de empresas, agencias y unidades gracias a sus funciones de soporte extremadamente inteligentes. Cabe destacar que la tecnología de IA actualmente es muy accesible y fácil de usar, lo que creará condiciones para que actores maliciosos la aprovechen fácilmente con fines fraudulentos. Los estafadores también cambian constantemente sus métodos de ataque, por lo que los usuarios deben actualizar la información periódicamente para saber cómo prevenirlos, recomendó el Sr. Son.

Según los expertos, los modelos GPT-4o y Gemini 1.5 Pro recientemente actualizados han demostrado que la inteligencia de la IA no tiene límites. Por lo tanto, además de alentar a las empresas a desarrollar herramientas y soluciones antifraude de IA, las agencias de gestión deben completar pronto el corredor legal sobre IA para mantenerse a la vanguardia de la tendencia.

El teniente coronel Nguyen Anh Tuan, subdirector del Centro Nacional de Datos de Población, dijo que es necesario emitir pronto documentos que regulen la ética y las responsabilidades de los proveedores de servicios nacionales y extranjeros en el proceso de desarrollo, producción, aplicación y uso de IA. Al mismo tiempo, es necesario que existan regulaciones específicas sobre estándares técnicos para los sistemas que utilizan, aplican, conectan y brindan servicios de IA. Es necesario investigar y aplicar proyectos de IA para combatir sus riesgos. Dado que la IA es creada por humanos y producto del conocimiento, existirán variantes de "IA buena" e "IA mala", por lo que es posible prevenir el desarrollo de la inteligencia artificial con la propia inteligencia artificial, señaló el coronel Tuan.

Desafíos de la ciberseguridad

El teniente coronel Nguyen Anh Tuan reconoció que la IA plantea desafíos a la ciberseguridad. En consecuencia, el malware respaldado por IA se puede instalar en archivos de documentos. Cuando los usuarios cargan archivos de documentos, este malware penetrará en el sistema. Además, gracias a tecnologías especiales de inteligencia artificial, los piratas informáticos pueden simular sistemas y atacar agujeros de seguridad. La IA puede crear muchas aplicaciones con imágenes falsas y nombres de aplicaciones y sitios web del Ministerio de Seguridad Pública para que las personas las descarguen, instalen y proporcionen información como el número de documento de identidad y la contraseña de inicio de sesión. "AI también desarrollará su propio software y malware híbrido, con mecanismos de evasión de seguridad más sofisticados y cambios de código fuente flexibles", advirtió el teniente coronel Nguyen Anh Tuan.

[anuncio_2]

Fuente: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[Foto] El Primer Ministro Pham Minh Chinh recibe al Sr. Jefferey Perlman, Director Ejecutivo de Warburg Pincus Group (EE. UU.)](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/18/c37781eeb50342f09d8fe6841db2426c)

![[ACTUALIZACIÓN] Ensayo del desfile del 30 de abril en la calle Le Duan frente al Palacio de la Independencia](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/18/8f2604c6bc5648d4b918bd6867d08396)

Kommentar (0)