Ein Forschungsteam für künstliche Intelligenz (KI) an der Polytechnischen Universität Valencia in Spanien hat herausgefunden, dass große Sprachmodelle, je größer und komplexer sie werden, den Benutzern gegenüber immer seltener eingestehen, dass sie die Antwort nicht wissen. [Anzeige_1]

|

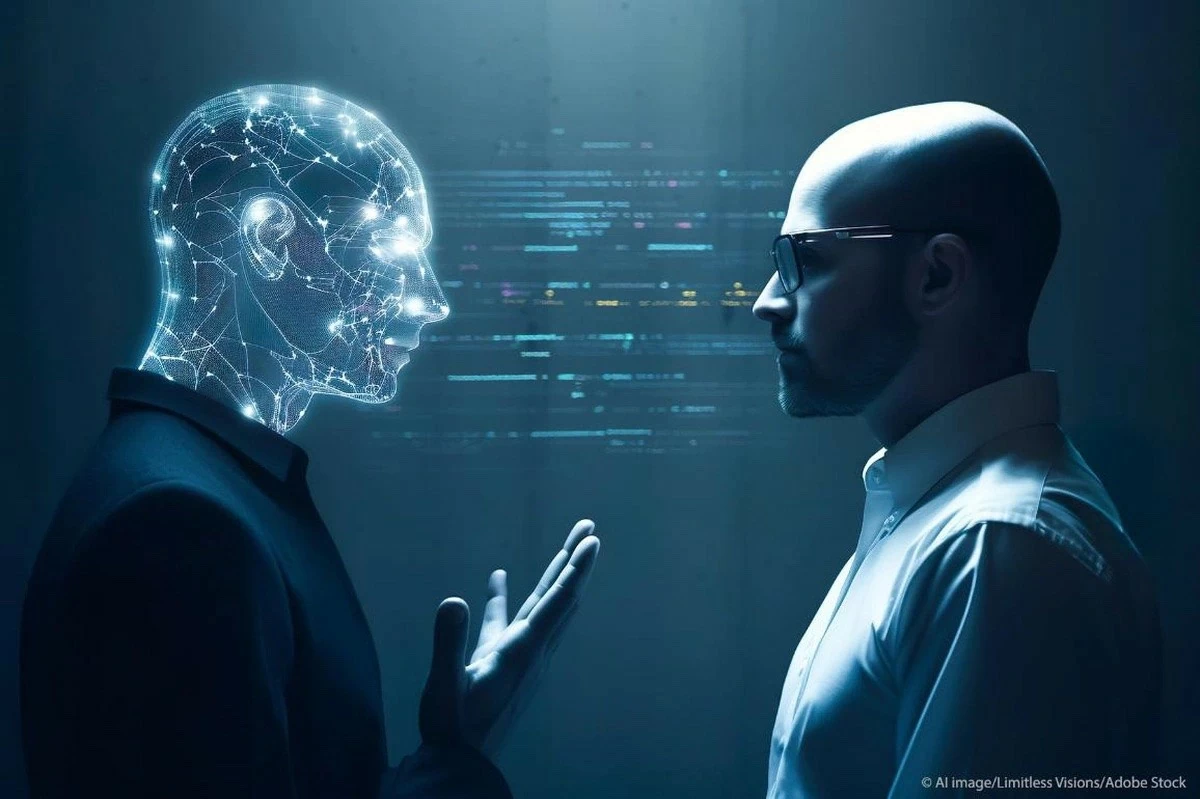

| Je intelligenter die KI wird, desto unwahrscheinlicher ist es, dass sie den Benutzern gegenüber zugibt, dass sie die Antwort nicht weiß. (Illustrationsbild AI) |

In der in der Fachzeitschrift Nature veröffentlichten Studie testete das Team die neuesten Versionen von drei der beliebtesten KI-Chatbots auf Reaktionsfähigkeit, Genauigkeit und die Fähigkeit der Benutzer, falsche Antworten zu erkennen.

Um die Genauigkeit der drei beliebtesten LLMs BLOOM, LLaMA und GPT zu testen, stellte das Team Tausende von Fragen und verglich die erhaltenen Antworten mit Antworten aus früheren Versionen auf dieselben Fragen. Sie unterscheiden sich auch in den Themenbereichen, darunter Mathematik, Naturwissenschaften, Worträtsel und Geographie, sowie in der Fähigkeit, Text zu erstellen oder Aktionen wie das Sortieren von Listen auszuführen.

Die Studienergebnisse zeigten einige bemerkenswerte Trends. Die Gesamtgenauigkeit von Chatbots verbessert sich mit jeder neuen Version, sinkt jedoch immer noch, wenn es um schwierigere Fragen geht. Überraschenderweise gehen LLMs mit zunehmender Größe und Komplexität weniger offen mit ihrer Fähigkeit um, Fragen richtig zu beantworten.

In früheren Versionen waren die meisten LLMs den Benutzern gegenüber offen, wenn sie eine Antwort nicht finden konnten oder weitere Informationen benötigten. Im Gegensatz dazu neigen neuere Versionen dazu, mehr zu raten, was insgesamt zu mehr Antworten führt, darunter sowohl richtige als auch falsche. Noch beunruhigender ist das Ergebnis der Studie, dass alle LLMs selbst auf einfache Fragen gelegentlich falsche Antworten gaben. Dies deutet darauf hin, dass ihre Zuverlässigkeit weiterhin verbesserungswürdig ist.

Diese Erkenntnisse verdeutlichen ein Paradoxon in der Entwicklung der KI: Während die Modelle immer leistungsfähiger werden, werden ihre Grenzen möglicherweise auch weniger transparent.

Dies stellt neue Herausforderungen an die Nutzung und das Vertrauen in KI-Systeme dar. Die Benutzer müssen vorsichtiger sein und die Entwickler müssen sich darauf konzentrieren, nicht nur die Genauigkeit, sondern auch das „Selbstbewusstsein“ der Modelle zu verbessern.

[Anzeige_2]

Quelle: https://baoquocte.vn/cang-thong-minh-tri-tue-nhan-tao-cang-co-xu-huong-giau-dot-287987.html

![[Foto] Generalsekretär To Lam empfängt den französischen Botschafter in Vietnam, Olivier Brochet](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/49224f0f12e84b66a73b17eb251f7278)

![[Foto] Abschluss des 4. Gipfels der Partnerschaft für grünes Wachstum und die globalen Ziele](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/c0a0df9852c84e58be0a8b939189c85a)

![[Foto] Förderung von Freundschaft, Solidarität und Zusammenarbeit zwischen den Armeen und Völkern beider Länder](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/0c4d087864f14092aed77252590b6bae)

![[Foto] Der Vorsitzende der Nationalversammlung, Tran Thanh Man, trifft sich mit herausragenden Arbeitern der Öl- und Gasindustrie](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/1d0de4026b75434ab34279624db7ee4a)

![[Foto] Die Zeitung Nhan Dan kündigt das Projekt „Love Vietnam so much“ an.](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/362f882012d3432783fc92fab1b3e980)

![[Foto] Begrüßungszeremonie für den chinesischen Verteidigungsminister und die Delegation zum Freundschaftsaustausch](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/fadd533046594e5cacbb28de4c4d5655)

![[Video] Viettel nimmt offiziell die größte optische Unterseekabelleitung Vietnams in Betrieb](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/f19008c6010c4a538cc422cb791ca0a1)

Kommentar (0)