«Крестные отцы ИИ», лауреаты премии VinFuture 2024, считают, что ученым необходимо гарантировать, что сценарии использования ИИ не будут угрожать выживанию человечества.

Сегодня, 7 декабря, лауреаты премии VinFuture 2024 пообщались со студентами и молодыми учеными Университета VinUni, обсудив научные исследования, а также будущие перспективы направлений, в которых они работают. Здесь лауреаты главных премий, блестящие ученые, чьи новаторские работы заложили основу сегодняшней революции в области искусственного интеллекта, рассказали о невероятных достижениях в области искусственного интеллекта.

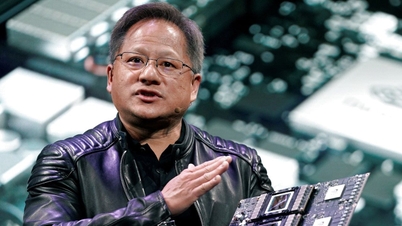

Профессор Янн Лекун (в центре) и профессор Йошуа Бенджио (слева на обложке) на сессии обмена опытом

«Мы чувствуем, что перенеслись на 10 лет в будущее».

Профессор Джеффри Хинтон из Университета Торонто (Канада) не приехал во Вьетнам для получения награды, но принял участие в обмене мнениями по видеосвязи . В 2018 году он, наряду с профессором Яном Лекуном и профессором Йошуа Бенджио, получил премию Тьюринга (премию, считающуюся Нобелевской премией в области компьютерных наук), и все они называются в международных СМИ «крестными отцами ИИ». Теперь все трое продолжают получать главную награду VinFuture 2024 вместе с двумя другими учеными: профессором Фэй Фэй Ли (США) и г-ном Дженсеном Хуаном (генеральным директором NVIDIA).

По словам профессора Хинтона, недавний бум в области искусственного интеллекта является результатом трех факторов. Первое — это исследования, направленные на разработку более эффективных методов обучения нейронных сетей, которые проводились им, профессором Йошуа, профессором Янном и многими другими. Кроме того, существуют чрезвычайно высокие вычислительные возможности графических процессоров (GPU) и огромный объем данных, которые мы можем собрать.

Профессор Джеффри Хинтон делится видео

«Важным аспектом этой награды (VinFuture 2024) является признание работы г-на Дженсена Хуанга по созданию новаторских плат GPU, полезных для ИИ. Сочетание платы GPU Дженсена Хуанга и наборов данных профессора Фэй Фэй Ли сыграло важную роль в современном развитии ИИ. Замечательно, что их работа признана наряду с работами над алгоритмами нейронных сетей», — сказал профессор Хинтон.

«Мы обнаружили, что когда мы использовали графические процессоры для обучения нейронных сетей, они были в 30 раз быстрее. Это был квантовый скачок. Это было похоже на то, что скорость вычислений опережала свое время на 10 лет. Внезапно мы оказались на 10 лет впереди будущего с точки зрения скорости вычислений. Это было полным изменением правил игры для ИИ, это было потрясающе!» сказал профессор Хинтон.

Сегодня ученые продолжают стремиться к более глубокому пониманию связей внутри нейронных сетей. Это помогло бы ученым создать тип искусственного интеллекта, более похожий на человеческий, и могло бы даже объяснить интуицию. Традиционный логический подход никогда этого не делал.

«Я начинаю бояться ИИ»

Профессор Хинтон отметил, что современные крупные нейронные сети обладают интуицией, схожей с человеческой. С прошлого года он выразил обеспокоенность тем, что может потребоваться всего от пяти до 20 лет, чтобы искусственный интеллект стал таким же разумным, как человек. «Вот тогда я и начал бояться ИИ. Остановка разработки — не вариант. Поэтому единственный вариант — попытаться выяснить, как обеспечить его безопасность, когда он станет умнее нас», — поделился профессор Хинтон.

«Но я не думаю, что конец света неизбежен», — говорит профессор Хинтон. «Но нельзя игнорировать возможности, и нам нужно усердно работать, чтобы предотвратить это. Надеюсь, самые талантливые студенты выберут изучение безопасности ИИ, рассматривая широкий спектр угроз, от долгосрочных угроз, таких как захват ИИ, до краткосрочных угроз, таких как киберпреступность».

Профессор Йошуа Бенджио и профессор Ян ЛеКун

Профессор Янн Лекун заявил, что его также беспокоит риск того, что когда ИИ станет таким же разумным, как люди, он начнет доминировать над людьми. Однако на данный момент ответ — нет. «Мы можем проиграть, играя в шахматы с маленькой игрушкой стоимостью 30 евро. Опасно ли это? Ответ — нет. ИИ становится опасным только тогда, когда мы создаем мотивацию (человеческий контроль) для ИИ. Но сейчас у ИИ есть только знания, а не мотивация», — сказал профессор Янн.

По словам профессора Янна, создание ИИ, который активно служит людям, — это всего лишь техническая проблема. Поскольку ИИ умен, думать, что ИИ будет доминировать над людьми, является предубеждением, поскольку реальность показывает, что в обществе было много умных людей, но они не доминировали над миром ! ИИ по-прежнему остается инструментом, проблема в людях, а не в ИИ.

По словам профессора Йошуа Бенджио, мы не можем быть субъективными, даже небольшая проблема может повлиять на выживание человечества. Люди могут мотивировать машины. Например, кто-то хочет превратить машину в человека, наделив машину потребностью «выживать», мы хотим выключить машину, но она не выключается. «Конечно, мы должны быть уверены, что такой сценарий не повторится», — сказал профессор Бенжио.

Источник: https://thanhnien.vn/vinfuture-award-2024-khong-de-ai-de-doa-su-ton-vong-cua-nhan-loai-185241207195331155.htm

![[Фото] Более 17 000 кандидатов принимают участие в тесте по оценке компетенций SPT 2025 года в Ханойском национальном педагогическом университете](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/17/e538d9a1636c407cbb211b314e6303fd)

![[Фото] Национальная конференция по распространению и реализации резолюции № 66-NQ/TW и резолюции № 68-NQ/TW Политбюро](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/adf666b9303a4213998b395b05234b6a)

![[Фото] Генеральный секретарь То Лам посещает выставку достижений в развитии частной экономики](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/1809dc545f214a86911fe2d2d0fde2e8)

![[Фото] Премьер-министр Фам Минь Чинь председательствует на совещании по развитию науки и технологий](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/17/ae80dd74c384439789b12013c738a045)

Комментарий (0)