최근, 중국어 위키피디아와 유사한 서비스인 바이두 바이커(Baidu Baike)가 robots.txt 파일을 업데이트했습니다. 이 파일은 검색 엔진에 접근할 수 있는 웹 주소를 알려주는 파일이며, Googlebot과 Bingbot이 플랫폼의 콘텐츠를 인덱싱하는 것을 완전히 차단했습니다.

사진: Shutterstock

이번 조치는 인공지능(AI) 모델과 애플리케이션을 개발하는 데 필요한 빅데이터에 대한 수요가 증가함에 따라 바이두가 온라인 자산을 보호하기 위한 노력을 보여주는 것입니다.

바이두 바이커의 robots.txt 업데이트 이후, SCMP 조사 결과 해당 플랫폼의 많은 항목이 이전에 보관된 오래된 콘텐츠에서 나온 것으로 추정되는 Google 및 Bing 검색 결과에 여전히 표시되고 있는 것으로 나타났습니다.

OpenAI가 ChatGPT를 출시한 지 2년이 넘은 가운데, 전 세계의 주요 AI 개발자 중 다수가 콘텐츠 게시자와 계약을 맺고 GenAI 프로젝트에 필요한 고품질 콘텐츠에 액세스하고 있습니다.

OpenAI는 6월에 타임지와 계약을 맺고 100년 이상의 역사를 담은 이 잡지의 전체 기록 보관소에 접근하기로 했습니다.

카오퐁 (SCMP에 따르면)

[광고2]

출처: https://www.congluan.vn/baidu-chan-google-va-bing-thu-thap-noi-dung-truc-tuyen-post309081.html

![[사진] Pham Minh Chinh 총리가 지역 및 국제 금융 센터 운영위원회 첫 회의를 주재](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/47dc687989d4479d95a1dce4466edd32)

![[사진] 수도청년들, 소방·수상구조 기술 열정적으로 연습](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3f8481675271488abc7b9422a9357ada)

![[사진] 호치민시, 4월30일 연휴 앞두고 보도 보수작업 속도 높여](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/17f78833a36f4ba5a9bae215703da710)

![[사진] 베트남 인민군 구출대, 잠시의 휴식](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/a2c91fa05dc04293a4b64cfd27ed4dbe)

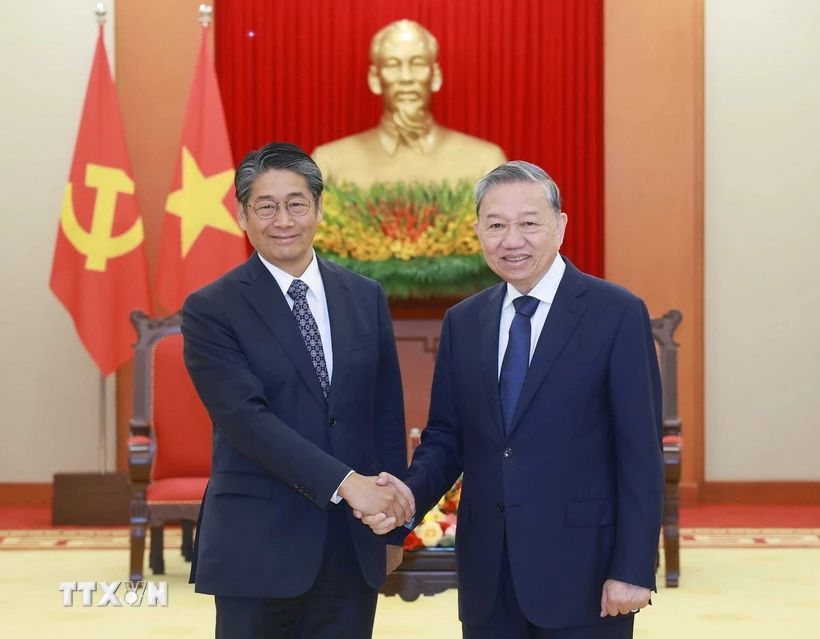

![[사진] 토람 사무총장, 베트남 주재 일본대사 이토 나오키 접견](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3a5d233bc09d4928ac9bfed97674be98)

![[사진] 미국이 상호 관세 발표 후 총리 Pham Minh Chinh가 회의를 주재](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/ee90a2786c0a45d7868de039cef4a712)

댓글 (0)