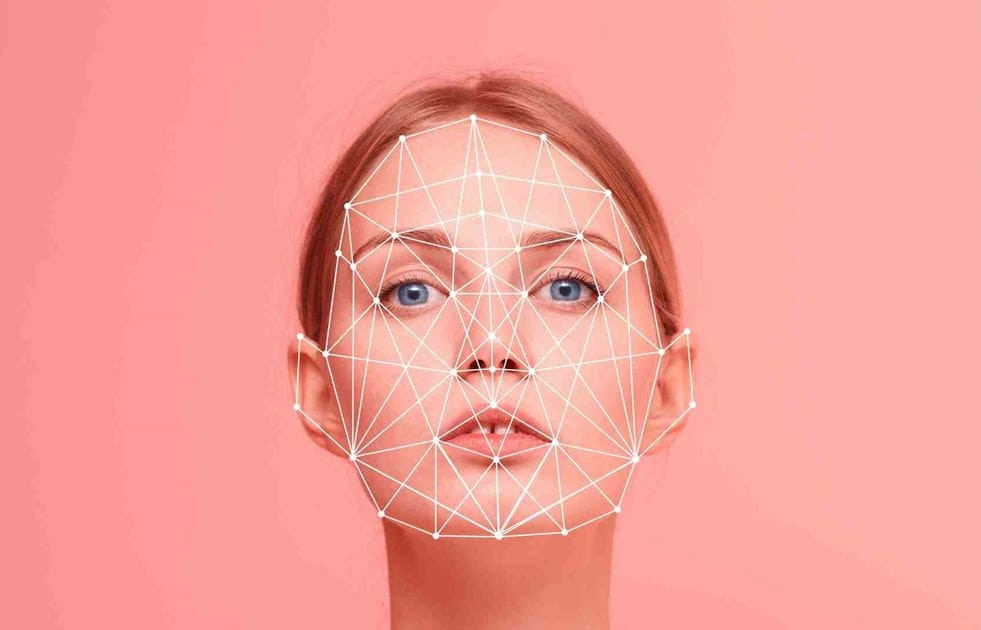

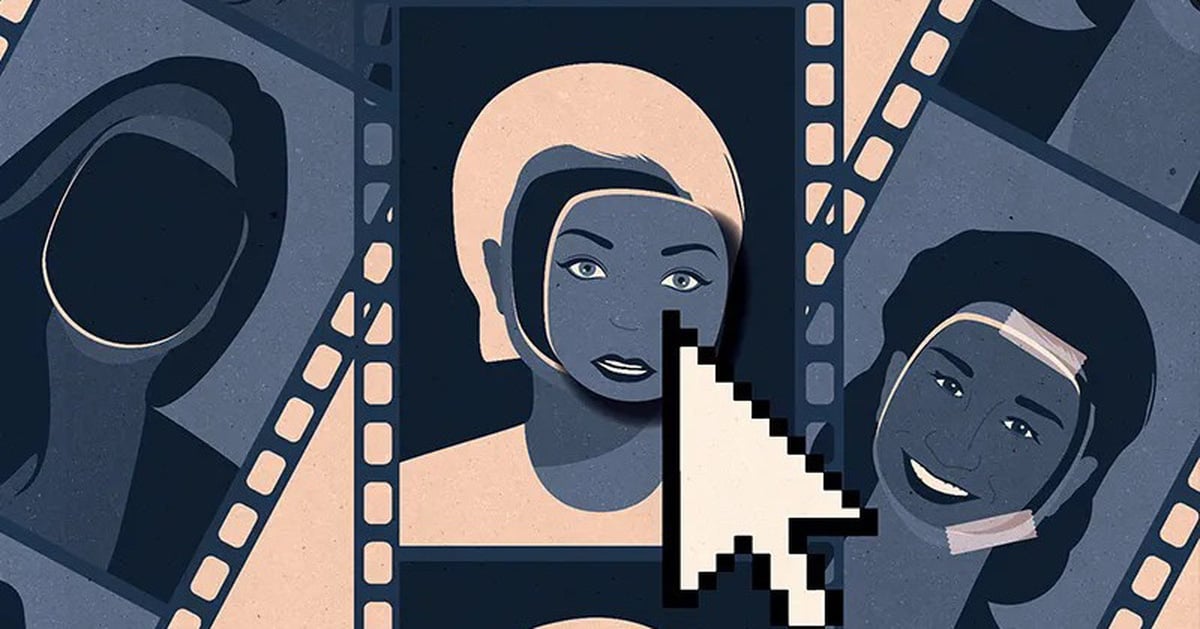

Deepfake គឺជាពាក្យដែលបង្កើតឡើងដោយការរួមបញ្ចូលគ្នារវាង 'Deep Learning' និង 'Fake' ។ និយាយឱ្យសាមញ្ញ វាគឺជាបច្ចេកវិទ្យានៃការក្លែងធ្វើ និងបង្កើតផលិតផលអូឌីយ៉ូ រូបភាព ឬវីដេអូក្លែងក្លាយ។

ចាប់តាំងពីការផ្ទុះនៃការអភិវឌ្ឍន៍បញ្ញាសិប្បនិមិត្ត (AI) បញ្ហានៃការក្លែងបន្លំកាន់តែមានភាពពេញនិយមកាន់តែខ្លាំងឡើង បង្កើតបានជារលកនៃព័ត៌មានមិនពិតដែលរីករាលដាលនៅក្នុងសារព័ត៌មាន។ ដូច្នេះ ការផ្ទៀងផ្ទាត់យ៉ាងសកម្មនូវប្រភពដើមនៃរូបភាព និងវីដេអូ គឺជាបញ្ហាបន្ទាន់សម្រាប់ក្រុមហ៊ុនកាមេរ៉ាឈានមុខគេរបស់ពិភពលោក។

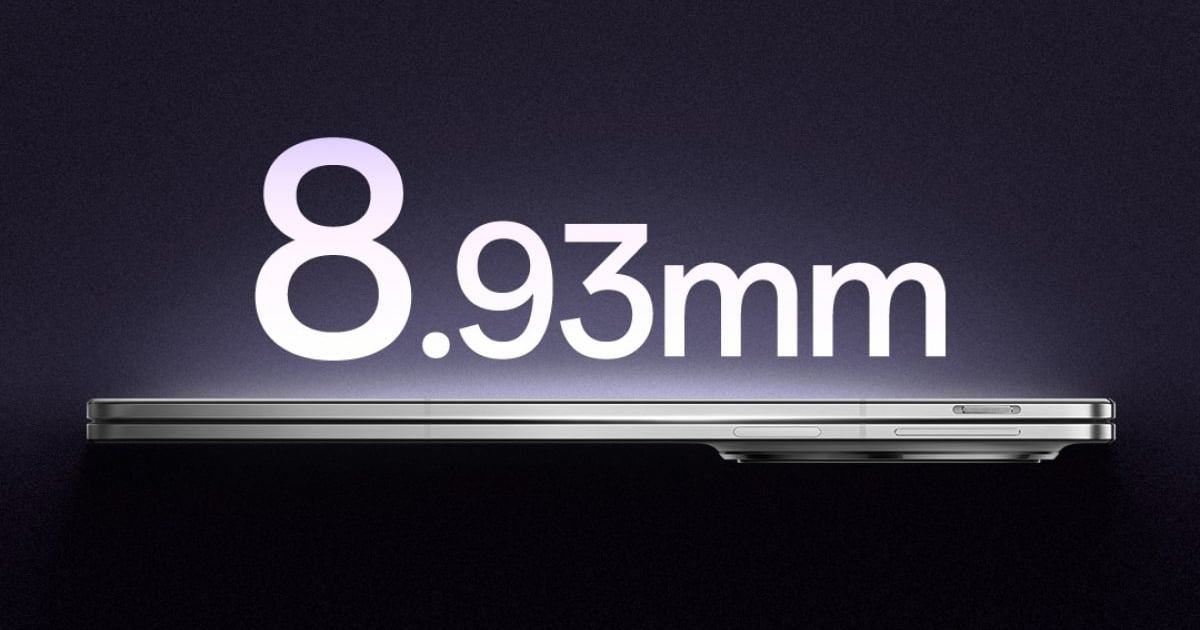

Sony, Canon និង Nikon ត្រូវបានគេរំពឹងថានឹងចាប់ផ្តើមខ្សែកាមេរ៉ាឌីជីថលដែលគាំទ្រហត្ថលេខាឌីជីថលដោយផ្ទាល់នៅលើខ្សែកាមេរ៉ា Mirrorless (ឬកាមេរ៉ាឌីជីថល DSLR) ដែលពួកគេផលិត។ កិច្ចខិតខំប្រឹងប្រែងដើម្បីអនុវត្តហត្ថលេខាឌីជីថលនៅលើកាមេរ៉ាគឺជាវិធានការដ៏សំខាន់បំផុត បង្កើតភស្តុតាងនៃប្រភពដើម និងភាពសុចរិតនៃរូបភាព។

ហត្ថលេខាឌីជីថលទាំងនេះនឹងរួមបញ្ចូលព័ត៌មានអំពីកាលបរិច្ឆេទ ពេលវេលា ទីតាំង អ្នកថតរូប ហើយនឹងមានការភ័ន្តច្រឡំ។ នេះមានសារៈសំខាន់ជាពិសេសសម្រាប់អ្នកសារព័ត៌មាន និងអ្នកជំនាញផ្សេងទៀត ដែលការងាររបស់ពួកគេទាមទារការផ្ទៀងផ្ទាត់។

ក្រុមហ៊ុនយក្សឧស្សាហកម្មកាមេរ៉ាចំនួនបីបានយល់ព្រមលើស្តង់ដារសកលសម្រាប់ហត្ថលេខាឌីជីថលដែលត្រូវគ្នាជាមួយឧបករណ៍ផ្ទៀងផ្ទាត់តាមអ៊ីនធឺណិត Verify ។ បើកដំណើរការដោយសម្ព័ន្ធសកលនៃអង្គការព័ត៌មាន ក្រុមហ៊ុនបច្ចេកវិទ្យា និងក្រុមហ៊ុនផលិតកាមេរ៉ា ឧបករណ៍នេះនឹងអនុញ្ញាតឱ្យមានការផ្ទៀងផ្ទាត់ដោយឥតគិតថ្លៃអំពីភាពត្រឹមត្រូវនៃរូបភាពណាមួយ។ ប្រសិនបើរូបភាពត្រូវបានបង្កើត ឬកែប្រែដោយប្រើ AI នោះ Verify នឹងសម្គាល់ពួកវាថា 'គ្មានព័ត៌មានផ្ទៀងផ្ទាត់ខ្លឹមសារ'។

សារៈសំខាន់នៃបច្ចេកវិទ្យាប្រឆាំងនឹងការក្លែងបន្លំយ៉ាងជ្រៅគឺកើតចេញពីការកើនឡើងយ៉ាងឆាប់រហ័សនៃការក្លែងបន្លំយ៉ាងជ្រៅនៃឥស្សរជនល្បីៗដូចជាអតីតប្រធានាធិបតីសហរដ្ឋអាមេរិក Donald Trump និងនាយករដ្ឋមន្ត្រីជប៉ុន Fumio Kishida ។

លើសពីនេះទៀត អ្នកស្រាវជ្រាវមកពីសាកលវិទ្យាល័យ Tsinghua ក្នុងប្រទេសចិនបានបង្កើតគំរូ AI ជំនាន់ថ្មី ដែលមានសមត្ថភាពបង្កើតរូបភាពប្រហែល 700,000 ក្នុងមួយថ្ងៃ។

ក្រៅពីក្រុមហ៊ុនផលិតកាមេរ៉ា ក្រុមហ៊ុនបច្ចេកវិទ្យាផ្សេងទៀតក៏កំពុងចូលរួមក្នុងការប្រយុទ្ធប្រឆាំងនឹងការក្លែងបន្លំជ្រៅផងដែរ។ Google បានបញ្ចេញឧបករណ៍មួយសម្រាប់រូបភាពឌីជីថលដែលបង្កើតដោយ AI ទឹកខណៈដែល Intel បានបង្កើតបច្ចេកវិទ្យាដែលវិភាគការផ្លាស់ប្តូរពណ៌ស្បែកនៅក្នុងរូបថតដើម្បីជួយកំណត់ភាពត្រឹមត្រូវរបស់ពួកគេ។ ក្រុមហ៊ុន Hitachi ក៏កំពុងស្រាវជ្រាវបច្ចេកវិទ្យាដើម្បីការពារការក្លែងបន្លំអត្តសញ្ញាណតាមអ៊ីនធឺណិតផងដែរ។

បច្ចេកវិទ្យាថ្មីនេះត្រូវបានគេរំពឹងថានឹងដាក់ឱ្យដំណើរការនៅដើមឆ្នាំ 2024។ ក្រុមហ៊ុន Sony គ្រោងនឹងផ្សព្វផ្សាយបច្ចេកវិទ្យានេះទៅកាន់ប្រព័ន្ធផ្សព្វផ្សាយ ហើយបានធ្វើការសាកល្បងរួចហើយនៅក្នុងខែតុលា ឆ្នាំ 2023។ Canon កំពុងចាប់ដៃគូជាមួយ Thomson Reuters និង Starling Data Preservation Lab (វិទ្យាស្ថានស្រាវជ្រាវដែលបង្កើតឡើងដោយសាកលវិទ្យាល័យ Stanford និងសាកលវិទ្យាល័យ Southern California) ដើម្បីកែលម្អបច្ចេកវិទ្យាបន្ថែមទៀត។

អ្នកផលិតកាមេរ៉ាសង្ឃឹមថា បច្ចេកវិទ្យាថ្មីនេះនឹងជួយស្ដារការជឿទុកចិត្តរបស់សាធារណៈជនលើរូបភាព ដែលនាំឱ្យពិភពលោកយល់ឃើញរបស់យើងឡើងវិញ។

(យោងទៅតាម OL)

បង់ប្រាក់ 5,000 ដុល្លារសម្រាប់ Facebook ដើម្បីផ្សព្វផ្សាយវីដេអូឆបោកវិនិយោគក្លែងក្លាយ

មេរោគថ្មីគ្រប់គ្រងលើស្មាតហ្វូន ហើយវីដេអូក្លែងក្លាយកាន់តែមានភាពស្មុគ្រស្មាញ

វីដេអូ Deepfake កាន់តែមានភាពស្មុគ្រស្មាញ និងប្រាកដនិយម

អ្វីដែលត្រូវធ្វើដើម្បីជៀសវាងការធ្លាក់ចូលទៅក្នុងអន្ទាក់នៃការហៅជាវីដេអូ Deepfake ដែលបោកប្រាស់ផ្ទេរប្រាក់?

Deepfakes កំពុងត្រូវបានកេងប្រវ័ញ្ចដើម្បីដាក់មុខជនរងគ្រោះនៅក្នុងវីដេអូសិច

ប្រភព

![[រូបថត] នាយករដ្ឋមន្ត្រី Pham Minh Chinh ធ្វើជាអធិបតីសន្និសីទរដ្ឋាភិបាលជាមួយតំបន់នានាអំពីកំណើនសេដ្ឋកិច្ច](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/2/21/f34583484f2643a2a2b72168a0d64baa)

Kommentar (0)