(Dan Tri) - បរិមាណនៃទិន្នន័យដែលប្រើដើម្បីបណ្តុះបណ្តាលបញ្ញាសិប្បនិមិត្តស្ទើរតែអស់ហើយ ដែលបង្ខំឱ្យអ្នកស្រាវជ្រាវប្រើ AI ដើម្បីហ្វឹកហាត់គ្នាទៅវិញទៅមក។ នេះអាចជារបកគំហើញដែលជួយ AI លើសពីភាពឆ្លាតវៃរបស់មនុស្ស។

Elon Musk ស្នើរវិធីថ្មីក្នុងការអភិវឌ្ឍន៍ AI ដែលអាចមានគ្រោះថ្នាក់

មហាសេដ្ឋីបច្ចេកវិទ្យា Elon Musk ស្ថាបនិកក្រុមហ៊ុនបញ្ញាសិប្បនិមិត្ត xAI ទើបតែបានបញ្ចេញព័ត៌មានដ៏គួរឱ្យភ្ញាក់ផ្អើលអំពីដំណើរការនៃការបណ្តុះបណ្តាល និងអប់រំគំរូបញ្ញាសិប្បនិម្មិត (AI) ។

Elon Musk បានឆ្លើយតបនៅក្នុងបទសម្ភាសន៍ដែលផ្សាយផ្ទាល់នៅលើបណ្តាញសង្គម X នៅថ្ងៃទី 9 ខែមករាថា "ឥឡូវនេះយើងបានអស់ចំនួនចំណេះដឹងរបស់មនុស្សក្នុងការបណ្តុះបណ្តាល និងអប់រំ AI ។

ម៉ូដែល AI ដូចជា GPT-4, Gemini, Grok ឬ Llama... ត្រូវបានបណ្តុះបណ្តាលដោយផ្អែកលើទិន្នន័យជាច្រើនដែលប្រមូលបានពីអ៊ីនធឺណិត ពីទិនានុប្បវត្តិវិទ្យាសាស្ត្រ ការសិក្សាដែលបានបោះពុម្ពផ្សាយ ទិន្នន័យអ្នកប្រើប្រាស់នៅលើបណ្តាញសង្គម...

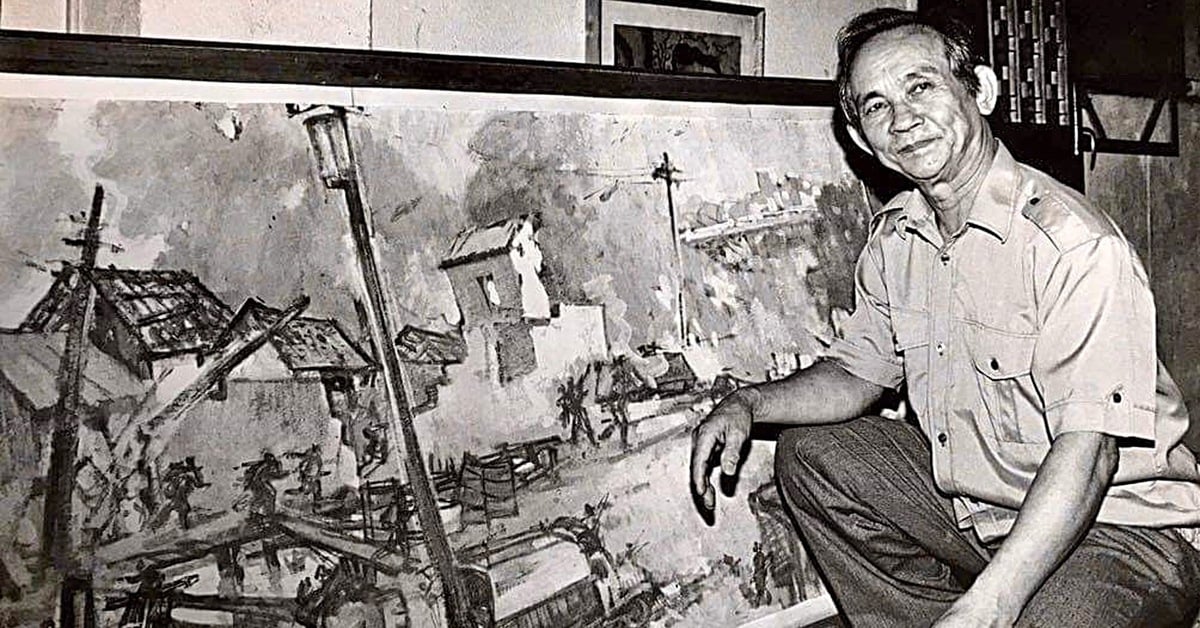

Elon Musk ស្នើឱ្យប្រើទិន្នន័យ AI ដើម្បីបណ្តុះបណ្តាល AI ប៉ុន្តែវាមានហានិភ័យដែលអាចកើតមានជាច្រើន (រូបភាព៖ Getty) ។

ទោះជាយ៉ាងណាក៏ដោយ ល្បឿននៃការអភិវឌ្ឍន៍គំរូ AI គឺលឿនណាស់ ដែលបរិមាណទិន្នន័យដែលអាចប្រើបានគឺលែងគ្រប់គ្រាន់ក្នុងការបណ្តុះបណ្តាល និងបង្កើនភាពវៃឆ្លាតនៃម៉ូដែល AI ទាំងនេះ។

ដើម្បីជម្នះបញ្ហានេះ លោក Elon Musk បានស្នើរដំណោះ ស្រាយ ពោលគឺប្តូរទៅប្រើទិន្នន័យដែលបង្កើតដោយ AI ផ្ទាល់ ដើម្បីបណ្តុះបណ្តាលគំរូ AI ។ ម្យ៉ាងវិញទៀត AI អាចបង្ហាត់ខ្លួនឯង និងគ្នាទៅវិញទៅមក ដោយមិនចាំបាច់ពឹងផ្អែកលើទិន្នន័យដែលផ្តល់ដោយមនុស្ស។

លោក Elon Musk បានចែករំលែកថា "មធ្យោបាយតែមួយគត់ដើម្បីដោះស្រាយបញ្ហានេះគឺការបន្ថែមទិន្នន័យសំយោគដែលបង្កើតឡើងដោយម៉ូដែល AI ដោយខ្លួនឯង និងប្រើប្រាស់ទិន្នន័យនេះដើម្បីបណ្តុះបណ្តាល AI ខ្លួនឯង"។

ប្រព័ន្ធ AI ការបណ្តុះបណ្តាលដោយខ្លួនឯងដោយផ្អែកលើទិន្នន័យសំយោគដែលបង្កើតឡើងដោយ AI ខ្លួនវានឹងជួយសន្សំសំចៃការចំណាយលើការអភិវឌ្ឍន៍ និងកាត់បន្ថយការពឹងផ្អែកលើទិន្នន័យរបស់មនុស្ស។ នេះបានធ្វើឱ្យមនុស្សជាច្រើនព្រួយបារម្ភថា AI អាចហ្វឹកហាត់ខ្លួនឯងឱ្យលើសពីភាពឆ្លាតវៃរបស់មនុស្ស លើសពីការគ្រប់គ្រងរបស់មនុស្សជាតិ។

ទោះជាយ៉ាងណាក៏ដោយ អ្នកជំនាញខាងបញ្ញាសិប្បនិមិត្តនិយាយថា ការប្រើប្រាស់ទិន្នន័យសំយោគដែលបង្កើតឡើងដោយ AI ខ្លួនវាផ្ទាល់ ដើម្បីបណ្តុះបណ្តាលគំរូ AI អាចដួលរលំម៉ូដែលទាំងនេះ នៅពេលដែលទិន្នន័យដែលបានបង្កើតខ្វះការច្នៃប្រឌិត មានភាពលំអៀង និងមិនត្រូវបានធ្វើបច្ចុប្បន្នភាពជាមួយនឹងទិន្នន័យចុងក្រោយបង្អស់។

លោក Andrew Duncan នាយក AI នៅវិទ្យាស្ថាន Alan Turing ក្នុងចក្រភពអង់គ្លេសបាននិយាយថា "នៅពេលដែលអ្នកប្រើទិន្នន័យសំយោគដើម្បីបណ្តុះបណ្តាលគំរូ AI ដំណើរការរបស់ពួកគេថយចុះជាលំដាប់ ដោយទិន្នន័យលទ្ធផលគឺមិនគួរឱ្យចាប់អារម្មណ៍ និងមានភាពលំអៀង" ។

ទិន្នន័យដែលមានគុណភាពខ្ពស់ត្រូវបានគេមើលឃើញថាជា "ធនធានរ៉ែ" ដ៏មានតម្លៃដែលក្រុមហ៊ុនអភិវឌ្ឍន៍ AI កំពុងប្រកួតប្រជែង។ ទោះជាយ៉ាងណាក៏ដោយ មិនមែនអ្នកវិទ្យាសាស្ត្រទាំងអស់មានឆន្ទៈក្នុងការផ្តល់នូវការស្រាវជ្រាវរបស់ពួកគេដើម្បីបណ្តុះបណ្តាលគំរូ AI នោះទេ។

Google អាចបង្កើត AI ដែលគិត និងធ្វើសកម្មភាពដូចមនុស្ស

ស្រមៃថាមានមធ្យោបាយដើម្បីកំណត់បុគ្គលិកលក្ខណៈ អាកប្បកិរិយា និងរចនាប័ទ្មរបស់បុគ្គលម្នាក់ ហើយបន្ទាប់មកបង្កើត AI ចម្លងរបស់មនុស្សនោះ។

នេះមិនមែនជារឿងប្រឌិតបែបវិទ្យាសាស្ត្រទេ ប៉ុន្តែជាគោលដៅមូលដ្ឋាននៃការសិក្សាស្រាវជ្រាវដោយអ្នកស្រាវជ្រាវនៅសាកលវិទ្យាល័យ Stanford និង Google ។

ដោយចំណាយពេលត្រឹមតែ 2 ម៉ោងនៃការសម្ភាសន៍ Google អាចបង្កើត AI ដែលគិត និងធ្វើសកម្មភាពដូចអ្នក (រូបថត៖ ZipRecruiter) ។

អ្នកស្រាវជ្រាវបានបង្កើតការចម្លង AI ដែលមានអ្នកចូលរួមជាង 1,000 ដោយប្រើព័ត៌មានពីការសម្ភាសន៍ដែលមានរយៈពេលត្រឹមតែ 2 ម៉ោង។ AI ទាំងនេះអាចធ្វើត្រាប់តាមអាកប្បកិរិយារបស់មនុស្ស។

សក្តានុពលនៃការអនុវត្តនៃការបង្កើតនេះគឺធំណាស់។ អ្នកបង្កើតគោលនយោបាយ និងអាជីវកម្មអាចប្រើការក្លែងធ្វើ AI នេះ ដើម្បីទស្សន៍ទាយប្រតិកម្មជាសាធារណៈចំពោះគោលនយោបាយ ឬផលិតផលថ្មី ជំនួសឱ្យការពឹងផ្អែកតែលើក្រុមផ្តោតអារម្មណ៍ ឬការស្ទង់មតិដដែលៗ។

អ្នកស្រាវជ្រាវជឿថាបច្ចេកវិទ្យានេះអាចជួយស្វែងរករចនាសម្ព័ន្ធសង្គម អន្តរាគមន៍សាកល្បង និងបង្កើតទ្រឹស្តីមិនច្បាស់លាស់នៃអាកប្បកិរិយារបស់មនុស្ស។

ទោះជាយ៉ាងណាក៏ដោយ វាក៏បានភ្ជាប់មកជាមួយនូវហានិភ័យមួយចំនួនផងដែរ ដូចជាការព្រួយបារម្ភខាងសីលធម៌អំពីការប្រើប្រាស់ខុសនៃ AI ក្លូន។ តួអង្គមិនល្អអាចទាញយក AI នេះដើម្បីរៀបចំមតិសាធារណៈ ក្លែងបន្លំបុគ្គល ឬក្លែងធ្វើសេចក្តីប្រាថ្នាសាធារណៈដោយផ្អែកលើទិន្នន័យសរុបក្លែងក្លាយ។

ក្តីបារម្ភទាំងនេះក៏កើតឡើងក្រោមការព្រួយបារម្ភជាយូរយារណាស់មកហើយរបស់មនុស្សជាច្រើនដែលថាការរីកសាយនៃគំរូ AI ស្រដៀងគ្នាអាចជះឥទ្ធិពលអវិជ្ជមានដល់អនាគតរបស់មនុស្សជាតិ។

ប្រភព៖ https://dantri.com.vn/suc-manh-so/ai-sap-dat-duoc-buoc-dot-pha-moi-co-the-vuot-qua-tri-tue-con-nguoi-20250111132229246.htm

![[រូបថត] គ្រានៃក្តីស្រលាញ់៖ ប្រជាជនមីយ៉ាន់ម៉ាត្រូវបានរំកិលទៅថ្លែងអំណរគុណដល់ទាហានវៀតណាម](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/9b2e07196eb14aa5aacb1bc9e067ae6f)

![[រូបថត] សារីរិកធាតុពិសេសនៅសារមន្ទីប្រវត្តិសាស្ត្រយោធាវៀតណាម ភ្ជាប់ជាមួយវីរភាពថ្ងៃទី ៣០ មេសា](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/a49d65b17b804e398de42bc2caba8368)

![[រូបថត] អគ្គលេខាបក្ស To Lam ទទួលជួបឯកអគ្គរដ្ឋទូតជប៉ុនប្រចាំនៅវៀតណាម Ito Naoki](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3a5d233bc09d4928ac9bfed97674be98)

Kommentar (0)