في مايو 2024، تتابعت شركات التكنولوجيا العملاقة الشهيرة عالميًا لإطلاق إصدارات جديدة من الذكاء الاصطناعي، مثل OpenAI مع GPT-4o، وGoogle مع Gemini 1.5 Pro... مع العديد من الميزات "الذكية للغاية" المضافة لتحسين تجربة المستخدم. ومع ذلك، فمن غير الممكن إنكار أن هذه التكنولوجيا يتم استخدامها من قبل مجرمي الإنترنت في العديد من سيناريوهات الاحتيال عبر الإنترنت.

زيادة المخاطر

وفي حديثه خلال مؤتمر عقد مؤخرا، أشار نائب وزير الإعلام والاتصالات فام دوك لونج إلى حقيقة مفادها أن الهجمات الإلكترونية تتزايد باستمرار مع زيادة التطور والتعقيد. وخاصة عندما يكون هناك دعم للذكاء الاصطناعي، فإن المخاطر التي يواجهها المستخدمون سوف تزيد بشكل كبير. حذر نائب الوزير فام دوك لونج من أن "مجرمي الإنترنت يستخدمون تقنية الذكاء الاصطناعي لإنشاء برامج ضارة جديدة بسهولة، وهجمات تصيد احتيالي جديدة ومتطورة...".

وبحسب تقرير صادر عن إدارة أمن المعلومات بوزارة المعلومات والاتصالات، فإن مخاطر الأمن السيبراني المتعلقة بالذكاء الاصطناعي تسببت في أضرار تجاوزت تريليون دولار أمريكي في جميع أنحاء العالم، منها 8000 - 10000 مليار دونج في فيتنام وحدها. الاستخدام الأكثر شيوعًا اليوم هو استخدام الذكاء الاصطناعي لتزييف الأصوات والوجوه لأغراض الاحتيال. ومن المتوقع أنه بحلول عام 2025 سيكون هناك حوالي 3000 هجوم/ثانية، و12 برنامجًا خبيثًا/ثانية، و70 ثغرة ونقطة ضعف جديدة/يوميًا.

وبحسب السيد نجوين هوو جياب، مدير شركة BShield المتخصصة في دعم الأمن للتطبيقات، فإن إنشاء صور وأصوات مزيفة ليس بالأمر الصعب مع تقدم الذكاء الاصطناعي. يمكن للمحتالين بسهولة جمع بيانات المستخدم من خلال المعلومات العامة التي ينشرونها على شبكات التواصل الاجتماعي أو من خلال الحيل مثل مقابلات العمل عبر الإنترنت والمكالمات الهاتفية تحت اسم "السلطات". وفي محاكاة أجرتها شركة BShield، من خلال الوجه المتاح عبر مكالمة فيديو، يمكن للمحتال وضعه على ورقة CCCD، ودمجه في جسم شخص متحرك لخداع أداة eKYC والتعرف عليه من قبل النظام كشخص حقيقي.

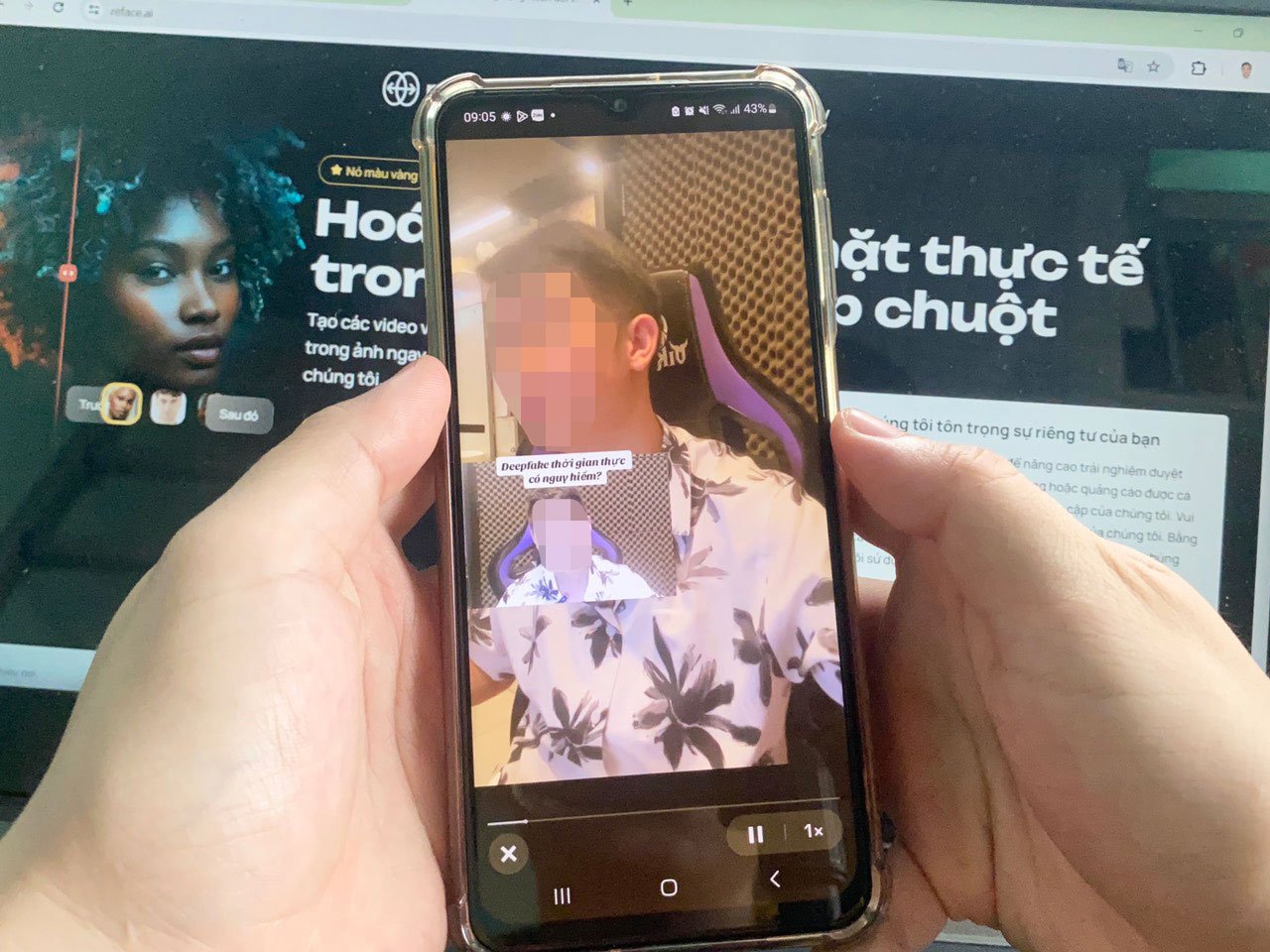

تتزايد الأساليب الاحتيالية باستخدام تقنية Deepfake وتصبح أكثر تعقيدًا. الصورة: لي تينه

من وجهة نظر المستخدم، يشعر السيد نجوين ثانه ترونج، وهو متخصص في تكنولوجيا المعلومات في مدينة هوشي منه، بالقلق من أن الأشرار يمكنهم الاستفادة من chatGPT لإنشاء رسائل بريد إلكتروني احتيالية ذات محتوى وأسلوب كتابة مشابه لرسائل البريد الإلكتروني الحقيقية من البنوك أو المؤسسات ذات السمعة الطيبة. من المرجح أن تكون رسائل البريد الإلكتروني هذه مرفقة ببرامج ضارة، وإذا نقر المستخدمون عليها، فسيتم بالتأكيد سرقة بياناتهم والاستيلاء على أصولهم. قال السيد ترونغ: "تشهد برامج الذكاء الاصطناعي تحسنًا متزايدًا، ويمكنها إنشاء مقاطع فيديو مزيفة تحتوي على وجوه وأصوات تشبه الأشخاص الحقيقيين بنسبة 95%، وتتغير الإيماءات في الوقت الفعلي مما يجعل من الصعب جدًا على المشاهدين اكتشافها".

الممر القانوني الكامل قريبا

وللحد من مخاطر الاحتيال باستخدام التكنولوجيا الفائقة، أشار خبير الأمن فام دينه ثانج إلى أن المستخدمين بحاجة إلى تحديث معلوماتهم حول الذكاء الاصطناعي بانتظام وعدم النقر على روابط ذات أصل غير معروف. بالنسبة للشركات، ينبغي تخصيص الميزانية لضمان أمن البيانات وعمليات النظام. ويحتاج موظفو المؤسسة أيضًا إلى التدريب العميق للوصول إلى نقاط الضعف الفعلية التي تحدث في النظام، مما يزيد من القدرة على تحديد أنواع الهجمات الإلكترونية.

قال السيد تا كونغ سون، رئيس قسم تطوير الذكاء الاصطناعي - مشروع مكافحة الاحتيال، إن الذكاء الاصطناعي قد تغلغل بعمق في حياة المستخدمين وعمليات الشركات والوكالات والوحدات بفضل ميزات الدعم الذكية للغاية. والجدير بالذكر أن تقنية الذكاء الاصطناعي أصبحت في الوقت الحالي متاحة للغاية وسهلة الاستخدام، وهو ما سيخلق الظروف للمجرمين للاستفادة منها بسهولة لأغراض احتيالية. "يقوم المحتالون أيضًا بتغيير أساليب هجومهم باستمرار، ويجب على المستخدمين تحديث المعلومات بانتظام لمعرفة كيفية منعها" - أوصى السيد سون.

وبحسب الخبراء، فإن طرازي GPT-4o وGemini 1.5 Pro اللذين تمت ترقيتهما مؤخرًا أثبتا أن ذكاء الذكاء الاصطناعي ليس له حدود. ولذلك، بالإضافة إلى تشجيع الشركات على تطوير أدوات وحلول الذكاء الاصطناعي لمكافحة الاحتيال، تحتاج وكالات الإدارة إلى استكمال الممر القانوني الخاص بالذكاء الاصطناعي قريبًا للبقاء في طليعة هذا الاتجاه.

قال المقدم نجوين آنه توان، نائب مدير المركز الوطني لبيانات السكان، إنه من الضروري إصدار وثائق قريبًا تنظم أخلاقيات ومسؤوليات مقدمي الخدمات المحليين والأجانب في عملية تطوير وإنتاج وتطبيق واستخدام الذكاء الاصطناعي. وفي الوقت نفسه، هناك حاجة إلى وضع لوائح محددة بشأن المعايير الفنية للأنظمة التي تستخدم خدمات الذكاء الاصطناعي وتطبقها وتتصل بها وتقدمها. من الضروري البحث في مشاريع الذكاء الاصطناعي وتطبيقها لمواجهة مخاطره. ولأن الذكاء الاصطناعي من صنع البشر، وهو نتاج المعرفة، ستكون هناك أنواع مختلفة من "الذكاء الاصطناعي الجيد" و"الذكاء الاصطناعي السيئ"، لذا من الممكن منع تطور الذكاء الاصطناعي من خلال الذكاء الاصطناعي نفسه - أشار العقيد توان.

تحديات الأمن السيبراني

واعترف المقدم نجوين آنه توان بأن الذكاء الاصطناعي يشكل تحديات للأمن السيبراني. وبناءً على ذلك، من الممكن تثبيت البرامج الضارة المدعومة بالذكاء الاصطناعي في ملفات المستندات. عندما يقوم المستخدمون بتحميل ملفات المستندات، فإن هذا البرنامج الخبيث سوف يخترق النظام. علاوة على ذلك، من خلال تقنيات الذكاء الاصطناعي الخاصة، يمكن للمتسللين محاكاة الأنظمة ومهاجمة الثغرات الأمنية. يمكن للذكاء الاصطناعي إنشاء العديد من التطبيقات التي تحتوي على صور وأسماء مزيفة لتطبيقات ومواقع وزارة الأمن العام ليقوم الأشخاص بتنزيلها وتثبيتها وتقديم معلومات مثل رقم بطاقة الهوية وكلمة المرور لتسجيل الدخول. وحذر المقدم نجوين آنه توان من أن "الذكاء الاصطناعي سوف يطور أيضًا برمجياته الخاصة وبرامجه الخبيثة الهجينة، مع آليات التهرب الأمني الأكثر تطورًا وتغييرات مرنة في الكود المصدر".

[إعلان 2]

المصدر: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[صورة] موسم التوت في فوك تو – فاكهة حلوة من الزراعة الخضراء](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/1710a51d63c84a5a92de1b9b4caaf3e5)

![[صورة] رئيس الوزراء فام مينه تشينه يرأس اجتماعًا لمناقشة الحلول الضريبية للسلع المستوردة والمصدرة في فيتنام](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/19b9ed81ca2940b79fb8a0b9ccef539a)

![[صورة] ألعاب شعبية فريدة من نوعها في مهرجان قرية تشونج](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/10/cff805a06fdd443b9474c017f98075a4)

تعليق (0)