|

دخلت مجموعة Ant Group التابعة لجاك ما سوق الذكاء الاصطناعي منخفض التكلفة في الصين. الصورة: بلومبرج . |

وتعمل شركة Ant Group، وهي شركة يدعمها الملياردير جاك ما، على تطوير تقنية يمكنها خفض تكاليف التدريب على تقنية الذكاء الاصطناعي الخاصة بها بنسبة 20% باستخدام شرائح أشباه الموصلات التي يتم الحصول عليها من الصين، وفقًا لبلومبرج .

وتستخدم الشركة شرائح تم شراؤها من علي بابا وهواوي، فضلاً عن تطبيق أسلوب التعلم الآلي Mixture of Experts، الذي يستخدمه DeepSeek R1، لتدريب الذكاء الاصطناعي الخاص بها.

وعلى الرغم من خفض التكاليف، فإن نتائج Ant Group قابلة للمقارنة مع نتائج شركات الذكاء الاصطناعي التي تستخدم أقوى الرقائق اليوم، مثل H800 من Nvidia.

وتستخدم الشركة بشكل أساسي وتتحول تدريجيًا إلى بدائل من AMD والرقائق الصينية لأحدث نماذج الذكاء الاصطناعي الخاصة بها.

باستخدام برنامج عالي الأداء، أنفقت مجموعة Ant ما يصل إلى 6.35 مليون يوان ( 880 ألف دولار أمريكي ) لتدريب 1000 مليار رمز. ولكن مع طريقة التحسين انخفض الرقم إلى 5.1 مليون يوان. الرموز هي وحدات من المعلومات يستقبلها النموذج للتعرف على العالم وتقديم استجابات مفيدة.

ويمثل هذا دخول Ant إلى سباق الذكاء الاصطناعي المتسارع بشكل متزايد بين الصين والولايات المتحدة، منذ أن أظهر DeepSeek أن النماذج يمكن تدريبها بتكلفة أقل بكثير من المليارات من الدولارات التي تنفقها OpenAI أو Google.

على الرغم من أن شريحة H800 من شركة Nvidia ليست الأكثر تقدمًا، إلا أنها لا تزال معالجًا قويًا، وهي محظورة من التصدير إلى الصين من قبل الولايات المتحدة. ولذلك تسعى الشركات الصينية جاهدة إلى إيجاد بدائل للبقاء في الصدارة في السباق.

أصدرت Ant Group في وقت سابق دراسة، زعمت فيها أن نماذجها تتفوق في بعض الأحيان على نماذج Meta Platforms في مقاييس تقييم معينة. وإذا كانت هذه النماذج صحيحة، فإنها ستمثل قفزة نوعية للذكاء الاصطناعي الصيني مع انخفاض تكاليف التطوير بشكل كبير.

ويعود الفضل في هذا الإنجاز إلى شركة DeepSeek من خلال أسلوب التعلم الآلي MoE، الذي يساعد على زيادة الأداء وخفض التكاليف الحسابية. على وجه التحديد، تساعد هذه الطريقة نماذج الذكاء الاصطناعي على تحليل المشكلة ولا تحتاج إلا إلى تنشيط جزء صغير من البيانات يكفي للتعامل مع المهام.

ومع ذلك، لا يزال تدريب نماذج MoE يتطلب شرائح عالية الأداء مثل وحدات معالجة الرسومات (GPUs) التي توفرها Nvidia. من عنوان ورقة بحث Ant، "تطوير نماذج MoE بدون وحدات معالجة رسومية متطورة"، يمكننا أن نرى أن الشركة تحاول كسر الحاجز المذكور أعلاه.

وهذا يتعارض مع استراتيجية Nvidia. ويقول جينسن هوانج، الرئيس التنفيذي للشركة، إن الطلب على الحوسبة سوف يستمر في الارتفاع حتى مع ظهور نماذج أكثر كفاءة مثل DeepSeek R1.

ويعتقد أن الشركات ستحتاج إلى شرائح أكثر قوة لمواصلة نمو الإيرادات، بدلاً من شرائح أرخص لخفض التكاليف. لذلك، تلتزم شركة Nvidia باستراتيجيتها المتمثلة في تطوير وحدات معالجة الرسوميات ذات عدد أكبر من أنوية المعالجة والترانزستورات وقدرات الذاكرة الأعلى.

وفي الوقت نفسه، تخطط Ant للاستفادة من الإنجازات الأخيرة في نماذج اللغة الكبيرة التي طورتها، بما في ذلك Ling-Plus وLing-Lite، لتوفير حلول الذكاء الاصطناعي للصناعات بما في ذلك الرعاية الصحية والتمويل.

استحوذت الشركة على منصة الإنترنت الصينية Haodf.com في عام 2025 لتعزيز خدمات الذكاء الاصطناعي في قطاع الرعاية الصحية، كما تمتلك أيضًا تطبيق مساعد الحياة بالذكاء الاصطناعي Zhixiaobao وخدمة الاستشارات المالية بالذكاء الاصطناعي Maxiaocai.

وفي الدراسة، قال أنت إن لينج لايت تفوق على أحد نماذج لاما التابعة لشركة ميتا في مقياس رئيسي لفهم اللغة الإنجليزية.

تفوقت كل من Ling-Lite وLing-Plus على نماذج DeepSeek المماثلة في اختبارات اللغة الصينية.

وقد أصبحت نماذج لينغ متاحة للعامة أيضًا. يحتوي Ling-Lite على 16.8 مليار معلمة، ويحتوي Ling-Plus على 290 مليار، وهو ما يعتبر كبيرًا جدًا في مجال نمذجة اللغة، مقارنة بـ 1800 مليار في ChatGPT GPT-4.5، و 671 في DeepSeek R1.

ومع ذلك، واجهت Ant بعض تحديات الاستقرار أثناء التدريب. وقالت الشركة إن حتى التغييرات الصغيرة في أجهزة النموذج أو هيكله يمكن أن تؤدي إلى زيادة مفاجئة في معدل خطأ النموذج.

المصدر: https://znews.vn/cong-ty-cua-jack-ma-lai-gay-chu-y-post1540514.html

![[صورة] رئيس الوزراء فام مينه تشينه يترأس الاجتماع الأول للجنة التوجيهية للمراكز المالية الإقليمية والدولية](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/47dc687989d4479d95a1dce4466edd32)

![[صورة] شباب العاصمة يمارسون بحماس مهارات مكافحة الحرائق والإنقاذ المائي](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3f8481675271488abc7b9422a9357ada)

![[صورة] لحظة راحة قصيرة لقوة الإنقاذ التابعة لجيش الشعب الفيتنامي](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/a2c91fa05dc04293a4b64cfd27ed4dbe)

![[صورة] رئيس الوزراء فام مينه تشينه يرأس اجتماعًا بعد إعلان الولايات المتحدة عن فرض رسوم جمركية متبادلة](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/ee90a2786c0a45d7868de039cef4a712)

![[صورة] مدينة هوشي منه تسرع أعمال إصلاح الأرصفة قبل عطلة 30 أبريل](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/17f78833a36f4ba5a9bae215703da710)

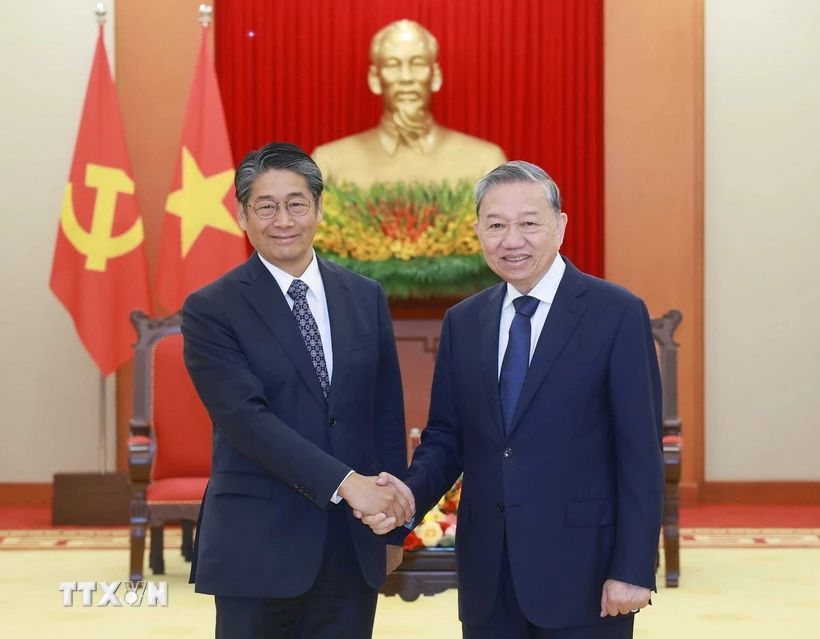

![[صورة] الأمين العام تو لام يستقبل السفير الياباني لدى فيتنام إيتو ناوكي](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/3/3a5d233bc09d4928ac9bfed97674be98)

تعليق (0)