OpenAI ไม่ได้เปิดเผยมากนักว่า ChatGPT-4 ได้รับการฝึกอย่างไร อย่างไรก็ตาม โดยทั่วไปโมเดลภาษาขนาดใหญ่ (LLM) จะได้รับการฝึกจากข้อความที่ดึงมาจากอินเทอร์เน็ตซึ่งมีภาษาอังกฤษเป็นภาษากลาง ประมาณ 93% ของข้อมูลการฝึกอบรมของ ChatGPT-3 เป็นภาษาอังกฤษ

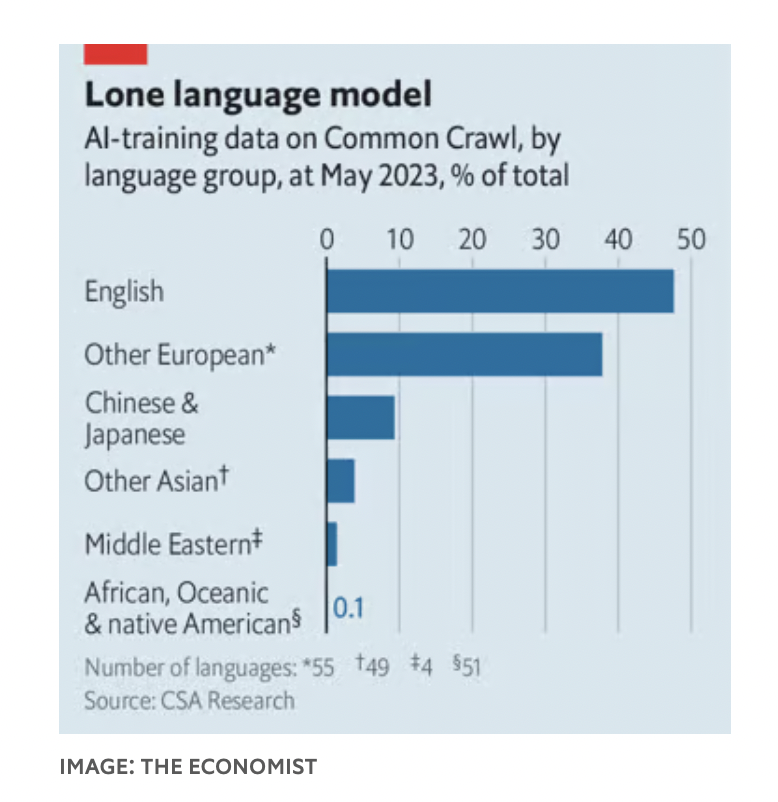

ใน Common Crawl ซึ่งเป็นเพียงชุดข้อมูลเดียวที่ใช้ฝึกโมเดล AI ภาษาอังกฤษมีสัดส่วน 47% ของคลังข้อมูล โดยภาษาอื่นๆ ในยุโรปมีสัดส่วนอีก 38% ในทางตรงกันข้าม ชาวจีนและญี่ปุ่นรวมกันมีสัดส่วนเพียง 9% เท่านั้น

การตรวจสอบโดย Nathaniel Robinson นักวิจัยจากมหาวิทยาลัย Johns Hopkins และเพื่อนร่วมงานของเขาพบว่าปัญหานี้ไม่ได้เกิดขึ้นเฉพาะกับ ChatGPT เท่านั้น หลักสูตร LLM ทั้งหมดจะมีประสิทธิภาพดีขึ้นเมื่อใช้ภาษาที่มี “ทรัพยากรสูง” ซึ่งมีข้อมูลการฝึกอบรมมากมาย มากกว่าใช้ภาษาที่มี “ทรัพยากรต่ำ” ซึ่งมีข้อมูลไม่เพียงพอ

นี่เป็นปัญหาสำหรับผู้ที่หวังจะนำ AI ไปสู่ประเทศยากจนเพื่อปรับปรุงด้านต่างๆ ตั้งแต่การศึกษาไปจนถึงการดูแลสุขภาพ ดังนั้นนักวิจัยทั่วโลกจึงพยายามทำให้ AI มีหลายภาษามากขึ้น

เมื่อเดือนกันยายนที่ผ่านมา รัฐบาลอินเดียเปิดตัวแชทบอทที่ช่วยให้เกษตรกรได้รับข้อมูลที่เป็นประโยชน์จากรัฐบาล

Shankar Maruwada จากมูลนิธิ EkStep ซึ่งเป็นองค์กรไม่แสวงหากำไรที่ช่วยสร้างแชทบอท กล่าวว่า บอททำงานโดยการรวมโมเดลภาษาสองประเภทเข้าด้วยกัน และผู้ใช้สามารถส่งคำถามในภาษาแม่ของตนได้ คำถามภาษาพื้นเมืองเหล่านี้จะถูกส่งไปยังซอฟต์แวร์แปลเครื่องที่ศูนย์วิจัยในอินเดีย ซึ่งจะแปลเป็นภาษาอังกฤษ ก่อนที่จะส่งต่อไปยัง LLM เพื่อประมวลผลคำตอบ ในที่สุดการตอบกลับจะถูกแปลกลับมาเป็นภาษาแม่ของผู้ใช้

กระบวนการนี้อาจได้ผล แต่การแปลคำถามเป็นภาษา "ที่ต้องการ" ของ LLM ถือเป็นวิธีแก้ปัญหาที่ยุ่งยาก ภาษาเป็นเครื่องมือในการสะท้อนวัฒนธรรมและทัศนคติโลก บทความในปี 2022 โดย Rebecca Johnson นักวิจัยจากมหาวิทยาลัยซิดนีย์ พบว่า ChatGPT-3 สร้างคำตอบในหัวข้อเช่น การควบคุมอาวุธปืนและนโยบายผู้ลี้ภัย ซึ่งเทียบได้กับค่านิยมของอเมริกันที่แสดงไว้ในแบบสำรวจ World Values

ดังนั้นนักวิจัยจำนวนมากจึงพยายามทำให้หลักสูตร LLM สามารถใช้ภาษาที่ไม่ค่อยใช้กันมากนักได้อย่างคล่องแคล่ว ในทางเทคนิค แนวทางหนึ่งก็คือการปรับเปลี่ยนการสร้างโทเค็นของภาษา บริษัทสตาร์ทอัพของอินเดียที่ชื่อ Sarvam AI ได้เขียนโทเค็นไนเซอร์ที่ปรับให้เหมาะกับภาษาฮินดี หรือโมเดล OpenHathi - LLM ที่ปรับให้เหมาะกับภาษาเทวนาครี (อินเดีย) ซึ่งสามารถลดต้นทุนในการตอบคำถามได้อย่างมาก

อีกวิธีหนึ่งคือการปรับปรุงชุดข้อมูลที่ใช้ฝึกอบรม LLM ในเดือนพฤศจิกายน ทีมนักวิจัยจากมหาวิทยาลัยโมฮัมเหม็ด บิน ซายิด ในอาบูดาบี เปิดตัวโมเดลภาษาอาหรับรุ่นล่าสุดที่เรียกว่า “Jais” มีจำนวนพารามิเตอร์เพียง 1/6 ของ ChatGPT-3 แต่ให้ประสิทธิภาพที่เทียบเคียงได้กับภาษาอาหรับ

ทิโมธี บอลด์วิน อธิการบดีมหาวิทยาลัยโมฮัมหมัด บิน ซายิด กล่าวว่า แม้ว่าทีมของเขาจะแปลงข้อความภาษาอาหรับเป็นดิจิทัลจำนวนมาก แต่โมเดลดังกล่าวยังคงมีข้อความภาษาอังกฤษอยู่บ้าง แนวคิดบางอย่างจะเหมือนกันในทุกภาษาและสามารถเรียนรู้ได้ในทุกภาษา

แนวทางที่สามคือปรับแต่งโมเดลหลังจากได้รับการฝึกแล้ว ทั้ง Jais และ OpenHathi มีคำถามและคำตอบที่สร้างโดยมนุษย์หลายคู่ สิ่งเดียวกันนี้ใช้ได้กับแชทบอททางตะวันตก เพื่อป้องกันข้อมูลที่ผิดพลาด

Ernie Bot ซึ่งเป็น LLM ของ Baidu บริษัทเทคโนโลยีรายใหญ่ของจีน ได้ถูกควบคุมเพื่อจำกัดคำพูดที่อาจทำให้รัฐบาลไม่พอใจ นอกจากนี้ นางแบบยังสามารถเรียนรู้จากข้อเสนอแนะของมนุษย์ โดยที่ผู้ใช้จะให้คะแนนคำตอบของ LLM แต่การทำเช่นนี้เป็นเรื่องยากสำหรับภาษาต่างๆ มากมายในภูมิภาคที่ยังพัฒนาน้อย เนื่องจากต้องจ้างคนที่มีคุณสมบัติเหมาะสมมาวิจารณ์การตอบสนองของเครื่องจักร

(ตามความเห็นของนักเศรษฐศาสตร์)

แหล่งที่มา

![[ภาพ] วันประสูติของพระพุทธเจ้า พ.ศ. ๒๕๖๘ : สืบสานคำสอนแห่งความรัก ปัญญา และความอดทน](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/12/8cd2a70beb264374b41fc5d36add6c3d)

![[ภาพ] เลขาธิการใหญ่โตลัมเดินทางถึงมินสค์ เริ่มการเยือนเบลารุสอย่างเป็นทางการ](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/76602f587468437f8b5b7104495f444d)

![[ภาพ] เลขาธิการโตลัมพบปะและแสดงความขอบคุณต่อเพื่อนชาวเบลารุสของเวียดนาม](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/11/c515ee2054c54a87aa8a7cb520f2fa6e)

การแสดงความคิดเห็น (0)