Nguy cơ từ mất kiểm soát AI

Nhân loại dường như đang lờ đi một bóng ma ở chân trời. Đó là bóng ma của một cuộc chiến tranh hạt nhân toàn cầu do trí tuệ nhân tạo (AI) gây ra. Tổng thư ký Liên hợp quốc Antonio Guterres đã cảnh báo về điều đó. Nhưng cho đến nay, các quốc gia sở hữu vũ khí hạt nhân vẫn chưa cùng nhau đàm phán về mối đe dọa thảm khốc này.

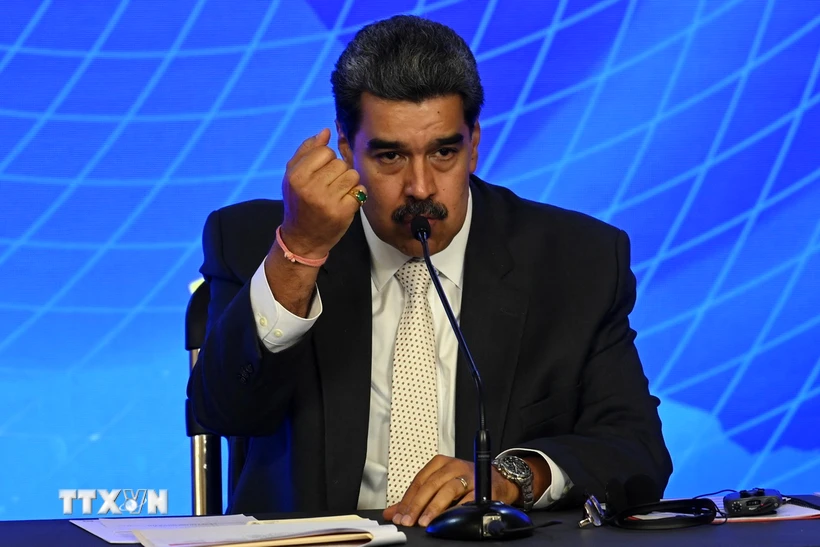

Sự phát triển thần tốc của trí tuệ nhân tạo (AI) đặt ra nguy cơ rằng AI có thể tự can thiệp vào quá trình khai hỏa vũ khí hạt nhân. Ảnh minh họa

Lâu nay vẫn có một sự đồng thuận không chính thức giữa 5 cường quốc hạt nhân lớn nhất - Mỹ, Nga, Trung Quốc, Anh và Pháp - về nguyên tắc "con người trong vòng lặp", tức là mỗi nước đều có hệ thống đảm bảo rằng con người phải tham gia vào quyết định phóng vũ khí hạt nhân.

Không nước nào trong số 5 cường quốc này nói rằng họ triển khai AI trong hệ thống chỉ huy phóng hạt nhân của mình. Theo Tiến sĩ Sundeep Waslekar - Chủ tịch của Strategic Foresight Group, một tổ chức nghiên cứu quốc tế tại Mumbai (Ấn Độ), điều này đúng nhưng gây hiểu lầm.

Hiện nay AI đều đã được sử dụng để phát hiện mối đe dọa và lựa chọn mục tiêu. Các hệ thống hỗ trợ AI phân tích lượng lớn dữ liệu từ các cảm biến, vệ tinh và radar theo thời gian thực, phân tích các cuộc tấn công tên lửa đang tới và đề xuất các phương án ứng phó.

Sau đó, người vận hành sẽ kiểm tra chéo mối đe dọa từ các nguồn khác nhau và quyết định có nên đánh chặn tên lửa của đối phương hay tiến hành các cuộc tấn công trả đũa hay không.

“Hiện tại, thời gian phản ứng khả dụng cho người vận hành là 10 đến 15 phút. Đến năm 2030, thời gian này sẽ giảm xuống còn từ 5 đến 7 phút” ông Sundeep Waslekar cho biết. “Dù con người sẽ đưa ra quyết định cuối cùng, nhưng họ sẽ bị ảnh hưởng bởi các phân tích dự đoán và chỉ định của AI. AI có thể là động lực thúc đẩy các quyết định phóng sớm nhất là vào những năm 2030”.

Vấn đề là AI có thể mắc lỗi. Các thuật toán phát hiện mối đe dọa có thể chỉ ra một cuộc tấn công bằng tên lửa khi không có gì xảy ra. Có thể là do lỗi máy tính, xâm nhập mạng hoặc các yếu tố môi trường làm mờ các tín hiệu. Trừ khi người vận hành kịp xác nhận báo động giả từ các nguồn khác trong vòng 2 đến 3 phút, họ có thể kích hoạt các cuộc tấn công trả đũa.

Sai số rất nhỏ, thảm họa cực lớn

Việc sử dụng AI trong nhiều chức năng dân sự như dự đoán tội phạm, nhận dạng khuôn mặt và tiên lượng ung thư được biết là có biên độ sai số là 10%. Theo ông Sundeep Waslekar, trong các hệ thống cảnh báo sớm hạt nhân, biên độ sai số có thể là khoảng 5%.

Khi độ chính xác của các thuật toán nhận dạng hình ảnh được cải thiện trong thập kỷ tới, biên độ sai số này có thể giảm xuống còn 1-2%. Nhưng ngay cả biên độ sai số 1% cũng có thể khởi xướng một cuộc chiến tranh hạt nhân toàn cầu.

Những quyết định tấn công hoặc đáp trả hạt nhân có thể bị kích hoạt bởi sai số từ AI. Ảnh: Modern War Institute

Rủi ro có thể tăng lên trong 2 đến 3 năm tới khi phần mềm độc hại mới xuất hiện, có khả năng xâm nhập qua các hệ thống phát hiện mối đe dọa. Phần mềm độc hại này sẽ thích nghi để tránh bị phát hiện, tự động xác định mục tiêu và tự động tấn công chúng.

Đã có một số cuộc tình huống “bên bờ vực” trong Chiến tranh Lạnh. Năm 1983, một vệ tinh của Liên Xô đã nhầm lẫn phát hiện 5 tên lửa do Mỹ phóng. Stanislaw Petrov, một sĩ quan tại trung tâm chỉ huy Sepukhov-15 của Nga, kết luận rằng đó là báo động giả và không cảnh báo cấp trên của mình để họ có thể tiến hành phản công.

Năm 1995, trạm radar Olenegorsk phát hiện một cuộc tấn công tên lửa ngoài khơi bờ biển Na Uy. Các lực lượng chiến lược của Nga đã được đặt trong tình trạng báo động cao và Tổng thống Nga khi đó là Boris Yeltsin đã được trao chiếc cặp hạt nhân. Ông nghi ngờ đó là một sai lầm và không nhấn nút. Hóa ra đó là một tên lửa khoa học. Nếu AI được sử dụng để xác định phản ứng trong cả hai tình huống, kết quả có thể là thảm khốc.

Hiện nay, tên lửa siêu thanh sử dụng cơ chế tự động hóa thông thường thay vì AI. Chúng có thể di chuyển với tốc độ từ Mach 5 đến Mach 25, tránh được sự phát hiện của radar và điều khiển đường bay của chúng. Các cường quốc đang có kế hoạch tăng cường tên lửa siêu thanh với AI để định vị và tiêu diệt ngay lập tức các mục tiêu đang di chuyển, chuyển quyết định tiêu diệt từ con người sang máy móc.

Ngoài ra còn có một cuộc đua phát triển trí thông minh nhân tạo chung, có thể dẫn đến các mô hình AI hoạt động ngoài tầm kiểm soát của con người. Khi điều này xảy ra, các hệ thống AI sẽ học cách tăng cường và sao chép chính chúng, tiếp quản các quy trình ra quyết định. Khi một AI như vậy được tích hợp vào các hệ thống hỗ trợ quyết định cho vũ khí hạt nhân, máy móc sẽ có thể khởi xướng các cuộc chiến tranh tàn khốc.

Đã đến lúc hành động

Trước những nguy cơ kể trên, nhiều chuyên gia cho rằng nhân loại cần một thỏa thuận toàn diện giữa các cường quốc để giảm thiểu rủi ro chiến tranh hạt nhân, vượt ra ngoài việc lặp lại khẩu hiệu “con người trong vòng lặp”.

Thỏa thuận này phải bao gồm các biện pháp minh bạch, khả năng giải thích và hợp tác; các tiêu chuẩn quốc tế về thử nghiệm và đánh giá; các kênh truyền thông khủng hoảng; các ủy ban giám sát quốc gia; và các quy tắc để cấm các mô hình AI hung hăng có khả năng bỏ qua các nhà điều hành con người.

Tổng thư ký António Guterres tham dự Lễ tưởng niệm hòa bình tại Hiroshima, nơi đã hứng chịu quả bom nguyên tử vào năm 1945. Ảnh: UN

Những thay đổi về địa chính trị đang tạo ra một cơ hội cho một hiệp ước như vậy. Chẳng hạn, các chuyên gia AI hàng đầu từ Trung Quốc và Mỹ đã tham gia vào một số cuộc đối thoại theo dõi hai về rủi ro AI, dẫn đến một tuyên bố chung của cựu tổng thống Mỹ Joe Biden và Chủ tịch Trung Quốc Tập Cận Bình vào tháng 11 năm ngoái.

Theo Tiến sĩ Sundeep Waslekar, tỷ phú Elon Musk là người ủng hộ mạnh mẽ cho nhu cầu cứu nhân loại khỏi những rủi ro hiện sinh do AI gây ra. Ông Musk có thể thúc giục Tổng thống Mỹ hiện tại Donald Trump biến tuyên bố chung giữa các ông Joe Biden và Tập Cận Bình thành một hiệp ước.

Thách thức về AI-hạt nhân cũng cần cả sự tham gia của Nga, theo tiến sĩ Sundeep Waslekar nhận định. Cho đến tháng 1 năm nay, Nga đã từ chối thảo luận về bất kỳ biện pháp giảm thiểu rủi ro hạt nhân nào, bao gồm cả việc hội tụ với AI, trừ khi vấn đề Ukraine được đưa ra thảo luận.

Với việc Tổng thống Donald Trump tham gia đối thoại với Tổng thống Nga Vladimir Putin nhằm cải thiện quan hệ song phương và chấm dứt cuộc chiến tại Ukraine, Nga hiện có thể cởi mở với các cuộc thảo luận.

Hồi tháng 2 năm nay, sau bài phát biểu của Phó Tổng thống Mỹ JD Vance tại Hội nghị thượng đỉnh về hành động trí tuệ nhân tạo Paris, Trung tâm An ninh Hoa Kỳ mới (CNAS) cũng đã công bố một báo cáo có tên “Ngăn chặn ngày tận thế của AI: Sự cạnh tranh giữa Hoa Kỳ-Trung Quốc-Nga tại mối quan hệ giữa vũ khí hạt nhân và trí tuệ nhân tạo”.

Báo cáo này chỉ ra những những rủi ro quan trọng nhất của mối liên hệ AI-hạt nhân, đồng thời hối thúc chính quyền Mỹ thiết lập một bộ cơ chế toàn diện về giảm thiểu rủi ro và quản lý khủng hoảng với Trung Quốc và Nga.

Trước đó, vào tháng 9 năm ngoái, khoảng 60 quốc gia bao gồm Mỹ đã thông qua "kế hoạch hành động" để quản lý việc sử dụng AI một cách có trách nhiệm trong quân đội tại Hội nghị thượng đỉnh AI có trách nhiệm trong lĩnh vực quân sự (REAIM) tổ chức ở Seoul, Hàn Quốc. Đây là hội nghị thứ hai cùng loại, sau hội nghị được tổ chức tại The Hague vào năm ngoái. Những chuyển động đó cho thấy, nguy cơ về một cuộc chiến hạt nhân được khởi xướng bởi AI không phải chuyện khoa học viễn tưởng.

Thế giới rõ ràng đang đối mặt với vấn đề hiện sinh đang ngày càng trở nên cấp bách, rất cần hành động thực tế từ các cường quốc để hạt nhân để đảm bảo rằng, “mọi quyết định về việc sử dụng hạt nhân đều phải do con người đưa ra, không phải máy móc hay thuật toán” - như lời kêu gọi của Tổng thư ký Liên hợp quốc Antonio Guterres.

Nguyễn Khánh

![[Ảnh] Bộ trưởng Quốc phòng chủ trì kiểm tra hợp luyện diễu binh, diễu hành](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/35c2dd58a3e840d3a8cd615e70e89039)

![[Ảnh] Báo Nhân Dân kỷ niệm 94 năm Ngày thành lập Đoàn Thanh niên Cộng sản Hồ Chí Minh](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/5571705682934ac5be5014ce171facb4)

![[Ảnh] Tổng Bí thư Tô Lâm chủ trì Cuộc họp Thường trực Ban Chỉ đạo Trung ương về phòng, chống tham nhũng, lãng phí, tiêu cực](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/3/25/839ea9ed0cd8400a8ba1c1ce0728b2be)

Bình luận (0)