SGGPO 20/10/2023 19:13

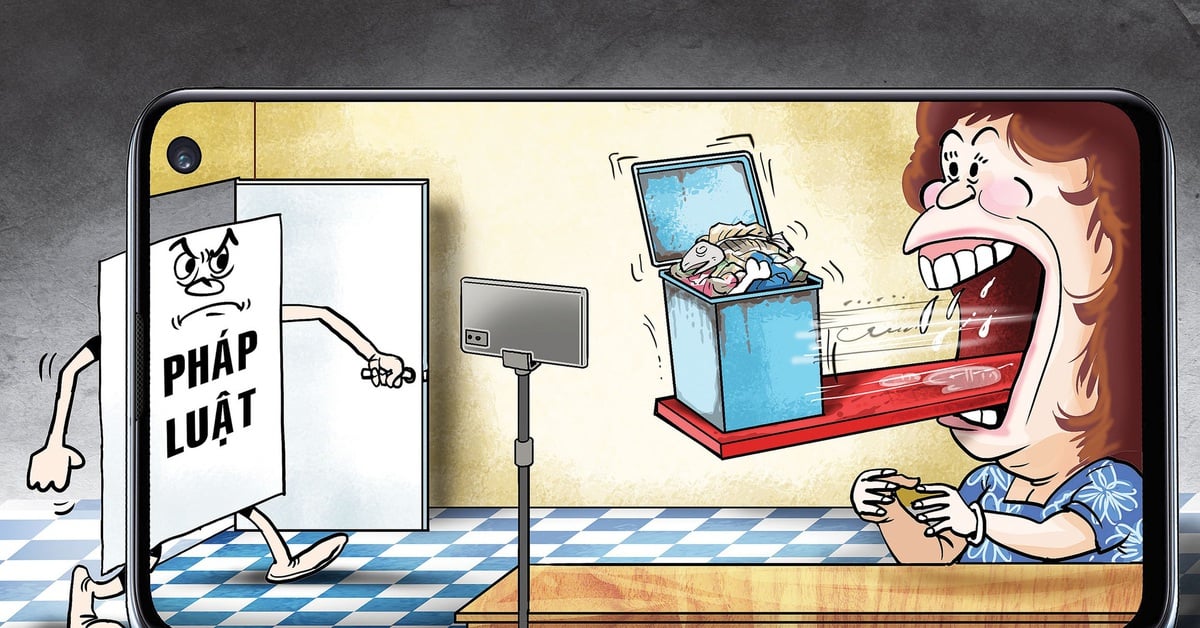

Không còn được dùng cho mục đích giải trí, deepfake đang dần bị các tội phạm mạng khai thác trở thành công cụ lừa đảo… và các vụ lừa đảo bằng deepfake sẽ tăng cao với nhiều hình thức đa dạng và tinh vi hơn.

|

| Kaspersky nhận định các vụ lừa đảo bằng deepfake sẽ tăng cao với nhiều hình thức đa dạng và tinh vi hơn. |

Sau khi nghiên cứu trên diễn đàn darknet (darknet forum), nơi các tội phạm công nghệ thường xuyên hoạt động, Kaspersky nhận định có nhiều tội phạm sử dụng deepfake để lừa đảo, đến mức nhu cầu sử dụng vượt xa nguồn cung các phần mềm deepfake hiện có trên thị trường.

Các chuyên gia của Kaspersky dự đoán rằng các vụ lừa đảo bằng deepfake sẽ tăng cao với nhiều hình thức đa dạng và tinh vi hơn. Từ cung cấp một video mạo danh chất lượng cao với đầy đủ dịch vụ sản xuất cho đến việc sử dụng hình ảnh người nổi tiếng trong luồng phát trực tuyến giả mạo (fake livestream) trên mạng xã hội và hứa hẹn sẽ thanh toán gấp đôi số tiền nạn nhân đã gửi họ.

Mặc dù AI đang bị các tội phạm lạm dụng cho những mục đích xấu, các cá nhân và doanh nghiệp vẫn có thể tận dụng AI để nhận diện deepfake nhằm giảm thiểu xác suất thành công của các vụ lừa đảo. Kaspersky chia sẻ các giải pháp để người dùng tự bảo vệ mình khỏi các trò lừa đảo deepfake:

Công cụ phát hiện nội dung AI: Những phần mềm phát hiện nội dung do AI tạo ra sử dụng thuật toán AI tiên tiến để phân tích và xác định mức độ bị chỉnh sửa của tệp hình ảnh, video, âm thanh.

Nội dung AI được đánh dấu watermark: Hình mờ (watermark) đóng vai trò là dấu hiệu nhận biết trong hình ảnh, video… giúp tác giả bảo vệ bản quyền cho các tác phẩm AI. Tuy nhiên, công cụ này có thể trở thành vũ khí chống lại deepfake vì hình thức này có thể giúp truy tìm nguồn gốc của nền tảng tạo ra AI.

Truy xuất nguồn gốc nội dung: Vì AI thu thập lượng lớn dữ liệu từ nhiều nguồn khác nhau để tạo nội dung mới, phương pháp này nhằm mục đích truy tìm nguồn gốc của nội dung đó.

Xác thực video: là quá trình xác thực nội dung video không bị thay đổi so với giai đoạn đầu được tạo. Đây là quá trình được người sáng tạo video quan tâm nhất.

“Deepfake đã trở thành cơn ác mộng đối với phụ nữ và xã hội. Tội phạm mạng hiện đang khai thác trí tuệ nhân tạo (AI) để ghép khuôn mặt nạn nhân vào ảnh và video khiêu dâm cũng như trong chiến dịch tuyên truyền. Những hình thức này nhằm mục đích thao túng dư luận bằng cách phát tán thông tin sai lệch hoặc thậm chí gây tổn hại đến danh tiếng của tổ chức hoặc cá nhân. Chúng tôi kêu gọi công chúng nâng cao cảnh giác trước mối đe dọa này,” bà Võ Dương Tú Diễm, Giám đốc khu vực Việt Nam của Kaspersky chia sẻ.

Nguồn

![[Ảnh] Thúc đẩy tình hữu nghị, đoàn kết và hợp tác giữa quân đội và nhân dân hai nước](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/0c4d087864f14092aed77252590b6bae)

![[Ảnh] Báo Nhân Dân công bố Dự án “Yêu lắm Việt Nam”](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/362f882012d3432783fc92fab1b3e980)

![[Ảnh] Tổng Bí thư Tô Lâm tiếp Đại sứ Pháp tại Việt Nam Olivier Brochet](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/49224f0f12e84b66a73b17eb251f7278)

![[Ảnh] Bế mạc Hội nghị thượng đỉnh Diễn đàn Đối tác vì tăng trưởng xanh và mục tiêu toàn cầu lần thứ tư](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/c0a0df9852c84e58be0a8b939189c85a)

![[Ảnh] Chủ tịch Quốc hội Trần Thanh Mẫn gặp mặt người lao động tiêu biểu của ngành dầu khí](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/1d0de4026b75434ab34279624db7ee4a)

![[Ảnh] Lễ đón Bộ trưởng Quốc phòng Trung Quốc và đoàn đại biểu sang giao lưu hữu nghị](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/fadd533046594e5cacbb28de4c4d5655)

![[Video] Viettel chính thức đưa tuyến cáp quang biển lớn nhất Việt Nam đi vào hoạt động](https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/4/17/f19008c6010c4a538cc422cb791ca0a1)

Bình luận (0)