En mai 2024, les géants technologiques de renommée mondiale se sont succédé pour lancer de nouvelles versions d'intelligence artificielle (IA), comme OpenAI avec GPT-4o, Google avec Gemini 1.5 Pro... avec de nombreuses fonctionnalités « super intelligentes » ajoutées pour optimiser l'expérience utilisateur. Cependant, il est indéniable que cette technologie est utilisée par les cybercriminels dans de nombreux scénarios de fraude en ligne.

Risque croissant

Lors d'une récente conférence, le vice-ministre de l'Information et des Communications, Pham Duc Long, a souligné le fait que les cyberattaques augmentent continuellement avec une sophistication et une complexité croissantes. Surtout lorsqu’il y a un support d’IA, les risques auxquels les utilisateurs sont confrontés augmenteront de manière exponentielle. « La technologie de l'IA est utilisée par les cybercriminels pour créer facilement de nouveaux logiciels malveillants, de nouvelles attaques de phishing sophistiquées... » - a averti le vice-ministre Pham Duc Long.

Selon un rapport du Département de la sécurité de l'information du ministère de l'Information et des Communications, les risques de cybersécurité liés à l'IA ont causé plus de 1 000 milliards de dollars de dommages dans le monde, dont 8 000 à 10 000 milliards de VND au Vietnam seulement. L’utilisation la plus courante aujourd’hui est l’utilisation de l’IA pour falsifier des voix et des visages à des fins de fraude. On prévoit que d’ici 2025, il y aura environ 3 000 attaques par seconde, 12 logiciels malveillants par seconde et 70 nouvelles vulnérabilités et faiblesses par jour.

Selon M. Nguyen Huu Giap, directeur de BShield - spécialisé dans le support de sécurité des applications - la création de fausses images et voix n'est pas difficile avec les progrès de l'IA. Les fraudeurs peuvent facilement collecter les données des utilisateurs à partir d'informations publiques qu'ils publient sur les réseaux sociaux ou par le biais d'astuces telles que des entretiens d'embauche en ligne et des appels téléphoniques sous le nom d'« autorités ». Dans une simulation menée par BShield, à partir du visage disponible via un appel vidéo, le fraudeur peut les mettre sur le papier CCCD, les fusionner dans le corps d'une personne en mouvement pour tromper l'outil eKYC et être reconnu par le système comme une vraie personne.

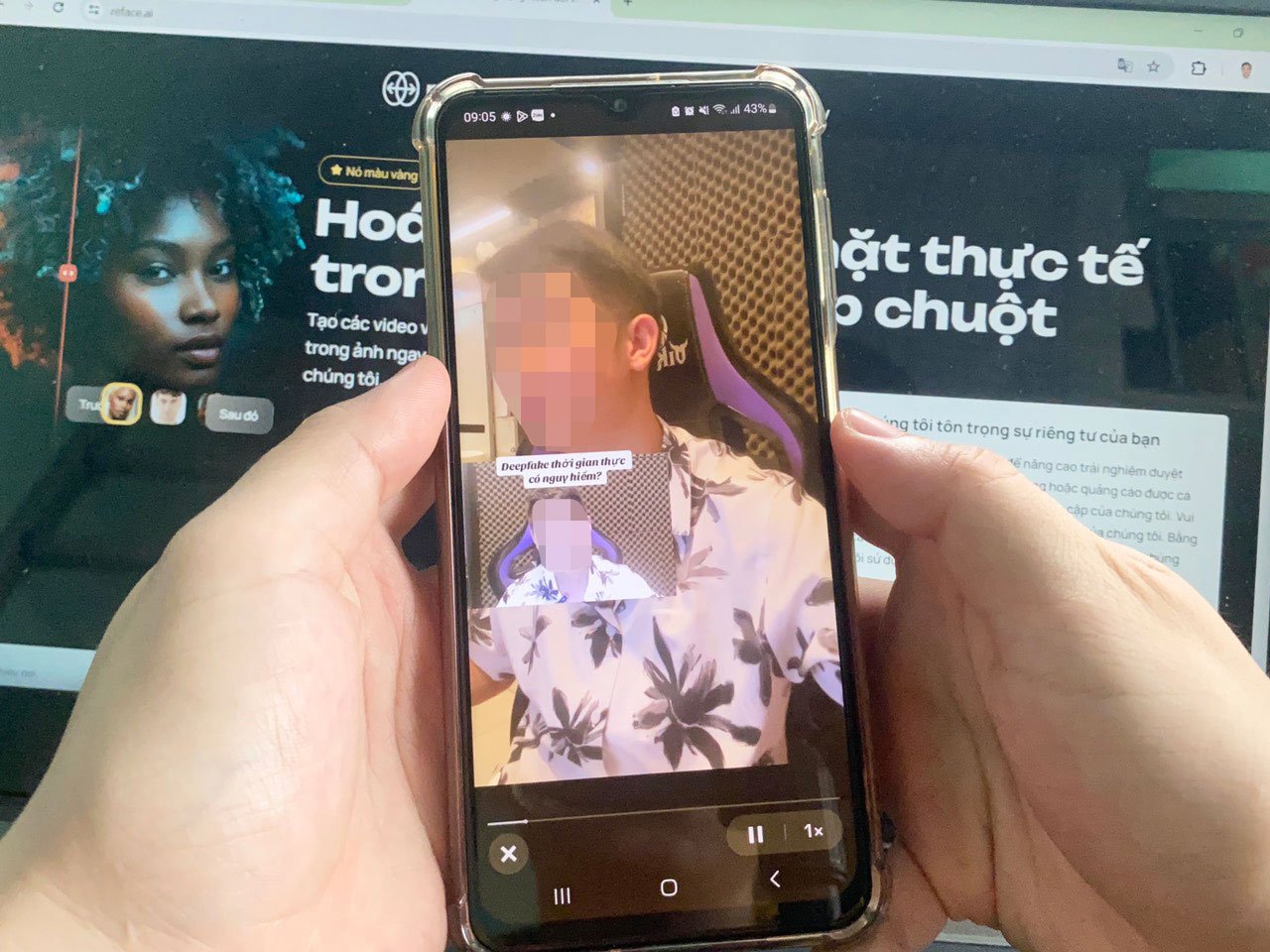

Les méthodes frauduleuses utilisant la technologie deepfake se multiplient et deviennent de plus en plus sophistiquées. Photo : LE TINH

Du point de vue de l'utilisateur, M. Nguyen Thanh Trung, spécialiste informatique à Ho Chi Minh-Ville, craint que des malfaiteurs puissent profiter de chatGPT pour créer des e-mails frauduleux avec un contenu et un style d'écriture similaires à ceux des vrais e-mails provenant de banques ou d'organisations réputées. Ces e-mails sont susceptibles d'être accompagnés de logiciels malveillants. Si les utilisateurs cliquent dessus, leurs données seront certainement volées et leurs actifs seront appropriés. « Les logiciels d'IA sont de plus en plus améliorés, ils peuvent créer de fausses vidéos avec des visages et des voix qui ressemblent à 95 % à de vraies personnes, les gestes changent en temps réel, ce qui rend la détection très difficile pour les spectateurs », a déclaré M. Trung.

Bientôt un corridor juridique complet

Pour limiter le risque de fraude de haute technologie, l'expert en sécurité Pham Dinh Thang a noté que les utilisateurs doivent régulièrement mettre à jour leurs connaissances sur l'IA et ne pas cliquer sur des liens d'origine inconnue. Pour les entreprises, un budget doit être alloué pour garantir la sécurité des données et le fonctionnement du système. Le personnel de l’entreprise doit également être formé en profondeur pour accéder aux vulnérabilités réelles qui se produisent dans le système, augmentant ainsi la capacité à identifier les types de cyberattaques.

M. Ta Cong Son, chef du département de développement de l'IA - Projet anti-fraude, a déclaré que l'IA a pénétré profondément dans la vie des utilisateurs et les opérations des entreprises, des agences et des unités grâce à ses fonctionnalités de support extrêmement intelligentes. Il est à noter que la technologie de l’IA est actuellement très accessible et facile à utiliser, ce qui créera les conditions permettant aux acteurs malveillants d’en tirer facilement profit à des fins frauduleuses. « Les fraudeurs changent également constamment leurs méthodes d'attaque, les utilisateurs doivent mettre à jour régulièrement leurs informations pour savoir comment les prévenir » - a recommandé M. Son.

Selon les experts, les modèles GPT-4o et Gemini 1.5 Pro récemment mis à niveau... ont prouvé que l'intelligence de l'IA n'a pas de limites. Par conséquent, en plus d’encourager les entreprises à développer des outils et des solutions anti-fraude basés sur l’IA, les agences de gestion doivent bientôt compléter le couloir juridique sur l’IA pour garder une longueur d’avance sur la tendance.

Le lieutenant-colonel Nguyen Anh Tuan, directeur adjoint du Centre national de données démographiques, a déclaré qu'il était nécessaire de publier prochainement des documents réglementant l'éthique et les responsabilités des prestataires de services nationaux et étrangers dans le processus de développement, de production, d'application et d'utilisation de l'IA. Dans le même temps, il est nécessaire de mettre en place des réglementations spécifiques sur les normes techniques applicables aux systèmes qui utilisent, appliquent, connectent et fournissent des services d’IA. « Il est nécessaire de rechercher et d'appliquer des projets d'IA pour lutter contre les risques liés à l'IA. L'IA étant créée par l'homme et issue du savoir, il existera des variantes de « bonne » et de « mauvaise » IA. Il est donc possible d'empêcher le développement de l'IA par l'IA elle-même », a souligné le colonel Tuan.

Les défis de la cybersécurité

Le lieutenant-colonel Nguyen Anh Tuan a reconnu que l’IA pose des défis à la cybersécurité. En conséquence, des logiciels malveillants soutenus par l’IA peuvent être installés dans des fichiers de documents. Lorsque les utilisateurs téléchargent des fichiers de documents, ce logiciel malveillant pénètre dans le système. De plus, grâce à des technologies d’IA spéciales, les pirates peuvent simuler des systèmes et attaquer les failles de sécurité. L'IA peut créer de nombreuses applications avec de fausses images et de faux noms d'applications et de sites Web du ministère de la Sécurité publique que les gens peuvent télécharger, installer et fournir des informations telles que le numéro de carte d'identité et le mot de passe de connexion. « L'IA développera également ses propres logiciels et logiciels malveillants hybrides, avec des mécanismes d'évasion de sécurité plus sophistiqués et des modifications flexibles du code source », a averti le lieutenant-colonel Nguyen Anh Tuan.

Source : https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[Photo] Le Premier ministre Pham Minh Chinh préside une conférence sur la lutte contre la contrebande, la fraude commerciale et la contrefaçon](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/14/6cd67667e99e4248b7d4f587fd21e37c)

Comment (0)