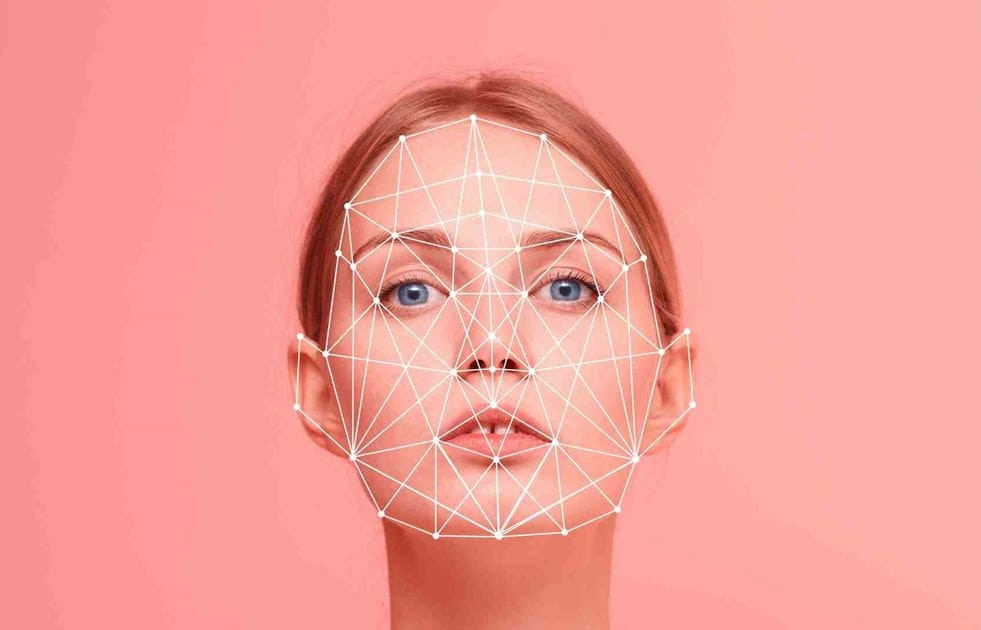

Deepfake ist ein Begriff, der aus der Kombination von „Deep Learning“ und „Fake“ entstanden ist. Einfach ausgedrückt handelt es sich dabei um eine Technologie zur Simulation und Erstellung gefälschter Audio-, Bild- oder sogar Videoprodukte .

Seit der explosionsartigen Entwicklung der künstlichen Intelligenz (KI) ist das Problem der Deepfakes immer populärer geworden und hat Wellen von Fehlinformationen in der Presse ausgelöst. Daher ist die proaktive Authentifizierung der Herkunft von Bildern und Videos für die weltweit führenden Kameraunternehmen ein dringendes Problem.

Es wird erwartet, dass Sony, Canon und Nikon Digitalkameraserien auf den Markt bringen, die digitale Signaturen direkt auf den von ihnen produzierten spiegellosen Kameraserien (oder digitalen DSLR-Kameras) unterstützen. Die Implementierung digitaler Signaturen auf Kameras ist eine äußerst wichtige Maßnahme, um den Ursprung und die Integrität von Bildern nachzuweisen.

Diese digitalen Signaturen enthalten Informationen zu Datum, Uhrzeit, Ort und Fotograf und sind manipulationssicher. Dies ist besonders wichtig für Fotojournalisten und andere Fachleute, deren Arbeit eine Authentifizierung erfordert.

Drei Giganten der Kamerabranche haben sich auf einen globalen Standard für digitale Signaturen geeinigt, der mit dem Online-Verifizierungstool Verify kompatibel ist. Das von einer globalen Koalition aus Nachrichtenorganisationen, Technologieunternehmen und Kameraherstellern ins Leben gerufene Tool ermöglicht die kostenlose Überprüfung der Echtheit jedes Bildes. Wenn Bilder mithilfe von KI erstellt oder geändert werden, kennzeichnet Verify sie mit „Keine Informationen zur Inhaltsüberprüfung“.

Die Bedeutung von Anti-Deepfake-Technologien ergibt sich aus dem rasanten Anstieg von Deepfakes berühmter Persönlichkeiten wie dem ehemaligen US-Präsidenten Donald Trump und dem japanischen Premierminister Fumio Kishida.

Darüber hinaus haben Forscher der Tsinghua-Universität in China ein neues generatives KI-Modell entwickelt, das in der Lage ist, etwa 700.000 Bilder pro Tag zu generieren.

Neben Kameraherstellern beteiligen sich auch andere Technologieunternehmen am Kampf gegen Deepfakes. Google hat ein Tool veröffentlicht, mit dem KI-generierte Bilder digital mit Wasserzeichen versehen werden können, während Intel eine Technologie entwickelt hat, mit der Hauttonveränderungen in Fotos analysiert werden können, um deren Authentizität zu bestimmen. Hitachi erforscht außerdem Technologien zur Verhinderung von Online-Identitätsbetrug.

Die Markteinführung der neuen Technologie ist für Anfang 2024 geplant. Sony plant, die Technologie in den Medien bekannt zu machen und hat im Oktober 2023 bereits Feldtests durchgeführt. Canon arbeitet mit Thomson Reuters und dem Starling Data Preservation Lab (einem von der Stanford University und der University of Southern California gegründeten Forschungsinstitut) zusammen, um die Technologie weiter zu verfeinern.

Die Kamerahersteller hoffen, dass die neue Technologie dazu beitragen wird, das Vertrauen der Öffentlichkeit in Bilder wiederherzustellen, die wiederum unsere Wahrnehmung der Welt prägen.

(laut OL)

Facebook zahlte 5.000 US-Dollar für die Verbreitung eines Deepfake-Investitionsbetrugsvideos

Neue Malware übernimmt die Kontrolle über Smartphones, Deepfake-Videos werden immer raffinierter

Deepfake-Videos werden immer raffinierter und realistischer

Was kann man tun, um nicht in die Falle von Deepfake-Videoanrufen zu tappen, die Geldtransfers vortäuschen?

Deepfakes werden ausgenutzt, um die Gesichter der Opfer in Pornovideos einzufügen

[Anzeige_2]

Quelle

![[Foto] Partei- und Staatsführer nehmen am besonderen Kunstprogramm „Du bist Ho Chi Minh“ teil.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/6895913f94fd4c51aa4564ab14c3f250)

![[Foto] Bereit für die Top-Wettbewerbe des vietnamesischen Tischtennis](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/9c547c497c5a4ade8f98c8e7d44f5a41)

![[Foto] Viele junge Leute stellten sich geduldig unter der heißen Sonne an, um eine Sonderbeilage der Zeitung Nhan Dan zu erhalten.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/5/18/6f19d322f9364f0ebb6fbfe9377842d3)

Kommentar (0)